HiAgent 架构与战略价值

1. 核心定义与证据

实质:HiAgent 不是一个单纯的学术概念,而是火山引擎(Volcengine)推出的企业级 AI 应用开发框架(SDK)。

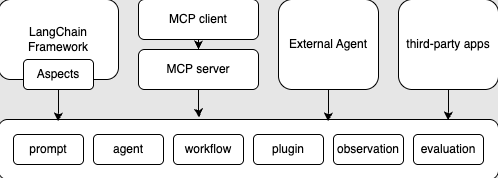

架构逻辑:它采用了“大一统(Unified)”的设计思路,试图在底层将 LangChain 的灵活性、MCP(Model Context Protocol)的连接性、以及外部工具的异构性,统一抽象为标准化的原子能力(Prompt, Agent, Workflow, Evaluation 等)。

技术定位:介于“底层原生 API”与“低代码平台(扣子/Coze)”之间,属于 Pro-Code(专业代码) 开发工具。

2. 关键假设与战略意图

假设验证:该框架建立在“企业需要一站式全家桶”的假设之上。它假定开发者比起自由组装散件(Best-of-breed),更倾向于使用经过厂商验证、开箱即用的成套组件。

差异化战略:

扣子 (Coze):负责“广度”,用低门槛吸纳长尾创意和 C 端流量。

HiAgent:负责“深度”,用标准化组件解决企业级开发中的不可控、难观测、难集成痛点。

3. 核心权衡:便利性 vs. 锁定 (Convenience vs. Lock-in)

根据你的观点,这是采用 HiAgent 最核心的博弈:

收益(得到的):

极速开发:通过提供完整的组件(从 Prompt 管理到评估体系),消除了选型的纠结。

平滑迁移:基于 Python 和 LangChain 生态的封装,使得现有的 AI 工程师无需痛苦的学习曲线即可上手。

企业级特性:直接获得了原本需要单独搭建的“观测(Observation)”和“评估(Evaluation)”能力。

代价(失去的):

深度绑定:你接受了“供应商锁定”。这意味着应用越复杂,越难以脱离火山引擎的云生态。

架构固化:应用架构被限制在 HiAgent 定义的范式内,灵活性受限于 SDK 的迭代速度。

4. 对“AI 架构师”角色的重新评估

你提出极其犀利的观点:“使用 HiAgent,企业已经不需要 AI 架构师。” 对此,经过综合分析,我们的结论需要做微调:企业不再需要“造轮子”的基础设施架构师,但更需要“懂业务”的解决方案架构师。

什么消失了? 以前需要架构师去设计“怎么连大模型”、“怎么做日志监控”、“怎么设计 Agent 内存机制”。HiAgent 把这些**基础设施工作(Infrastructure)**标准化了,所以纯技术型的“管道工”架构师确实不再被需要。

什么留下了? HiAgent 解决了“怎么做(How)”,但没解决“做什么(What)”和“为什么做(Why)”。企业依然需要高阶人员决策:

数据安全策略:私有数据如何通过 HiAgent 安全流转?

成本控制模型:如何优化 Token 消耗策略?

复杂业务编排:如何用标准组件实现非标准的复杂业务逻辑?

5. 最终建议

HiAgent 是以下类型企业的“最佳答案”:

深度依赖火山引擎生态:已经在使用字节系的云服务或大模型。

追求交付速度:项目工期紧,需要快速从 Demo 推进到生产环境。

团队配置务实:团队以中级开发人员为主,缺乏顶级架构师来从零搭建 LLM Ops 平台。

一句话小结: HiAgent 是字节跳动为企业开发者提供的一套“精装修房”。你不需要操心水电煤(基础设施)和硬装(底层框架),拎包(带上业务逻辑)即可入住。代价是,你不能随意改变房间的格局,而且你必须一直缴纳“物业费”(留在火山引擎生态内)。对于大多数只需解决业务问题的企业来说,这是一笔划算的交易。

BiSheng 架构

“毕升”由北京数据项素智能科技有限公司(DataElement)开发,是一个开源的 LLM DevOps 平台。将它与 HiAgent 进行对比。

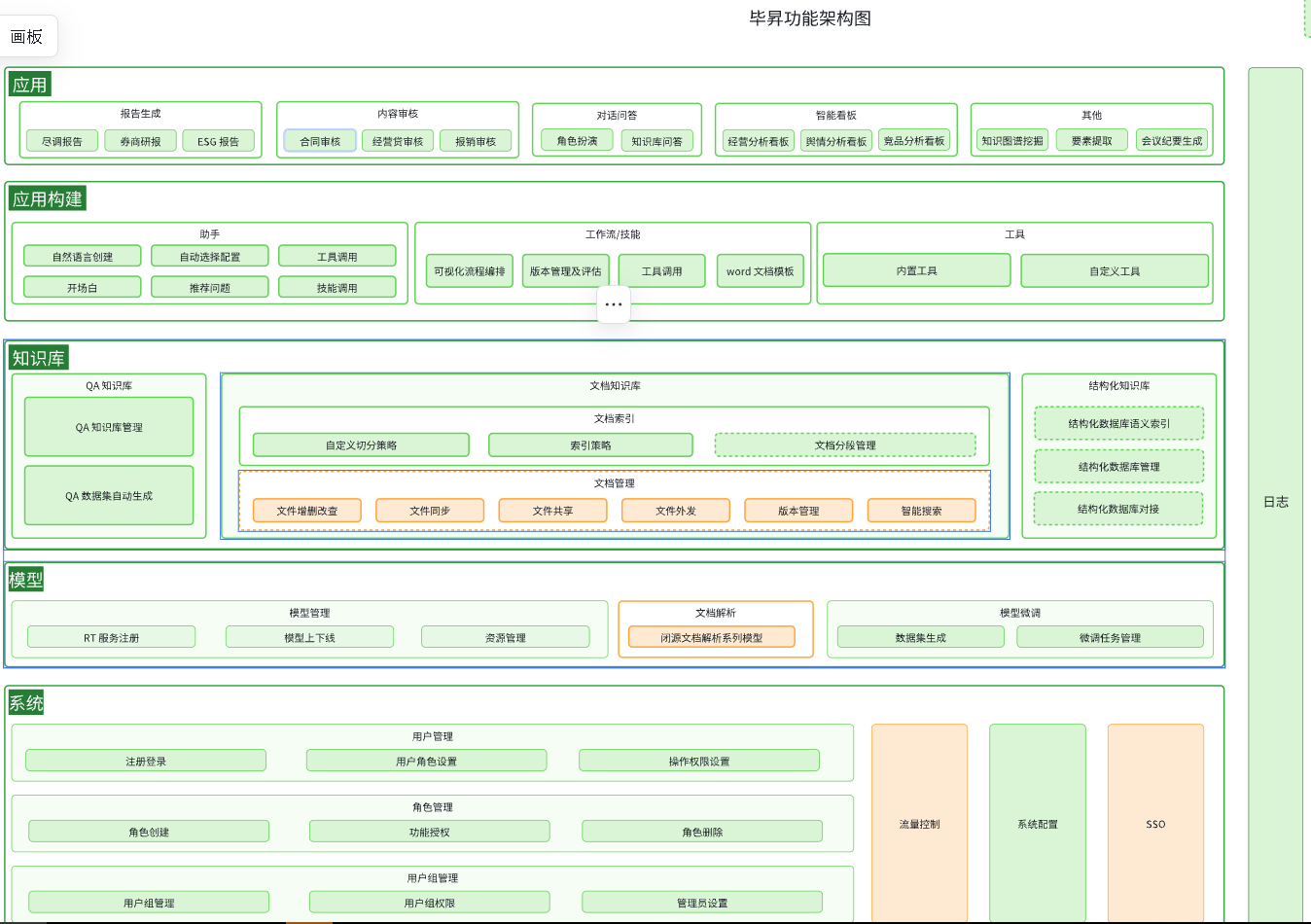

功能架构

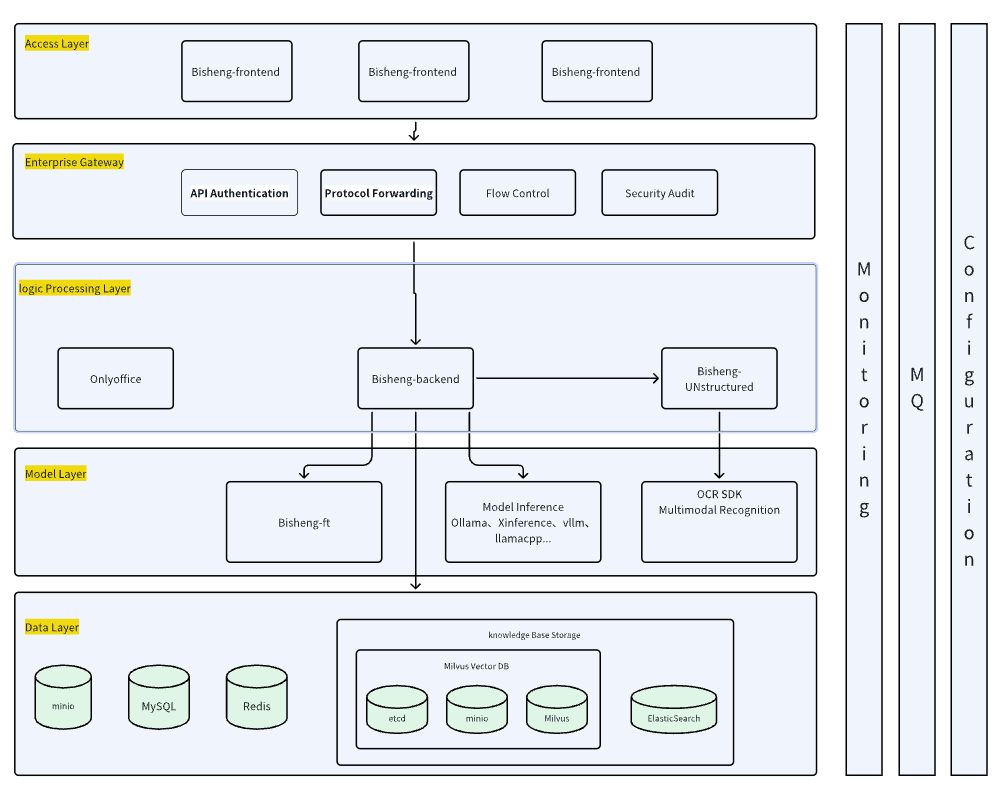

部署架构

应用场景解读

https://dataelem.feishu.cn/wiki/BlAZwupR7iNVXzk4SLIces55nqe?table=tbl1OJa9vYkwfqZ9&view=vewTlDP6A2

BiSheng 非国产化硬件配置

机箱:4U GPU服务器

CPU:2颗英特尔志强6148金牌处理器,每颗20物理核,主频2.4GHz

内存:512G DDR4 ECC 内存

硬盘:6 * 960G SSD 固态硬盘(系统盘2*960G RAID1,数据盘4*960G RAID5)

计算加速卡:4 * 英伟达Tesla A40 48G PCIe GPU 加速卡(其他推荐:H100、A100、A10、3090、4090)

电源:2*2000W 冗余热插拔电源

核心定位:连接器 vs. 操作系统

HiAgent (字节/火山引擎):

定位:SDK 级中间件。

比喻:它是通向火山引擎生态的“高速公路入口”。

核心逻辑:Code-First。它是为了让你写 Python 代码更方便,本质上是 LangChain 的一层“厚封装”,重点在于连接厂商的云服务能力。

BiSheng (数据项素):

定位:应用级 DevOps 平台。

比喻:它是一个独立的“加工厂”。

核心逻辑:Platform-First。它提供了一个可视化的工作台,包含模型管理、知识库(RAG)流水线、评估和应用编排。它不只是代码库,而是一个可以私有化部署的系统。

开放性与锁定风险:云厂商锁定 vs. 平台锁定

HiAgent(强云厂商锁定):

风险点:正如我们之前分析的,HiAgent 是火山引擎的战略工具。它的深度集成是为了让你离不开火山的算力和生态。

迁移难度:极高。代码逻辑与厂商 SDK 深度耦合。

BiSheng(弱平台锁定):

风险点:虽然它支持接入多家模型(阿里、OpenAI、火山等),但你会被锁定在“毕升”这个平台的架构范式里。你的工作流是毕升特有的 JSON 或 YAML 定义,而不是通用的 Python 代码。

迁移难度:中等。因为是开源(Apache 2.0)且支持私有化部署,你拥有代码掌控权。即使厂商(数据项素)倒闭,你依然可以在内网运行这个平台,但二次开发需要懂它的 Java/Python 微服务架构。

目标场景:云原生开发 vs. 私有化落地

HiAgent 胜出场景:

你的企业数据已经都在云上了。

你追求极致的 API 调用速度和弹性。

你的团队是纯粹的 Python 开发者,喜欢写代码控制一切。

BiSheng 胜出场景:

敏感数据不出域:这是毕升最大的杀手锏。它支持完全的私有化部署(On-Premise),特别适合金融、政务、军工等对数据合规要求极高的行业。

非结构化数据治理:毕升在 RAG(检索增强生成)方面做了很多针对 PDF、表格解析的底层优化(这是数据项素公司的老本行),而 HiAgent 这部分可能更多依赖云端 API。

混合角色协作:需要业务人员(拖拽编排)和开发人员(写插件)在同一个平台上工作。

BaaS (Backend-as-a-Service) 的胜利

HiAgent 的逻辑:SDK 优先。它认为开发者的核心还在代码里,SDK 只是帮你在代码里更好调用云服务。

BiSheng 的逻辑:平台优先。它认为你需要一个厚重的私有化管理台,去处理那些脏活累活(解析 PDF、切分数据)。

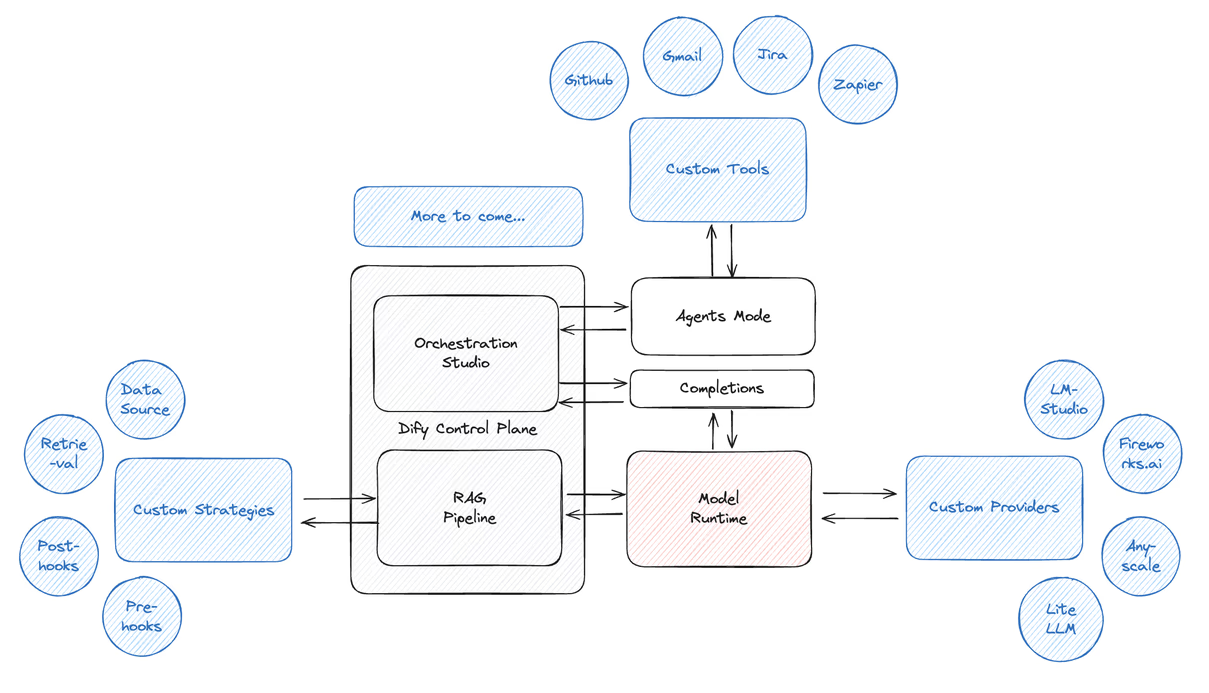

Dify 的逻辑:中间件优先(Middleware)。

它创造了一个新概念:LLM 应用的后端即服务。

它把 RAG、Agent 编排、模型管理都封装成了一套标准的 API。你既可以用它的可视化界面(No-Code)快速搭一个 Demo,也可以用 API(Pro-Code)把它集成到你自己的前端应用里。

战略高地:Dify 赢在“可进可退”。进可以做无代码交付,退可以做纯后端引擎。

Dify 最令企业心动的点

在 HiAgent 模式下:业务提需求 -> 产品写文档 -> 开发写代码。路径长,沟通损耗大。

在 Dify 模式下:产品经理直接在 Dify 画出 Workflow,调通 Prompt。开发人员只需要写一个“自定义代码节点”去处理特殊逻辑,或者直接通过 API 调用这个编排好的应用。

影响:它让“非技术人员”具备了生产力。这在企业内部推广 AI 时至关重要。

Dify 缺点

“玩具”陷阱:Dify 的可视化界面容易让人觉得 AI 很简单。但当应用复杂度达到一定阈值(比如超长复杂的 Agent 循环),可视化连线会变成“意大利面条”,维护难度反而高于纯代码(HiAgent 模式)。

RAG 瓶颈:Dify 的内置 RAG 属于“通用标准件”。如果你面临的是极其专业的文档(如石油勘探报告、复杂的金融报表),你可能发现 Dify 怎么切都切不对。这时候,BiSheng 这种允许你深度魔改解析流程的平台反而是救星。

性能黑盒:作为中间件,Dify 封装了太多逻辑。当 API 响应慢时,你很难排查是模型慢、数据库慢,还是 Dify 的 Python 解释器慢。

Dify架构

三个框架对比

维度 | HiAgent (火山) | BiSheng (毕升) | Dify |

上手难度 | 中 (需要懂 Python/LangChain) | 高 (需要运维部署复杂微服务) | 低 (产品经理都能用拖拉拽上手) |

生态开放性 | 低 (绑定火山引擎) | 中 (开源,但架构较重) | 极高 (模型中立,社区插件极其丰富) |

RAG 能力 | 依赖云端 (云端解析能力) | 特种兵 (擅长复杂表格/PDF解析) | 通用型 (标准 RAG,够用但非最强) |

工作流编排 | 代码定义 (灵活性最高,可视化弱) | 可视化 (偏向数据处理流) | 可视化 + 代码节点 (最佳平衡点) |

最佳场景 | 纯开发者写 Python 后端服务 | 国企/金融私有化知识库 | 快速构建 AI 应用 MVP / 企业内部工具 |

权衡

选 Dify,如果:

你需要快速试错,甚至让业务部门自己去试错。

你需要一个模型中立的平台,今天用 GPT-4,明天想无缝切到 DeepSeek 或 Claude。

你的应用场景是标准的客服、知识库、助手。

不选 Dify(而选 HiAgent),如果:

你的应用逻辑极度复杂,需要写几千行 Python 代码来控制状态机。

你已经全栈绑定了字节跳动的基础设施。

不选 Dify(而选 BiSheng),如果:

你的核心资产是异构、复杂的私有文档,且数据绝对不能出内网。

你需要对文档解析(Parsing)做像素级的优化。

如果你是互联网公司 / SaaS 创业者:选 HiAgent(或直接用 LangChain)。你需要的是轻量、快速迭代,不需要自己维护一套厚重的 DevOps 平台。

如果你是国企 / 金融机构 / 传统大型企业:选 BiSheng。数据安全和私有化部署是你的红线。你需要的不是一个“好用的 Python 库”,而是一个“看得见、摸得着、数据完全可控”的内部 AI 中台。

总结

Dify 是目前市场上“最大公约数”最好的产品。它不够 HiAgent 那么原生硬核,也不像 BiSheng 那么垂直专精,但它最像现代软件工程需要的“中间件”——足够好用,足够灵活,且不被单一厂商绑架。

今天先到这儿,希望对AI,云原生,技术领导力, 企业管理,系统架构设计与评估,团队管理, 项目管理, 产品管理,信息安全,团队建设 有参考作用 , 您可能感兴趣的文章:

微服务架构设计

视频直播平台的系统架构演化

微服务与Docker介绍

Docker与CI持续集成/CD

互联网电商购物车架构演变案例

互联网业务场景下消息队列架构

互联网高效研发团队管理演进之一

消息系统架构设计演进

互联网电商搜索架构演化之一

企业信息化与软件工程的迷思

企业项目化管理介绍

软件项目成功之要素

人际沟通风格介绍一

精益IT组织与分享式领导

学习型组织与企业

企业创新文化与等级观念

组织目标与个人目标

初创公司人才招聘与管理

人才公司环境与企业文化

企业文化、团队文化与知识共享

高效能的团队建设

项目管理沟通计划

构建高效的研发与自动化运维

某大型电商云平台实践

互联网数据库架构设计思路

IT基础架构规划方案一(网络系统规划)

餐饮行业解决方案之客户分析流程

餐饮行业解决方案之采购战略制定与实施流程

餐饮行业解决方案之业务设计流程

供应链需求调研CheckList

企业应用之性能实时度量系统演变

如有想了解更多软件设计与架构, 系统IT,企业信息化, 团队管理 资讯,请关注我的微信订阅号:

作者:Petter Liu

出处:http://www.cnblogs.com/wintersun/

本文版权归作者和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文连接,否则保留追究法律责任的权利。

该文章也同时发布在我的独立博客中-Petter Liu Blog。

浙公网安备 33010602011771号

浙公网安备 33010602011771号