论文解读-FedGNN

1. 论文介绍

论文题目:FedGNN: Federated Graph Neural Network for Privacy-Preserving Recommendation

论文领域:联邦学习 + 图神经网络

论文发表: ICML 2021

2. 论文贡献

1,提出了一种新的联邦学习框架,隐私保护下的GNN推荐模型

2,针对传输的模型梯度,采用本地差分隐私来保护数据安全

3,提出了一个针对高阶 user-item集合的隐私保护手段

4,实验证明了联邦学习下的GNN推荐算法可以获得比同等类型GNN推荐更好的效果

3. 相关工作

本地训练GNN推荐算法的困难:

- 1,本地数据量太少,需要一个能够协作大量client端的训练框架

- 2,基于本地数据训练的GNN也可能泄露隐私,在得知全局GNN和本地GNN下如何保护隐私的安全

- 3,本地用户数据只包含一阶的user-item交互数据,多用户-item交互数据不能被直接获取。如何在隐私保护下使用高阶数据

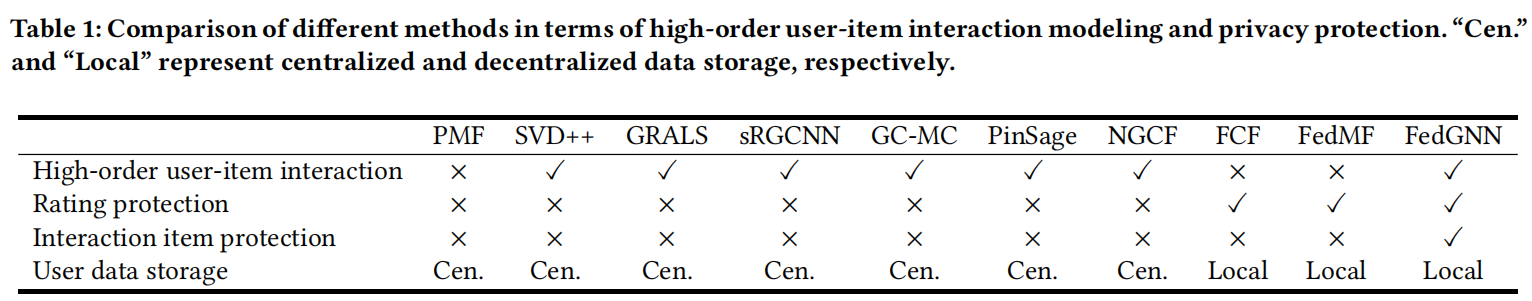

本文算法和其他推荐算法的比较

4. 论文算法

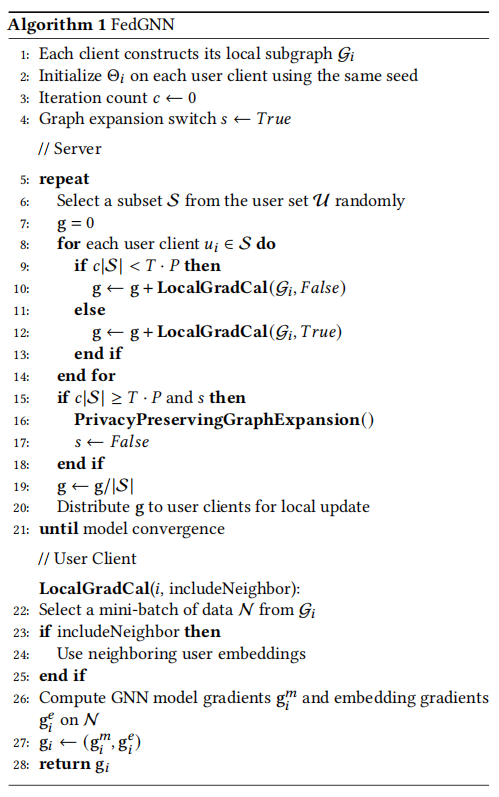

fedGNN的算法框架

每一个client会学习user-item嵌入信息,基于本地子图来训练GNN模型。然后上传梯度给中心服务器。中心服务器负责协调各个client和集成学习到的梯度。

4.1 fedGNN的详细的算法流程

4.2 fedGNN的隐私保护的模型更新

如果client直接上传梯度,那么只有user-item对应的才为非0梯度,很容易恢复出原始数据。GNN模型梯度和rating predictor也会暴露用户喜好。

两个解决策略,

第一个是伪交互项采样pseudo interacted item sampling,随机采样M个user没有交互的item,使用等同于真实item嵌入空间的均值和方差的高斯分布来产生它们的梯度。(K维随机响应机制)

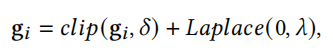

第二个是本地差分隐私,使用正则化裁剪,用零均值的拉普拉斯噪声来添加本地差分隐私

4.3 fedGNN的隐私保护的user-item图扩展

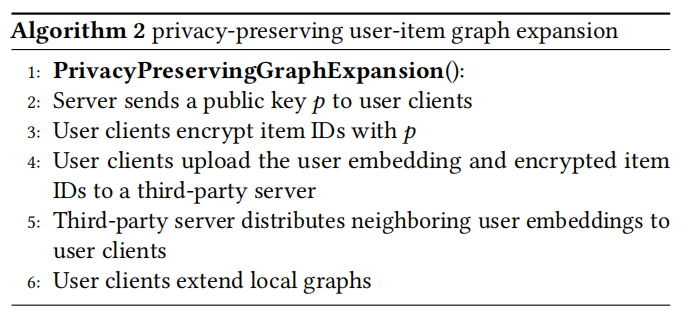

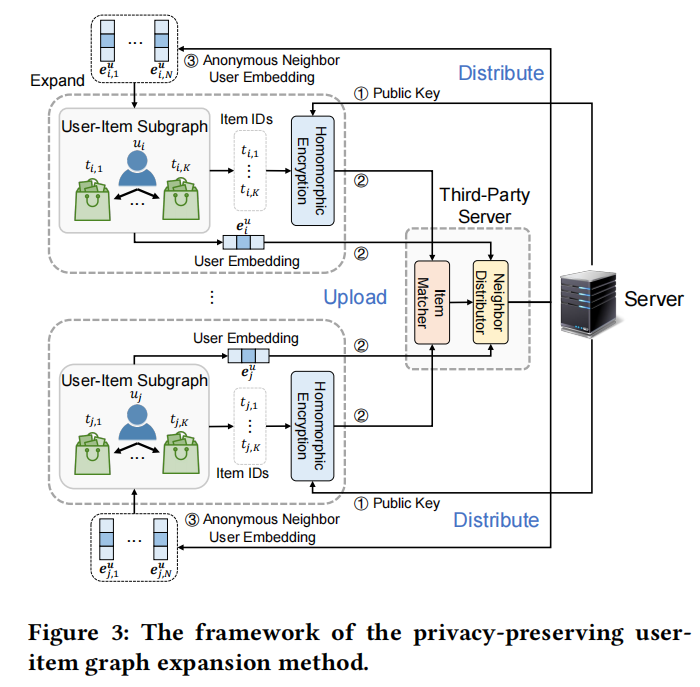

图扩展技术算法流程为:

第一步是中心服务器给每一个client发给一个public key。每一个client基于public key使用同态加密,对本地的item IDs进行加密。

其次,第三方服务器不需要是信任的,负责收集两两user之间的共同item,并相互匹配,然后给各个user提供匿名的邻居的嵌入空间。第三方服务器因为不能解密item IDs,所以也是隐私安全的。

通过这个算法,本地的user-item图可以被高阶的user-item数据丰富。

框架图为:

4.4 fedGNN的LDP

LDP是本地差分隐私技术,用在本地梯度上传上。隐私保护的budget的边界如下,需要在隐私保护和模型性能上保持一个平衡。

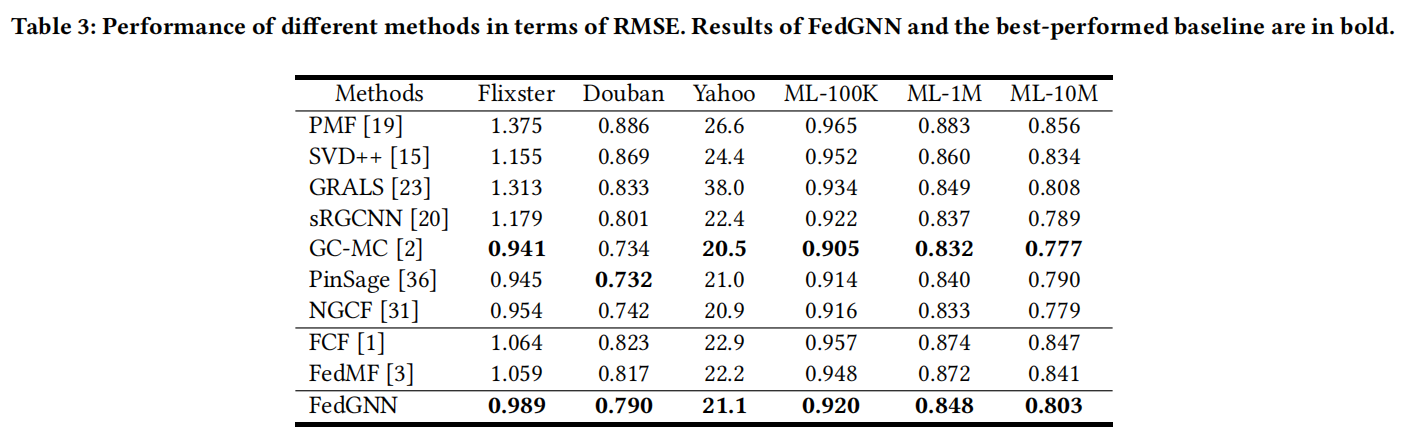

5. 实验设置

使用GAT模型作为GNN模型,使用点积来实现排序预测。

使用RMSE 均方根误差(rooted mean square error)作为评价指标。

对比方法有

PMF 概率矩阵因子分解 probability matrix factorization

SVD++ 基于奇异值分解的推荐算法

GRALS 基于图信息的协同过滤算法

sRGCNN 基于递归多图神经网络的矩阵完备化方法

GC-MC 基于图卷积的自动编码机的矩阵完备化方法

PinSage 基于2跳的GCN网络的推荐技术

NGCF 图神经网络的协同过滤算法

FCF 基于联邦协同过滤的隐私保护推荐算法

FedMF 基于安全矩阵分解的隐私保护推荐算法

从上面的实验结果得到几个结论

- 1,基于高阶信息的算法(GC-MC,PinSage, NGCF)表现更优于基于一阶信息的(PMF)

- 2,对比中心存储数据的(GC-MC, NGCF),本文算法比肩甚至更好。

- 3,本算法同时保护rating和user-item交互,FCF和FedMF只保护rating。

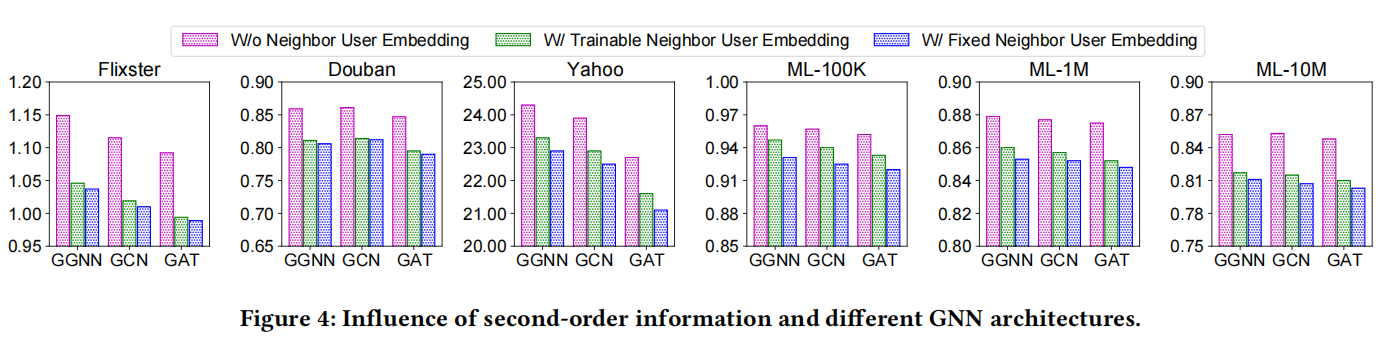

以下对比说明了fedGNN可以基于多种的底层GNN模型,证明了通用性。

6. 超参数分析

差分隐私的参数的不同对整体的影响

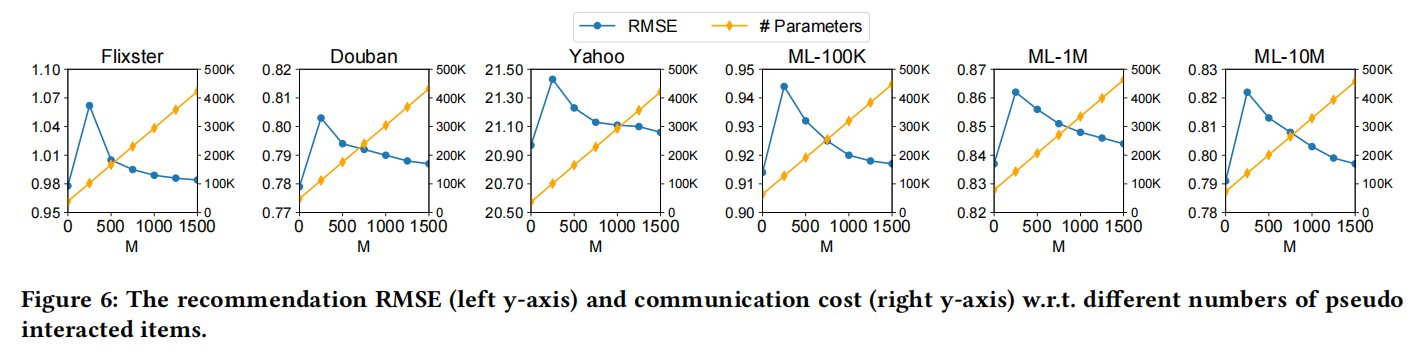

伪交互项采样的个数对结果RMSE的影响和对训练通信的消耗的影响

7. 总结

本文将基于GNN的推荐算法 ,联邦学习,差分隐私保护技术三者进行有效的融合,本来GNN在推荐算法中的制霸地位,较大的创新点是高阶user-item的交互信息模型,利用差分隐私和第三方服务器来丰富本地的子图。

浙公网安备 33010602011771号

浙公网安备 33010602011771号