数值优化 —— 牛顿法为啥要求Hession矩阵为正定矩阵???

数值优化中的牛顿法为啥要求Hession矩阵为正定矩阵

DeepSeek 思考过程:

嗯,我现在要理解为什么数值优化中的牛顿法需要Hessian矩阵是正定矩阵。这个问题我之前学过一点,但可能有些细节还不太清楚,得仔细想想。

首先,牛顿法是一种迭代优化方法,用来寻找函数的极小值或者极大值。在优化问题中,我们通常关注的是极小化目标函数。牛顿法的基本思想是利用目标函数的二阶泰勒展开来近似,然后通过迭代的方式逼近极小点。具体的迭代公式我记得是x_{k+1} = x_k - H^{-1}(x_k) * g(x_k),其中H是Hessian矩阵,g是梯度。

那么为什么Hessian矩阵需要正定呢?首先,正定矩阵有什么性质呢?正定矩阵的所有特征值都是正的,这保证了矩阵是可逆的,因为行列式不为零。所以,Hessian矩阵正定的话,首先可以保证它是可逆的,这样在计算迭代步长的时候,H^{-1}存在,不会出现无法计算的情况。这一点可能是一个原因,如果Hessian矩阵不是正定的,可能不可逆,导致无法进行牛顿法的迭代步骤。

不过可能还有更深入的原因。比如,在寻找极小值时,我们希望每次迭代的步长是朝着下降方向进行的。也就是说,方向d = -H{-1}g应该是一个下降方向。那下降方向的条件是什么呢?我记得是梯度的转置乘以方向向量要小于零,也就是gT * d < 0。如果Hessian矩阵正定的话,方向d = -H{-1}g,那这时候梯度和方向的内积是-gT H^{-1} g。因为H正定,所以H{-1}也是正定的,因此gT H^{-1} g > 0(只要g不等于零),所以-g^T H^{-1} g < 0,这说明d确实是下降方向。所以Hessian正定保证了牛顿方向是下降方向,这对于算法的收敛很重要。

反过来,如果Hessian矩阵不是正定的,比如说有负特征值或者零特征值的话,可能H{-1}就不存在,或者即使存在,方向d可能就不是下降方向了。例如,如果Hessian矩阵在某个点处是不定的,也就是既有正特征值又有负特征值,那么这时候H可能使得方向d反而指向了上升的方向,导致算法不收敛或者发散。

另外,二阶条件方面,对于极小点来说,Hessian矩阵在该点处需要是半正定的(必要条件),而如果是严格正定的话,那就是充分条件。所以在使用牛顿法时,如果当前点的Hessian是正定的,说明该点可能处在一个局部凸的区域,这时候用牛顿步长能有效地逼近极小点。而如果Hessian不是正定的,可能当前点附近存在鞍点或者局部极大点,这时候牛顿法可能会失效,或者需要修正,比如使用修正牛顿法,或者拟牛顿法。

还有一个可能的方面是步长的有效性。如果Hessian矩阵正定,那么牛顿法的步长可以保证在目标函数是凸函数的情况下,一步迭代就能到达极小点。这种情况下,牛顿法具有二次收敛性。但是对于非凸函数,Hessian可能在某些区域不是正定的,这时候需要采取其他策略,比如混合方法或者引入正则化项来保证Hessian的正定性,例如Levenberg-Marquardt算法中的处理方式。

不过,我是不是遗漏了一些其他原因呢?比如,Hessian矩阵正定还能保证二次模型在该点有一个唯一的极小点。牛顿法实际上是在每一步用二次函数近似原函数,然后找到这个二次函数的极小点作为下一步的迭代点。如果Hessian正定,那么这个二次函数是凸的,存在唯一的极小点,这时候牛顿法可以正确找到这个点。反之,如果Hessian不是正定的,二次模型可能没有极小点,而是有一个鞍点或者极大点,这样直接使用牛顿步长可能会让迭代点朝着错误的方向移动,导致算法不稳定或者发散。

再想一下,如果Hessian矩阵不是正定的,比如说在某个方向上是负曲率的,那么沿着这个方向,二次模型是开口向下的抛物线,这时候二次模型的极小点其实不存在,或者说在无穷远处。这时候牛顿步长给出的方向可能是一个上升方向,导致目标函数值增加,这显然不是我们想要的。

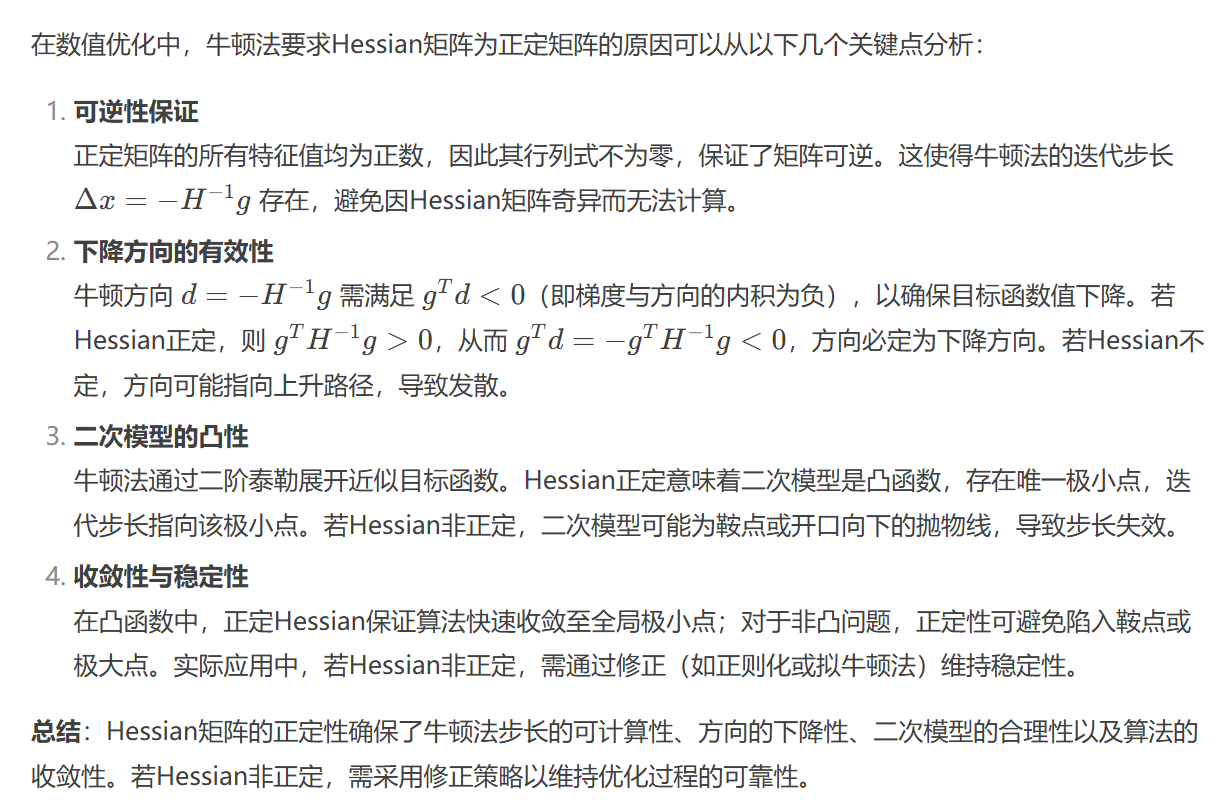

所以综合这些因素,Hessian矩阵正定确保了以下几点:

-

Hessian矩阵可逆,从而迭代步长存在。

-

迭代方向是下降方向,保证目标函数值在迭代过程中减少。

-

二次模型在该点有一个唯一的极小点,使得牛顿法能正确找到这个点。

-

在凸函数的情况下,保证算法快速收敛到全局极小点。

不过,实际应用中,特别是在非凸优化问题中,Hessian矩阵可能并不总是正定的。这时候就需要对牛顿法进行修正,比如使用拟牛顿法(如BFGS)来保持正定性,或者在Hessian矩阵中加入一个足够大的单位矩阵倍数,使其变为正定(如Levenberg-Marquardt方法中的处理)。这样做的目的是在保持算法稳定性的同时,尽可能利用二阶信息加速收敛。

总结起来,牛顿法要求Hessian矩阵正定主要是为了保证算法的稳定性、下降方向的正确性以及二次模型的凸性,从而确保迭代过程能够有效逼近极小点。如果Hessian矩阵不正定,这些条件可能无法满足,导致算法失效或者表现不佳。

回答:

posted on 2025-03-15 17:44 Angry_Panda 阅读(210) 评论(0) 收藏 举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号