0826 每日文献阅读 打卡

|

Read Data: 0826 |

Publication: CVPR 2020 |

||

|

Title: MixNMatch: Multifactor Disentanglement and Encoding for Conditional Image Generation Participants: Yuheng Li Krishna Kumar Singh Utkarsh Ojha Yong Jae Lee |

|||

|

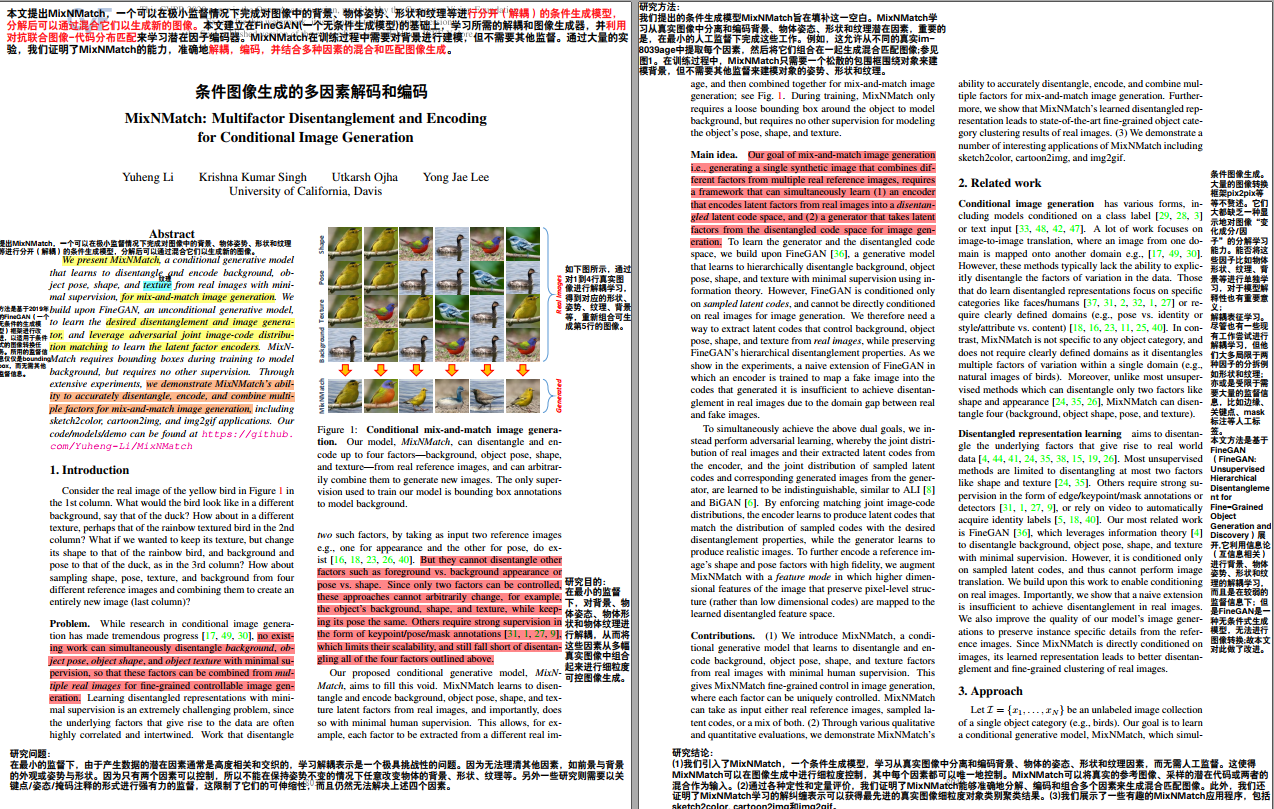

Aim: 在最小的监督下,对背景、物体姿态、物体形状和物体纹理进行解耦,从而将这些因素从多幅真实图像中组合起来进行细粒度可控图像生成。 |

Research Question: 在最小的监督下,由于产生数据的潜在因素通常是高度相关和交织的,学习解耦表示是一个极具挑战性的问题。本文提出的条件生成模型MixNMatch旨在填补这一空白。MixNMatch学习从真实图像中分离和编码背景、物体姿态、形状和纹理潜在因素,重要的是,在最小的人工监督下完成这些工作。 |

||

|

Method: FineGAN将四个随机采样的潜码(z,b,c,p)作为输入,以三个阶段分层次生成图像:(1)背景阶段,其中仅建模学习如何生成背景,以一个one-hot的潜码b为条件;(2)父阶段,在该阶段中,模型以潜码p和连续的z为条件,生成对象的形状和姿势,并将其融合进背景图像上;(3)子阶段,以one-hot的潜码c为条件,对上一生成图像进行纹理填充。

在父阶段和子阶段中,FineGAN都会自动生成mask(无需任何监督mask)以捕获适当的形状和纹理细节。为了解开背景因子,该方法依赖于对象边界框(例如,通过对象检测器获取)。为了在没有其它监督的情况下解耦剩余的因子,FineGAN使用信息论方法(参考inforGAN),对潜码之间的关系施加了约束。

在训练期间,FineGAN(1)将采样的子阶段潜码约束为不相交的group,以便每个group共享相同的唯一父阶段潜码,(2)将每个生成的图像的采样背景和子潜码强制为相同的。

|

|||

|

Results: 通过大量的实验,我们证明了MixNMatch的能力,准确地解耦,编码,并结合多种因素的混合和匹配图像生成。 |

Discussion: 最后,也谈及一些方法的局限:1. 生成的背景可能会错过大型结构,因为使用patch鉴别器。2. 特征模式的训练比较敏感、取决于码模式下所训练模型的好坏。3. 对于图像的背景和目标对象纹理相似的场合下,无法生成良好的mask,导致生成一个不合理的目标物体。 |

||

|

Conclusion: (1)我们引入了MixNMatch,一个条件生成模型,学习从真实图像中分离和编码背景、物体的姿态、形状和纹理因素,而无需人工监督。这使得MixNMatch可以在图像生成中进行细粒度控制,其中每个因素都可以唯一地控制。MixNMatch可以将真实的参考图像、采样的潜在代码或两者的混合作为输入。(2)通过各种定性和定量评价,我们证明了MixNMatch能够准确地分解、编码和组合多个因素来生成混合匹配图像。此外,我们还证明了MixNMatch学习的解纠缠表示可以获得最先进的真实图像细粒度对象类别聚类结果。(3)我们展示了一些有趣的MixNMatch应用程序,包括sketch2color, cartoon2img和img2gif。 |

Further: |

||

|

Ref: 提出MixNMatch,一个可以在无监督情况下完成对图像中的背景、物体姿势、形状和纹理等进行分开(解耦)的条件生成模型,分解后可以通过混合它们以生成新的图像。建立在FineGAN(一个无条件生成模型)的基础上,学习所需的解耦和图像生成器,并利用对抗联合图像-代码分布匹配来学习潜在因子编码器。MixNMatch在训练过程中需要对背景进行建模,但不需要其他监督。

|

|||

浙公网安备 33010602011771号

浙公网安备 33010602011771号