0705 每日文献阅读 打卡

|

Read Data: 0705 |

Publication: ICCV 2019 |

||

|

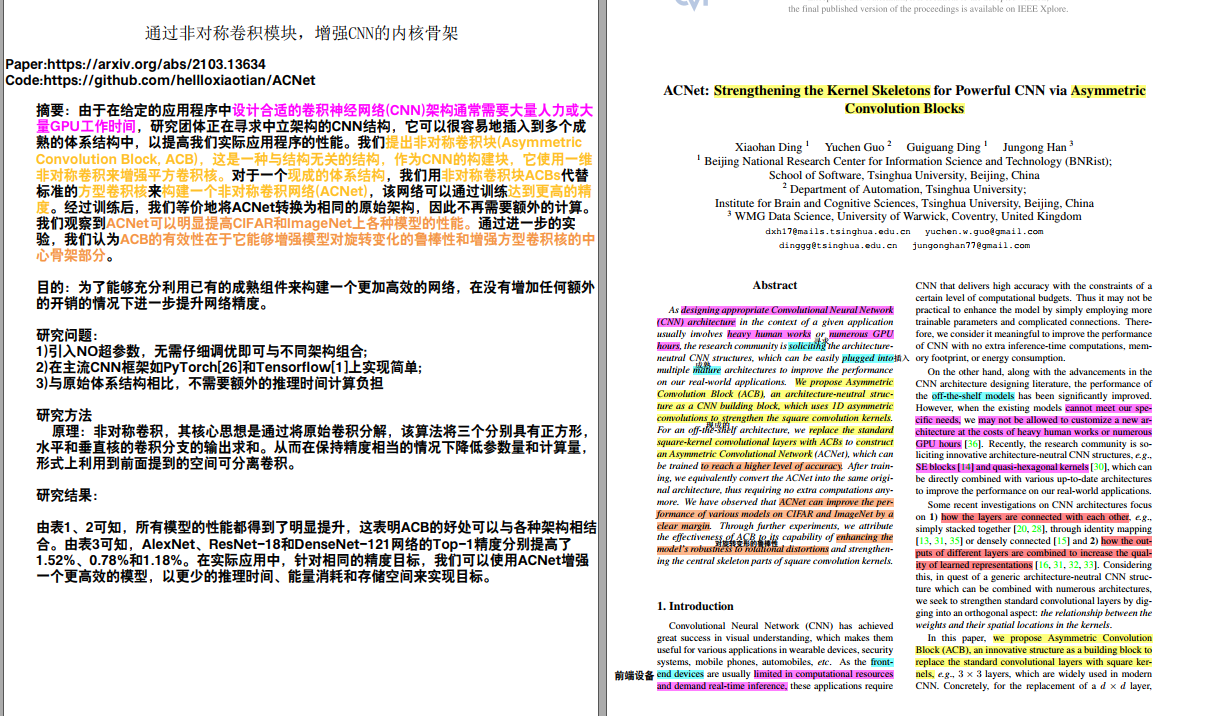

Title: ACNet: Strengthening the Kernel Skeletons for Powerful CNN via Asymmetric Convolution Blocks Participants: Xiaohan Ding ; Yuchen Guo; Guiguang Ding ; Jungong Han |

|||

|

Aim: 为了能够充分利用已有的成熟组件来构建一个更加高效的网络,在没有增加任何额外的开销的情况下进一步提升网络精度。 |

Research Question: 1)引入NO超参数,无需仔细调优即可与不同架构组合; 2)在主流CNN框架如PyTorch和Tensorflow上实现简单; 3)与原始体系结构相比,不需要额外的推理时间计算负担 |

||

|

Method: 非对称卷积原理: 其核心思想是通过将原始卷积分解,该算法将三个分别具有正方形,水平和垂直核的卷积分支的输出求和。从而在保持精度相当的情况下降低参数量和计算量,形式上利用到前面提到的空间可分离卷积。 公式:对于具有H×W和D滤核尺寸的卷积层,并以C通道特征图作为输入,我们使用F表示3D卷积核,M输入,这是一个具有U×V和C通道的空间分辨率的特征图,而O分别为具有D通道的输出。 可加性:如果几个具有兼容大小的2D内核在相同的步幅上以相同的步幅运行以产生具有相同分辨率的输出,并且将它们的输出相加,我们可以将这些内核在相应的位置上相加为 获得将产生相同输出的等效内核。也就是说,即使具有不同的内核大小,可加性也适用于2D卷积, |

|||

|

Results: 由表1、2可知,所有模型的性能都得到了明显提升,这表明ACB的好处可以与各种架构相结合。由表3可知,AlexNet、ResNet-18和DenseNet-121网络的Top-1精度分别提高了1.52%、0.78%和1.18%。在实际应用中,针对相同的精度目标,我们可以使用ACNet增强一个更高效的模型,以更少的推理时间、能量消耗和存储空间来实现目标。 |

Discussion:

非对称卷积仅引入少量超参数便可方便的与其它结构结合而无需微调,显示增强标注卷积核的特征表达能力。

应用非对称卷积可以在没有增加额外的推理时间和计算开销的前提下,有效的提高网络精度,同时增强模型对旋转失真物体的鲁棒性。 |

||

|

Conclusion: 我们用ACB代替成熟体系结构中的平方核层,构造了一个非对称卷积网络(ACNet),并在训练后将其转换为原来的体系结构。我们在CIFAR和ImageNet上对ACNet进行了评估,改进了各种普通的、残差的和密集连接的模型。我们已经证明ACNet可以增强模型的鲁棒性,以可观的边际,并明确地加强骨架的性质的平方核。值得注意的是,ACNet引入了不需要调整的超参数,不需要额外的推理时间计算,并且使用主流框架实现起来很简单。 |

Further: |

||

|

Ref: 原作者在2021年的CVPR会议上进一步提出了ACN v2,设计出一种称为Diverse Branch Block的模块,创造性的将Inception的多分支、多尺度思想与过参数化思想进行了一次组合,是一种可以提升CNNs性能且推理耗时无损的通用模块组件 |

|||

浙公网安备 33010602011771号

浙公网安备 33010602011771号