0606 周末文献汇报

新型算子Involution

《Involution: Inverting the Inherence of Convolution for Visual Recognition》2021CVPR

研究背景

随着科技的高速发展,图像相关研究得到了极大的重视和快速的发展。人们对其运用的要求越来越高,比如:越来越便捷、高速、智能化的目标跟踪、视频监控、机器人导航等方面的应用。

面对图像应用的高要求,需要提高相关图像精确度和复杂度方面的技术水平。在提高图像技术水平方面,一般在神经网络算子、网络结构框架以及相关图片处理等方面进行不断优化。

相关研究

在图像领域中,卷积的运用具有重要地位。除此之外,注意力机制也越来越火爆。逐渐出现了DERT,ViT等模型。

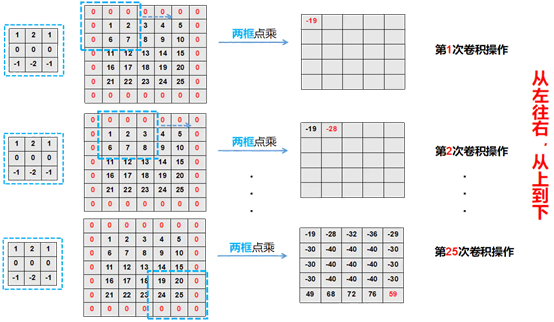

卷积神经网络CNN,大多使用二位卷积,卷积核可以看成参数矩阵。在深度学习中,卷积运算先乘法在加法,通过卷积核向(x,y)两个方向移动,从图像数据中,计算低维特征。以单通道为例,卷积核是3*3的矩阵,其元素,从左向右,从上往下,在每个位置都进行元素的相乘累加,每滑动一个位置都会生成一个值,最终输出5*5矩阵。

卷积特性:卷积层的卷积核,具有空间不变性和通道特异性。卷积核大小为,其中 Co和Ci 分别是输出和输入的通道数目,而K是kernel size,一般不写,代表在个pixel上共享相同的kernel,即空间不变性,而每个通道C独享对应的kernel则称为通道特异性。

存在的问题:

1. 卷积核限制了提取特征的的能力(其实每个位置应该通过不同的方式提取特征,且特征提取范围也不应该局限于感受域)。

2. 局部性限制了卷积的感受野,对小目标或者模糊图像构成了挑战。

3. 卷积核内部的通道间冗余这使得卷积核对于不同通道的灵活性受到限制。

本文要解决的问题:

1、解决了卷积过程中,随着通道数的增长,参数量和计算量显著增长的问题。

2、解决了卷积过程中,卷积核提取的特征比较单一的问题。

本文研究内容

Involution

1、 特性:

总的来看,Involution的设计和卷积的设计相反,在特性上,具有空间特异性(spatial-specific)和通道不变性(channel-agnostic)。通俗地理解,在空间维度上采用生成核函数,对每个像素都生成核(kernel),从而进行灵活建模;在通道维度上使用共同的核(kernel),kernel减少冗余。

2、内容:

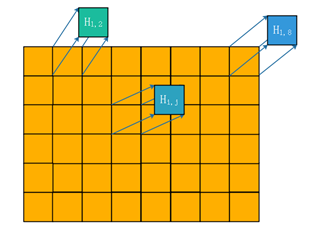

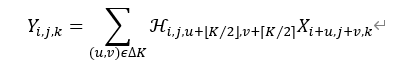

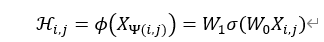

在通道维度,共享kernel,在空间维度,采用特异的kernel进行灵活建模。Involution kernels大小为,其中,表示所有通道共享G个kernel。公式表示为:

其中,involution kernels表示为。对于每个像素是不同的,但是,在通道维度上共享。表示使用相同kernel的组数。通过对输入进行相乘累加操作,得到involution的输出特征映射。

involution kernels的大小是依赖于输入X的大小。将对应每个像素输入,通过生成函数,生成kernel,其中,为的邻域的index的集合,如公式所示。

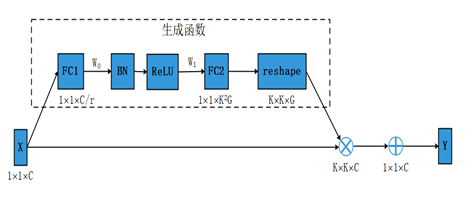

本文的生成函数使用的是类似于SENet的bottleneck结构来进行实验。为的这个单点集合,即X取单个像素生成。,是线性变换矩阵;为中间的BN和ReLU。

3、 过程

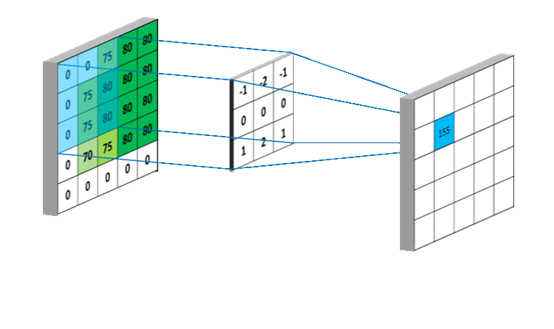

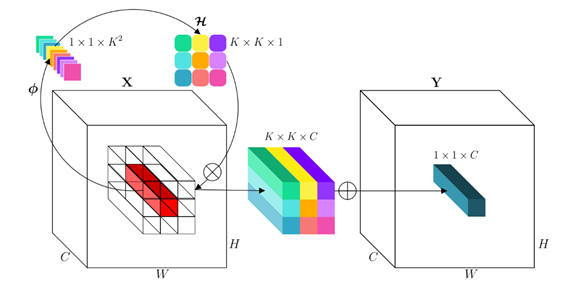

对输入特征向量X,首先,经过变换,再通过reshape 转换形状,生成这个像素上的involution kernel。然后,kernel再和该点邻域的特征向量进行相乘累加,得到最终输出的特征映射。过程如图所示:

当G=1,立体呈现效果如下如所示:

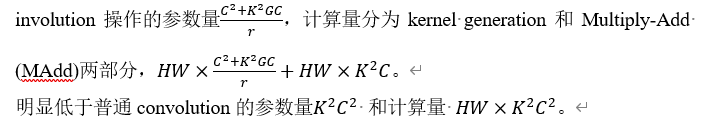

4、计算量

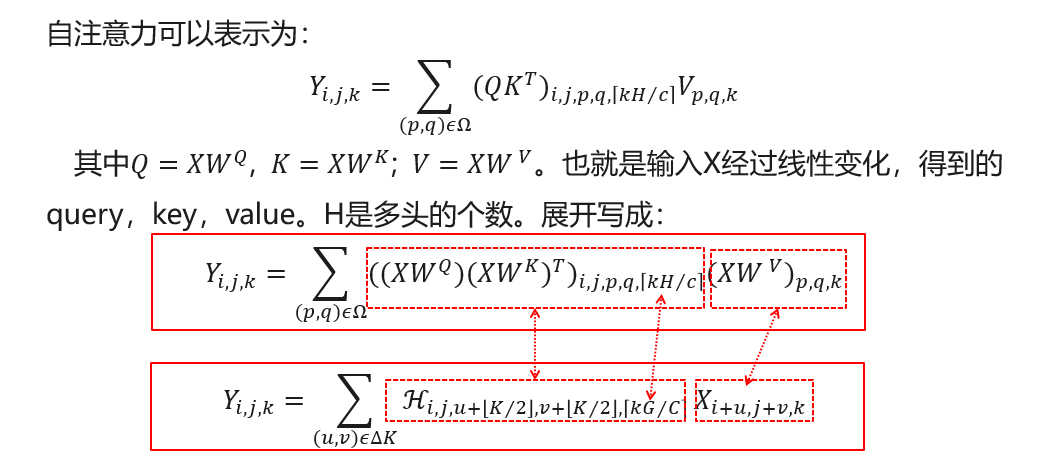

5、与自注意力对比

6、总结

Involution的解决的问题:

1、解决了卷积过程中,随着通道数的增长,参数量和计算量显著增长的问题。

2、解决了卷积过程中,卷积核提取的特征比较单一的问题。

Involution的过程是在通道上共享kernel,从而在空间维度上设计,提升性能有保证效率。

Involution的设计特点,在微观粒度上,进行了重新调配,将有限的算力调整到最能够发挥的位置。

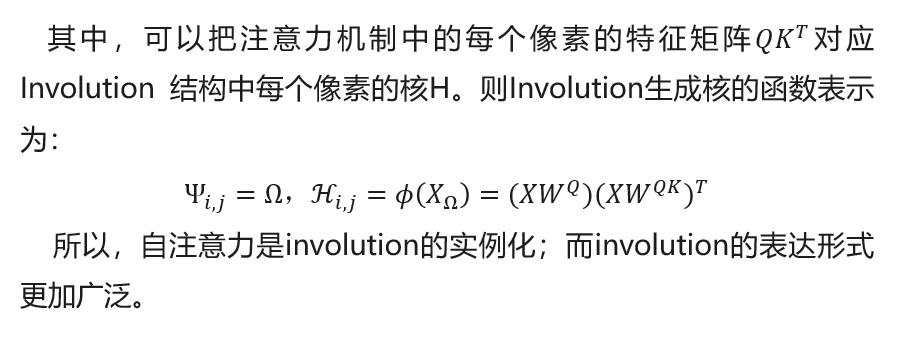

图中,a图展示的是准确性和复杂度之间关系;b图展示的是准确性和参数之间关系。值得注意的是,与SAN、Axial和 ResNet等当前先进模型相比,RedNet在参数和复杂性之间取得了更好的平衡,因为它们被图a或b中的RedNet系列的曲线所包在下面。

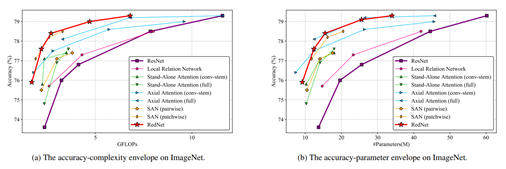

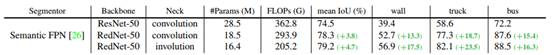

图表中说明,基于involution构建了架构RedNet,并改善了Baseline的性能,分别提高了1.6%的Top-1分类精度、2.5%和2.4%的边界框AP值,以及4.7%的mIoU,同时将计算成本压缩为原来的66%、65%、72%和57%。

浙公网安备 33010602011771号

浙公网安备 33010602011771号