7-30破防

今天开始部署HDFS

HDFS(Hadoop Distributed File System)是 Hadoop 生态系统的核心分布式存储组件,专为存储和管理海量数据(TB/PB 级)设计,运行在普通硬件集群上,具有高容错性、高吞吐量等特点。

真是破大防

按照https://www.bilibili.com/video/BV1WY4y197g7?spm_id_from=333.788.videopod.episodes&vd_source=531ef0571bd21a6f140383bcf2e73ef8&p=22

教程来的

此时还一切正常

然后在FinalShell里面操作会出现这种百分号

完全不受控制

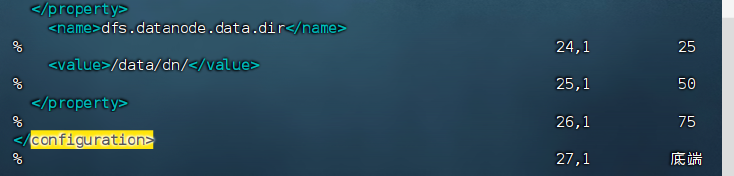

想把这个依赖添加进去

在这个过程中 格式会发生各种各样的错误

谁试谁知道...

最终解决方案是在linux 自带的终端中导入依赖

<configuration> <property> <name>dfs.datanode.data.dir.perm</name> <value>700</value> </property> <property> <name>dfs.namenode.name.dir</name> <value>/data/nn/</value> </property> <property> <name>dfs.namenode.hosts</name> <value>node1,node2,node3</value> </property> <property> <name>dfs.blocksize</name> <value>268435456</value> </property> <property> <name>dfs.namenode.handler.count</name> <value>100</value> </property> <property> <name>dfs.datanode.data.dir</name> <value>/data/dn/</value> </property> </configuration>

`

如果只有这个

其实也还好

但是

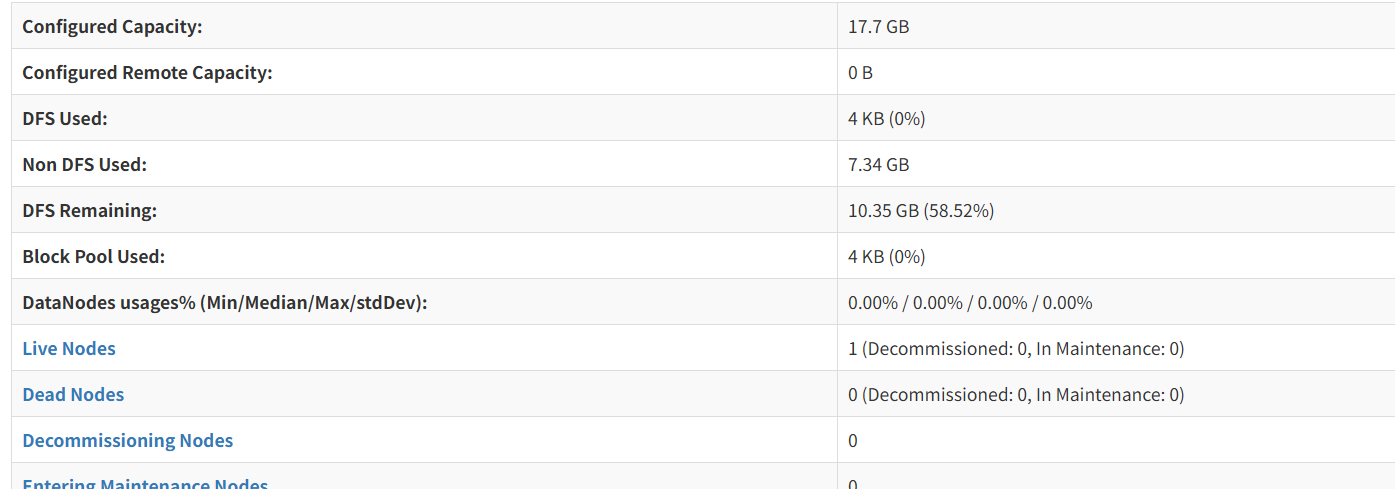

按照所有的步骤一步一步弄了将近一上午

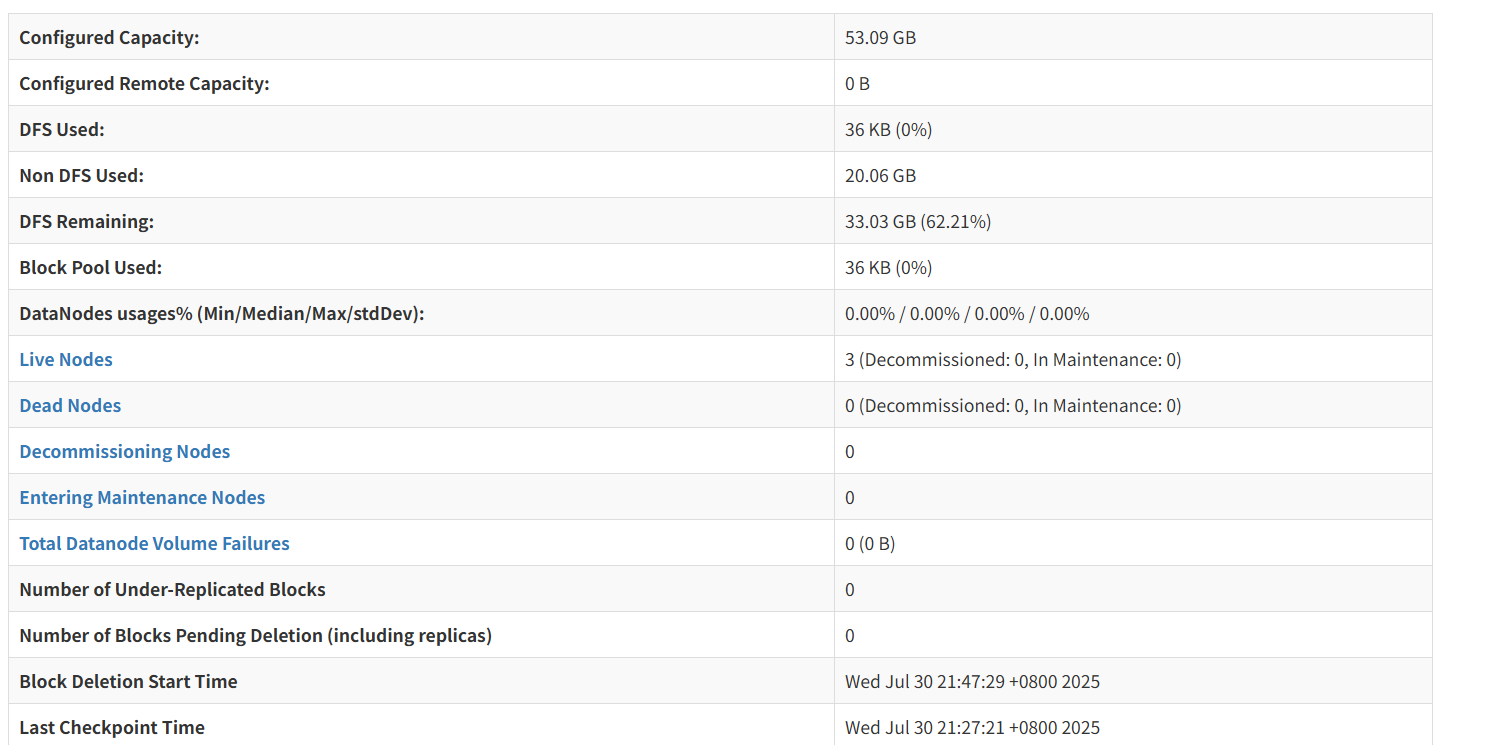

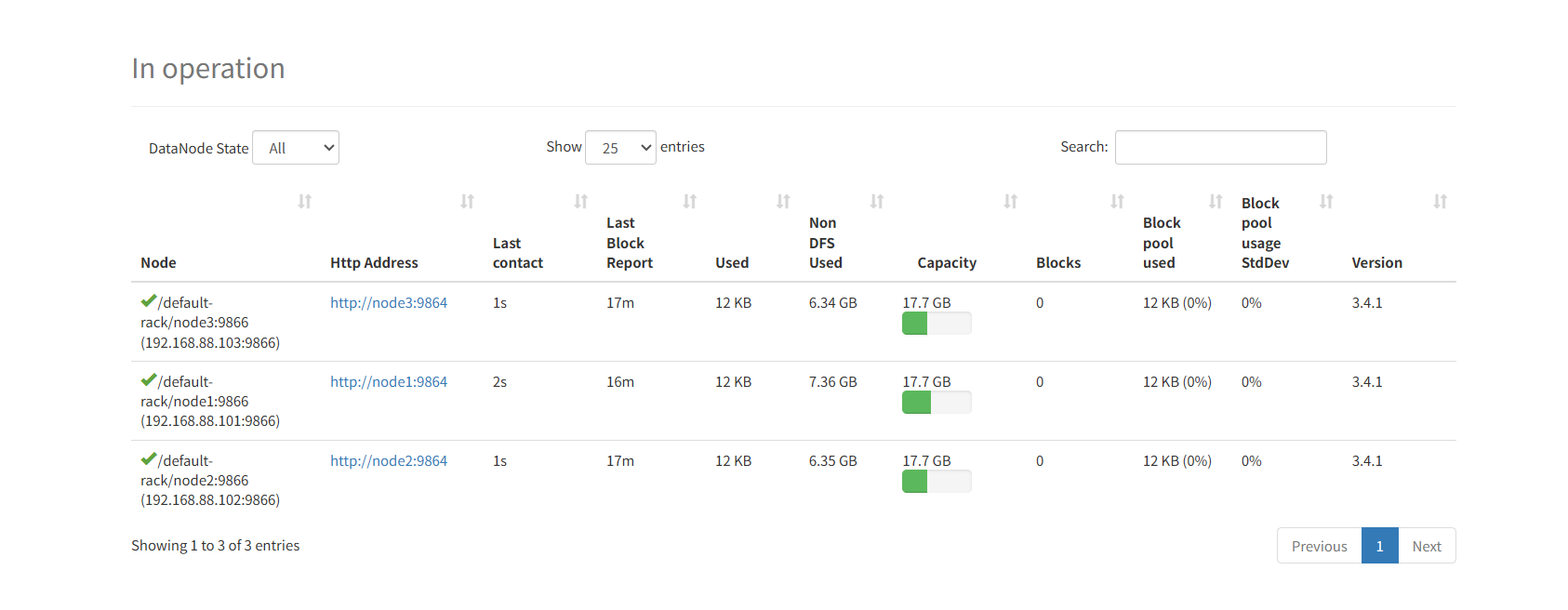

最后验证有没有搭建成功的时候

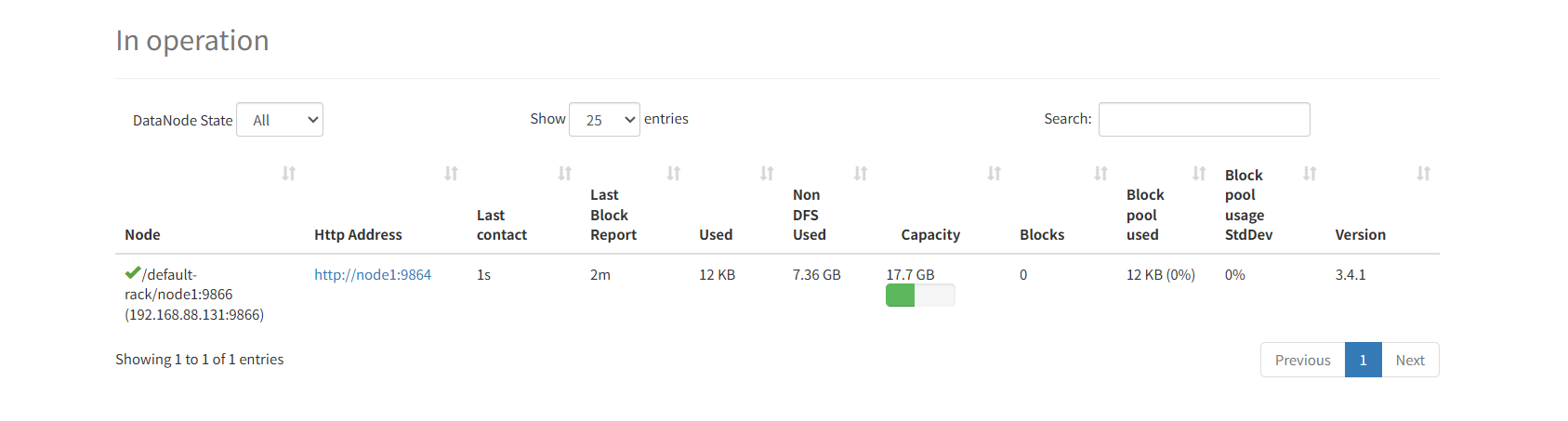

只能看到node1部署成功,node2 node3显示不出来

问豆包

教程里面没有相关介绍

。。。

花费将近一个下午

解决

原因是 node1 的 NameNode 无法将 node2 的实际通信 IP(192.168.88.129)反向解析为 node2 主机名,导致注册被拒绝

解决措施--禁用动态ip 动态 IP 与静态 IP 冲突,导致 NameNode 无法解析 DataNode 的通信地址

搭建成功

不得不说 linux语句直接给我练熟了...

浙公网安备 33010602011771号

浙公网安备 33010602011771号