基于GWO灰狼优化的VMD-LSTM时间序列预测算法matlab仿真

1.前言

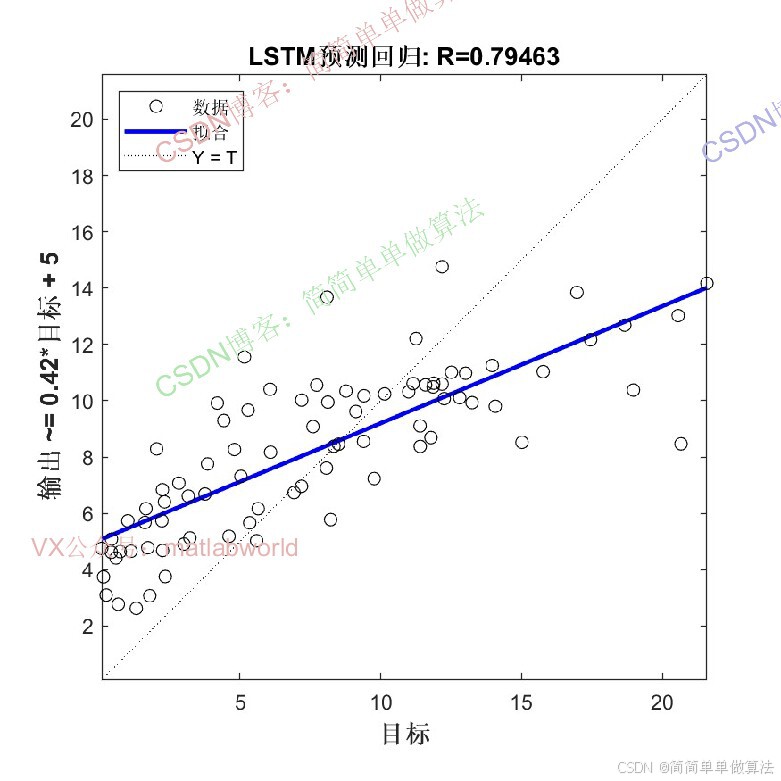

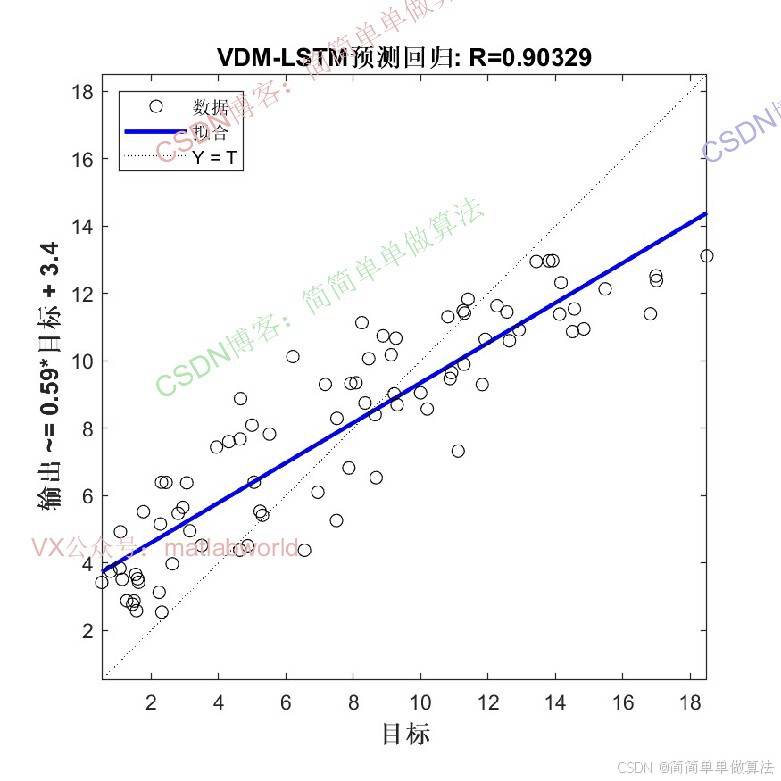

时间序列预测在能源、气象等领域具有重要应用价值。传统方法如ARIMA、SVM等在处理非线性、非平稳序列时存在局限性,而深度学习模型 (如LSTM)虽能捕捉时序特征,但对初始参数敏感,且复杂序列需预处理以提升预测精度。变分模态分解(VMD)可将复杂时序分解为多个平稳模态分量,LSTM可有效建模序列长期依赖关系,GWO优化则用于优化LSTM的关键参数,形成 “分解-优化-预测” 的完整框架。该算法通过多技术协同,提升时序预测的准确性和鲁棒性。

2.算法运行效果图预览

(完整程序运行后无水印)

3.算法运行软件版本

Matlab2024b(推荐)或者matlab2022a

4.部分核心程序

(完整版代码包含中文注释和操作步骤视频)

%分量建模 for d=1:Rc X_imf = [dat(:,1:end-1) imf(d,:)']; [T_train,T_test,Pxtrain,Txtrain,Pxtest,Txtest,Norm_I,Norm_O,indim,outdim]=func_process2(X_imf,dims); %LSTM网络, layers = [ ... sequenceInputLayer(indim) lstmLayer(Nlayer) reluLayer fullyConnectedLayer(outdim) regressionLayer]; %参数设置 options = trainingOptions('adam', ... % 优化算法Adam 'MaxEpochs', 200, ... % 最大训练次数 'GradientThreshold', 1, ... % 梯度阈值 'InitialLearnRate', LR, ... % 初始学习率 'LearnRateSchedule', 'piecewise', ... % 学习率调整 'LearnRateDropPeriod', 60, ... 'LearnRateDropFactor',0.2, ... 'L2Regularization', 0.01, ... % 正则化参数 'ExecutionEnvironment', 'cpu',... % 训练环境 'Verbose', 0, ... % 关闭优化过程 'Plots', 'training-progress'); % 画出曲线 %训练 [net,INFO] = trainNetwork(Pxtrain, Txtrain, layers, options); end TNpre1sum =sum(TNpre1s); TNpre2sum =sum(TNpre2s); T_trainsum=sum(T_trains); T_testsum =sum(T_tests); %计算误差 error1=T_trainsum-TNpre1sum; error2=T_testsum-TNpre2sum; rmse1=sqrt(mean(error1.^2)) rmse2=sqrt(mean(error2.^2)) save R3woavdmlstm.mat TNpre2sum T_testsum T_trainsum TNpre1sum Rerrs Rloss rmse1 rmse2 227

5.算法理论概述

VMD是一种自适应信号分解方法,通过构建变分模型将原始序列分解为若干模态分量(IMF),每个分量对应特定频率尺度,且带宽之和最小化。该过程通过交替迭代更新各模态的频率和幅值实现,无需预设分解层数(实际应用中需结合数据特性确定或优化)。

LSTM是一种特殊的循环神经网络 ,它通过引入门控机制来控制信息的流动,从而能够有效捕捉时间序列中的长距离依赖关系 。LSTM的核心是记忆单元,它可以存储和更新时间序列中的信息。

浙公网安备 33010602011771号

浙公网安备 33010602011771号