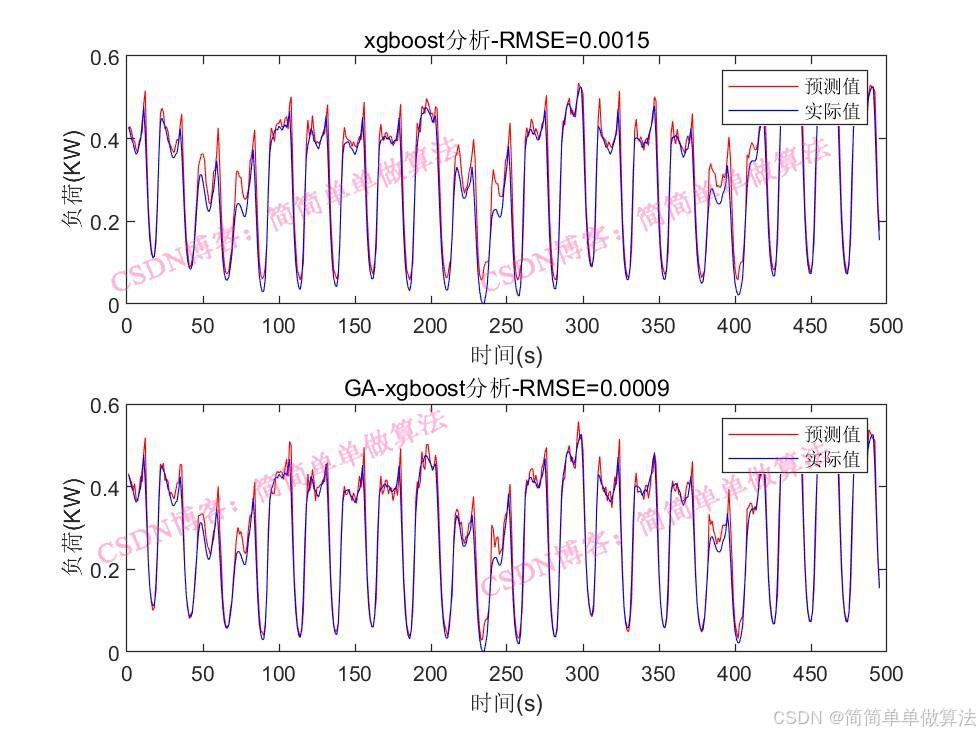

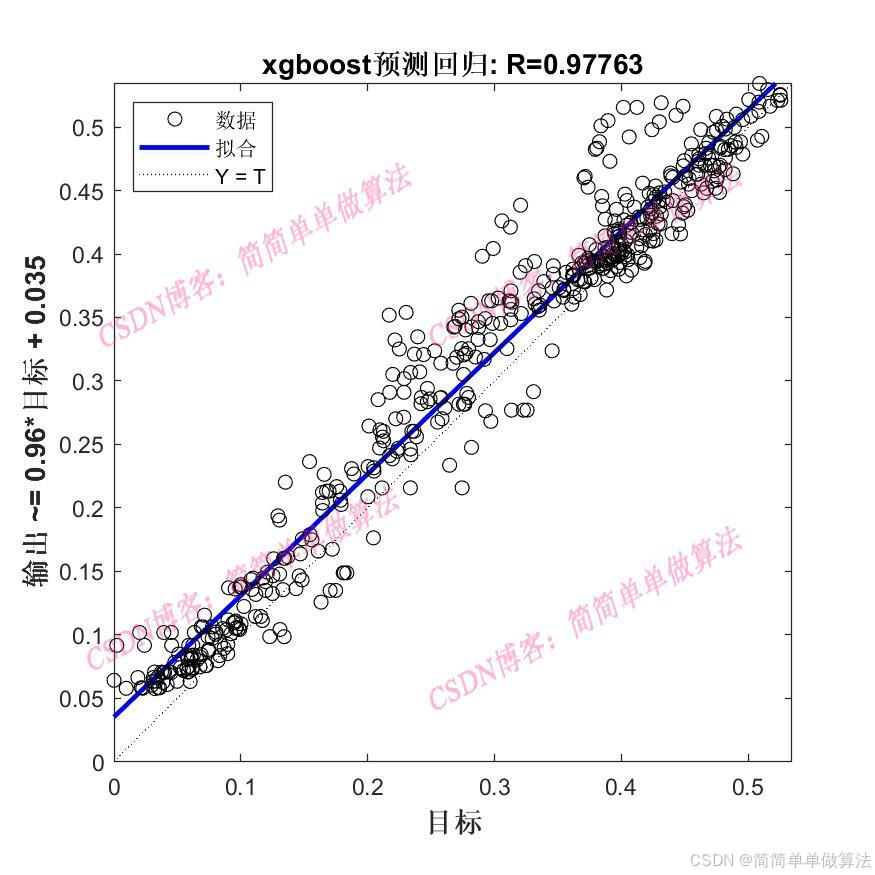

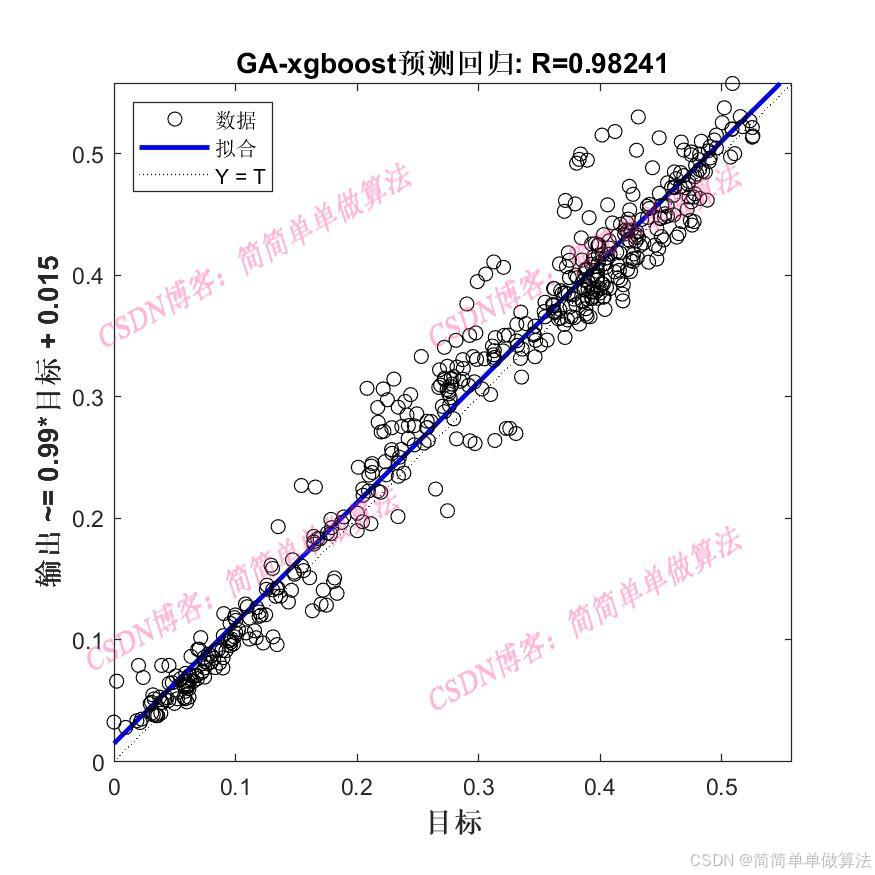

基于GA遗传优化的XGBoost序列预测算法matlab仿真

1.算法运行效果图预览

(完整程序运行后无水印)

2.算法运行软件版本

matlab2022a/matlab2024b

3.部分核心程序

(完整版代码包含详细中文注释和操作步骤视频)

........................................... [V,I] = min(JJ); X = phen1(I,:); %最大迭代次数 paramters.maxiter = 50; paramters.train_booster ='gbtree'; paramters.objective ='reg:linear'; %最大深度 paramters.depth_max = round(X(1)); %学习率 paramters.learn_rate = X(2); %最小叶子 paramters.min_child = round(X(3)); %采样 paramters.subsample = X(4); paramters.colsample_bytree = 1; paramters.num_parallel_tree = 1; %Xgboost训练 Nets = func_Xgboost_train(Xtrain_norm, Ytrain_norm, paramters); %预测 Pred_trainy = func_Xgboost_test(Nets,Xtrain_norm); Pred_testy = func_Xgboost_test(Nets,Xtest_norm); %反归一化 Pred_trainy2 = Pred_trainy.*max(Ytrain)+Ym; Pred_testy2 = Pred_testy.*max(Ytrain)+Ym; figure; plot(Ytrain,'r') hold on plot(Pred_trainy2,'b') xlabel('NO.') ylabel('时间序列预测结果') title('XGBoost训练集效果') legend('真实值','预测值') grid on figure; plot(Ytest,'r') hold on plot(Pred_testy2,'b') xlabel('NO.') ylabel('时间序列预测结果') title('XGBoost测试集效果') legend('真实值','预测值') grid on rmse = mean((Pred_testy2(:)-Ytest(:)).^2);% 计算均方根误差 rmse save R2.mat Pred_testy2 Ytest rmse 214

4.算法理论概述

序列预测在金融、气象、工业控制等领域具有广泛应用,其核心目标是通过历史数据推断未来趋势。传统的时间序列预测方法如 ARIMA、LSTM 等在处理非线性、高维数据时存在局限性。XGBoost(Extreme Gradient Boosting)作为一种高效的梯度提升框架,在结构化数据预测中表现优异,但其性能高度依赖超参数的选择。GA具有较强的全局搜索能力,能够在复杂搜索空间中快速找到全局最优解。将GA与XGBoost结合,可自动优化模型超参数,提升序列预测精度。

在XGBoost优化中,适应度函数通常选择验证集上的均方根误差(RMSE)。

XGBoost 的关键超参数包括:

学习率(learning_rate)

最大树深度(max_depth)

子样本比例(subsample)

列采样比例(colsample_bytree)

基于GA的XGBoost序列预测算法通过粒子群优化自动搜索最优超参数,显著提高了预测精度。实验结果验证了该方法的有效性,为序列预测提供了一种高效的解决方案。未来可进一步研究多目标优化和并行计算以提升算法性能。

浙公网安备 33010602011771号

浙公网安备 33010602011771号