脉冲神经网络研究现状及展望——论文摘抄

论文参见:http://cjc.ict.ac.cn/online/bfpub/ztl-20201223120834.pdf

1 引言

随着脑科学研究和人工智能的快速发展,具有交叉学科特点的类脑智能研究受到人们日益广泛的关注。类脑智能算法的本质,是期望从生物科学研究结果中得到结构、机制或功能等方面的启发,来完善人工智能算法或引领未来人工智能的发展方向,使得人工智能能够扩展、融合多种认知能力,逐步逼近类人水平的通用人工智能。脉冲神经网络(Spiking Neural Network, SNN)的研究正处于类脑智能研究的核心,对其结构基础、功能优化等方面的研究,将有助于我们更好的认识大脑、理解生物智能的本质并启发得到更新一代的人工智能模型。

正如诺贝尔生理学或医学奖得主Gerald M. Edelman所说,"脑科学知识即将奠定新时代的科学基础,凭借脑研究的结果我们可以在疾病治疗方面取得进展,同时建成具有仿脑功能的新机器,有助于我们更为深入地认识和了解人类本质"。2013年,欧洲的人脑计划(Human Brain Project, HBP)入选了欧盟委员会的未来旗舰技术框架项目,该计划的主要目标之一,是搭建脉冲神经元尺度的大规模脑模拟器并力图在下一代信息技术的类脑智能研究上获得突破。2014年,美国的高级情报计划署开展了由脑皮层智能网络启发的机器智能项目(Machine Intelligence from Cortical Networks, MICrONS),该项目的主要思路是通过采集、观察、重建和模拟大脑皮层的网络结构和脉冲信息处理机制,以此来研发新一代的具有人类新皮层智能特性的智能系统。2018年,MIT联合内部五大学院开展Intelligence Quest项目,核心研究点为机器学习算法,外延方向为通过计算机科学的见解来反向提高对生物脉冲网络功能的认识。以上这些计划的核心研究点之一就是学习和记忆的可塑性,而这也是生物脑智能中最重要的核心认知功能之一。长期"优胜劣汰"使得大脑遗传进化出良好的物质和结构基础,在这个基础上,大脑通过后天的再训练习得了越来越多的高级认知功能,如分类、识别、决策、记忆和联想等。正是"可塑性"使得人脑神经网络具有了强大的环境学习和再适应能力。因此,脉冲神经网络算法,将不可避免的要借鉴和学习人脑的多尺度的、多类型的可塑性认知机理及神经网络结构。

自从1943年McCulloch和Pitts借鉴了生物神经元的运算模式,首次提出了MP人工神经元模型以后,人工神经网络的研究开始稳步发展,一些具有里程碑意义的神经网络模型也被相继提出,如1958年的Perceptron感知机,1983年的Hopfield网络,1986年的反向传播(Backpropagation, BP)网络,1987年的卷积神经网络(Convolutional Neural Network, CNN),1997年的脉冲神经网络,2006年的深度置信网络(Deep Belief Network, DBN),2012年兴起的深度神经网络(Deep Neural Network, DNN)等。

脉冲神经网络是源于生物启发的新一代人工神经网络模型,如图1所示。当前的以放电率为信息承载主体的CNN、DNN属于非Spike模型。与之相比,脉冲神经网络虽然也属于人工神经网络,但是更加强调,以具有精确放电时间、具有事件驱动特性的Spike作为信息运算的基本载体。虽然名字中着重强调了"脉冲"这一生物网络的主要特点,但是与之同样重要的还包括高动态-复杂动力学的神经元节点(时序脉冲产生)、强可塑性-稳定信息表征的突触结构(脉冲学习)、复杂功能特异性的网络环路(脉冲功能表达)等。脉冲神经网络的提出,标志着神经网络从以放电率为主体的空间编码,逐步过渡到以精确Spike放电、阈下膜电势累积为主体的时空编码。新增的时间维度,使得更精细的生物计算模拟、更稳定鲁棒的信息表征、更高效节能的生物可塑性网络优化成为了可能。

![]()

2 脉冲神经网络的主要优势及特点

一直以来,达到类人脑的通用智能水平是人工智能领域不懈追求的终极目标之一。SNN网络考虑了更多的生物细节,因此天然的可以作为人工智能模型和生物神经系统的联通桥梁。

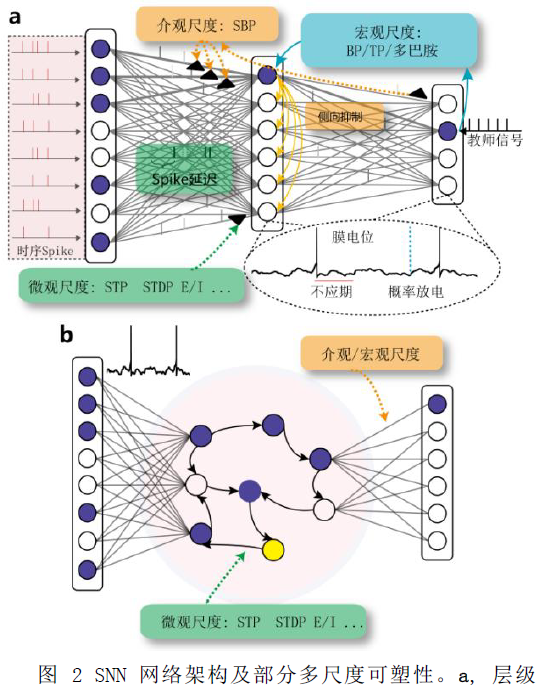

通过融合生物启发的、有益高效的神经信息处理机制到SNN中,可以探索生物系统智能运算的本质,然后通过数学模型的方式迁移泛化到更加广泛的人工智能模型中,将为得到更加智能、高效的人工智能算法提供帮助。SNN的基本架构如图2所示,包括类似皮层的层级结构和类似海马的环状网络结构,网络中含有不同尺度的可塑性,用来指导网络突触权重的学习[5]。

![]()

现有的人工神经网络已经借鉴了部分的脑神经信息处理方式,如非线性的神经元信息转换、权值可变的突触更新、特定层级或循环的网络结构等。未来,脉冲神经网络通过大规模的借鉴生物神经科学发现,将有可能在以下几个方面展现出优势:①不同神经元非线性信息处理模式的差异。生物系统中可以粗劣地分为两大类神经元,比例多而种类少的兴奋性(Excitatory, E)神经元,以及比例少而种类多的抑制性(Inhibitory, I)神经元,他们对信息的非线性处理模式有很大的不同,适当比例的神经元组合建模将显著减少神经网络的能量消耗。②神经元节点对时间-空间信息的高效整合能力。单一神经元内部具有复杂的动力学特性,膜电位本身可以是多个高阶吸引子的动态组合,可以积累很长时间内的历史输入并在放电阈值、静息电位阈值等方面产生可塑性,甚至可以单神经元通过多房室实现如工作记忆保持、信息决策、多频段信息整合及滤波等能力。③稀疏的神经信息/神经脉冲编码方式。生物神经网络采取了脉冲的方式进行信号的编码,只有当膜电位达到放电阈值才激发神经脉冲进而发生信息传递,大部分的神经元在活动周期中都处于静息状态。这种稀疏脉冲编码的方式,将精确信息编码到了脉冲序列的时间间隔中,在降低了后期网络运算量的同时,也极大的降低了信息传递能耗。此外,脉冲序列的编码也不是一成不变的线性编码,而可以是网络根据输入信息自适应的调整上下界、放电阈值或静息电位的动态过程。④神经元中突触的位置差异性建模。生物神经元的突触位点可能发生在细胞胞体、也可能发生在远端的树突棘,两者的信息传递能效、信息迟滞时间等都有很大不同,这将极大的增加脉冲神经网络的非线性信息编码能力。⑤神经元突触的信息延迟建模。生物中的信息通过突触结构会发生信息延迟,具体时间会根据突触的离子通道类型、受体蛋白数量的多少、距离胞体位置远近、处于几层分叉点等不同而有很大的不同,这将增强脉冲神经网络的时间动态编码能力。⑥快速的、非监督的微观神经突触可塑性调节方法。已有的生物研究结果表明,生物系统中不存在类似BP的全局误差函数调优,而是更可能由诸多的局部突触可塑性快速、直接地完成。生物系统是如何通过局部的参数调优进而实现了全局网络的优化,是值得现有的人工智能系统借鉴的,如现有的一些生物学习机制,包括赫伯学习法则(Hebb’s law)[6],脉冲时序依赖的突触可塑性(Spike-Timing Dependent Plasticity, STDP)[7],短时突触可塑性(Short-Term Plasticity, STP),生物自组织反馈(Self-organized Back Propagation, SBP)[8]机制等。脉冲神经网络将依据这些机制达到更快速的网络学习。⑦介观尺度生物微环路的多时钟自组织调节。生物网络通过多神经元群体编码,对输入的不同维度的数据内部信息进行自动关联学习。如在传统的神经网络学习的y=f(x)映射基础上,生物网络还会增加对输入数据本身进行xt→xt+1的内部时间关联建模,这种关联发生在突触上,将对网络的稳定存储提取(抗噪性)、甚至信息的启发式联想(动态稳定性)等能力带来帮助。由此,网络形成了神经元内部时钟、突触时钟、网络环路时钟的多类时钟计算过程。⑧宏观生物网络多脑区的协同能力。生物体脑区的数量众多,脑区之间的组织方法不同于脑区内部的自组织方式,具有明显的兴奋、抑制连接通路,同时可以结合多种神经反馈信息(如多巴胺奖励信号)综合实现多任务的协同,这将使得脉冲神经网络在保持脑区内部功能自稳定的基础上,同时具有快速的学习能力。

深度借鉴生物信息处理机制的另一个原因,是现有的人工网络(如DNN等)正在逐渐面临越来越多的挑战,如小样本学习效果差、待调优参数过多容易发生欠拟合、网络迭代训练次数过多又容易发生过拟合、网络迁移能力有限、DNN的灾难性遗忘、网络对新任务的适应能力差、增量学习效果弱等;又如网络虽然对特定样本的识别正确率很高,但是显然模型并没有真正对图片形成符合人类认知水平的理解,因此容易发生啼笑皆非的测试结果,如将黄黑色条纹的图片以极高的置信度识别为校车[9]。通过生物网络结构、生物学习机制等启发,将为现有人工模型提高其认知能力指明一种可能的优化方向。考虑到现有人工神经网络所忽略的很多的生物规则可能恰恰是实现通用类人脑智能的关键,因此,在SNN的框架中深入研究这些生物规则,将有可能使得现有网络获得更为强大的计算能力和适应能力,最终达到与人类相比拟的智能信息感知、分析、决策能力。

3 脉冲神经网络的优化目标及定位

如何高效优化复杂的脉冲神经网络模型是近些年研究的重点,且优化方向根据最终目标的不同而稍有差别。一类是以理解生物系统为最终目标,采用的优化方法要尽可能的满足已知的生物发现,如STDP、STP、长时程增强(Long-Term Potentiation,LTP)、长时程抑制(Long-Term Depression, LTD)、神经元侧抑制(Lateral Inhibition)、Dale准则(神经元突触同为正数或者同为负数)、侧抑制、兴奋-抑制神经元平衡,及其上述准则的不同变体等。通过将这些受生物现象启发的学习规则加入到SNN学习框架中来,以尝试让SNN具有类人认知水平的多模态信息处理能力、低能耗运算能力、鲁棒认知能力等。

另一类是以追求卓越计算性能为最终目标,采用的优化方法不局限于生物约束,特别的可以采用基于BP的不同变体实现SNN的优化,如代理梯度、BP训练ANN后再转化为SNN、对SNN的Spike平滑近似使其满足可微分条件等。

整体而言,如图3所示,脉冲神经网络可以同时借鉴生物系统的可塑性机制和当前人工网络的成熟优化方法,综合实现更加高效的类人感知、认知、决策能力,为实现新一代的通用人工智能模型打好基础。

4 脉冲神经网络的基本信息编码

在脉冲神经网络内部,神经元接收上游神经元轴突传来的Spike信息(基本量纲为电势),经过树突突触后将电势信息转为电流信息,电流经过神经元内部到达胞体,通过电流改变胞体内外的电势差,达到放电阈值后通过钙离子通道的打开,生成新的Spike信息并通过轴突继续向下游神经元传递。

在脉冲神经网络外部,编码方法多用来将输入的实值信号转换为带有时间信息的Spike序列信息,由于编码的目的是尽可能无损的还原输入信息,因此基于简单均匀放电的Spike序列编码最为常用,更为详细的编码说明请参考[10],如包括:①首个脉冲触发时间编码。生物证据表明,大部分脉冲信息是在刺激产生的20-50ms内发生传递,因此着重强调第一个脉冲的出现时间,而对其他脉冲时间忽略或做小权重整合[11]。②延迟相位编码。该方法受到视网膜神经节细胞的信息处理启发,即刺激越强,延迟越短,且需要在计算的时候进行相位对齐[12]。③泊松信息编码。泊松Spike编码符合生物发现,且在脉冲序列估计、神经网络背景噪声的模拟中被广泛采用[13, 14]。然而,泊松编码通过长时间序列的泊松分布来对特定的精确数值进行估计,且估计数值为泊松分布全时域的均值,因此理论上在有限时间内无法得到精确编码。④神经元动力学特性编码。生物神经元的膜电位变化可以等效为高阶微分动力学方程,外界的输入电流将影响动力学方程的极值数量和数值,因此将会出现不同类型的吸引子或动态分岔,如鞍-结分岔、Andronov-Hopf分岔等。Izhikevich模型提出简化的采用四个无量纲的参数组合来表征多类丰富的脉冲发放模式,如均匀放电、强直簇状放电、梳状放电等,可以看做是构建复杂神经动力方程的捷径[15],部分神经元编码举例如图4所示。

5 以理解生物系统为目标的脉冲神经网络优化进展

在记忆认知的理解方面,Zenke 组合了多种微观神经可塑性规则,如Hebb规则、三相STDP、时序异步突触后可塑性、介质调节的突触前可塑性等,通过构建循环的SNN网络,采用漏电-积分-放电(Leaky-integrated and fire,LIF)神经元模型进行建模,实现了多可塑性融合的学习和记忆网络,该网络可对几类简单的不同形态、轮廓的特征图片信息进行存储和记忆重现,充分展示了SNN的信息转存能力[16]。Song等通过对兴奋性和抑制性神经元组建的SNN微环路的模拟,为多种、多尺度的认知任务进行了生物模型层面的解释,如对于决策、工作记忆保持、网络周期稳定放电等,未来将有可能在越来越多的宏观生物智能现象的解释上发挥重要作用[17]。受到大脑皮层的网络结构和功能的启发,美国工程院院士Jeff Hawkins通过对大脑6层脑皮层的不同层间关系的生物学解剖结果分析,构建了类脑皮层的分层时序记忆模型算法。该模型可以整合时序和多层次记忆之间的关系,为时序数据信息抽取和模态预测提供了新的思路。

在微观可塑性的理解方面,Diehl采用两层SNN网络以及LIF神经元模型,通过相邻层神经元的非监督STDP学习映射,然后挑选输出层的对特定类别选择性放电的神经元作为类别标记,在MNIST数据集上可以达到95%的测试正确率,充分验证了LIF节点的信息处理能力[18]和STDP的可塑性学习能力[19]。Wade提出了一种基于BCM(Bienenstock Cooper Munro)和STDP相结合的突触权值更新方法[20],SNN网络同时加入了兴奋和抑制性突触,最终模型得到了相比无抑制性突触的SNN模型更好的分类结果:如在Iris数据集合(包含3种不同类型的鸢尾花的50个样本)中达到了95%的正确率,且在Wisconsin癌症诊断数据集合中达到了96%的正确率。Wang提出了一种支持小样本在线学习的SNN算法[21],该网络分为时间编码层、空间时间聚类层和分类输出层三层网络结构,使用了STDP和反STDP相结合的学习规则来调整权值,虽然在MNIST数据集上只有75%的正确率,但是相对其他SNN网络具有更快的收敛速度。Beyeler采用了Izhikevich神经元模型构建SNN网络,使用电导依赖的突触可塑性规则,结合STDP学习规则在MNIST数据集上得到了约90%的识别正确率[22]。Resume结合STDP和anti-STDP规则,根据前后层神经元的放电模式调整他们之间的突触连接强度,与传统的STDP的最大差异,是通过加入了时间积分核来对历史放电模式进行积累,并作为乘性因子来放大STDP的可塑性调节程度。然而此方法仍然是局部、单层的学习方法,目前主要在液体状态机的输出层权重学习部分发挥作用[23]。

在简单任务的验证方面,Wysoski提出了一种多层的SNN架构来识别动态视频流中的模式[24]。其中,自适应在线学习规则和多帧意见收集算法被结合到了SNN算法中,并采用LIF模型、4层的二维神经网络结构,以及应用Hebb法则学习不同的模式数据,最终在视频流的模式分类任务中取得了相对其他静态处理方法更高的正确率。Taras提出了一种简化了的脉冲神经网络计算模型[25],采用LIF神经元模型、STDP学习规则、脉冲频率编码和输入图片的感受野像素转化等方法,在线学习达到了高于传统SNN约20倍的运算速度。Yu等构建了SNN网络,对语音时序信息进行了稳定编码、学习和解码[26]。

这些方法都着重依赖生物可解释的可塑性法则来优化目标功能网络,并随着优化效果的提升逐渐对生物的多类优化机制有了更深刻的认识,如STDP和BP的相关性分析[27]、泊松编码和STDP的关系分析[14]等。

6 以追求卓越计算性能为目标的脉冲神经网络优化进展

针对SNN由于存在Spike而不可处处可微的问题,受到神经动力学特性的启发,SNU(Spiking Neuron Unit)通过内部环路实现类LIF的工作机制,同时结合BP的优化方法,在保证多层SNN的有效学习的同时,尽可能的保留了生物神经节点的动力学信息处理特点,如信息积累、衰减、阈值放电等[28],在MNIST数据集上得到98%的正确率。Lee构建了多层次的SNN,并采用生物LIF模型建模,通过分析已有的多种生物网络中的噪声信号特性,如非均匀泊松噪声、固定频率噪声等,开创性的将现有的LIF神经信息放电视为噪声的一种,把原本非连续的神经膜电位信息等价为连续的神经元模型,然后采用BP的方式优化,同样达到了较高的分类精度。训练后的网络很适合对模糊放电信息的处理,因此从侧面表现出SNN网络强大的时空信息整合能力[29]。另一类代理梯度的方法优化SNN网络,一般采用Van-Rossum Distance计算代价函数,在BP优化过程中,用连续膜电位变量替换离散Spike的优化推导,如将膜电位中不可微分项去掉,包括Reset项和Spike项,使得网络可以最终用近似BP的方式求解[30, 31],且在最终的收敛速度和正确率上和标准BP可比较。类似的尝试也发生在具有放电神经元的多类神经网络中[32-34]。

用神经元精确放电的Spike时刻来表征网络信息的传递,是另一种可以融合BP优化的有效途径。SpikeProp [35]通过限制网络中神经元的脉冲发放次数,然后通过BP的方法根据放电时差来优化调节每层的权重数值。相似的QuickProp [36]等改进版本也在运算速率、非线性运算等方面展现了优势。然而,本质上基于时域BP的方法使得这些SNN网络学习速度较慢。特别的,对于不发放脉冲的状况下,网络将不会产生可学习的梯度,进而影响SNN的快速拟合。Tempotron [37]方法通过计算目标和实际输出的最小化,实现突触权值的优化,采用了类似BP的方法但是只适用于单个神经元。

受大脑的“多脑区协同”机制启发,加拿大滑铁卢大学的科学家们实现了NENGO神经模拟器平台[38]。该平台包括十几个脑区,采用了统一的语义指针架构网络(Semantic Pointer Architecture Unified Network,SPAUN)[39],包含250万个虚拟神经元,可执行8种不同的认知任务:如模仿绘图、计数器、记忆和推理等。该模型构建了前额叶皮质、基底核、丘脑等功能相关区域。在宏观尺度上,部分区域的功能与大脑中特定区域的功能保持了一致。在微观尺度上,单位运算节点与LIF神经元模型保持了一致。SPAUN拥有不多的神经元数量却能够实现较为复杂的认知功能,达到了多个脑区协同来展示复杂行为的目的。然而它的缺点依旧明显,如对不同脑区的功能划分不详细、脑区特定功能是以预设目标函数方法来实现的、微观神经活动是通过自顶向下的反向函数计算拟合得到的、无法很好适应新的工作任务等等。

除此之外,将DNN预先训练然后转化为SNN也是一种高效的SNN实现方法[40],这些方法在DNN训练阶段将权值限制到0附近的小范围内,使得SNN转化后的LIF信息编码可以处于激活函数的近似线性空间内,最后通过统计神经元的放电率来计算网络输出[41, 42]。脉冲耦合神经网络[43]是SNN中的一类特别分支,基本原理是将信息(如图像像素)及其周围邻域的信息同步输入到网络中,根据这些输入信息值的大小关系输出局部整合结果,类似于数字图像处理中的卷积滑动掩膜矩阵,可以等价实现多种图像处理或增强效果,如平滑、滤波、边缘增强等。这些及其他相关的有效尝试,都为人工智能模型和生物发现的深入结合提供了可能的思路[44, 45]。

7 基于多尺度生物可塑性的脉冲神经网络优化方法

7.1 基于微观尺度可塑性的SNN优化

7.2 基于介观尺度可塑性的脉冲神经网络优化

7.3 基于宏观尺度可塑性的SNN优化

8 总结及展望

脉冲神经网络包含具有时序动力学特性的神经元节点、稳态-可塑性平衡的突触结构,是一种局部非监督、全局弱监督的类生物网络,因此具有强大的非线性计算、异步事件信息处理、自学习等能力。

脉冲神经网络独特的信息编码模式,将启发现有的人工神经网络逐步从以网络环路为重心,到节点-环路并重的编码方向发展。生物神经元的膜电位编码符合动力学特性,不同类型的神经元具有功能特异性,因此,可以参考不同脑区、不同功能环路的主要神经元类型,定制化的构建符合特定期望功能的脉冲神经元模型,以此来增强人工神经网络编码的有效性。同时,具有动力学优势的神经元表现出相对传统神经元更大的信息容量,可在节点内部存储更多的历史状态信息,对研究网络的短时记忆、工作记忆等都将有极大的帮助。

脉冲神经网络独特的基于可塑性的优化方法,将启发人工神经网络从单一的函数拟合逐步过渡到通用的认知计算。现有的人工神经网络,主要特点是“重拟合”而“轻认知”。随着神经网络的拟合能力越来越强,人们对于模型智能水平的评价呈现了从低到高再变低的过程,当人工网络的拟合能力达到极致、甚至超过了人类单一任务的最高水平,人工神经网络的诸多认知相关的问题便逐渐凸显:如增量学习能力差;鲁棒性差,特别对噪声或者通过对抗网络学习到的对抗图片的攻击无能为力;认知能力差,不能自组织理解复杂背景,不能像生物系统那样能够轻易的根据几个位置标记的运动轨迹抽象联想出具体的行为动作等。这些问题出现的主要原因之一,在于人工神经网络的设计之初,从网络结构到学习方法等都是根据单一的以性能最优为目标来设计的,因此往往在实际应用的过程中,展现出很多的反常识、不类人、不智能的识别结果。通过借鉴多尺度可塑性机制,脉冲神经网络可以同时满足生物的结构和功能约束,为进一步获得类脑的认知能力打好基础。

脉冲神经网络将不会拘泥于生物计算本身,还将从已有的深度学习、最优化理论等方面获得启发,如高效的BP、TP、强化学习、遗传演化等全局优化方法,在数学理论层面,探讨生物计算和人工计算深度融合的可能。脉冲神经网络的发展目标不是构建人工神经网络的生物版本替代品,而是通过脉冲神经网络的优化理论突破,为构建下一代具有认知特色的高效人工智能模型奠定理论基础。

脉冲神经网络的有效优化理论的建立,还将反向启发生命科学中生物神经网络的研究发现,促进生物领域未解开的对长程回路连接作用的理解、对多脑区协同方式方法的认识、对不同功能的生物网络自组织关联的假设验证等。最终,通过SNN在神经动力学、自组织学习、多模态时空信息融合、鲁棒信息表征等方面取得进展,为研发新一代人工智能计算模型贡献力量。

浙公网安备 33010602011771号

浙公网安备 33010602011771号