清华团队NeurIPS2025最高分论文重磅发现:RLVR训练只是效率优化,大模型推理能力并未超越基座边界

论文标题:Does Reinforcement Learning Really Incentivize Reasoning Capacity in LLMs Beyond the Base Model?

作者团队:清华大学、上海交通大学

发布时间:2025年10月23日

✅Lab4AI平台提供AI导读和AI翻译等工具,辅助论文阅读。

⭐研究背景

近年来,强化学习与可验证奖励(RLVR)已成为提升大语言模型推理能力的主流方法。该方法通过基于可自动验证的奖励信号(如数学答案的正确性、代码通过单元测试)对模型进行强化学习训练,显著提升了模型在数学、编程等复杂推理任务上的表现,使社区普遍认为RLVR能够激励模型获得超越基座模型的新型推理能力。

⭐研究目的

本研究旨在 critically re-examine(批判性地重新审视)一个核心假设:RLVR训练是否真的能够赋予LLMs超越其基座模型原有容量边界的新颖推理能力? 研究通过实验探究RLVR训练的本质效果,区分其究竟是提升了模型的“能力边界”还是仅仅优化了“采样效率”。

⭐核心创新点

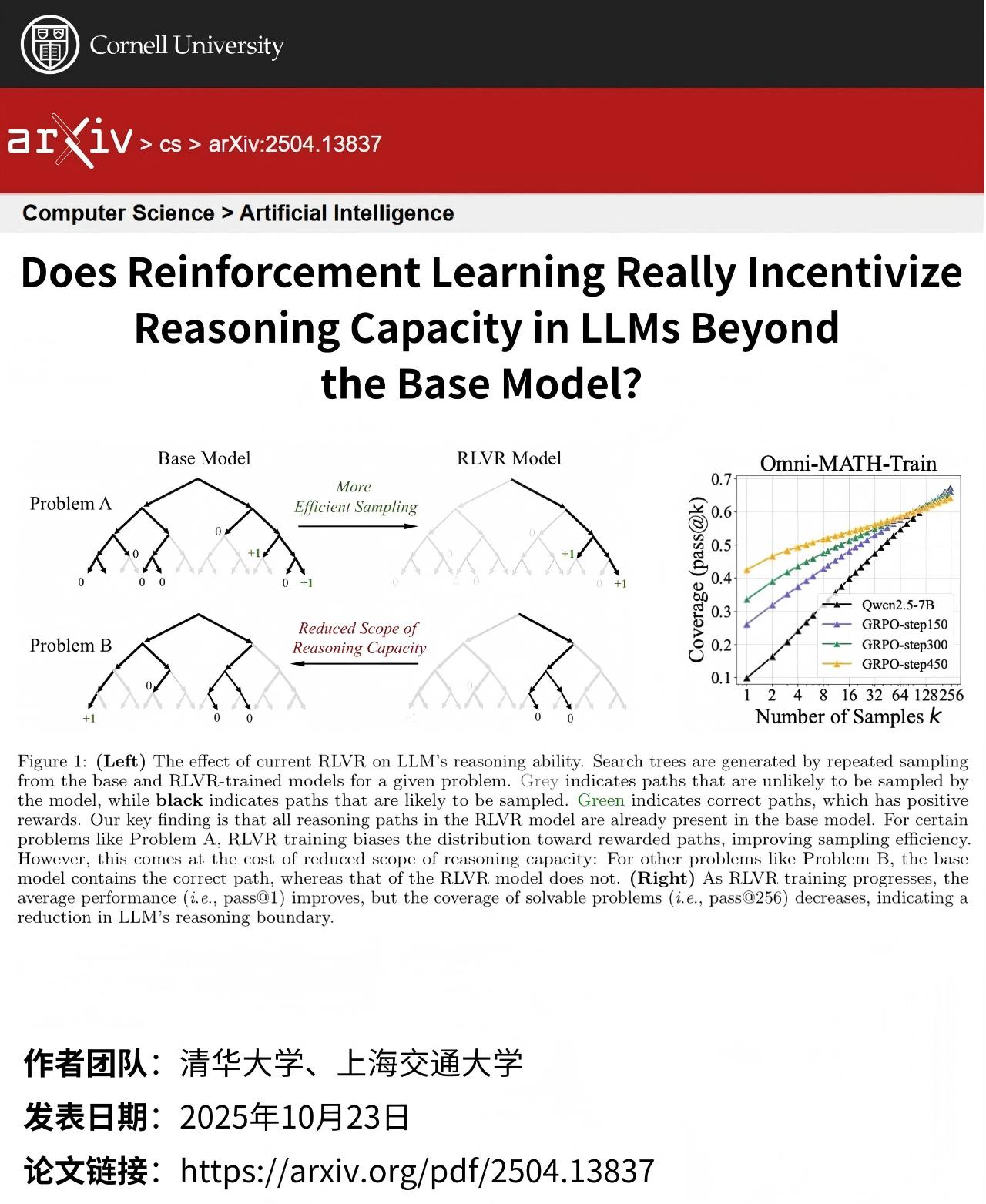

本文通过系统实验揭示,当前基于可验证奖励的强化学习(RLVR)虽能提升LLMs的采样效率,但并未激发超越基础模型的新推理能力。研究发现,RLVR模型的优秀推理路径已存在于基础模型中,其能力本质上受基座模型所限。相比之下,知识蒸馏能引入新能力。这表明现有RLVR方法远未实现其通过探索创造新知识的理想目标。

⭐总结

本研究通过大量实证分析表明,当前形式的RLVR训练主要作用是优化LLMs从其基座模型已具备的推理能力中进行采样的效率,而非激发超越基座模型能力边界的新颖推理能力。RLVR模型的表现上限本质上受限于其基座模型。

浙公网安备 33010602011771号

浙公网安备 33010602011771号