第一篇 文献阅读---基于空洞卷积的多维视频语义分割

文章:

MULTI-SCALE CONTEXT AGGREGATION BY DILATED CONVOLUTIONS

读到这篇论文,参考了博客:https://www.cnblogs.com/fourmi/p/10049998.html

摘要:

在语义分割中,我们开发了一个新的卷积网络模块,专门设计用于密集预测。该模块在不丢失分辨率的情况下,采用了卷积法对多尺度上下文信息进行了系统化处理。该体系结构基于这样一个假设,即扩展的解决方案支持在不损失分辨率或覆盖范围的情况下对该感知区域的指数扩展。结果表明,本文提出的上下文模块提高了语义分割系统的准确性。此外,我们还研究了图像分类网络对稠密预测的适应性,并表明简化适应网络可以提高预测精度。

Unit 1:计算机视觉中的语义分割

语义分割是计算机视觉中十分重要的领域,它是指像素级地识别图像,即标注出图像中每个像素所属的对象类别。下图为语义分割的一个实例,其目标是预测出图像中每一个像素的类标签。分割的目标一般是将一张RGB图像(height*width*3)或是灰度图(height*width*1)作为输入,输出的是分割图,其中每一个像素包含了其类别的标签(height*width*1). 为了清晰起见,使用了低分辨率的预测图,但实际上分割图的分辨率应与原始输入的分辨率相匹配。(https://blog.csdn.net/Biyoner/article/details/82591370)

Unit 2:DILATED CONVOLUTIONS ---空洞卷积

普通卷积 i.e. dilation=1

空洞卷积 i.e. dilation=2

空洞卷积核中的点距离由 1 增加到了 dilation 值,即中间 dilation-1 的地方都是空着的,这个空着的地方,一方面保持了卷积的参数的单次卷积运算量的不变,同时扩大了卷积的视野。

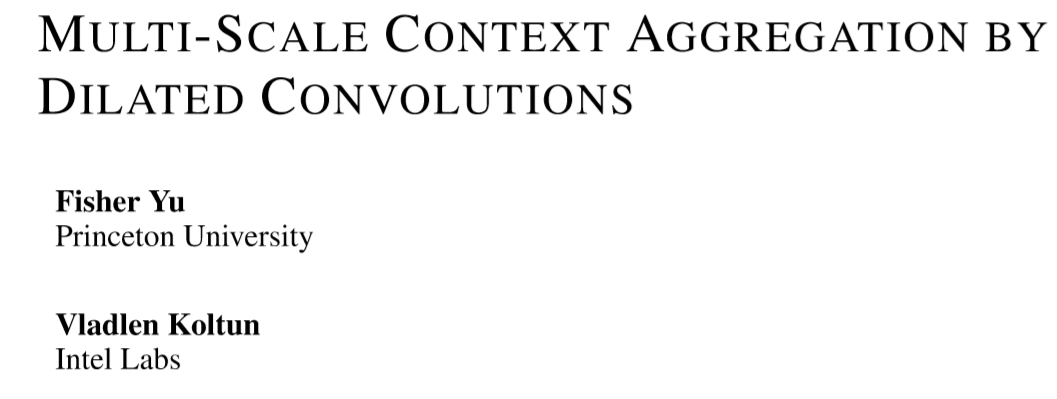

a图中每个红点表示3X3的视野范围 b中每个红点表示7X7的视野范围(因为中间空出了2个格子) c中每个红点视野范围为15X15

视野范围的计算公式为:M =(K+1)*N - 1 【K是卷积核维度 N是dilated数】

Unit 3:多级上下文聚合

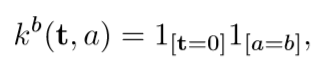

上下文聚合模块因为输入输出都是C特征图的形式,所以可以插入现有的稠密预测结构中。

上下文模块的基本构成是:每个层都有C个通道; 每个层的表现是相同的; 每个层都可以用于直接获得一个稠密类预测;

尽管没有标准化特征图也没有定义LOSS 但是该模块可以通过传递特征图以揭示上下文信息以提高预测的准确性。

基本上下文模块由7层3X3卷积构成,只是膨胀因子不同,分别取值为1,1,2,4,8,16,1。

每层的3X3XC卷积都有前两个维度的膨胀,所有后面都跟这一个逐点截取的 max(·,0)函数。最后一层为1X1XC 因为处理特征图为64X64 所以到第六层就不膨胀了,要不视野就超了。

实验的第一次尝试失败了,标准化的初始化过程不能达到良好的训练效果。

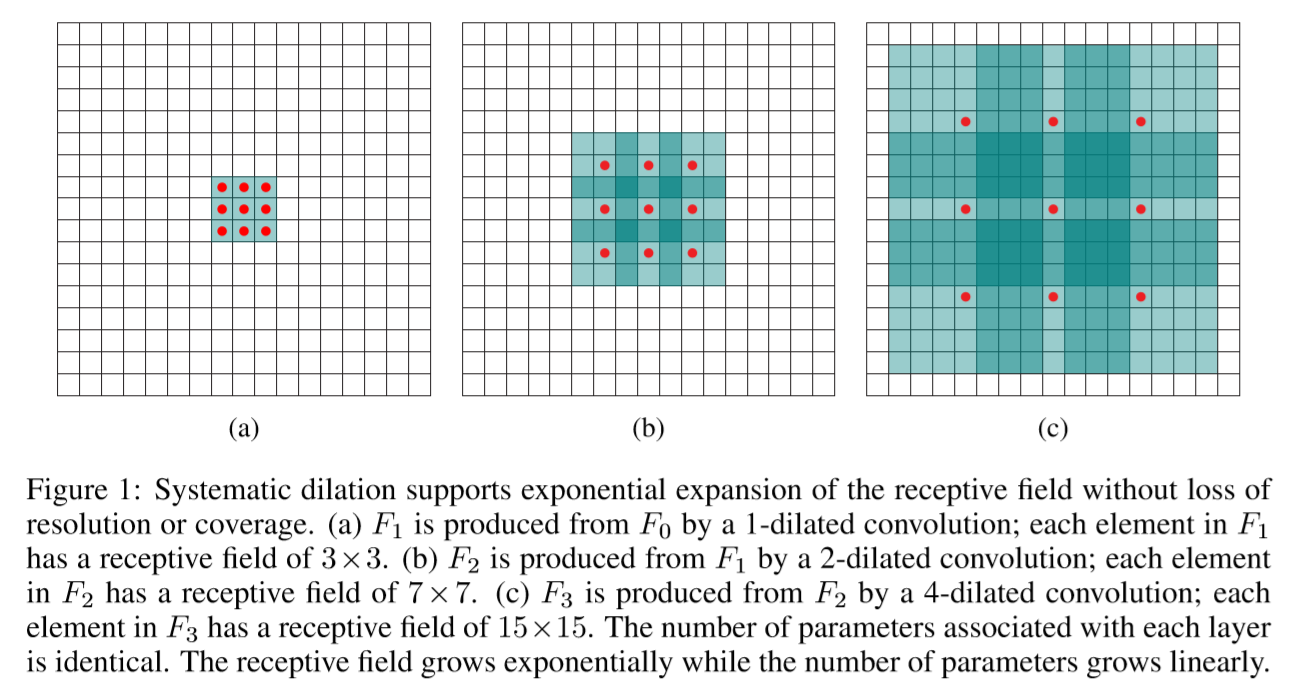

通常卷积神经网络人们都是用随机分布初始化,但是在本实验中我们发现一种清空语义的选择初始化方案更好用:

其中a,b分别为特征图和输出图的索引

网络结构

大型网络的初始化函数

测试结果:https://arxiv.org/abs/1511.07122

TensorFlow模型:https://github.com/ndrplz/dilation-tensorflow

论文提供模型:https://github.com/fyu/dilation

(本文的工作是朝着不受图像预分类约束的密集预测专用架构迈出的一步。随着新的数据源的出现,未来的体系结构可能会变成端到端的密集训练,不再需要预先训练动物分类数据集,这可以实现架构的简化和统一。具体地说,端到端的密集训练可以实现完全密集的体系结构,类似于呈现的上下文网络,通过输出操作完全分辨率,接受原始图像作为输入,并以完全分辨率生成密集的标签分配作为输出。----目标:端到端的密集标签分配)

个人总结:本文用了一个使用空洞卷积的上下文聚合模块提高语义分割的精度。扩展卷积算子特别适合于密集预测,因为它能够在不丢失分辨率或覆盖率的情况下扩展接收场。本文还表明,现有的卷积网络用于语义分割的精度可以通过去除图像冗余来增加。

浙公网安备 33010602011771号

浙公网安备 33010602011771号