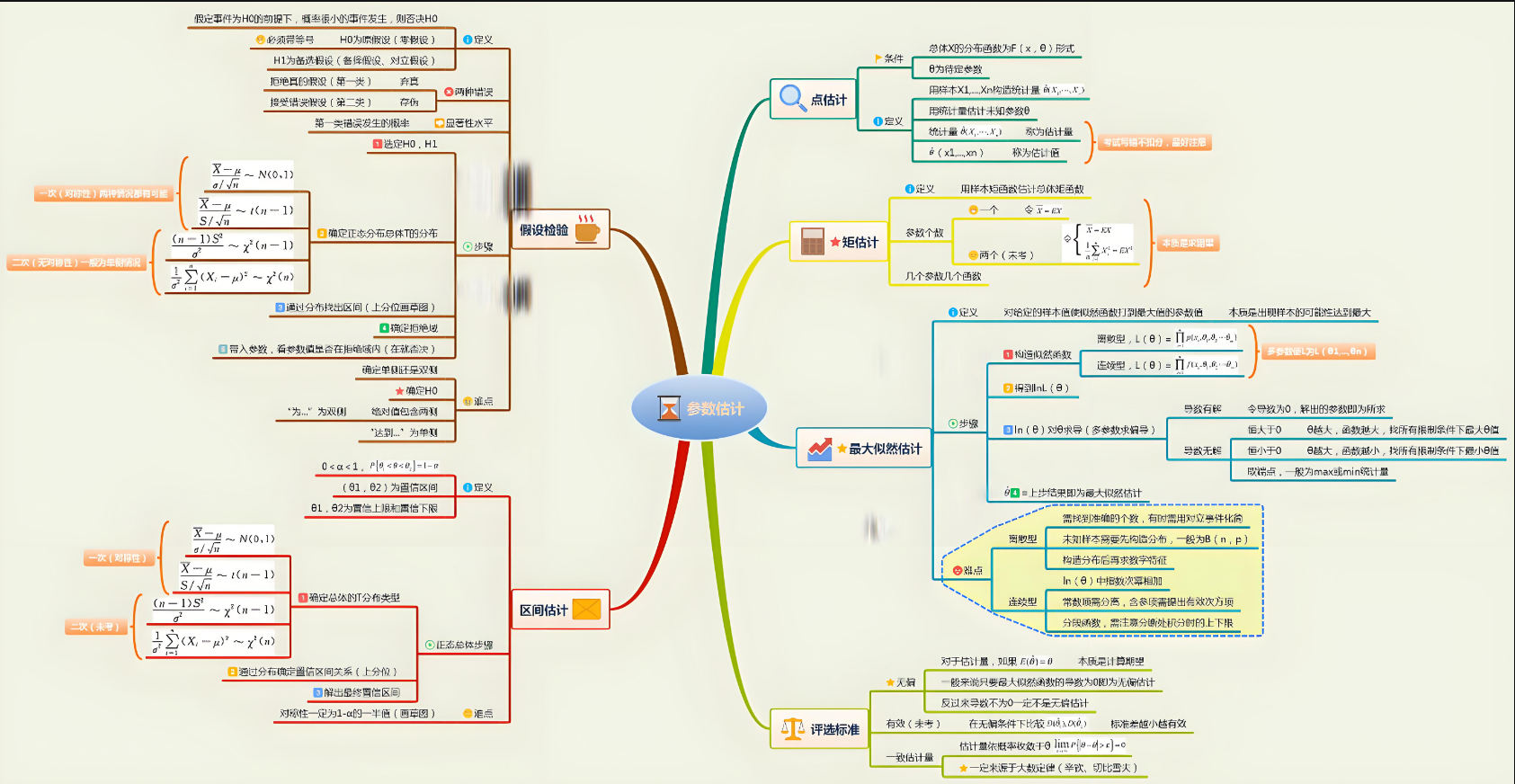

统计学(十五)——参数估计概要

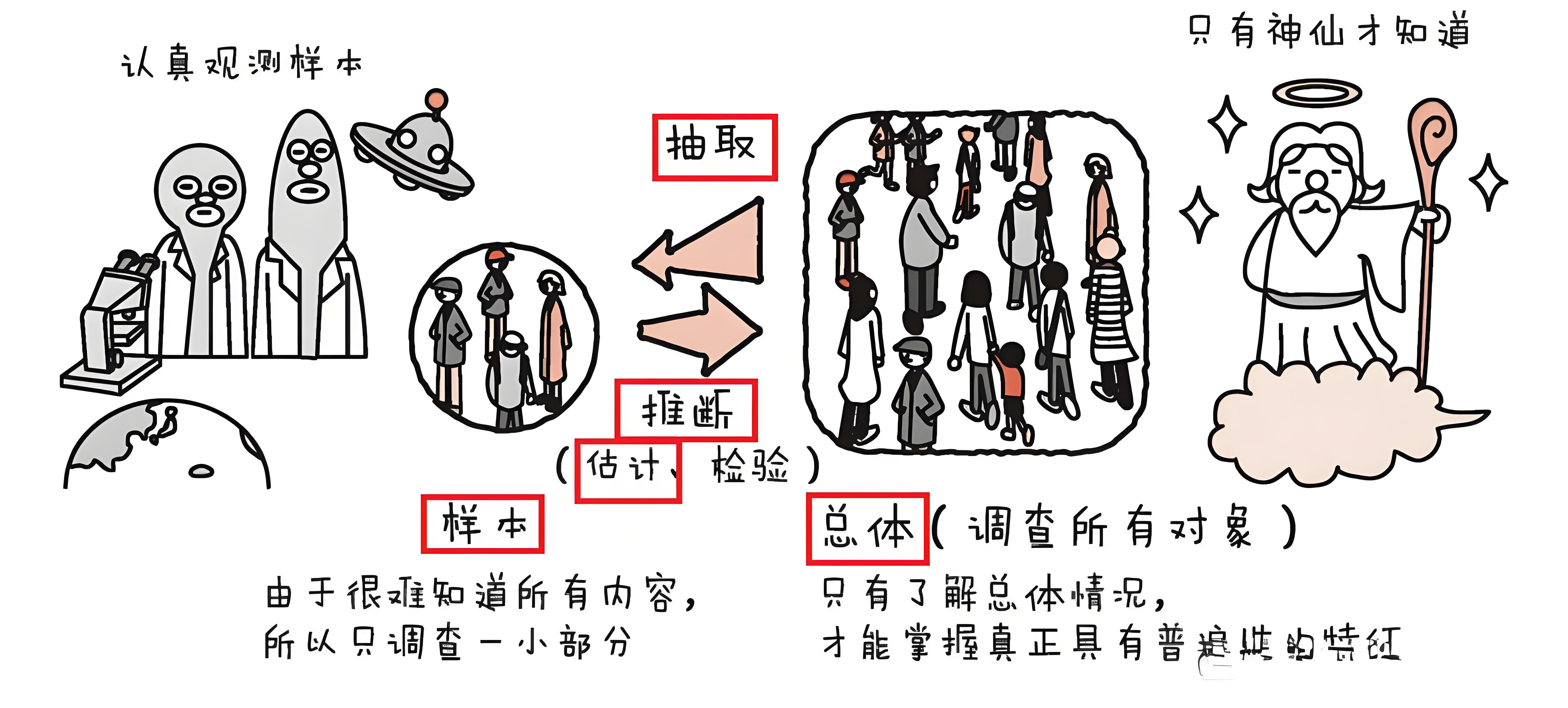

在数理统计与计量经济学中,参数估计(Parameter Estimation)是推断总体分布性质的核心任务之一。由于在现实问题中,我们往往无法获取总体的全部信息,因此只能依赖有限的样本数据,对总体分布中的关键参数进行合理的估计。这一过程不仅涉及对概率模型的理解,还要求构造具有良好统计性质的估计量。参数估计在统计推断体系中处于基础而关键的地位,是进行假设检验、模型构建与预测分析的重要前提。

一、参数估计的基本思想

统计推断的核心任务是通过样本信息反推出总体特征。其中,参数估计(Parameter Estimation)是统计推断中最基础、最常用的一种方式,它旨在利用有限的样本数据对总体分布中某些未知但关键的参数进行数值估计。相比于假设检验、区间估计等推断方法,参数估计更关注于“点”上对参数的数值把握,是所有后续推断的基础。

例如,在正态总体 \(N(\mu, \sigma^2)\) 中,均值 \(\mu\) 与方差 \(\sigma^2\) 是两个重要的参数,它们分别刻画了数据的集中趋势和离散程度。通常我们并不知道 \(\mu\) 和 \(\sigma^2\) 的真实数值,但可以通过样本均值 \(\bar{X}\)、样本方差 \(S^2\) 来作为这两个参数的“代表”,进行近似估计。

1.1 什么是“参数”

在统计学中,“参数”是用来描述总体分布特征的固定常数,尽管其数值未知,但我们假定它存在,并且是唯一的。参数不是变量,不随样本改变;但我们的任务是用样本数据来对其进行估计。

常见参数包括但不限于:

-

均值 \(\mu\):描述总体分布的中心位置,表示总体数据的期望值;

-

方差 \(\sigma^2\):衡量总体数据的离散程度,是稳定性和风险的衡量指标;

-

比例参数 \(p\):出现在伯努利分布、二项分布等模型中,用来描述事件发生的概率;

-

回归参数 \(\beta_i\):用于线性回归模型或广义线性模型中,反映解释变量对因变量的影响程度;

-

相关系数 \(\rho\):用于描述两个变量之间的线性相关关系。

这些参数通常不直接观测得到,但在实际问题中往往是决策、预测与控制的关键。因此,我们希望通过统计手段对它们进行合理的估计。

1.2 样本与统计量

在统计学中,“样本”是从总体中随机抽取的一组观测值,记作 \(X_1, X_2, \ldots, X_n\),是总体的子集,具有独立同分布(i.i.d.)的假设前提。样本是我们进行推断的唯一数据来源。

“统计量”是样本观测值的函数,即:

统计量本身是随机变量,它们的分布依赖于总体分布和样本容量。

常见的统计量如下:

-

样本均值:

\[\bar{X} = \frac{1}{n} \sum_{i=1}^{n} X_i \]用于估计总体均值 \(\mu\)。

-

样本方差:

\[S^2 = \frac{1}{n-1} \sum_{i=1}^{n}(X_i - \bar{X})^2 \]用于估计总体方差 \(\sigma^2\)。除以 \(n-1\) 是为了使估计量无偏(Bessel校正)。

-

样本比例:

\[\hat{p} = \frac{1}{n} \sum_{i=1}^{n} I(X_i = 1) \]用于估计某事件发生的概率 \(p\)。

统计量的设计应具有良好的估计性能,比如无偏性、一致性和有效性,这些性质将影响参数估计的准确程度和稳定性。

1.3 参数估计的目标

参数估计的最终目标是从样本出发,构造一个具有统计意义与实践价值的估计量,以尽可能贴近真实的总体参数。在这个过程中,我们需要解决三个核心问题:

- 如何构造估计量? 选择合适的统计量对参数进行估计。例如使用 \(\bar{X}\) 估计 \(\mu\),使用 \(S^2\) 估计 \(\sigma^2\)。

- 估计量好不好? 需要评估估计量的性质,例如是否为无偏估计、一致估计、最小方差估计等。

- 如何进行理论分析与实际计算? 需要结合分布知识、概率论与数值方法,推导估计量的分布、期望、方差等性质,以确保估计过程具有可控性与可靠性。

因此,参数估计不仅仅是一个“计算公式”,更是一个涵盖理论构造、方法选择、性质分析、实际应用等多个层次的系统过程。一个优秀的估计方法,不仅可以提高推断精度,还能降低模型的不确定性,为后续建模与决策提供坚实基础。

二、参数估计的一般流程

虽然参数估计的方法种类丰富,涉及不同的理论背景和技术路线,但它们在应用中往往遵循相似的逻辑流程。一般而言,完成一次系统的参数估计工作通常包括以下五个关键步骤:

2.1 明确总体模型

首先需要根据研究问题的实际背景,合理假设总体所服从的概率模型。这一环节至关重要,因为模型的选取直接决定了参数形式、估计方法及其理论基础。常见的概率模型有:

- 正态分布 \(N(\mu, \sigma^2)\):常用于处理自然现象(如身高、体重、测量误差等);

- 二项分布 \(B(n, p)\):适用于独立重复试验中事件发生次数的建模;

- 泊松分布 \(P(\lambda)\):描述单位时间或单位空间内的随机事件数(如事故、来电、顾客流);

- 指数分布、伽马分布、对数正态分布 等也常根据应用场景出现。

该步骤的核心目标是:给出概率分布形式,确定待估参数的种类与个数。例如,在一个正态总体中,我们常常关注两个参数:均值 \(\mu\) 和方差 \(\sigma^2\)。

2.2 收集样本数据

在明确模型后,需要从总体中抽取一组具有代表性的样本数据。合理的样本采集策略应遵循以下原则:

- 独立同分布(i.i.d.):每一个样本点应独立于其他点,且服从同一个总体分布;

- 样本量足够大:样本量越大,估计结果越稳定,估计量的一致性才有保障;

- 避免偏倚抽样:应采用随机抽样方式,避免人为选择带来的偏差。

收集的数据通常表现为观测序列 \(\{x_1, x_2, \ldots, x_n\}\),它们是总体中个体的观测值,是后续统计分析的唯一依据。

2.3 选择合适的估计方法

根据所建模型的形式和数据特征,选择合适的参数估计方法是整个流程的技术核心。主要方法包括:

- 方法矩(Method of Moments, MOM):通过使样本矩与总体矩相等,构造出参数的估计值,优点是计算简便,适用于简单模型;

- 极大似然估计(Maximum Likelihood Estimation, MLE):通过最大化样本在给定参数下的联合概率密度(或质量)函数,找到最可能的参数取值,具有强大的理论支持;

- 贝叶斯估计(Bayesian Estimation):通过将参数视为随机变量,引入先验分布和样本信息(似然函数),结合贝叶斯公式计算后验分布,从中获得估计值;

- 最小二乘估计(Least Squares, LS):主要用于回归模型中,通过最小化误差平方和得到参数估计,简洁有效,易于计算。

估计方法的选择需考虑模型复杂度、样本量大小、计算资源以及是否需要先验知识等因素。

2.4 构造估计量并计算估计值

一旦选择了合适的估计方法,就可以根据方法的原理构造估计量,并通过样本数据进行数值计算。估计量是关于样本的函数,是一个随机变量,而估计值是样本代入后的具体数值。

例如:

- 对正态总体的均值进行估计时,可用样本均值:\[\bar{X} = \frac{1}{n} \sum_{i=1}^n X_i \quad \text{估计} \quad \mu \]

- 若采用极大似然估计,对于伯努利总体的参数 \(p\),其估计值为样本中“成功”的比例:\[\hat{p} = \frac{1}{n} \sum_{i=1}^n X_i \]

这一环节既包括数学推导,又包括数值运算,需保证公式严谨、计算准确。

2.5 分析估计结果

估计结果的解释与评价是判断其“好坏”的关键所在。主要评估的标准包括:

- 无偏性(Unbiasedness):估计量的期望是否等于真实参数值;

- 一致性(Consistency):样本量趋于无穷时,估计量是否收敛于参数;

- 有效性(Efficiency):在所有无偏估计量中,估计量是否具有最小方差;

- 充分性(Sufficiency):估计量是否包含了样本中所有关于参数的信息;

- 计算简便性与应用价值:估计是否容易推广、解释与实施。

此外,还可通过构造置信区间、进行假设检验等方式进一步丰富估计结果的解释性与稳定性。

三、参数估计的主要方法

参数估计方法众多,各具特点。根据其构造思路与理论背景,常见的方法包括:方法矩(MOM)、极大似然估计(MLE)、最小二乘估计(LS) 以及 贝叶斯估计(Bayesian Estimation)。

3.1 方法矩(Method of Moments, MOM)

方法矩是最早发展出的参数估计技术之一,其基本思路非常直观:令样本矩等于理论矩来解出未知参数。

设总体分布具有一阶矩和二阶矩:

- 理论期望:\(\mathbb{E}[X] = \mu\)

- 理论方差:\(\mathbb{D}[X] = \sigma^2\)

我们可以通过以下等式构造估计:

- \(\bar{X} = \mu\)

- \(S^2 = \sigma^2\)

对于有 \(k\) 个参数的模型,构造 \(k\) 个矩等式,联立求解即可。

3.2 极大似然估计(Maximum Likelihood Estimation, MLE)

MLE 是目前最常用的参数估计方法之一,其核心思想:找到一组参数,使得在该参数下,实际观测到的样本是“最有可能”出现的。其一般步骤为

-

写出似然函数(样本联合密度函数):

\[L(\theta) = \prod_{i=1}^n f(x_i; \theta) \] -

为便于求导,转化为对数似然函数:

\[\ell(\theta) = \ln L(\theta) = \sum_{i=1}^n \ln f(x_i; \theta) \] -

对参数 \(\theta\) 求导并令导数为零,解方程获得极值点。

-

验证所得解是否为极大值(通过二阶导数判定法等)。

设样本来自正态分布 \(N(\mu, \sigma^2)\),其中 \(\sigma^2\) 已知,似然函数为:

对数化并对 \(\mu\) 求导:

3.3 最小二乘估计(Least Squares, LS)

最小二乘法主要用于回归模型中,目的是:选择一组参数,使得模型预测值与真实观测值之间的误差平方和最小。如一元线性回归模型:

设观测模型为:

目标函数为残差平方和:

对参数求偏导并联立方程解得最优参数值:

3.4 贝叶斯估计(Bayesian Estimation)

贝叶斯估计体现了参数估计的另一种思路:将参数本身也视为一个随机变量,利用先验知识和样本信息共同更新对参数的认知。核心公式(贝叶斯公式):

- \(P(\theta)\):先验分布

- \(L(\theta)\):似然函数

- \(P(\theta | x)\):后验分布

- 贝叶斯估计量可取后验均值、众数或中位数

对伯努利总体 \(X \sim B(1, p)\),设先验分布为 Beta 分布 \(p \sim \text{Beta}(a, b)\),则后验为:

| 方法名称 | 原理 | 优点 | 缺点 | 应用领域 |

|---|---|---|---|---|

| 方法矩(MOM) | 样本矩 = 理论矩 | 计算简便,形式直观 | 精度较低,受矩存在限制 | 基础估计、教学 |

| 极大似然估计(MLE) | 最大化样本在参数下的似然函数 | 渐近无偏、高效、可拓展 | 求导困难,局部极值问题 | 通用统计模型、经济学 |

| 最小二乘估计(LS) | 最小化残差平方和 | 算法高效,线性模型适配好 | 异常值敏感,需假设残差条件 | 回归分析、计量经济学 |

| 贝叶斯估计 | 后验分布推断参数 | 融合先验,适应复杂结构 | 计算复杂,先验主观 | 小样本、机器学习 |

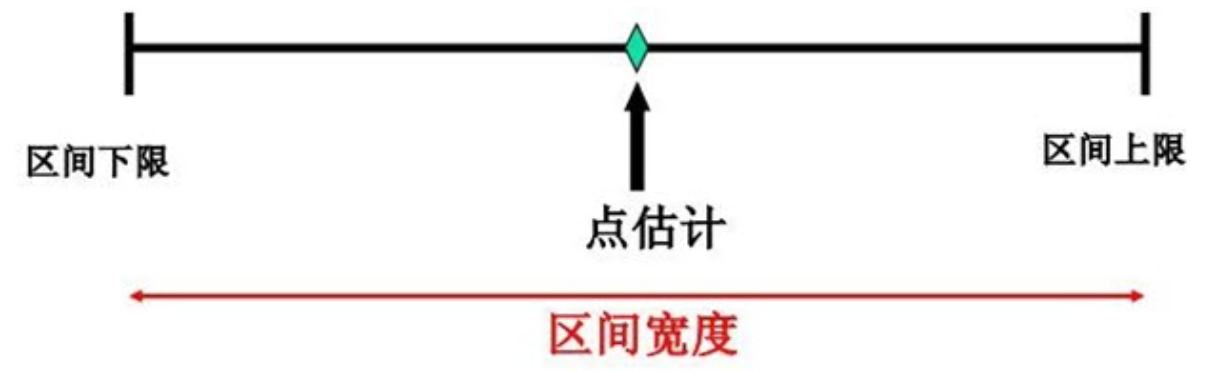

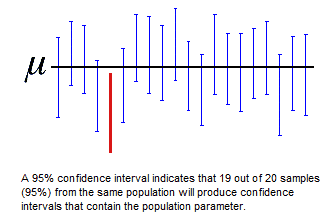

四、区间估计与置信区间的构造

参数估计包括点估计和区间估计两种方式:点估计是用一个具体数值来估计总体参数,例如用样本均值估计总体均值;而区间估计则给出一个区间范围,表明参数落在该范围内的可信程度,通常伴随置信水平。点估计虽能提供一个参数的“估计值”,但无法反映估计的不确定性。区间估计(Interval Estimation)通过构造一个包含真实参数的区间,并给出其可信度,具有更高的信息量。

4.1 区间估计的定义

区间估计的基本思想是:根据样本数据构造一个区间,使得该区间在一定的置信度(如 95%)下能包含未知参数值。形式上,若我们从样本 \(X_1, X_2, \ldots, X_n\) 中构造出两个统计量 \(L(X)\) 与 \(U(X)\),使得:

则称区间 \([L(X), U(X)]\) 为参数 \(\theta\) 的 \(100(1-\alpha)\%\) 的置信区间(Confidence Interval),其中 \(1 - \alpha\) 即为置信水平(Confidence Level),常取为 0.95 或 0.99,意味着在重复实验中有 95% 或 99% 的区间会覆盖真实参数值。

4.2 利用枢轴量构造区间

区间估计通常借助于枢轴量(Pivotal Quantity)的理论构建。枢轴量是一类与总体参数有关但其分布已知的统计量,它在构造置信区间时起到桥梁作用。

例如,在正态分布 \(N(\mu, \sigma^2)\) 中,若总体方差 \(\sigma^2\) 已知,则样本均值 \(\bar{X}\) 的标准化量:

这是一个标准正态分布的枢轴量。我们可利用该分布的分位数来构造 \(\mu\) 的置信区间。在 95% 置信水平下:

代入 \(Z\) 的表达式,进行代数变换:

即得 \(\mu\) 的 95% 置信区间为:

若 \(\sigma^2\) 未知,需使用样本方差 \(S^2\) 并引入 t 分布:

则对应置信区间变为:

此方法在实际中非常常见,适用于均值、比例、方差等多种参数的区间估计。

4.3 区间估计的意义与作用

与点估计相比,区间估计的优势在于:

- 更直观表达估计精度:提供上下限比单一数值更能反映不确定性;

- 可控制推断风险:通过设定置信水平明确允许的误差范围;

- 适用于决策分析:为风险管理、假设检验提供依据。

在科研与工程实践中,人们更倾向于使用区间估计结果。例如:医学临床试验中,不仅关心药物平均疗效,更关注疗效可能区间;金融市场预测中,也不只是给出未来股价期望值,更关注置信带宽。

| 样本情况 | 参数 | 置信下限 | 置信上限 | 自由度 |

|---|---|---|---|---|

| 大样本或小样本 总体方差 \(\sigma^2\) 已知 |

\(\mu\) | \(\bar{x} - u_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | \(\bar{x} +u_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | - |

| 大样本 总体方差未知 |

\(\mu\) | \(\bar{x} - u_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | \(\bar{x} + u_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | - |

| 小样本 总体方差未知 |

\(\mu\) | \(\bar{x} - t_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | \(\bar{x} + t_{\frac{\alpha}{2}} \frac{\sigma}{\sqrt{n}}\) | \(n - 1\) |

| 两总体方差 \(\sigma_1^2\)、\(\sigma_2^2\) 已知 | \(\mu_1 - \mu_2\) | \(\bar{x}_1 - \bar{x}_2 - u_{\frac{\alpha}{2}} \sigma_0\) | \(\bar{x}_1 - \bar{x}_2 + u_{\frac{\alpha}{2}} \sigma_0\) | - |

| 两总体方差未知 但 \(\sigma_1^2 = \sigma_2^2\) |

\(\mu_1 - \mu_2\) | \(\bar{x}_1 - \bar{x}_2 - t_{\frac{\alpha}{2}} s_0\) | \(\bar{x}_1 - \bar{x}_2 + t_{\frac{\alpha}{2}} s_0\) | \(n_1 + n_2 - 2\) |

| 单总体比例估计 | \(p\) | \(\hat{p} - u_{\frac{\alpha}{2}} \sqrt{\frac{\hat{p}(1-\hat{p})}{n}}\) | \(\hat{p} + u_{\frac{\alpha}{2}} \sqrt{\frac{\hat{p}(1-\hat{p})}{n}}\) | - |

| 两总体比例差异 | \(p_1 - p_2\) | \(\hat{p}_1 - \hat{p}_2 - u_{\frac{\alpha}{2}} \sqrt{ \frac{\hat{p}_1(1 - \hat{p}_1)}{n_1} + \frac{\hat{p}_2(1 - \hat{p}_2)}{n_2} }\) | \(\hat{p}_1 - \hat{p}_2 + u_{\frac{\alpha}{2}} \sqrt{ \frac{\hat{p}_1(1 - \hat{p}_1)}{n_1} + \frac{\hat{p}_2(1 - \hat{p}_2)}{n_2} }\) | - |

| 总体方差估计(正态总体) | \(\sigma^2\) | \(\frac{(n - 1) S^2}{\chi^2_{\alpha/2}}\) | \(\frac{(n - 1) S^2}{\chi^2_{1 - \alpha/2}}\) | \(n - 1\) |

| 比例总体的样本容量估计 | \(n\) | \(\frac{Z^2_{\alpha/2} \cdot \hat{p}(1 - \hat{p})}{E^2}\) | - | - |

五、参数估计的典型例题

通过三个经典统计模型,展示参数估计在实际中的应用过程,包括点估计、极大似然估计的完整推导。

5.1 正态总体的参数估计

设样本来自正态总体 \(X_1, X_2, \ldots, X_n \sim N(\mu, \sigma^2)\),现需对均值 \(\mu\) 和方差 \(\sigma^2\) 进行估计。

解:

- 点估计均值 \(\mu\):

根据定义,样本均值 \(\bar{X}\) 是对总体均值 \(\mu\) 的自然估计:

它是无偏估计量,且具有一致性和渐近正态性。

- 点估计方差 \(\sigma^2\):

样本方差采用无偏形式:

这是对 \(\sigma^2\) 的无偏估计,随着 \(n \to \infty\) 收敛于真实方差。

5.2 抛硬币问题中的极大似然估计

某实验中对一枚硬币抛掷 100 次,出现正面 65 次,问如何估计该硬币正面概率 \(p\)?

解:

该实验服从二项分布 \(B(n=100, p)\),观察值为 \(x = 65\)。

- 构造似然函数:

- 取对数方便求导:

- 求导并令导数为 0:

解得:

因此,极大似然估计为 \(\hat{p} = 0.65\),即正面概率估计为 65%。

5.3 指数分布参数的极大似然估计

设随机变量 \(X_1, X_2, \ldots, X_n\) 独立同分布于指数分布:

要求估计参数 \(\lambda\)。

解:

- 写出似然函数:

- 取对数求导:

- 令导数为零求极值:

即极大似然估计为:

5.4 区间估计

已知某种灯泡寿命服从正态分布,从中随机抽取16只灯泡,得到其使用寿命(小时)如下:

1510, 1450, 1480, 1460, 1520, 1480, 1490, 1460

1480, 1510, 1530, 1470, 1500, 1520, 1510, 1470

试以 95% 的置信水平,估计该种灯泡的平均使用寿命。

解:

- 第一步:计算样本均值(点估计)

由图可知,样本容量 \(n = 16\),样本寿命总和为:

所以样本均值为:

- 第二步:计算样本标准差

- 第三步:构造区间估计公式

由于总体方差未知,且总体服从正态分布,因此应采用 t 分布 构造置信区间。

置信水平为 95%,自由度为 \(n - 1 = 15\),查表得:

于是,均值的置信区间为:

计算标准误差:

计算置信区间:

- 统计结果:

以 95% 的置信水平,该种灯泡的平均寿命区间估计为:\([1476.8,1503.2] \text{小时}\)

# 灯泡寿命数据

lifespan <- c(1510, 1450, 1480, 1460, 1520, 1480, 1490, 1460,

1480, 1510, 1530, 1470, 1500, 1520, 1510, 1470)

# 样本容量

n <- length(lifespan)

# 样本均值

x_bar <- mean(lifespan)

# 样本标准差(使用无偏估计)

s <- sd(lifespan)

# 置信水平 95%,自由度 n - 1

alpha <- 0.05

df <- n - 1

t_critical <- qt(1 - alpha / 2, df)

# 标准误差

se <- s / sqrt(n)

# 构造置信区间

lower <- x_bar - t_critical * se

upper <- x_bar + t_critical * se

# 输出结果

cat("样本均值:", x_bar, "小时\n")

cat("样本标准差:", round(s, 4), "小时\n")

cat("t临界值:", round(t_critical, 4), "\n")

cat("标准误差:", round(se, 4), "小时\n")

cat("95%置信区间:[", round(lower, 2), ",", round(upper, 2), "] 小时\n")

总结

参数估计作为统计学的重要分支,不仅为样本与总体之间建立了关键的联系,也为现代统计推断体系奠定了理论基础。在大数据与智能化时代背景下,参数估计技术已不仅仅局限于传统数理统计范畴,更逐步扩展至机器学习、人工智能、数据科学等多个交叉领域。其方法论与算法的发展,对于提升模型预测性能、优化经济与工程决策具有举足轻重的作用。

参数估计的研究与应用已呈现出多元化和智能化的发展趋势。首先,随着深度学习和强化学习的广泛应用,如何将参数估计方法与人工智能模型深度融合,构建更高效、更具解释性的估计框架,将成为重要课题。其次,小样本情境下的参数估计方法,如稳健估计、贝叶斯方法等,将在医学、生物、金融等领域得到更广泛的关注。再次,贝叶斯估计作为连接主观信念与数据推断的桥梁,其与决策理论的结合将在智能决策系统中发挥越来越大的作用。最后,借助高性能计算、并行算法与马尔可夫链蒙特卡罗(MCMC)方法,对复杂模型进行高效求解与参数估计,将推动统计推断走向更高维度与更大规模的实际问题处理能力。总体而言,参数估计将在理论深化与技术演化中不断拓展其边界,成为连接理论研究与实际应用的重要纽带。

浙公网安备 33010602011771号

浙公网安备 33010602011771号