vLLM Ascend 是最优解吗?基于 mis-tei 实现昇腾上的高性能 Embedding/Reranker 模型推理

在昇腾(Ascend)生态中,vLLM 等推理引擎在生成类任务中表现出色,已被广泛采用。而在 Embedding 与 Reranker 等检索相关场景下,mis-tei 作为专用推理组件,同样提供了高效且更贴合场景的能力。

mis-tei 专注于文本向量生成与重排序能力,广泛应用于检索增强(RAG)、语义搜索等场景。

但在实际落地过程中,我们发现:

- 官方镜像可以使用,但接入成本较高

- 路径依赖、参数配置、运行方式存在一定门槛

- 在 GPUStack 中集成时,需要额外适配

基于这些问题,我们对官方镜像进行了重打包与简化处理,并以社区镜像形式提供,大幅降低接入复杂度。

本文将基于社区镜像,演示如何在 GPUStack 中接入 mis-tei 后端,并进行高性能 Embedding/Reranker 模型推理。

镜像说明

1. Ascend 官方镜像

swr.cn-south-1.myhuaweicloud.com/ascendhub/mis-tei:7.3.0-300I-Duo-aarch64

swr.cn-south-1.myhuaweicloud.com/ascendhub/mis-tei:7.3.0-800I-A2-aarch64

swr.cn-south-1.myhuaweicloud.com/ascendhub/mis-tei:7.3.0-800I-A3-aarch64

2. GPUStack 社区镜像(推荐)

swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-300I-Duo-aarch64

swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-800I-A2-aarch64

swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-800I-A3-aarch64

3. 优化点说明

相比官方镜像,社区版本主要做了以下优化:

- ✅ 简化启动脚本,优化默认参数配置

- ✅ 支持任意参数透传,增强灵活性

- ✅ 开箱即用接入 GPUStack,降低使用门槛

重打包的具体实现细节,可参考社区后端仓库:

https://github.com/gpustack/community-inference-backends/tree/main/mis-tei

接入 mis-tei 后端

在 GPUStack 中,可以通过自定义后端的方式接入 mis-tei。

操作步骤

-

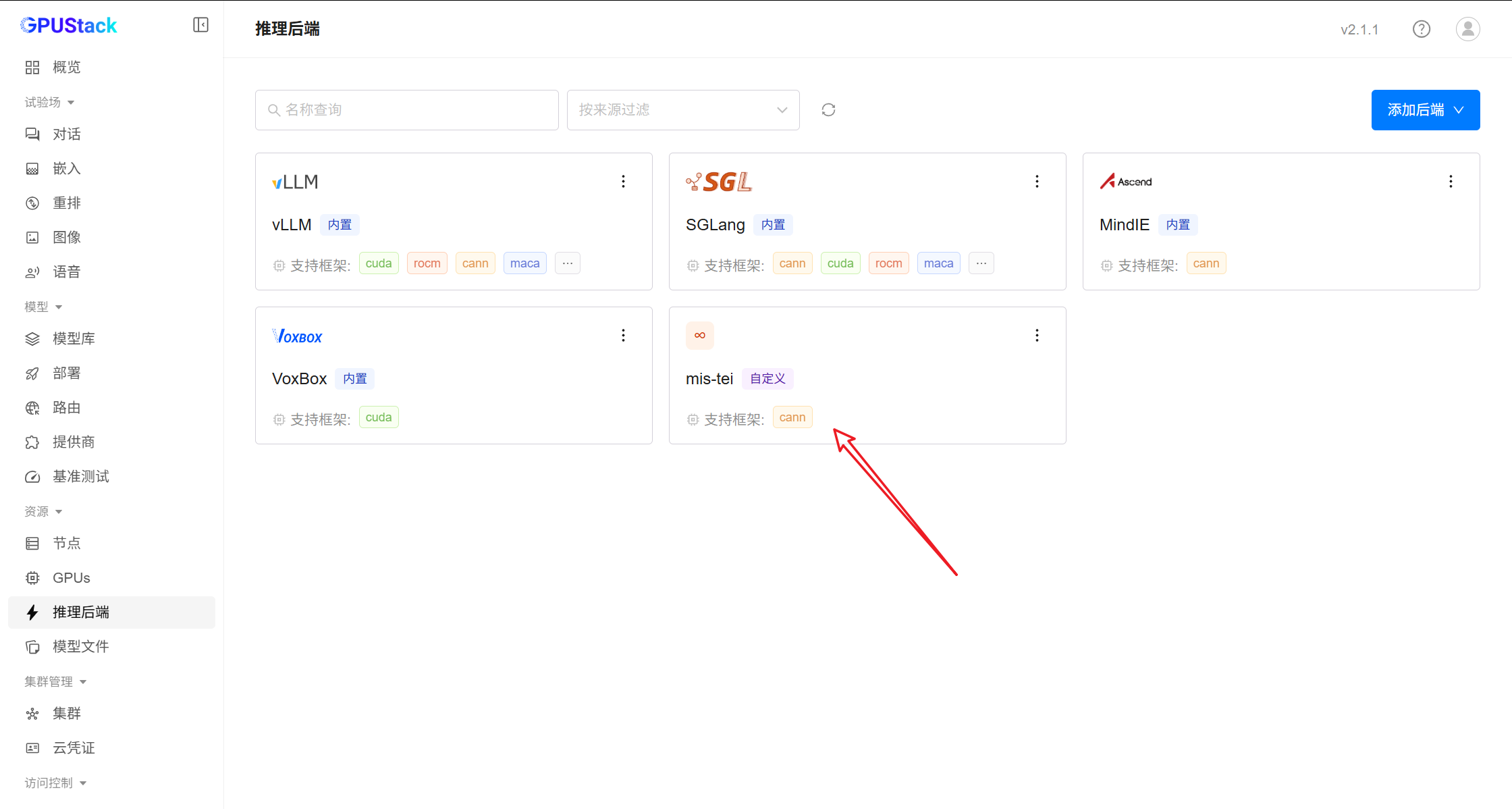

进入 推理后端 页面

-

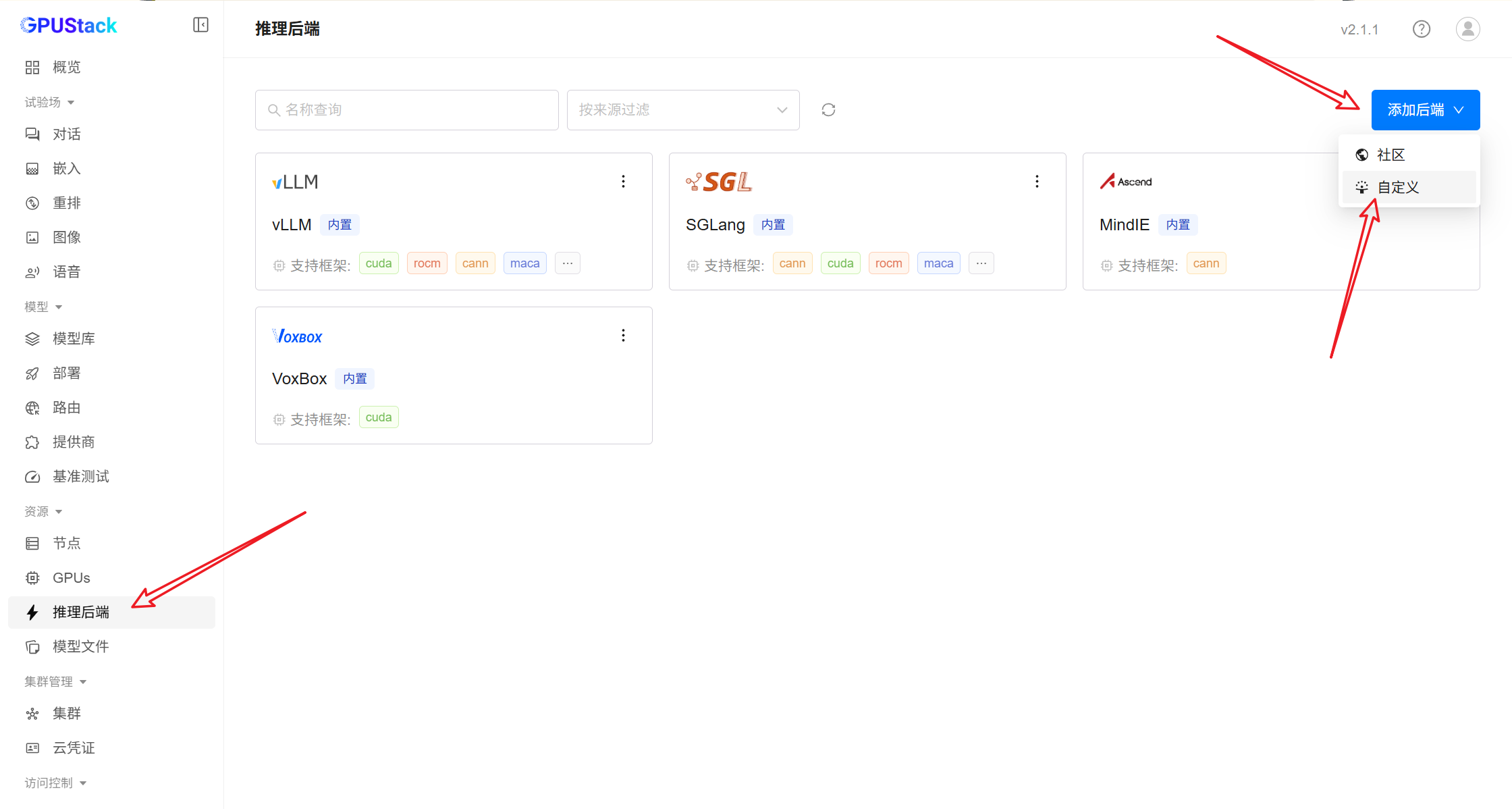

点击右上角 添加后端 → 自定义

![]()

-

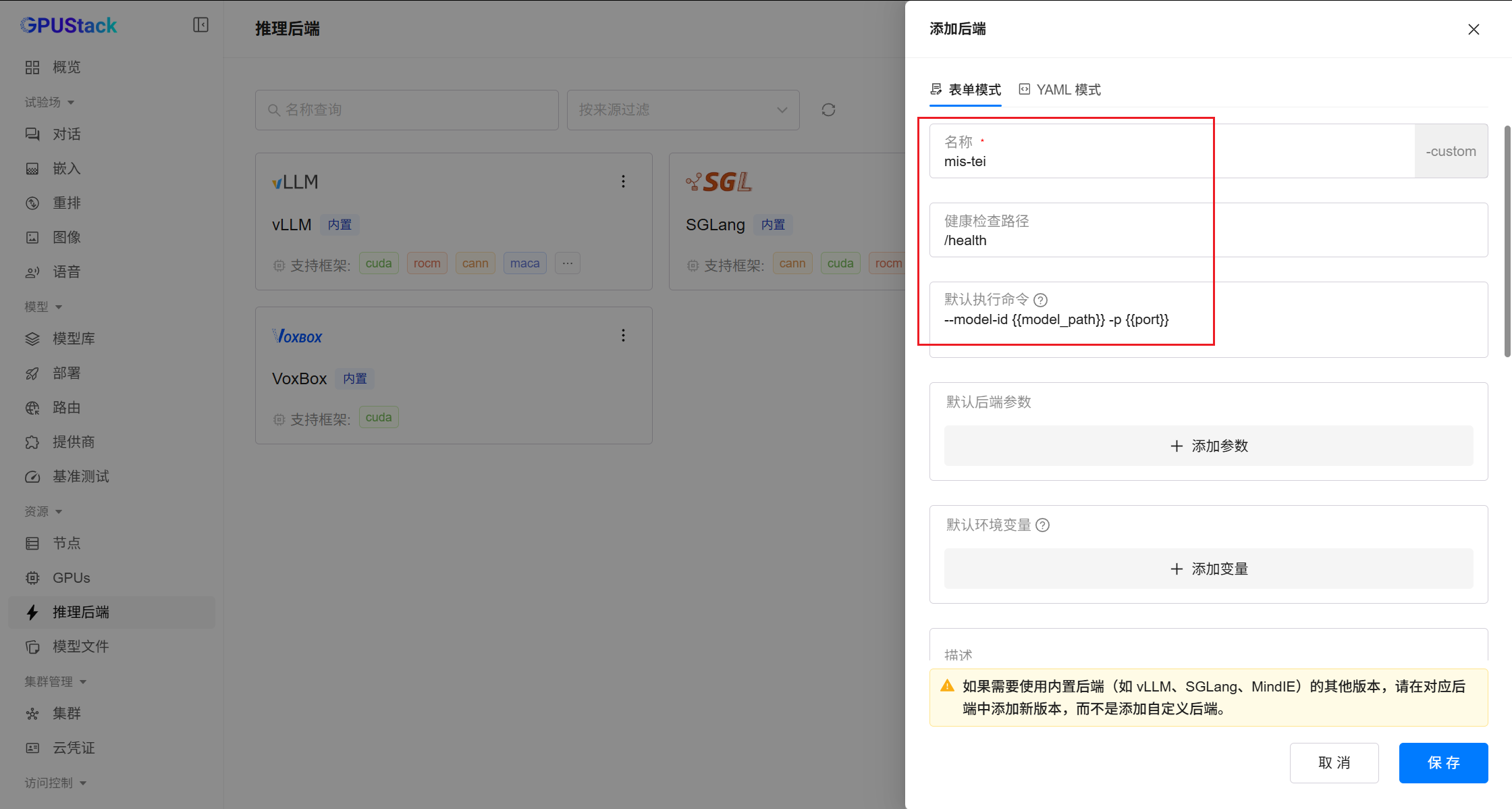

按如下示例填写参数

![]()

![]()

⚠️ 注意:镜像需根据昇腾设备型号选择

| 芯片型号 | 镜像 TAG |

|---|---|

| 800I-A2(910B) | 7.3.0-800I-A2-aarch64 |

| 800I-A3(910C) | 7.3.0-800I-A3-aarch64 |

| 300I-Duo(310P) | 7.3.0-300I-Duo-aarch64 |

YAML 配置(可直接导入)

backend_name: mis-tei-custom

health_check_path: /health

default_run_command: --model-id {{model_path}} -p {{port}}

default_env:

ENABLE_BOOST: "True"

AUTO_TRUNCATE: "true"

version_configs:

7.3.0-a2:

image_name: swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-800I-A2-aarch64

custom_framework: cann

7.3.0-a3:

image_name: swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-800I-A3-aarch64

custom_framework: cann

7.3.0-310p:

image_name: swr.cn-south-1.myhuaweicloud.com/gpustackcommunity/mis-tei:7.3.0-300I-Duo-aarch64

custom_framework: cann

default_version: 7.3.0-a2

⚠️ 注意:从公众号或网页复制 YAML 时,可能会混入不可见字符(如 NBSP),导致解析失败。

建议从 GitHub 原文件中复制:https://github.com/gpustack/community-inference-backends/blob/main/mis-tei/spec.yaml

参数说明

image_name:使用社区重打包镜像custom_framework:指定昇腾 CANN 运行环境default_run_command:统一启动参数模板health_check_path:健康检查接口

完成后,后端添加效果如下:

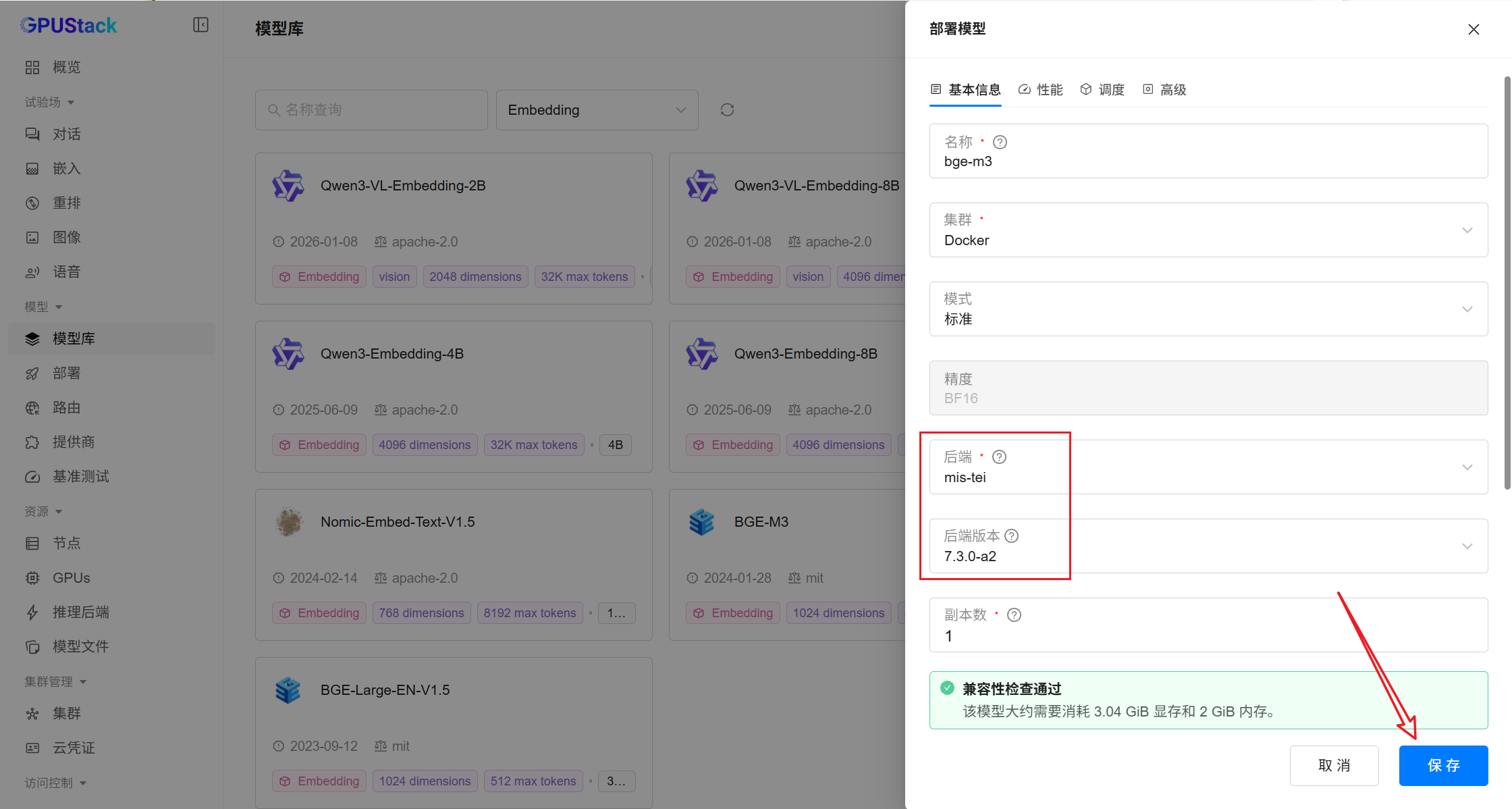

部署模型

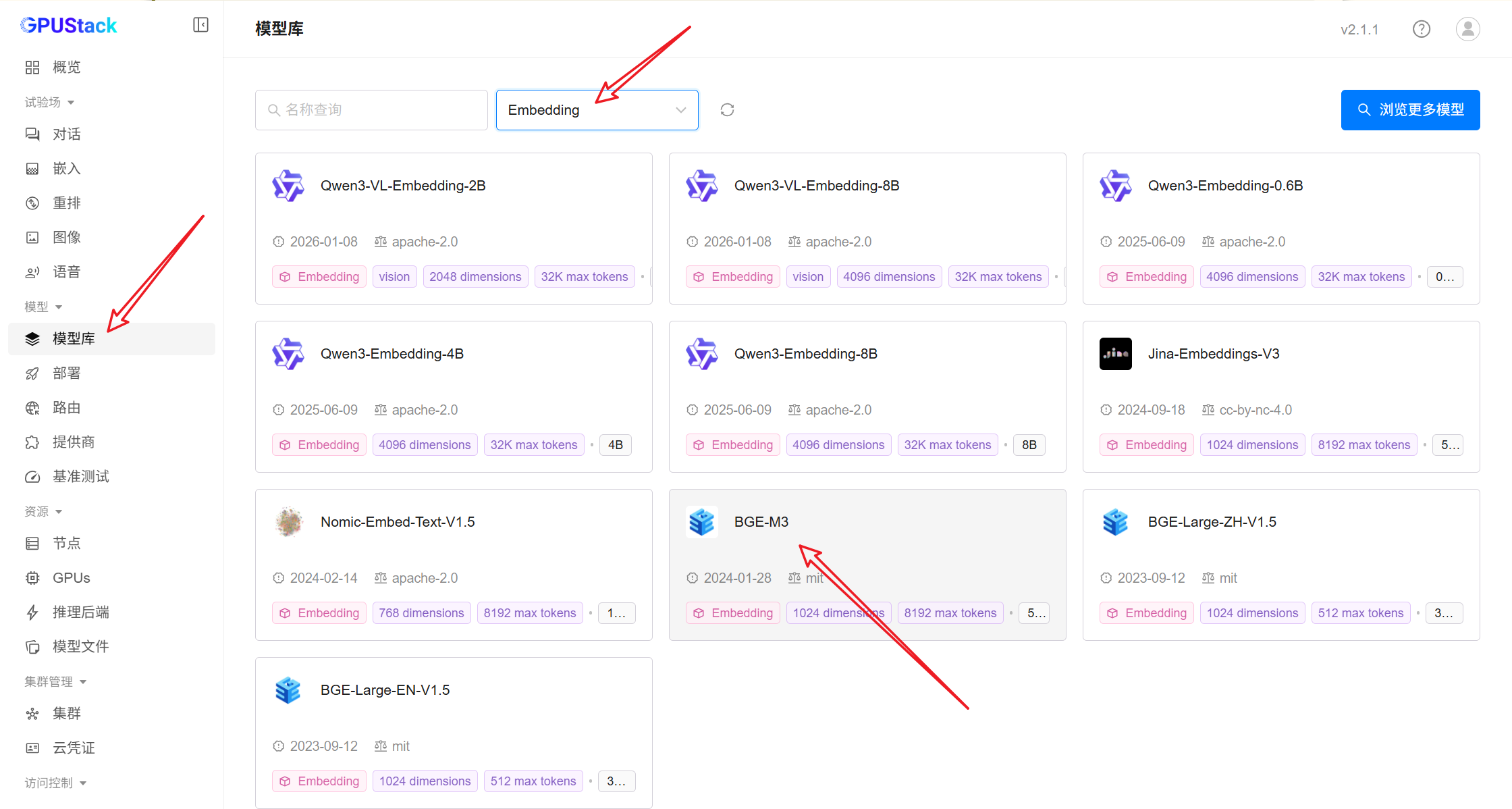

下面以 BGE-M3 嵌入模型为例进行演示:

-

打开模型库,筛选 Embedding 模型

![]()

-

将推理引擎切换为 mis-tei

![]()

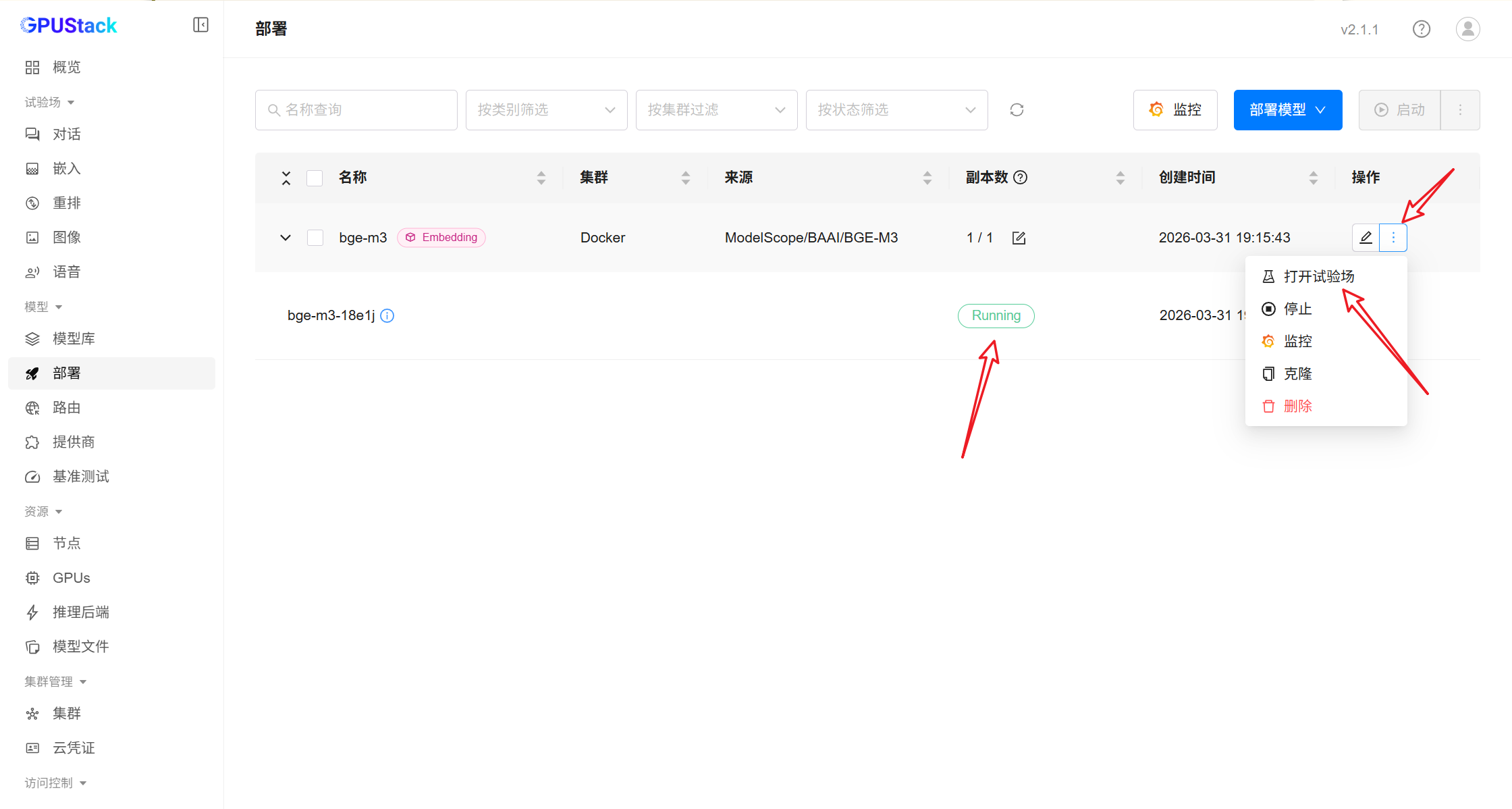

-

点击部署,等待模型状态变为 Running

![]()

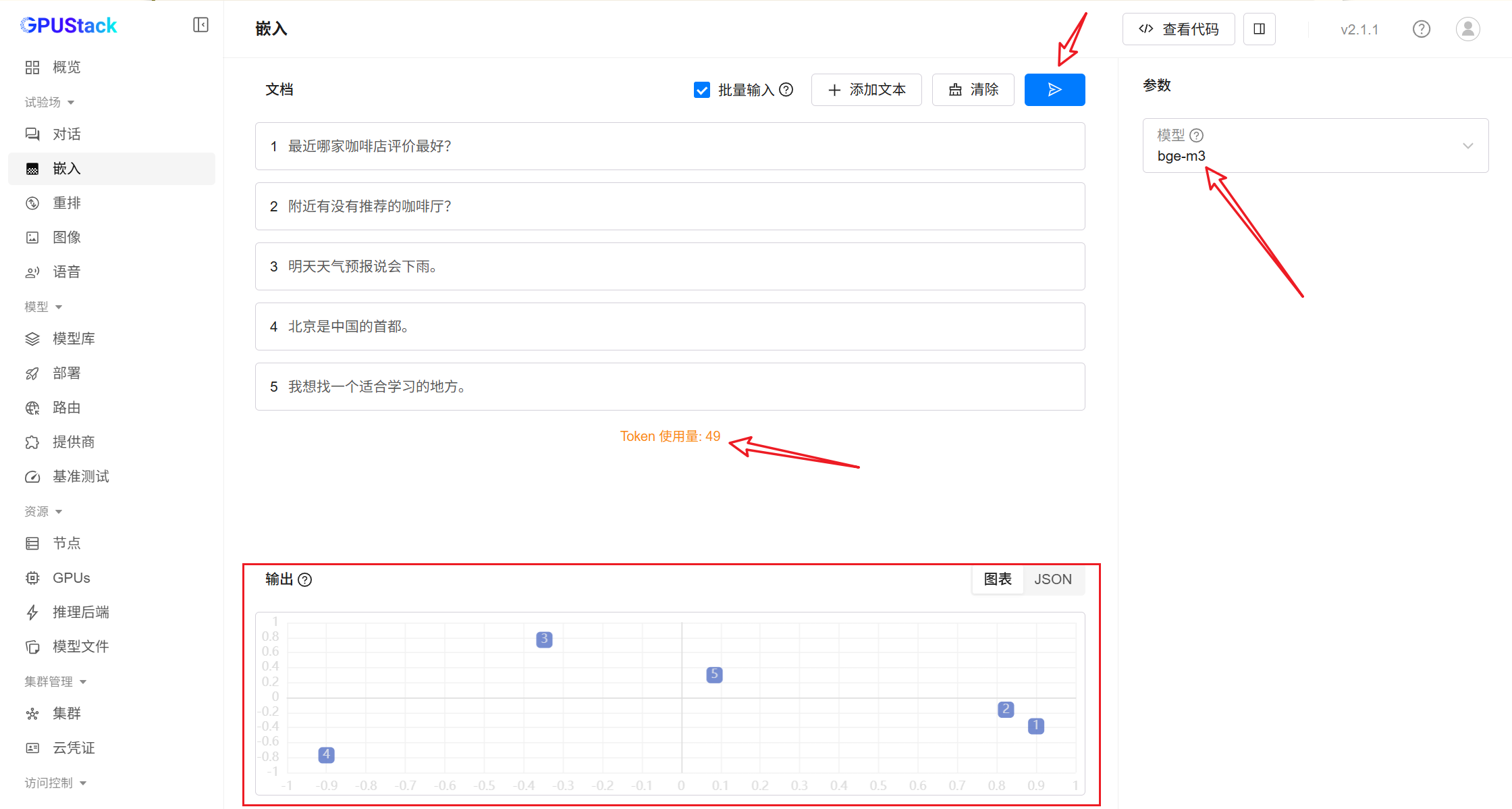

-

打开 试验场 进行测试

![]()

模型支持说明

mis-tei 支持的模型类型及相关参数配置,可参考官方文档:

👉 https://www.hiascend.com/developer/ascendhub/detail/07a016975cc341f3a5ae131f2b52399d

小结

通过对 Ascend 官方 mis-tei 镜像进行重打包与适配,我们在 GPUStack 中实现了更轻量、易用的接入方案:

- 🚀 显著降低部署与配置复杂度

- 📦 提供开箱即用的社区镜像

- 🔧 简化模型服务接入流程

- ⚡ 面向 RAG 场景优化,更好地衔接检索与生成链路

下个版本中,该后端将接入 GPUStack 内置社区后端,用户可直接一键启用。

更多内容

更多社区后端项目,欢迎访问:

👉 https://github.com/gpustack/community-inference-backends

也欢迎大家参与贡献,一起完善 GPUStack 生态 🚀

加入 GPUStack 社区

GPUStack 社区聚焦 AI 基础设施与大模型实践。

社区中持续分享真实环境下的部署经验、问题排查案例,以及推理引擎、算力管理和系统架构相关讨论。

欢迎扫码添加 GPUStack 小助手加入 GPUStack 社区,与更多关注 AI Infra 与大模型推理实践的伙伴一起交流、学习与分享。

若群聊已满或二维码失效,请访问以下页面查看最新群二维码:

https://github.com/gpustack/gpustack/blob/main/docs/assets/wechat-group-qrcode.jpg

浙公网安备 33010602011771号

浙公网安备 33010602011771号