视觉定位作为机器人SLAM系统的核心,一直是开放世界自主导航的关键挑战。

现有方法往往受限于光照、视角变化,或在大规模环境下定位效率低下,难以满足真实城市场景的长期应用需求。近日,Peng Yin等研究者在TRO 2025发表的iLoc系统,创新性地融合Transformer自适应域对齐、球面卷积特征提取与分层快速匹配,一举攻克跨域、跨视角、大规模定位三大难题,在2公里范围仅需0.5秒即可实现1米级高精度定位,效率提升超80%。

题目:iLoc: An Adaptive, Efficient, and Robust Visual Localization System

iLoc:一种自适应、高效且鲁棒的视觉定位系统

作者:Peng Yin, Shiqi Zhao, Jing Wang, Ruohai Ge, Jianmin Ji, Yeping Hu, Huaping Liu, Jianda Han

研究背景:视觉定位的三大核心痛点

现实世界的视觉定位面临三大核心挑战:

- 跨域鲁棒性不足:光照、天气变化会导致图像特征分布偏移,传统方法难以保持稳定的场景描述符;

- 大规模定位效率低:复杂城市场景下,全局重定位的暴力搜索方式耗时严重,无法满足实时性要求;

- 在线跟踪精度差:地点识别易产生异常值,单纯依赖视觉里程计的轨迹易漂移,难以长期稳定。

针对这些问题,研究团队提出iLoc(Adaptive, Efficient, and Robust Visual Localization System),一个集自适应特征提取、快速全局重定位、鲁棒在线跟踪于一体的端到端视觉定位系统,首次实现了复杂环境下“高精度+高效率+高鲁棒”的三维定位突破。

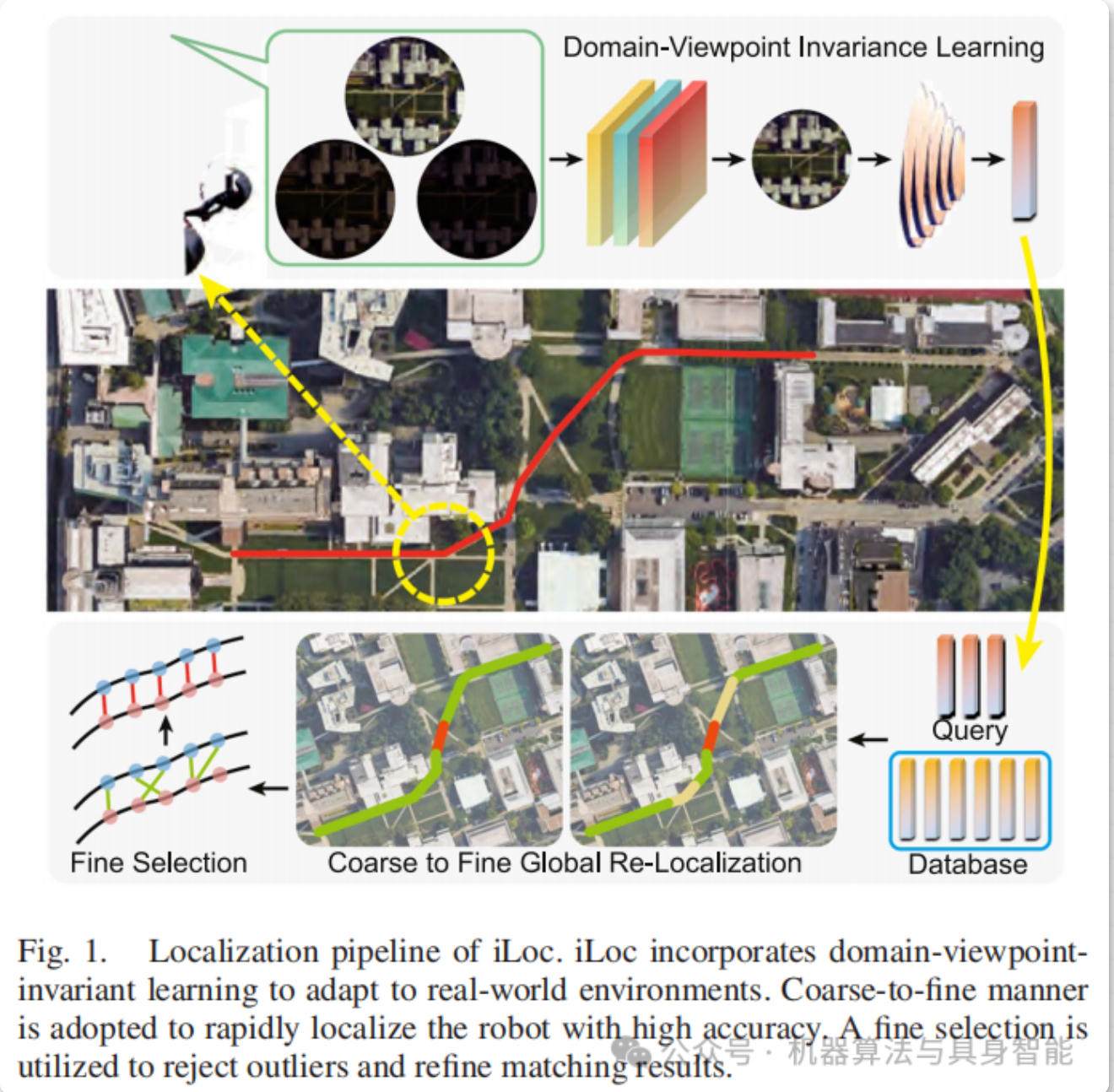

二、iLoc系统核心架构:三大模块构建全流程定位能力Loc的整体架构围绕“自适应特征提取-快速全局匹配-鲁棒在线优化”三大核心模块展开,其系统总体结构如下图所示:

自适应跨域特征提取模块:攻克光照/视角变化难题

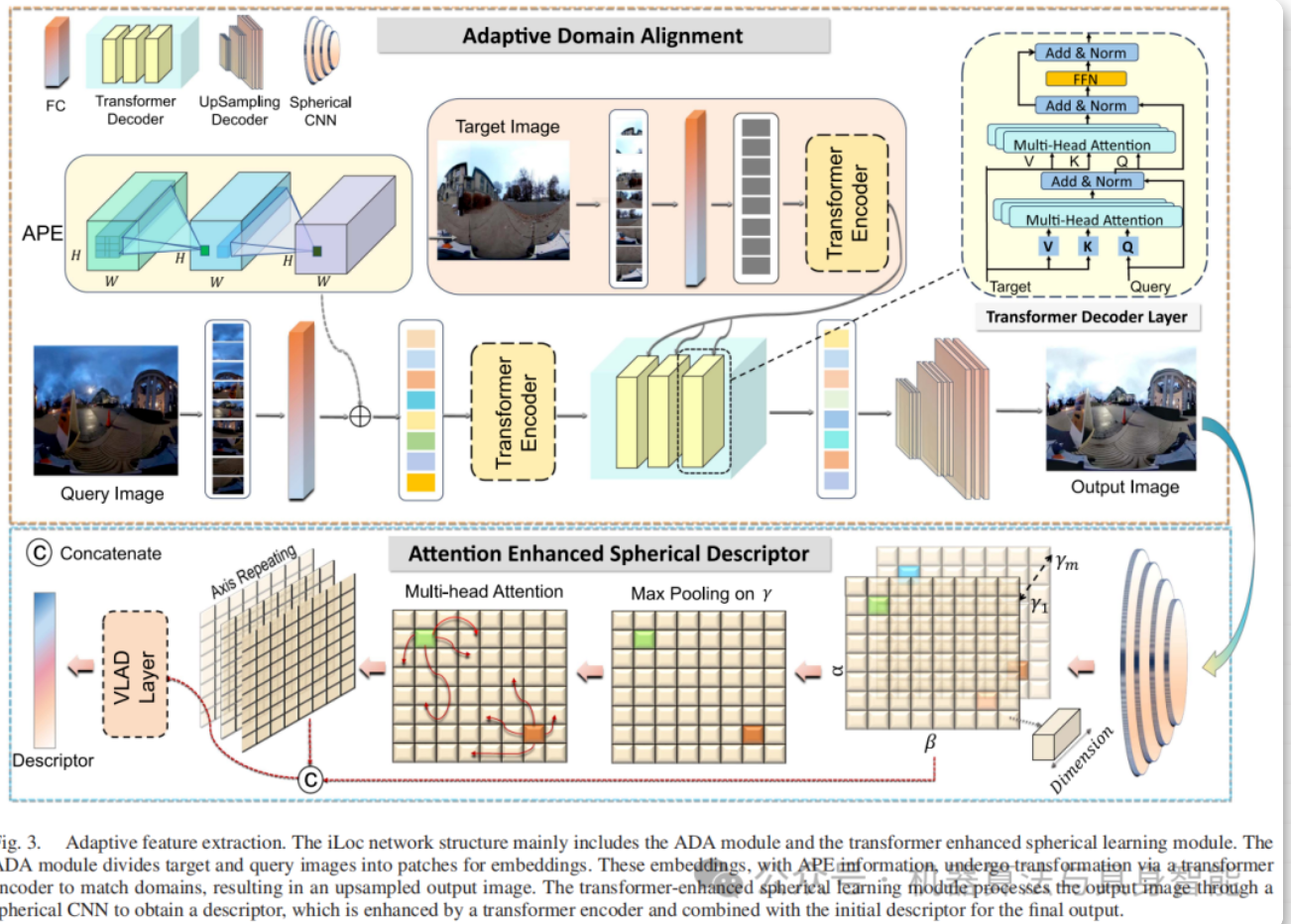

传统特征提取方法难以兼顾跨域对齐与视角不变性,iLoc创新性地集成两大子模块:

- Transformer自适应域对齐(ADA)模块:以最佳光照图像为目标域,通过风格迁移技术对齐不同光照条件下的图像特征。

- 该模块引入自适应位置编码(APE)解决传统位置编码对图像尺寸敏感的问题,结合Transformer编码器-解码器结构,既保留查询图像的纹理细节,又匹配目标域的风格特征,有效消除光照变化带来的特征偏移(如下图所示)。

注意力增强球面特征提取(AESE)模块:针对全景图像的旋转不变性需求,采用球面CNN处理球面数据,克服传统CNN无法保持旋转不变性的缺陷。同时集成Transformer注意力模块捕获长程依赖,通过最大池化筛选关键旋转特征,最终生成的描述符兼具局部细节与全局上下文,完美适配视角变化场景(如下图所示)。

2. 快速分层全局重定位算法:效率提升80%的关键

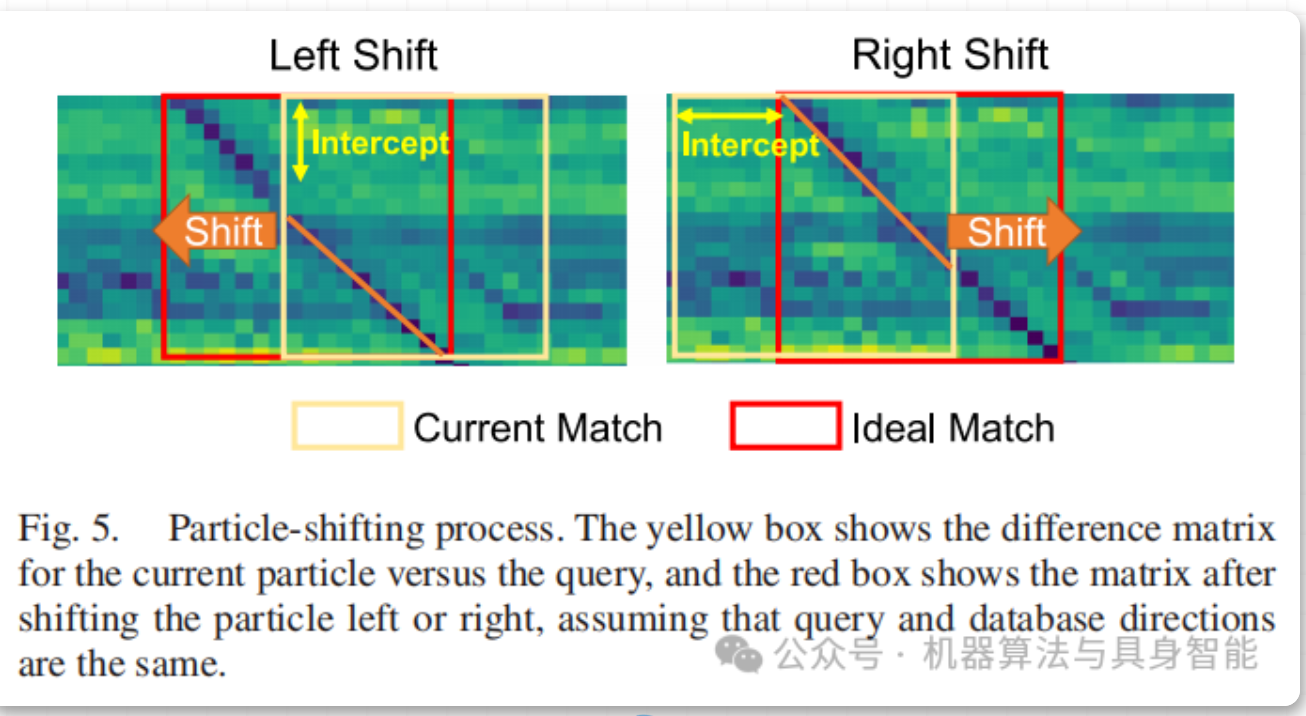

为解决大规模环境下的定位效率问题,iLoc设计由粗到精的快速序列匹配(Fast SeqMatch)算法:

- 粒子初始化:在降采样的地图数据库中分布粒子,每个粒子代表一个候选序列片段,初始权重均等;

- 粒子偏移:基于SeqSLAM生成匹配数组,通过拟合最优直线校正粒子位置,更新粒子权重;

- 粒子合并与分辨率更新:合并相邻粒子并逐步提升分辨率,最终实现精准匹配。

该算法将传统暴力搜索的时间复杂度从O(NT)降至O(3NT/16),在2公里城市场景中仅需0.5秒即可完成全局重定位,效率提升超80%(算法流程如下图)。

全局重定位后,iLoc融合视觉里程计与闭环检测,通过两大策略提升在线跟踪鲁棒性:

- 候选帧精细选择:使用SuperPoint+SuperGlue提取局部特征,结合几何约束过滤异常值(如全景图拼接线附近的错误匹配);

- 位姿图优化(PGO):整合视觉-惯性里程计与回环约束,每行进2米添加一次回环约束,通过GTSAM优化轨迹,确保定位精度与轨迹平滑性。

三、实验验证:多数据集下的性能碾压

研究团队在ALITA校园、KITTI360、谷歌地球、真实城市四大数据集(部分样本如下图)上验证iLoc性能,覆盖多变光照、视角、天气场景。

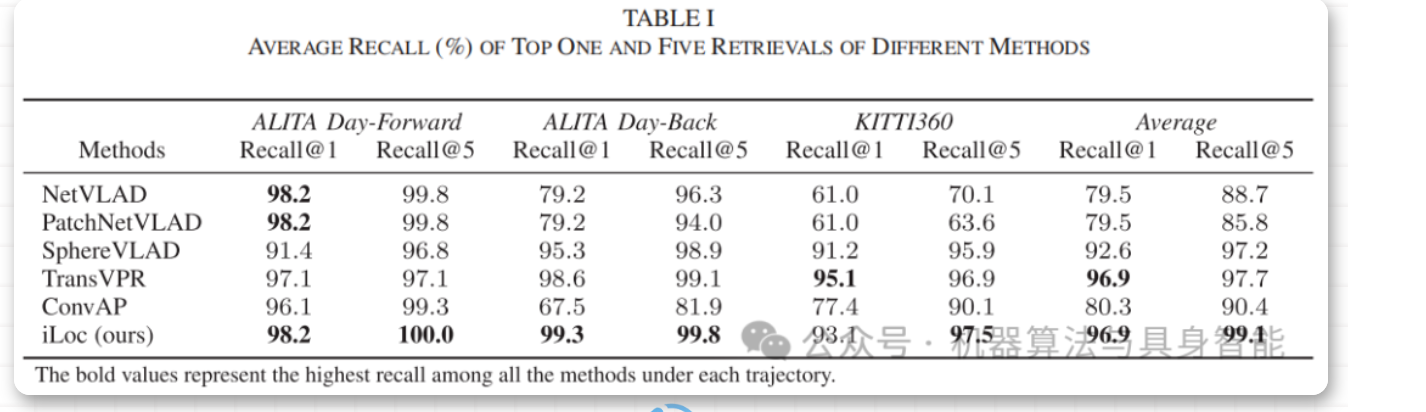

在ALITA数据集的正向/反向视角测试中,iLoc的Recall@N指标显著优于NetVLAD、PatchNetVLAD、ConvAP等经典方法;在KITTI360大规模数据集上,iLoc凭借球面CNN的旋转不变性,视角适应能力远超基于立方体贴图的CNN方法(性能对比如下图)。

2. 效率与精度实测

- 全局重定位:2公里范围定位耗时仅0.5秒,效率较传统SeqSLAM提升80%;

- 定位精度:复杂城市场景下平均定位误差1米,光照/视角变化下精度衰减小于5%;

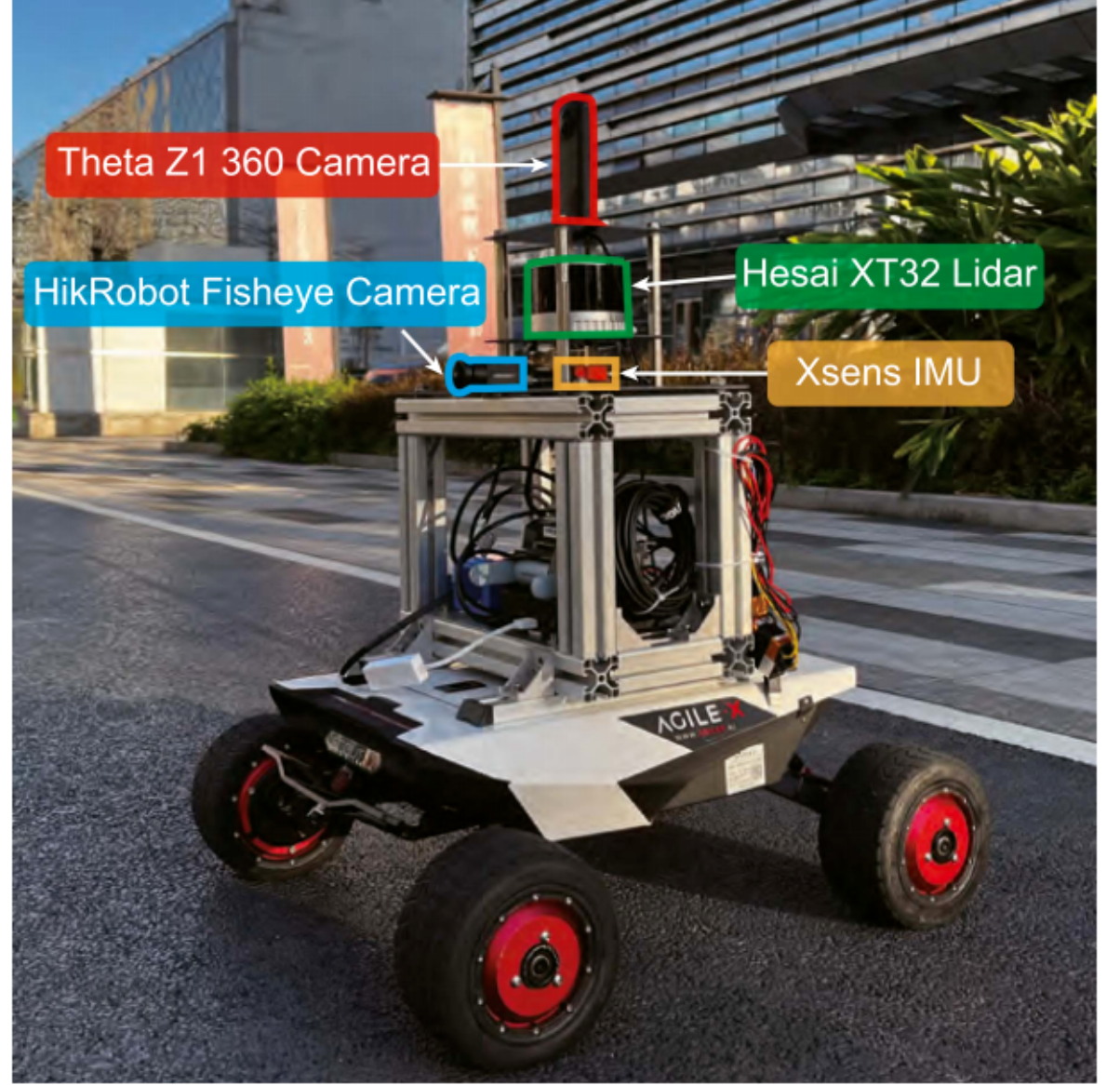

- 在线跟踪:实地测试(硬件平台如下图)显示,连续1小时跟踪轨迹无明显漂移,异常值剔除率超90%。

四、总结与展望

iLoc作为首个融合Transformer自适应域对齐、球面卷积特征提取与分层快速匹配的视觉定位系统,首次实现了“跨域鲁棒+大规模高效+在线精准”的三位一体突破。其核心创新点在于:

- 自适应特征模块解决了光照/视角变化下的特征稳定性问题;

- 分层匹配算法突破了大规模定位的效率瓶颈;

- 鲁棒优化框架保证了真实场景的长期应用可靠性。

该研究不仅为机器人视觉定位提供了新范式,也为自动驾驶、无人机导航等领域的大规模、长周期定位需求提供了可行方案。未来,研究团队将进一步优化硬件部署效率,探索多传感器融合的定位方案,推动iLoc从实验室走向实际应用。

浙公网安备 33010602011771号

浙公网安备 33010602011771号