通道注意力机制

- 卷积操作(总结自这篇帖子)

- 2D convolution using a kernel size of 3, stride of 1 and padding(这是一个常见的组合,kernel_size=3, stride=1, padding=1,输出特征图与输入图像尺寸相等)

- padding确保边界信息不会被完全丢失

- 通道注意力机制

- Squeeze-and-Excitation (SE) 模块

顾名思义,先将每个channel上的特征图压缩(Squeeze)到一个值,这个值反应了这张特征图的全局特征;特征图维度因此变成[B, C, 1, 1, 1],有效维度[B, C],经过全连接层(信息压缩)- 激活函数(非线性变化)- 全连接层(信息扩展),生成channel的注意力权重[B, C, 1, 1, 1];经过sigmoid将每个channel的注意力权重映射到[0, 1]之间,权重与channel上的特征图逐元素乘法,增强(Excitation)重要通道,抑制不重要通道。通过global average pooling汇总了一阶统计信息,两层 Fully-connected layer 捕捉 Cross-channel interaction,广泛应用于ResNet、Inception、DenseNet等网络中。 - Convolutional Block Attention Module (CBAM) 模块

- Global Second-Order Pooling (GSoP) 模块

通道先下采(C'->C),对下采后的C个通道,两两计算协方差,得到协方差矩阵C*C,之后经过fully-connected layer、sigmoid得到注意力权重C',对原始的C'个通道进行激活。相较于SE block,能够更好地反映通道间的关系,是一种二阶注意力机制。 - Lightweight Style-Based Recalibration Module (SRM) 模块

有别于SE block,SRM对每个通道不仅做了全局平均池化,还做了全局标准差池化(to improve its capability to capture global information),池化后的向量concat到一起后经过轻量级的channel-wise fully-connected (CFC) layer(相比于SE的FC layer)、batch normalization layer、sigmoid。 - Gated Channel Transformation (GCT) 模块

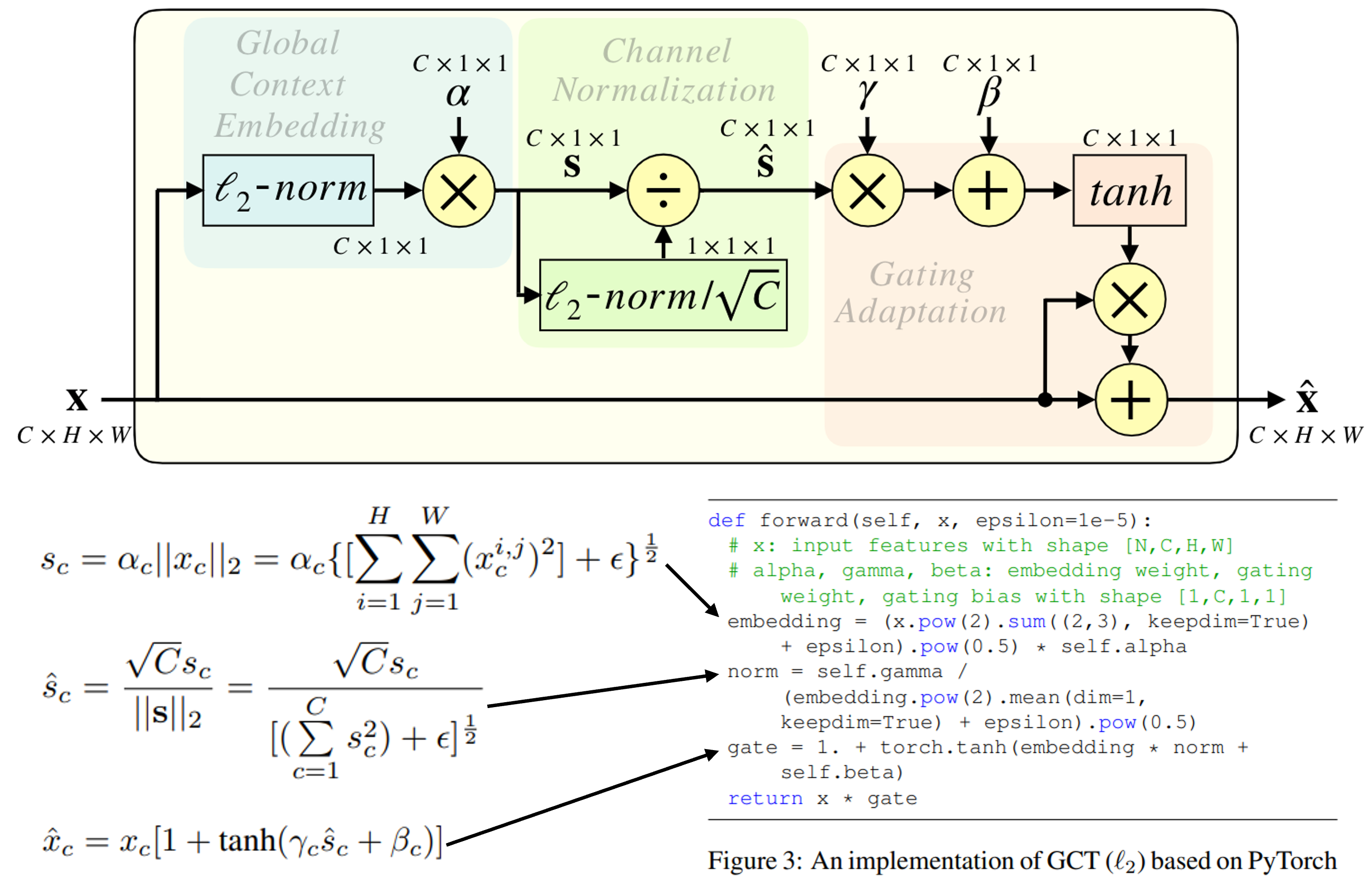

用L2 normalization取代FC:先是对每个channel进行L2正则化,得到的矩阵再乘以α(可训练),结果记为S,同时呢,对S进行L2正则化可以得到一个正则化项,S除以这个正则项实现通道上的normalization,得到\hat{S};接着\hat{S}乘以γ再加上β(γ、β可训练),最后经过Tanh,并加入跳接,将输入与经过通道加权后的输入相加。使用一个归一化模块替换FC,对通道间的特征关系建模;设计了一系列参数,应用gating mechanism(门控机制)对通道间的特征关系建模;跳接保留了关键信息,提升了鲁棒性。 - Efficient Channel Attention (ECA) 模块

- 残差块结构

- 整体架构

- 浅层残差块

- 深层残差块——瓶颈残差块(Bottleneck Block)

- ResNeXt中的分组卷积思想(grouped convolution)

参考资料

[1] Squeeze-and-Excitation Networks

[2] 计算机视觉注意力网络(三)——CBAM [ECCV 2018]

[3] Understanding Attention Modules: CBAM and BAM — A Quick Read

[4] Channel Attention Mechanisms in Deep Learning for Geospatial Tasks (Part 2)

[5] Attention Mechanism: Channel Attention Implementation in CNNs Using Tensorflow Deep Learning

[6] 计算机视觉注意力网络(四)——GSoP-Net [CVPR 2019]

[7] SRM : A Style-based Recalibration Module for Convolutional Neural Networks论文笔记

[8] What is: style-based recalibration module?

[9] 【CVPR2020】Gated Channel Transformation for Visual Recognition

[10] Gated Channel Transformation for Visual Recognition

[11] 論文閱讀 CVPR 2020 — ECA-Net: Efficient Channel Attention for Deep Convolutional Neural Networks

浙公网安备 33010602011771号

浙公网安备 33010602011771号