摘要:  1. 什么是DPO? DPO(Direct Preference Optimization)是一种用于对齐大语言模型(LLMs)的新型方法,旨在高效地将人类偏好融入模型训练中。它提供了一种替代强化学习(如 RLHF, Reinforcement Learning with Human Feedbac 阅读全文

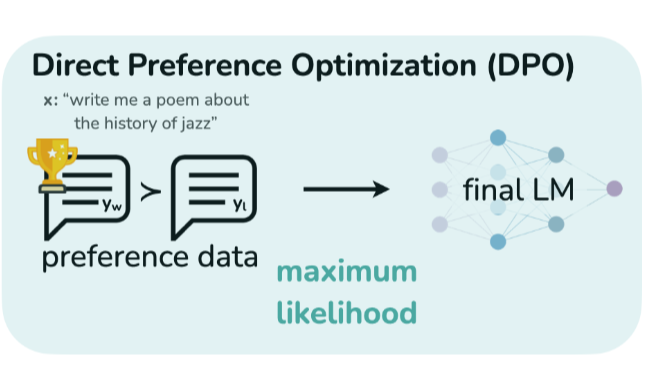

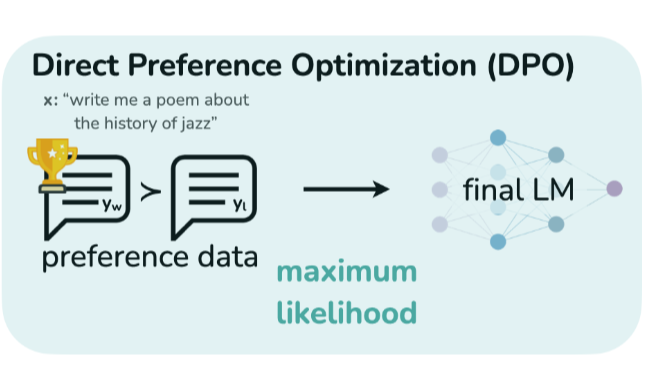

1. 什么是DPO? DPO(Direct Preference Optimization)是一种用于对齐大语言模型(LLMs)的新型方法,旨在高效地将人类偏好融入模型训练中。它提供了一种替代强化学习(如 RLHF, Reinforcement Learning with Human Feedbac 阅读全文

1. 什么是DPO? DPO(Direct Preference Optimization)是一种用于对齐大语言模型(LLMs)的新型方法,旨在高效地将人类偏好融入模型训练中。它提供了一种替代强化学习(如 RLHF, Reinforcement Learning with Human Feedbac 阅读全文

1. 什么是DPO? DPO(Direct Preference Optimization)是一种用于对齐大语言模型(LLMs)的新型方法,旨在高效地将人类偏好融入模型训练中。它提供了一种替代强化学习(如 RLHF, Reinforcement Learning with Human Feedbac 阅读全文

posted @ 2025-03-28 22:26

[X_O]

阅读(2935)

评论(1)

推荐(1)

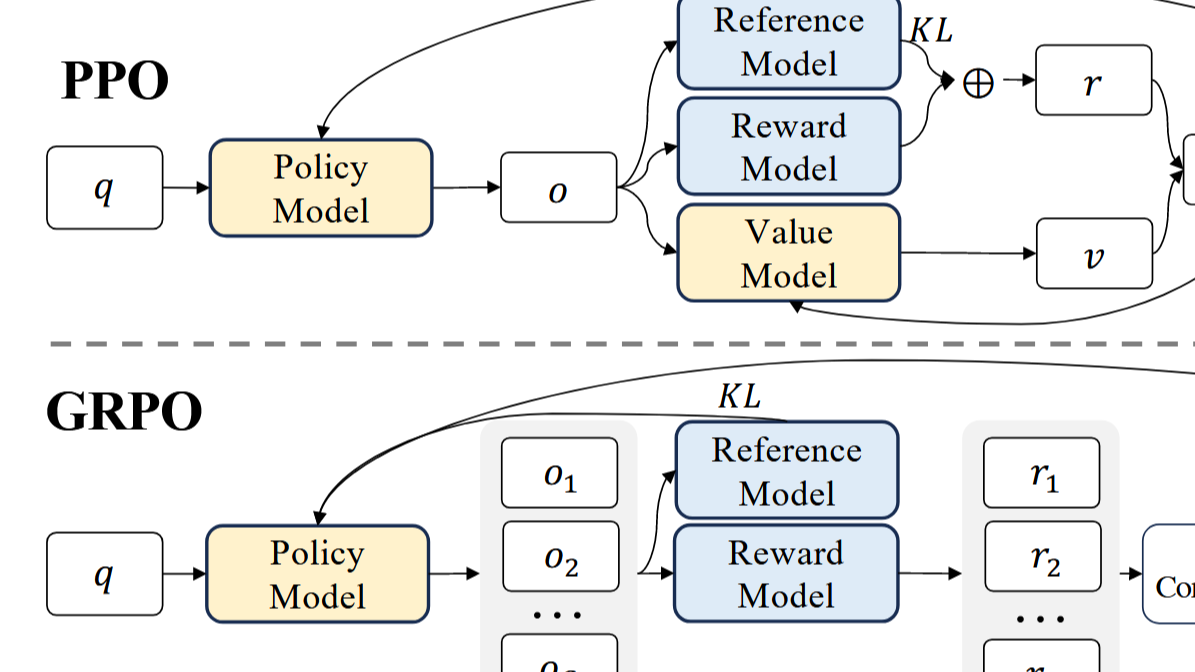

GRPO详解 GRPO算法是在PPO算法的基础上进化而来的,在搞清楚GRPO算法前,需要先了解PPO算法是如何在LLM的Post Training中应用的。 本文主要参考DeepSeekMath: Pushing the Limits of Mathematical Reasoning in Ope

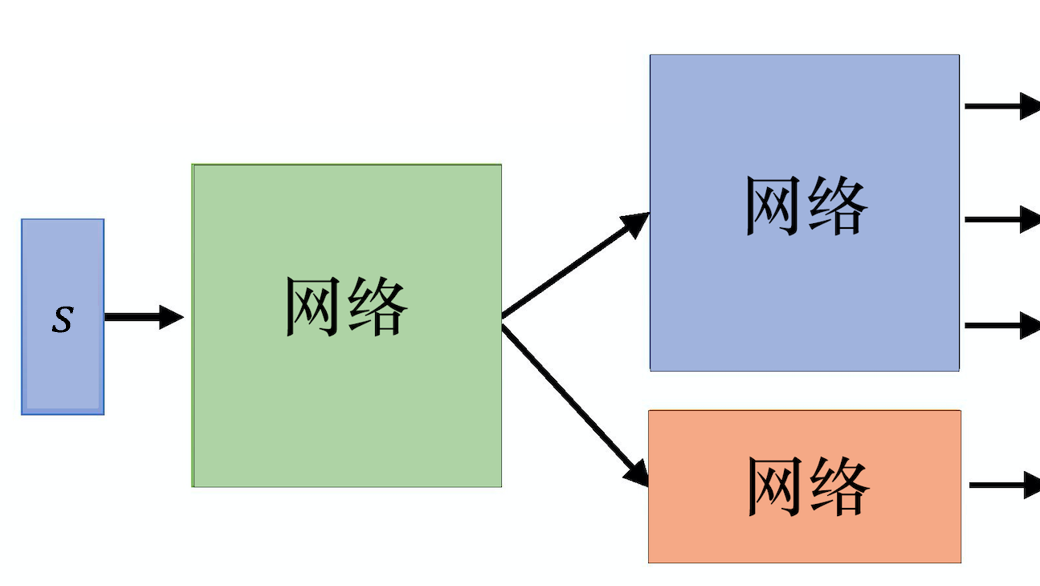

GRPO详解 GRPO算法是在PPO算法的基础上进化而来的,在搞清楚GRPO算法前,需要先了解PPO算法是如何在LLM的Post Training中应用的。 本文主要参考DeepSeekMath: Pushing the Limits of Mathematical Reasoning in Ope  本笔记有大量参考蘑菇书EasyRL https://datawhalechina.github.io/easy-rl/#/ 包括其配图和部分文本。 1. 基本概念 1.1 基本流程 强化学习是一种学习框架,其中智能体(Agent) 通过与 环境(Environment) 的交互,在每一步从环境中接收

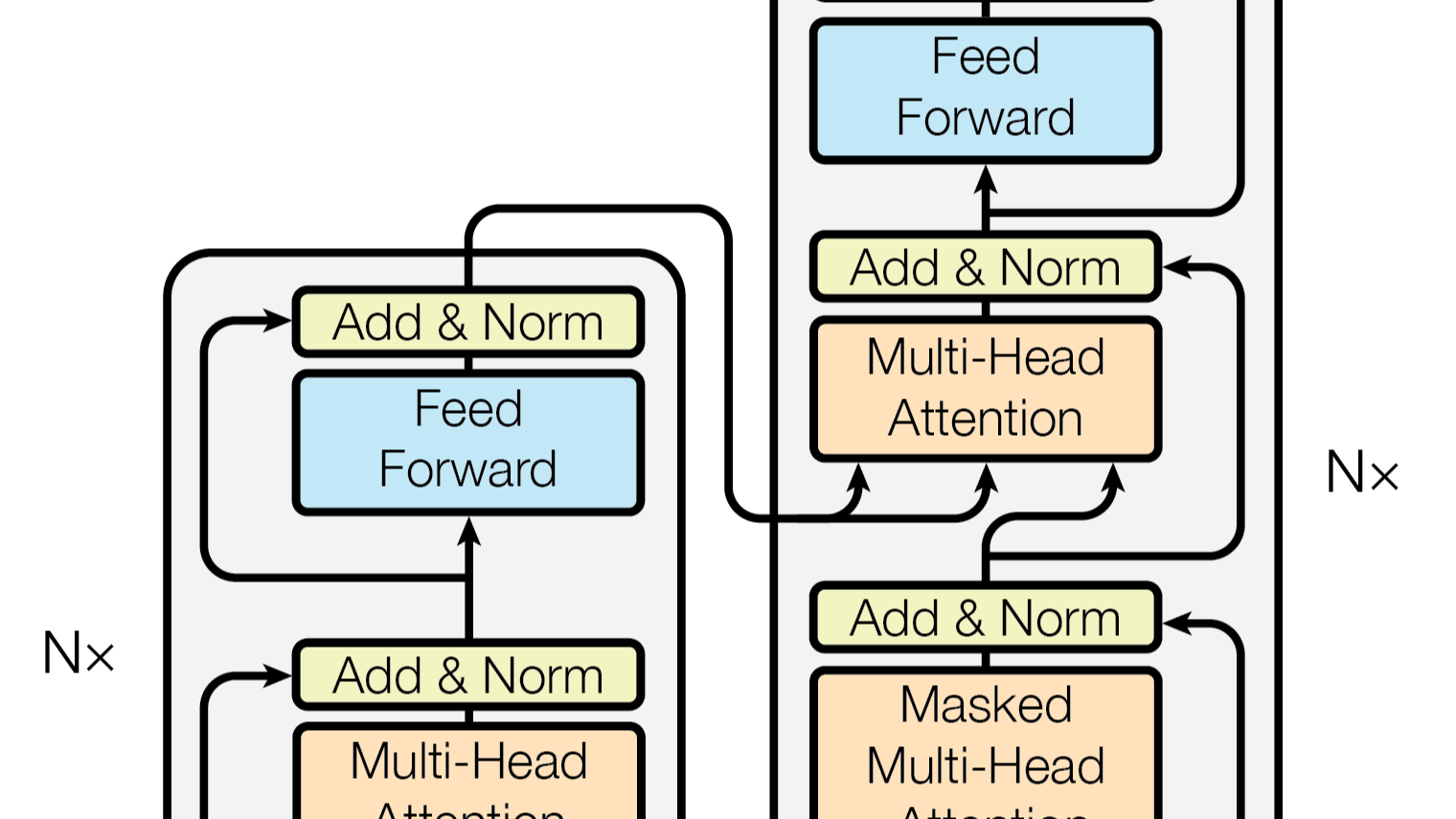

本笔记有大量参考蘑菇书EasyRL https://datawhalechina.github.io/easy-rl/#/ 包括其配图和部分文本。 1. 基本概念 1.1 基本流程 强化学习是一种学习框架,其中智能体(Agent) 通过与 环境(Environment) 的交互,在每一步从环境中接收  在学习Transformer这个模型前对seq2seq架构有个了解时很有必要的 先上图 输入和输出 首先理解模型时第一眼应该理解输入和输出最开始我就非常纠结 有一个Inputs,一个Outputs(shift right)和一个Output Probabilities,首先需要借助这三个输入/输出来

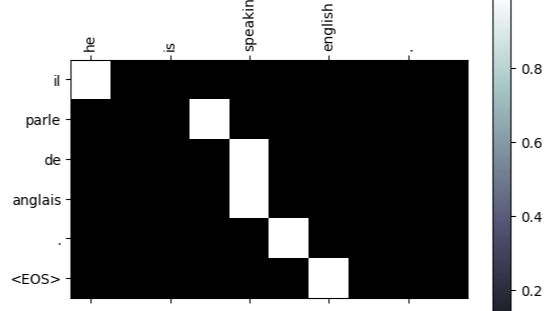

在学习Transformer这个模型前对seq2seq架构有个了解时很有必要的 先上图 输入和输出 首先理解模型时第一眼应该理解输入和输出最开始我就非常纠结 有一个Inputs,一个Outputs(shift right)和一个Output Probabilities,首先需要借助这三个输入/输出来  模型架构 先上图 我们这里选用GRU来实现该任务,因此上图的十个方框框都是GRU块,如第二张图,放第一张图主要是强调编码器的输出是作用在解码器每一次输入的观点,具体的详细流程图将在代码实现部分给出。 编码阶段 1. 准备工作 要用到的数据集点此下载,备用地址,点击下载 导入相关的库和编写字符处理的函

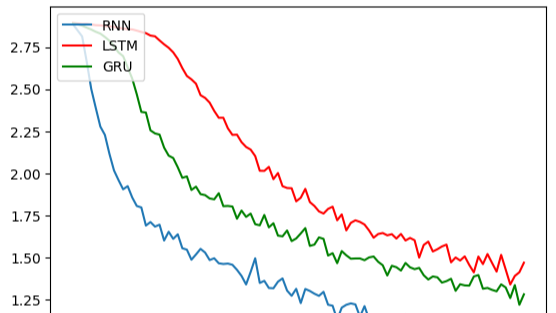

模型架构 先上图 我们这里选用GRU来实现该任务,因此上图的十个方框框都是GRU块,如第二张图,放第一张图主要是强调编码器的输出是作用在解码器每一次输入的观点,具体的详细流程图将在代码实现部分给出。 编码阶段 1. 准备工作 要用到的数据集点此下载,备用地址,点击下载 导入相关的库和编写字符处理的函  传统RNN网络及其案例--人名分类 传统的RNN模型简介 RNN 先上图 这图看起来莫名其妙,想拿着跟CNN对比着学第一眼看上去有点摸不着头脑,其实我们可以把每一个时刻的图展开来,如下 其中,为了简化计算,我们默认每一个隐层参数相同,这样看来RNN的结构就比较简单了,相比较CNN来说,RNN引入了更

传统RNN网络及其案例--人名分类 传统的RNN模型简介 RNN 先上图 这图看起来莫名其妙,想拿着跟CNN对比着学第一眼看上去有点摸不着头脑,其实我们可以把每一个时刻的图展开来,如下 其中,为了简化计算,我们默认每一个隐层参数相同,这样看来RNN的结构就比较简单了,相比较CNN来说,RNN引入了更  浙公网安备 33010602011771号

浙公网安备 33010602011771号