7.Spark SQL

1 分析SparkSQL出现的原因,并简述SparkSQL的起源与发展。

Spark SQL是Spark用来处理结构化数据的一个模块,它提供了一个叫作Data Frame的编程抽象结构数据模型(即带有Schema信息的RDD),Spark SQL作为分布式SQL查询引擎,让用户可以通过SQL、DataFrame API和Dataset API三种方式实现对结构化数据的处理。但无论是哪种API或者是编程语言,都是基于同样的执行引擎,因此可以在不同的API之间随意切换。

Spark SQL的前身是 Shark,Shark最初是美国加州大学伯克利分校的实验室开发的Spark生态系统的组件之一,它运行在Spark系统之上,Shark重用了Hive的工作机制,并直接继承了Hive的各个组件, Shark将SQL语句的转换从MapReduce作业替换成了Spark作业,虽然这样提高了计算效率,但由于 Shark过于依赖Hive,因此在版本迭代时很难添加新的优化策略,从而限制了Spak的发展,在2014年,伯克利实验室停止了对Shark的维护,转向Spark SQL的开发。

2 简述RDD 和DataFrame的联系与区别。

RDD:

分布式的java对象的集合

Spark框架本身不了解内部结构

转换操作

行动操作

面向对象的编程风格

DataFram能做的事情RDD都能做,RDD能做的事情DataFrame不一定能做

DataFrame:

分布式的Row对象的集合

DataFrame带有schema元信息.

Spark SQL清楚地知道该数据集中包含哪些列,每列的名称和类型。

新的操作数据的方法

SQL

提升执行效率、减少数据读取以及执行计划的优化

3 PySpark-DataFrame创建和保存

创建people.txt文件和people.json文件

vim people.json

# 文件内容

{"name":"Michael"}

{"name":"Andy", "age":30}

{"name":"Justin", "age":19}

vim people.txt

# 文件内容

Michael, 29

Andy, 30

Justin, 19

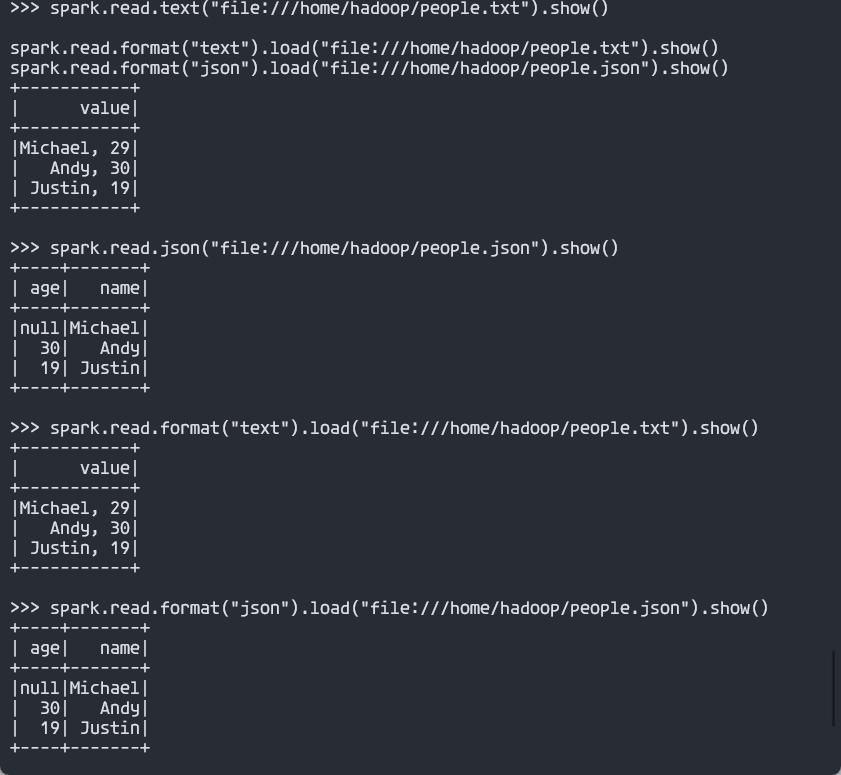

DataFrame创建

spark.read.text("file:///home/hadoop/people.txt").show()

spark.read.json("file:///home/hadoop/people.json").show()

spark.read.format("text").load("file:///home/hadoop/people.txt").show()

spark.read.format("json").load("file:///home/hadoop/people.json").show()

观察从不同类型文件创建DataFrame有什么异同?

txt文件:创建的DataFrame数据没有结构

json文件:创建的DataFrame数据有结构

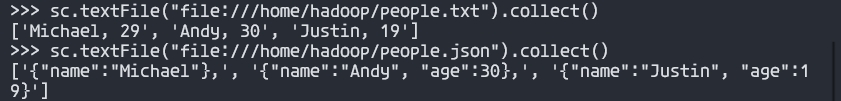

同时创建RDD

sc.textFile("file:///home/hadoop/people.txt").collect()

sc.textFile("file:///home/hadoop/people.json").collect()

区别:

DataFrame可以看作是分布式的Row对象的集合,在二维表数据集的每一列都带有名称和类型,这就是Schema元信息,这使得Spark框架可以获取更多的数据结构信息,从而对在DataFrame背后的数据源以及作用于DataFrame之上数据变换进行了针对性的优化,最终达到大幅提升计算效率。

RDD是分布式的Java对象的集合,例如图4-3中的RDD[Person]数据集,虽然它以Person为类型参数,但是对象内部之间的结构相对于Spark框架本身是无法得知的,这样在转换数据形式时效率相对较低。

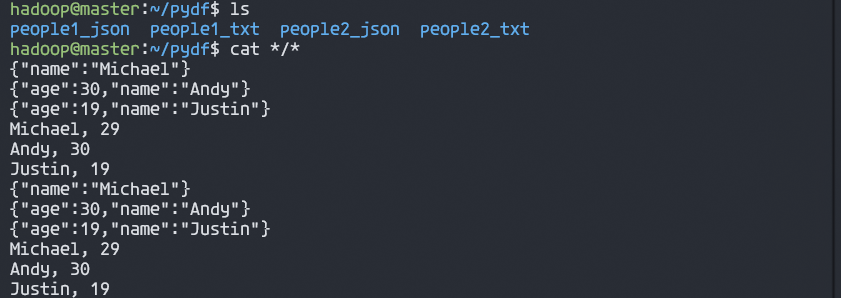

DataFrame保存

txtdf = spark.read.text("file:///home/hadoop/people.txt")

jsondf = spark.read.json("file:///home/hadoop/people.json")

txtdf.write.text("file:///home/hadoop/pydf/people1_txt")

jsondf.write.json("file:///home/hadoop/pydf/people1_json")

txtdf.write.format("text").save("file:///home/hadoop/pydf/people2_txt")

jsondf.write.format("json").save("file:///home/hadoop/pydf/people2_json")

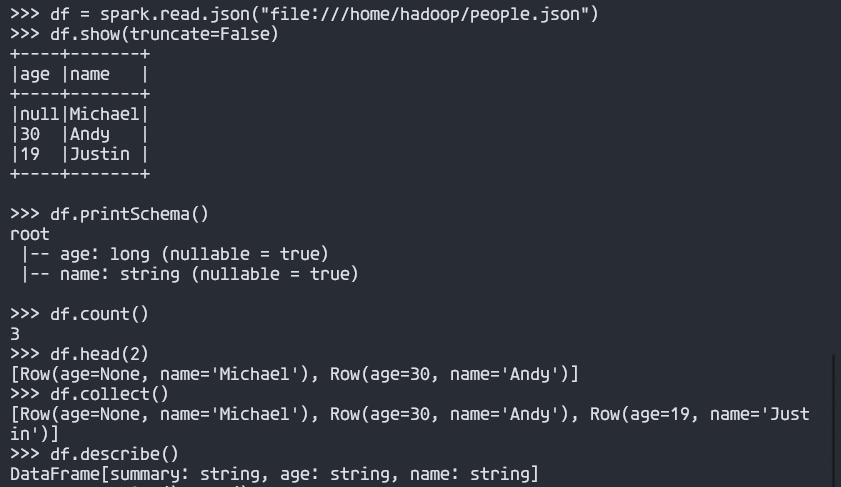

4. PySpark-DataFrame各种常用操作

基于df的操作:

打印数据 df.show()默认打印前20条数据

打印概要 df.printSchema()

查询总行数 df.count()

df.head(3) #list类型,list中每个元素是Row类

输出全部行 df.collect() #list类型,list中每个元素是Row类

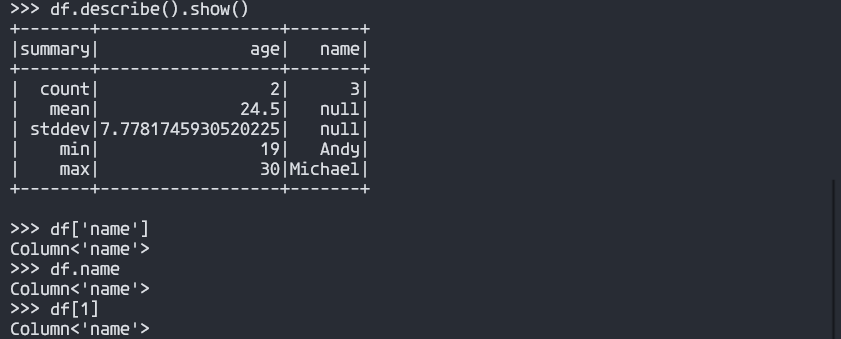

查询概况 df.describe().show()

取列 df[‘name’], df.name, df[1]

df = spark.read.json("file:///home/hadoop/people.json")

df.show(truncate=False)

df.printSchema()

df.count()

df.head(2)

df.collect()

df.describe()

df.describe().show()

df['name']

df.name

df[1]

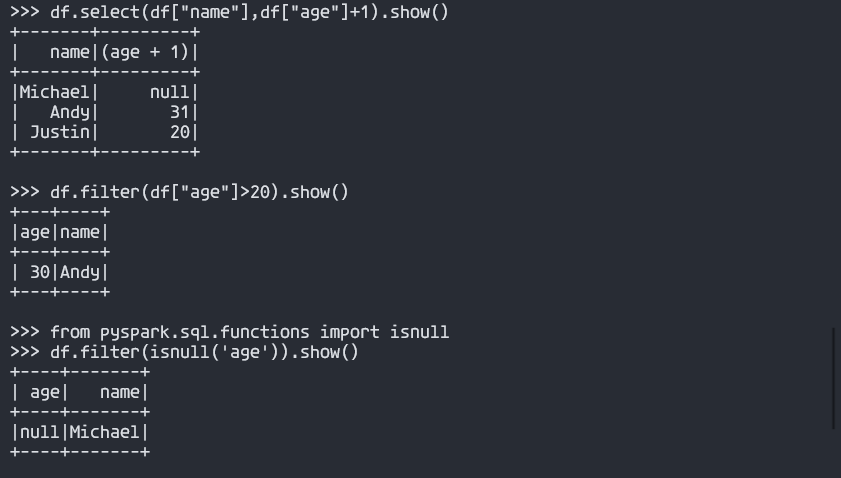

选择 df.select() 每个人的年龄+1

筛选 df.filter() 20岁以上的人员信息

筛选年龄为空的人员信息

分组df.groupBy() 统计每个年龄的人数

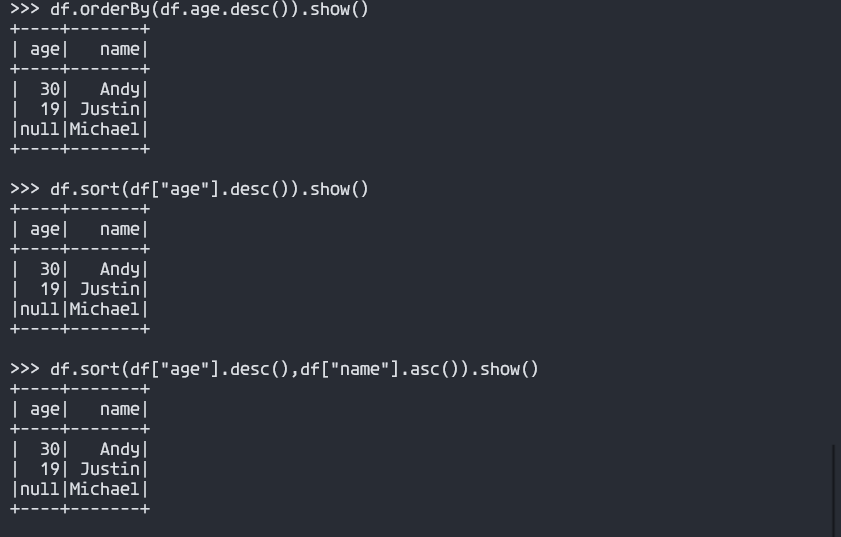

排序df.sortBy() 按年龄进行排序

df.select(df["name"],df["age"]+1).show()

df.filter(df["age"]>20).show()

from pyspark.sql.functions import isnull

df.filter(isnull('age')).show()

df.groupBy("age").count().show()

df.orderBy(df.age.desc()).show()

df.sort(df["age"].desc()).show()

df.sort(df["age"].desc(),df["name"].asc()).show()

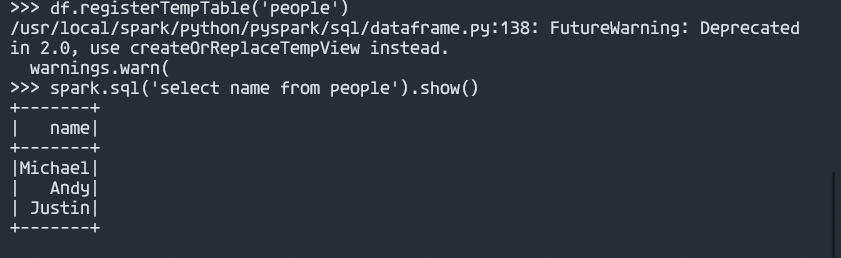

基于spark.sql的操作:

创建临时表虚拟表 df.registerTempTable('people')

spark.sql执行SQL语句 spark.sql('select name from people').show()

df.registerTempTable('people')

spark.sql('select name from people').show()

5. Pyspark中DataFrame与pandas中DataFrame

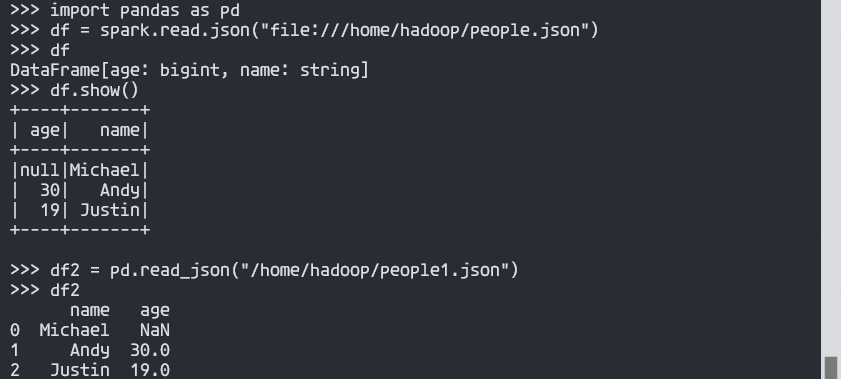

分别从文件创建DataFrame

比较两者的异同

pandas中DataFrame转换为Pyspark中DataFrame

Pyspark中DataFrame转换为pandas中DataFrame

import pandas as pd

df = spark.read.json("file:///home/hadoop/people.json")

df

df.show()

df2 = pd.read_json("/home/hadoop/people1.json")

df2

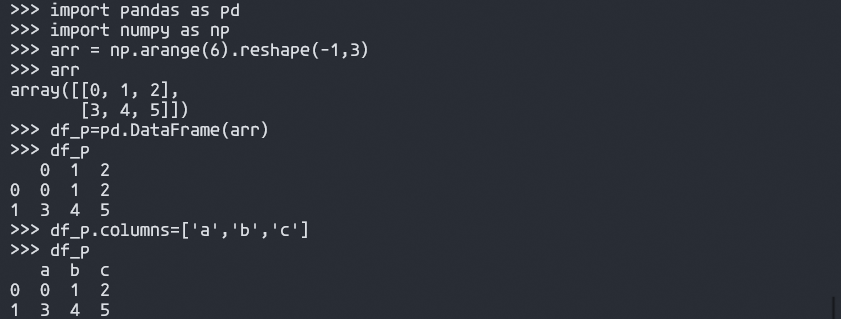

import pandas as pd

import numpy as np

arr = np.arange(6).reshape(-1,3)

arr

df_p=pd.DataFrame(arr)

df_p

df_p.columns=['a','b','c']

df_p

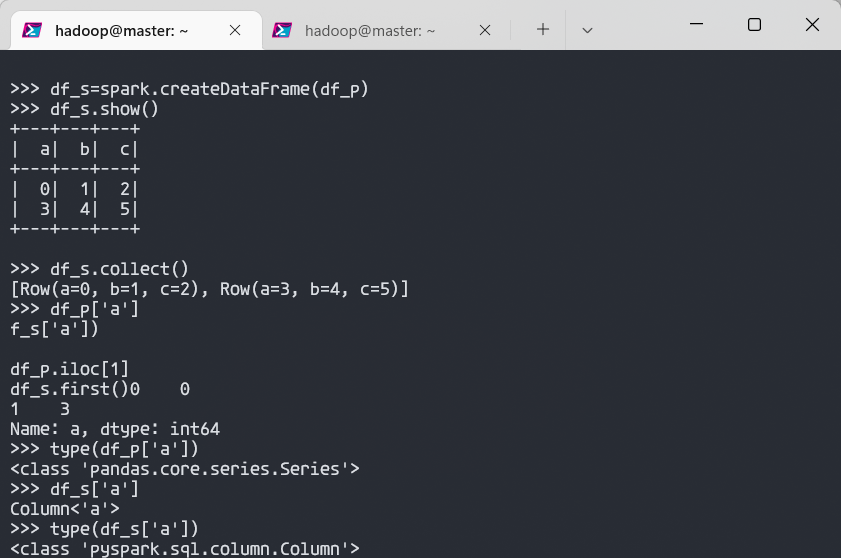

df_s=spark.createDataFrame(df_p)

df_s.show()

df_s.collect()

df_p['a']

type(df_p['a'])

df_s['a']

type(df_s['a'])

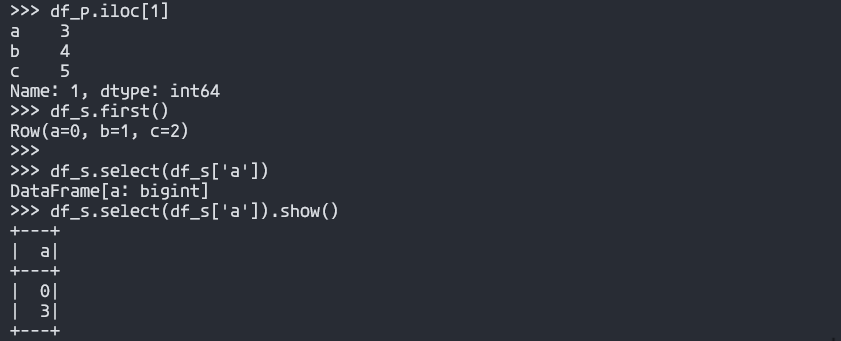

df_p.iloc[1]

df_s.first()

df_s.select(df_s['a'])

df_s.select(df_s['a']).show()

df.show()

df.toPandas()

6.从RDD转换得到DataFrame

6.1 利用反射机制推断RDD模式

创建RDD sc.textFile(url).map(),读文件,分割数据项

每个RDD元素转换成 Row

由Row-RDD转换到DataFrame

from pyspark.sql import Row

people = spark.sparkContext.textFile("file:///usr/local/spark/examples/src/main/resources/people.txt").map(lambda line: line.split(",")).map(lambda p: Row(name=p[0], age=int(p[1])))

schemaPeople = spark.createDataFrame(people)

#必须注册为临时表才能供下面的查询使用

schemaPeople.createOrReplaceTempView("people")

personsDF = spark.sql("select name,age from people where age > 20")

#DataFrame中的每个元素都是一行记录,包含name和age两个字段,分别用p.name和p.age来获取值

personsRDD=personsDF.rdd.map(lambda p:"Name: "+p.name+ ","+"Age: "+str(p.age))

personsRDD.foreach(print)

6.2 使用编程方式定义RDD模式

生成“表头”

生成“表中的记录”

把“表头”和“表中的记录”拼装在一起

from pyspark.sql.types import *

from pyspark.sql import Row

#下面生成“表头”

schemaString = "name age"

fields = [StructField(field_name, StringType(), True) for field_name in schemaString.split(" ")]

schema = StructType(fields)

#下面生成“表中的记录”

lines = spark.sparkContext.textFile("file:///usr/local/spark/examples/src/main/resources/people.txt")

parts = lines.map(lambda x: x.split(","))

people = parts.map(lambda p: Row(p[0], p[1].strip()))

#下面把“表头”和“表中的记录”拼装在一起

schemaPeople = spark.createDataFrame(people, schema)

4.选择题:

-

1单选(2分)关于Shark,下面描述正确的是:C

A.Shark提供了类似Pig的功能

B.Shark把SQL语句转换成MapReduce作业

C.Shark重用了Hive中的HiveQL解析、逻辑执行计划翻译、执行计划优化等逻辑

D.Shark的性能比Hive差很多 -

2单选(2分)下面关于Spark SQL架构的描述错误的是:D

A.在Shark原有的架构上重写了逻辑执行计划的优化部分,解决了Shark存在的问题

B.Spark SQL在Hive兼容层面仅依赖HiveQL解析和Hive元数据

C.Spark SQL执行计划生成和优化都由Catalyst(函数式关系查询优化框架)负责

D.Spark SQL执行计划生成和优化需要依赖Hive来完成 -

3单选(2分)要把一个DataFrame保存到people.json文件中,下面语句哪个是正确的:A

A.df.write.json("people.json")

B.df.json("people.json")

C.df.write.format("csv").save("people.json")

D.df.write.csv("people.json") -

4多选(3分)Shark的设计导致了两个问题:AC

A.执行计划优化完全依赖于Hive,不方便添加新的优化策略

B.执行计划优化不依赖于Hive,方便添加新的优化策略

C.Spark是线程级并行,而MapReduce是进程级并行,因此,Spark在兼容Hive的实现上存在线程安全问题,导致Shark不得不使用另外一套独立维护的、打了补丁的Hive源码分支

D.Spark是进程级并行,而MapReduce是线程级并行,因此,Spark在兼容Hive的实现上存在线程安全问题,导致Shark不得不使用另外一套独立维护的、打了补丁的Hive源码分支 -

5 多选(3分)下面关于为什么推出Spark SQL的原因的描述正确的是:AB

A.Spark SQL可以提供DataFrame API,可以对内部和外部各种数据源执行各种关系操作

B.可以支持大量的数据源和数据分析算法,组合使用Spark SQL和Spark MLlib,可以融合传统关系数据库的结构化数据管理能力和机器学习算法的数据处理能力

C.Spark SQL无法对各种不同的数据源进行整合

D.Spark SQL无法融合结构化数据管理能力和机器学习算法的数据处理能力 -

6多选(3分)下面关于DataFrame的描述正确的是:ABCD

A.DataFrame的推出,让Spark具备了处理大规模结构化数据的能力

B.DataFrame比原有的RDD转化方式更加简单易用,而且获得了更高的计算性能

C.Spark能够轻松实现从MySQL到DataFrame的转化,并且支持SQL查询

D.DataFrame是一种以RDD为基础的分布式数据集,提供了详细的结构信息 -

7多选(3分)要读取people.json文件生成DataFrame,可以使用下面哪些命令:AC

A.spark.read.json("people.json")

B.spark.read.parquet("people.json")

C.spark.read.format("json").load("people.json")

D.spark.read.format("csv").load("people.json") -

8单选(2分)以下操作中,哪个不是DataFrame的常用操作:D

A.printSchema()

B.select()

C.filter()

D.sendto() -

9多选(3分)从RDD转换得到DataFrame包含两种典型方法,分别是:AB

A.利用反射机制推断RDD模式

B.使用编程方式定义RDD模式

C.利用投影机制推断RDD模式

D.利用互联机制推断RDD模式 -

10多选(3分)使用编程方式定义RDD模式时,主要包括哪三个步骤:ABD

A.制作“表头”

B.制作“表中的记录”

C.制作映射表

D.把“表头”和“表中的记录”拼装在一起

浙公网安备 33010602011771号

浙公网安备 33010602011771号