爬虫(一)初识爬虫

爬虫

获取互联网上的信息

- 数据挖掘

- 数据清洗

代码语言

python

大数据时代获取信息途径

- 企业生产的用户数据:百度指数、阿里指数、TBI、腾讯浏览器指数、新浪微博指数

- 数据平台购买数据:数据堂、国云数据市场、贵阳大数据交易所

- 政府/机构公开的数据:中华人民共和国统计局数据、世界银行公开数据、联合国数据、纳斯达克

- 数据管理咨询公司:麦肯锡、埃森哲、艾瑞咨询

- 爬取网络数据:如果需要的数据市场上没有,或者不愿意购买,name可以选择招/做一名爬虫工程师,自己动手丰衣足食。

数据挖掘和数据清洗

通用爬虫和聚焦爬虫

根据使用场景,网络爬虫可以分为 通用爬虫 和 聚焦爬虫 两种

通用爬虫

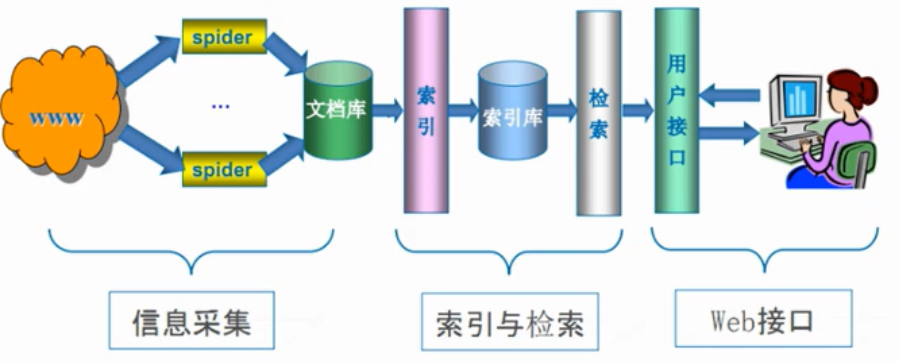

通用网络爬虫是搜索引擎抓取系统(baidu、google、yahoo等)的重要组成部分。主要目的是将互联网上的网页下载到本地,形成一个互联网内容的镜像备份。

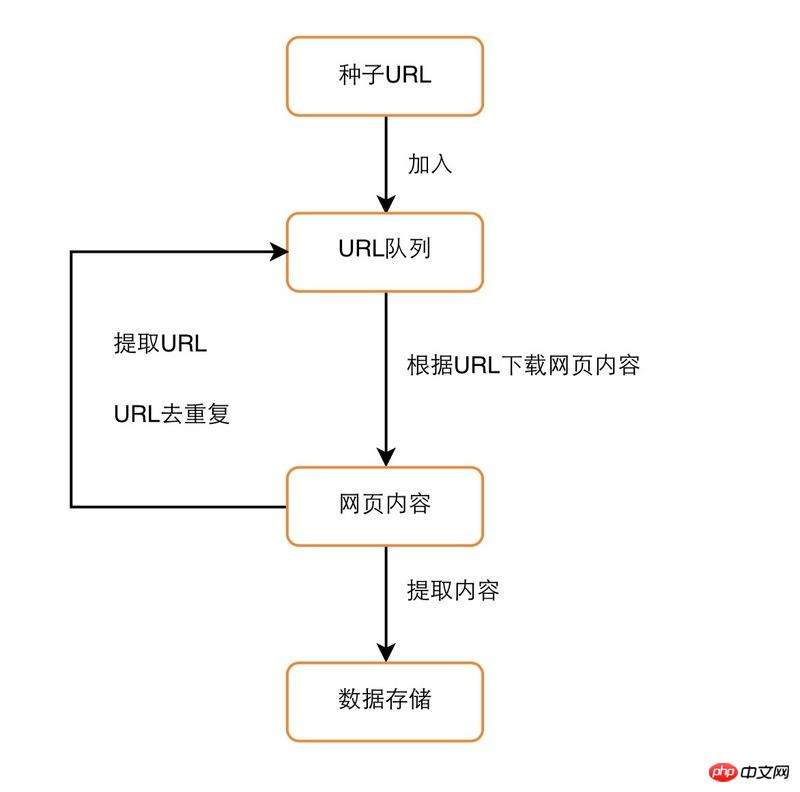

第一步:抓取网页

搜索引擎网络爬虫的基本工作流程如下:

- 首先选取一部分的种子URL,将这些URL放入待抓取URL队列;

- 取出待抓取URL,解析DNS得到主机的IP,并将对应的网页下载下来,存进已下载网页库中,并且将这些URL放进已抓取URL队列。

- 分析已抓取URL队列中的URL,分析其中的其他URL,并且将URL放入待抓取URL队列,从而进入下一个循环...

第二步:数据存储

搜索引擎通过爬虫到的网页,将数据存入原始数据库。其中的页面数据与用户浏览得到的HTML是完全一样的。

搜索引擎蜘蛛在抓取页面时,也做一定的重复内容检测,一旦遇到访问权重很低的网站上有大量抄袭、采集或者复制的内容,很可能就不再爬行。

第三步:预处理

搜索引擎将爬虫抓取回来的页面,进行各种步骤的预处理

- 提取文字

- 中文分词

- 清除噪音(比如版权声明文字、导航条、广告等...)

- 索引处理

- 链接关系计算

- 特殊文件处理

- ......

除了HTML文件外,搜索引擎通常还能抓取和索引以文字为基础的多种文件类型,如PDF、Word、WPS、XLS、PPT、TXT文件等。我们在搜索结果中也经常会看到这些文件类型。

但搜索引擎还不能处理图片、视频、Flash这类非文字内容,也不能执行脚本和程序。

第四步:提供检索服务,网站排名

搜索引擎在对信息进行组织和处理后,为用户提供关键字检索服务,将用户检索相关的信息展示给用户。

同时会根据页面的PageRank值(链接的访问量排名)来进行网站排名,这样Rank值高的网站在搜索结果中会排名较前,当然也可以直接使用Money购买搜索引擎网站排名,简单粗暴。

但是,这些搜索引擎也存在这一定的局限性:

- 通用搜索引擎所返回的结果都是网页,而大多数情况下,网页里90%的内容对用户来说都是无用的。

- 不同领域、不同背景的用户往往具有不同的检索目的和需求,搜索引擎无法提供针对具体某个用户的搜索结果。

- 万维网数据形式的丰富和网络科技技术的不断发展,图片、数据库、音频、视频多媒体等不同数据大量出现,通用搜索引擎对这些文件无能为力,不能很好地发现和获取。

- 通用搜索引擎大多提供基于关键字的检索,难以支持根据语义信息提出的查询,无法准确理解用户的具体需求。

针对这些情况,聚焦爬虫技术得以广泛使用。

聚焦爬虫

聚焦爬虫,是面向特定主题需求的一种网络爬虫程序,它与通用搜索引擎爬虫的区别在于:聚焦爬虫在实施网页抓取时会对内容进行处理筛选,尽量保证只抓取与需求相关的网页信息。

而我们要学习使用的,就是聚焦爬虫

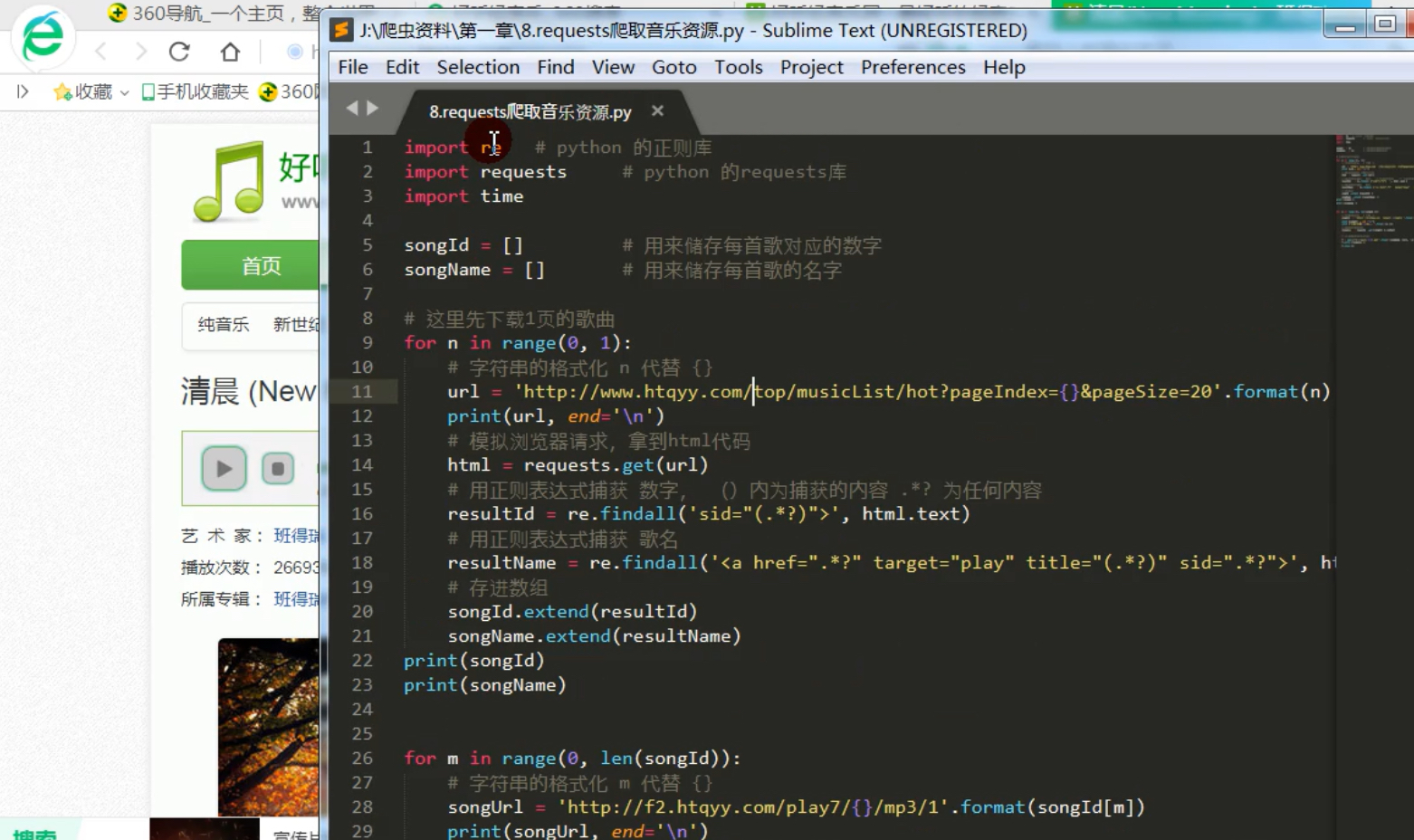

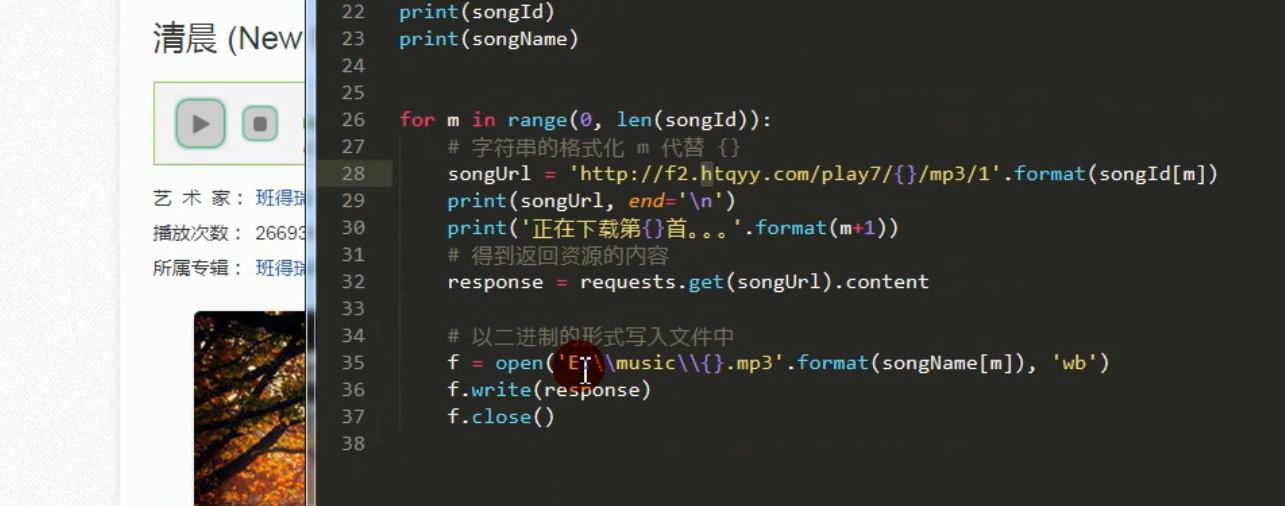

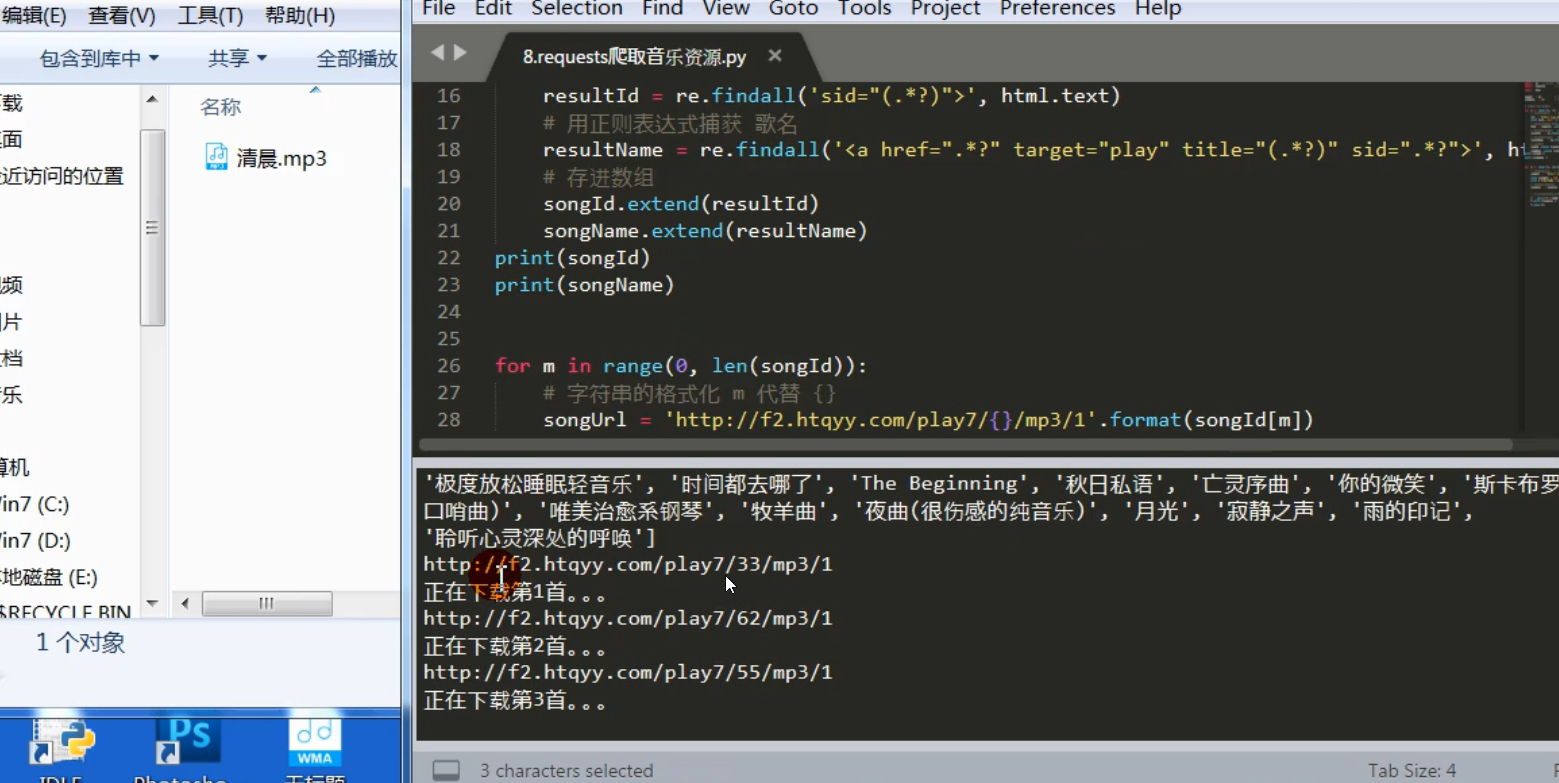

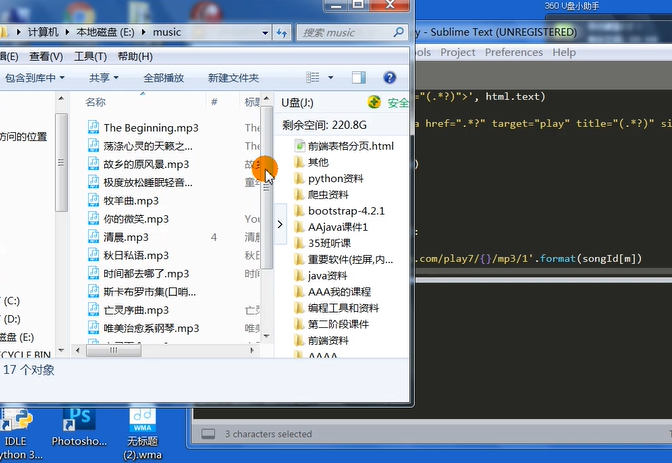

体验-跳过限制爬取音乐资源

打开【好听轻音乐网】

https:htqyy.com

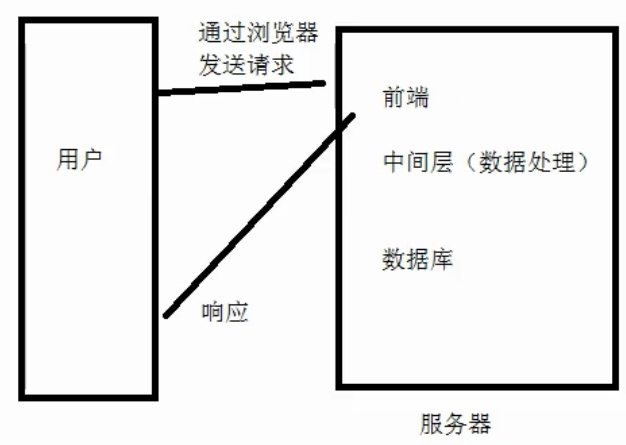

请求和响应

所有网站都要一个服务器

URL

说白了就是网址

HTTP的请求和响应

基本格式:scheme://host[:port#]/path/.../[?query-string][#anchor]

- scheme:协议(例如:http、https)

- host:服务器的IP地址或者域名

- port#:服务器的端口(如果是走协议默认端口,缺省端口80)

- path:访问资源的路径

- query-string:参数,发送给http服务器的数据

- anchor:锚(跳转到网页的指定锚点位置)

例如:

ftp://192.168.0.116:8080/index

http://item.dj.com/11936238.html#product-detail

Get和Post

GET是从服务器上获取数据,POST是向服务器传送数据

注意:避免使用Get方式提交表单,因为有可能会导致安全问题。比如说在登录表单中用Get方式,用户输入的用户名和密码将在地址栏中暴露无疑。

浙公网安备 33010602011771号

浙公网安备 33010602011771号