【征文计划】从掌心到像素:深度解析Rokid UXR 2.0的手势识别与自定义交互实战

目录

【征文计划】从掌心到像素:深度解析Rokid UXR 2.0的手势识别与自定义交互实战

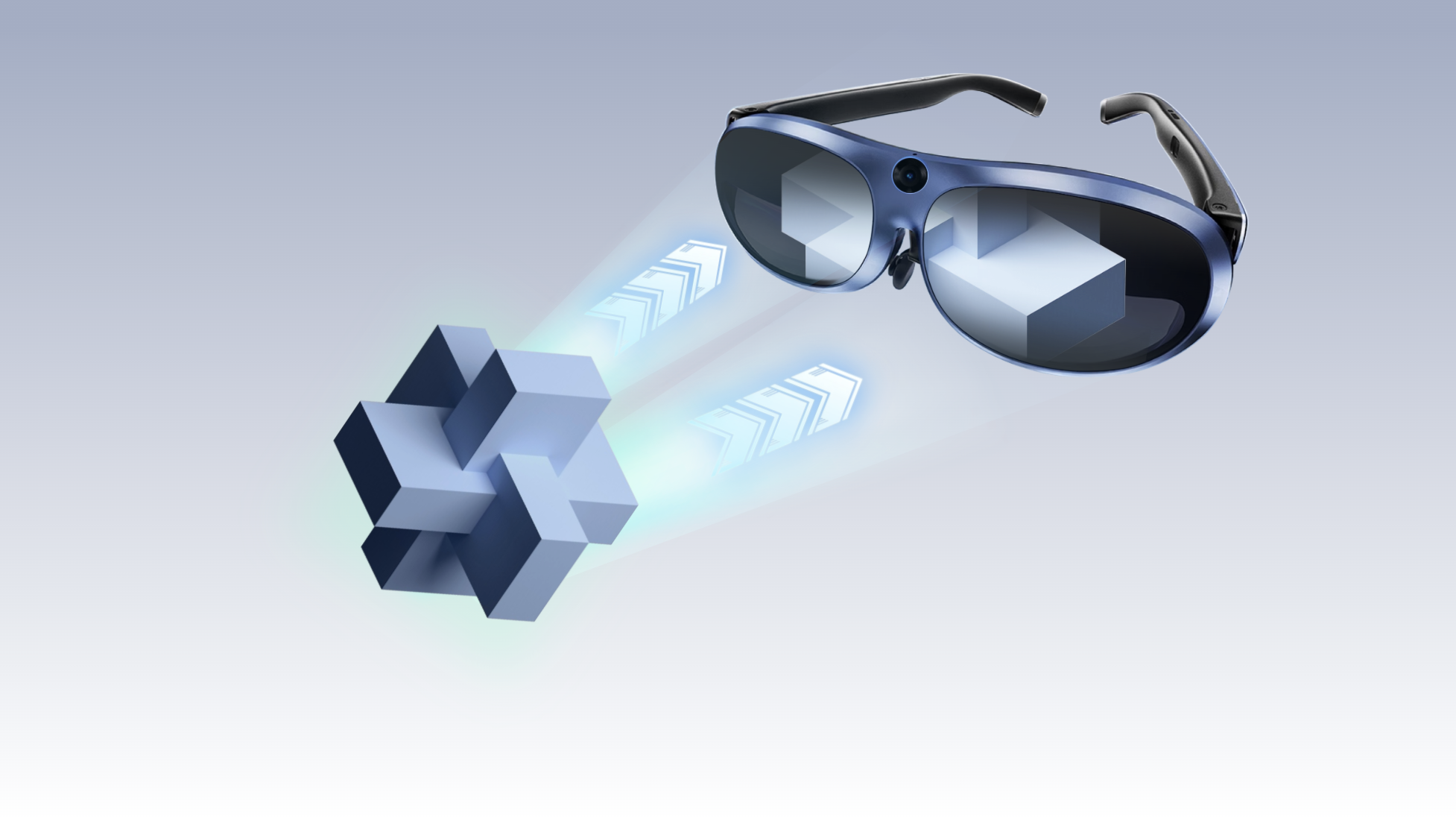

想象一下,在空气中轻轻一捏,就能抓取一个虚拟的立方体;张开手掌,菜单界面便如影随形。这不再是科幻电影的桥段,而是Rokid UXR 2.0 SDK为我们带来的现实。今天,就让我们一同潜入代码深处,不仅揭开其手势识别技术的神秘面纱,更要突破默认设定的边界,探索如何自定义专属手势与交互规则,真正释放空间计算的无限潜力。

一、引言:为何手势是空间计算的“终极语言”?

在AR/VR的世界里,传统的控制器或触摸屏打破了沉浸感。我们渴望的,是一种更自然、更直觉的交互方式——就像我们在现实中用手直接操控物体一样。手势识别,因此成为了空间计算中至关重要的“无声语言”。

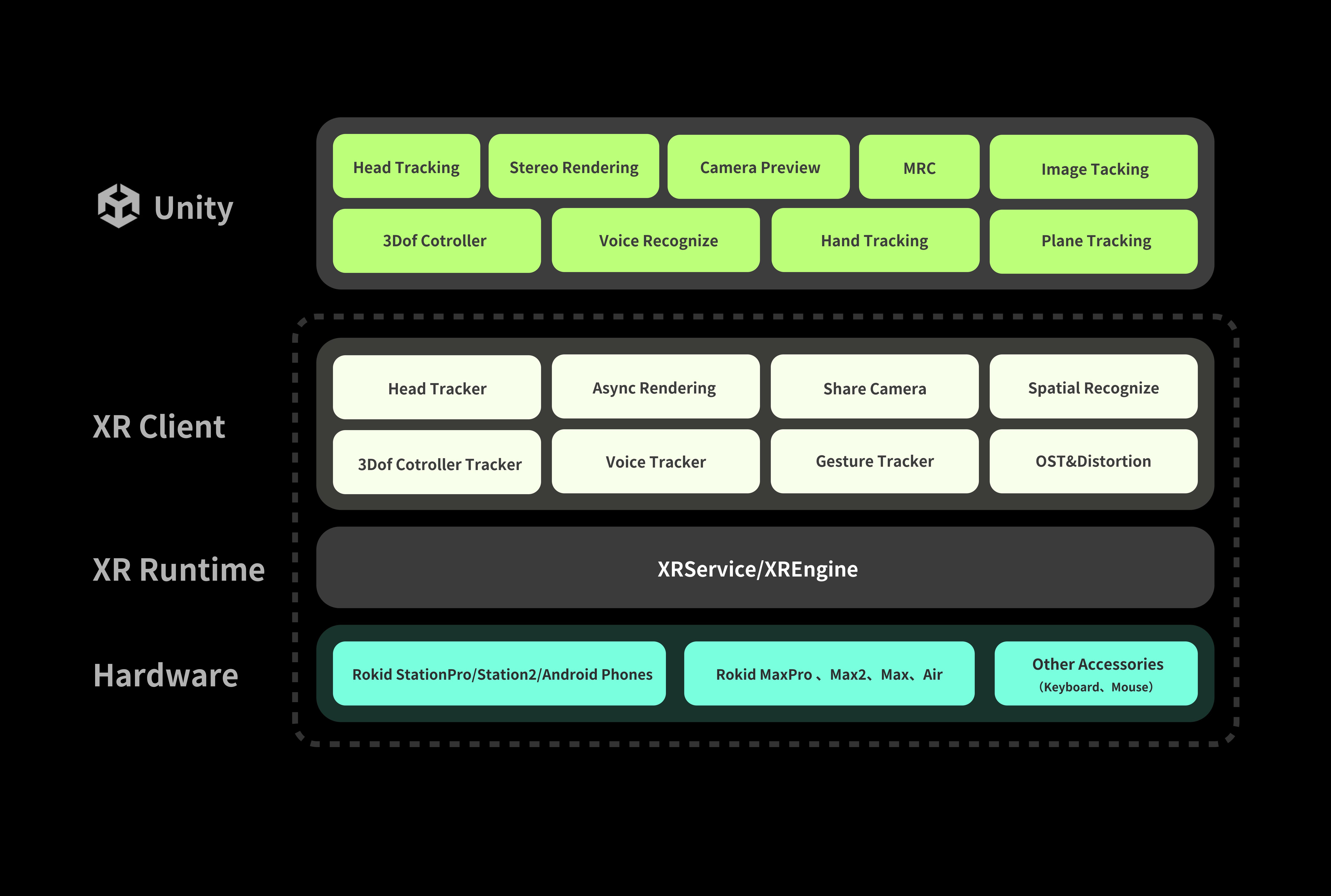

Rokid UXR 2.0 SDK将手势识别作为其多模态交互体系的核心一环,它提供的不仅仅是一套预定义的手势库,更是一套从底层数据到高层交互的完整工具链。无论是使用开箱即用的基础手势,还是创造独一无二的交互逻辑,UXR 2.0都为我们铺平了道路。

二、原理解析:Rokid手势识别的技术内核

尽管官方文档未透露底层算法的全部细节,但我们可以根据其架构和API设计,勾勒出技术实现的轮廓。

- 核心工作流程

一个完整的手势识别流程,可以抽象为以下 pipeline:

[眼镜端双摄图像输入] -> [图像预处理与增强] -> [手部检测与21+关键点定位] -> [手势分类与姿态估计] -> [Unity引擎中的交互事件派发]

图像输入:依赖于Rokid Max Pro眼镜集成的双目摄像头,提供立体视觉数据,这对于估算手部的深度信息至关重要。

手部检测与关键点:这是技术的核心。系统需要首先在图像中定位手部区域,进而识别出21个骨骼关节点(如INDEX_FINGER_TIP、WRIST、PALM等)。

手势分类:基于关节点形成的空间向量、角度和形状,通过一个预先训练好的机器学习模型来判断当前的手势状态(如握拳、张开、捏合等)。

- UXR SDK的抽象层:

RKInput与InputModuleManager

Rokid的精妙之处在于,它将复杂的底层感知技术封装成了一个对Unity开发者极其友好的抽象层。这个抽象层的核心就是 RKInput预制体和其上的 InputModuleManager脚本。

InputModuleManager 像一个交互模式的总调度中心。在其 DefaultInitModule 列表中,我们可以勾选希望启用的交互方式。对于手势识别,我们必须确保 Gesture 模块被启用。

设计思想:这种模块化设计意味着手势、射线、TouchPad等交互模式并非割裂的,而是可以动态切换、互为补充的。系统会根据用户的行为(如摊开手掌面向摄像头)智能地切换到最合适的交互模式。

三、源码与配置分析:如何让Unity“理解”手势?

让我们深入到项目配置和代码层面,看看如何搭建起手势交互的桥梁。

- 环境搭建与SDK导入

![在这里插入图片描述]()

手势识别的基石是正确的开发环境。这包括:

Unity环境:2021/2022 LTS版本,并安装Android Build Support。

SDK导入:通过Unity Package Manager (UPM),从Rokid的NPM仓库 (https://npm.rokid.com) 添加 com.rokid.xr.unity 包。

关键配置:在 Plugins/Android/ 下的Gradle配置文件中,必须确保引入了核心依赖 com.rokid.uxrplugin:rkuxrplugin:2.5.3。

这些步骤确保了Unity项目能够调用Rokid设备底层的SLAM、手势识别等原生能力。

- 交互配置的两种场景

UXR SDK为UI和3D物体提供了不同的交互路径。

场景一:与UI交互(以PointableUI为例)

这是最简单快捷的方式。你不需要理解底层事件,SDK已经为你封装好了。

- 拖入预制体:将

PointableUI预制体拖入场景。 - 创建UI元素:在

PointableUI的Canvas下创建一个Button或Image。 - 编写响应逻辑:直接使用UGUI自带的事件接口,例如:

using UnityEngine;

using UnityEngine.EventSystems;

using UnityEngine.UI;

public class GestureUIHandler : MonoBehaviour, IPointerEnterHandler, IPointerClickHandler

{

private Image image;

void Start()

{

image = GetComponent<Image>();

}

// 当手势射线悬停时触发

public void OnPointerEnter(PointerEventData eventData)

{

image.color = Color.cyan; // 改变颜色给予反馈

}

// 当做出“点击”手势时触发

public void

浙公网安备 33010602011771号

浙公网安备 33010602011771号