PersonaLive 实时直播数字人:12GB 显存跑起来的「可流式、无限时长」肖像动画

- 项目地址:https://github.com/GVCLab/PersonaLive

- 云算力试玩镜像(仙宫云):https://www.xiangongyun.com/image/detail/c68ad63c-8ce0-462f-8481-1c80e973ae41

PersonaLive 是一个面向直播场景的实时数字人(肖像动画)方案:主打 实时(Real-time)、可流式传输(Streamable),并支持 长时输出(Infinite-length) 的肖像动画生成。

如果你正在做“实时数字人分身”内容(直播/短视频/虚拟主播/AIGC 工具整合),它非常适合拿来做“效果展示 + 快速上手部署”的一条龙教程。

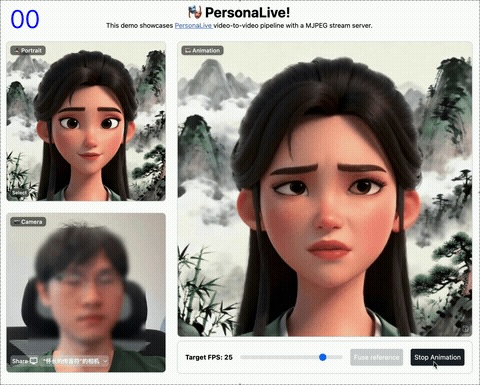

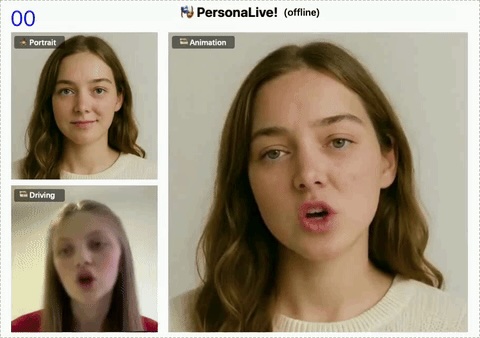

先看效果

图片展示位

PersonaLive 能做什么?

一句话:上传一张人像图,用摄像头驱动它实时动起来,并且可以持续生成很久。

你可以把它理解为:

- 实时数字人:适合直播

- 流式生成:可以边生成边输出,更贴近直播链路

- 长时稳定:更适合长时间持续输出的场景

本地部署

我也做过云算力试玩(仙宫云一键部署镜像),但实际体验上更推荐 本地部署:

- 延迟更低:不需要把画面来回传输(上行/下行都会吃延迟)

- 更稳定:直播链路对抖动非常敏感

- 调参更方便:Driving FPS、队列策略

项目部署

1)克隆仓库 & 创建环境

# clone this repo

git clone https://github.com/GVCLab/PersonaLive

cd PersonaLive

# Create conda environment

conda create -n personalive python=3.10

conda activate personalive

# Install packages with pip

pip install -r requirements_base.txt

2)下载权重模型

python tools/download_weights.py

编译前端 WebUI(Linux / Windows)

Linux:用 nvm 安装 Node.js 18+

# install Node.js 18+

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.1/install.sh | bash

nvm install 18

source web_start.sh

Windows:用 Git Bash 执行脚本

- 安装 Git for Windows(确保有 Git Bash)

- 安装 nvm for Windows(或直接装 Node.js 18 也行)

- 打开 Git Bash,进入项目目录

- 执行:

bash web_start.sh

提示:Windows 的 nvm 与 Linux 的 nvm 不是同一个实现;若脚本里依赖 Linux nvm 命令,建议优先确保 node -v 能看到 v18.x。

开始实时推理(Online)

python inference_online.py

然后在浏览器打开:

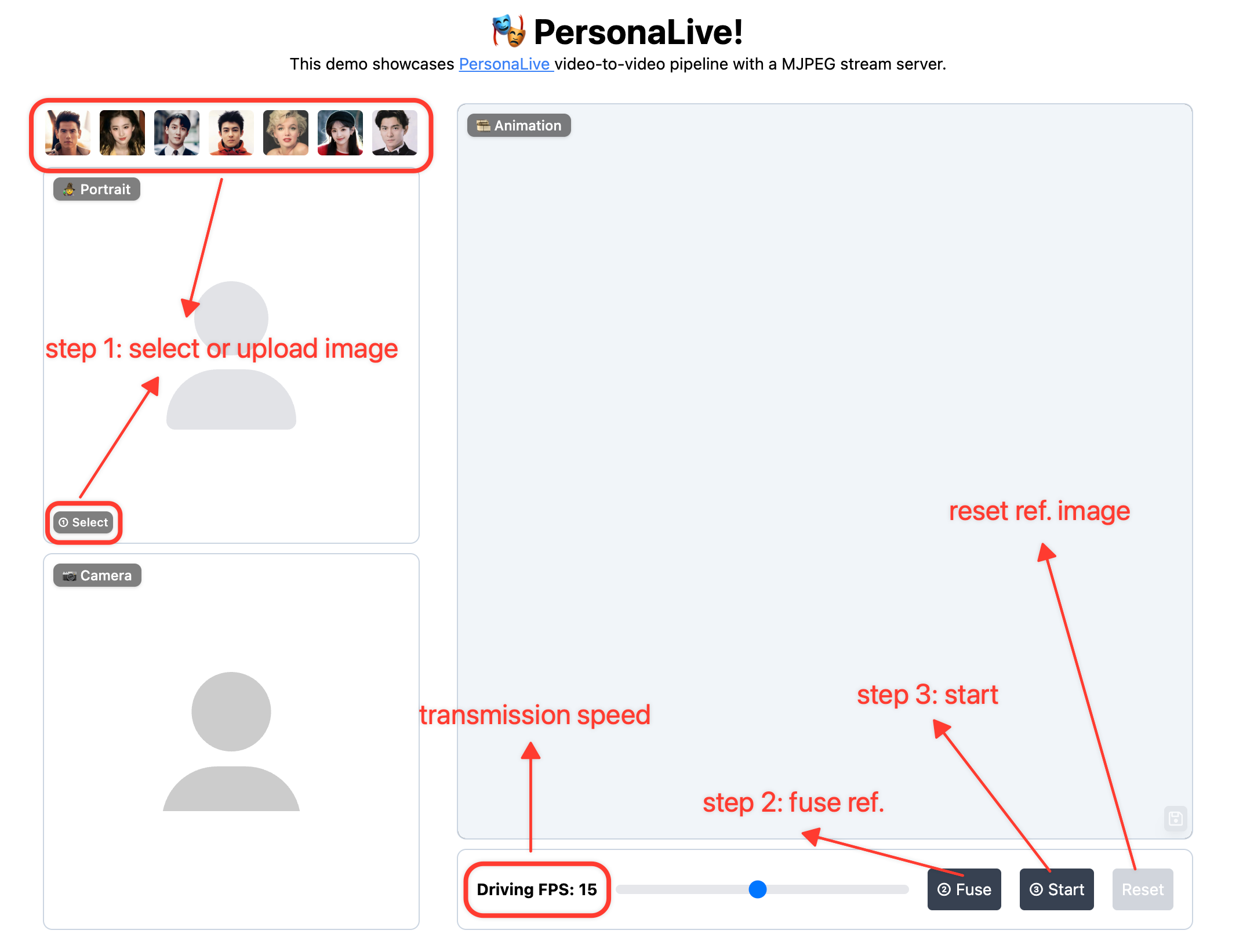

使用方法

上传图片 → 融合参考图像 → 开始动画 → 尽情欣赏!🎉

建议你在视频里这样讲更顺:

- 上传一张正脸清晰照片

- 点击“融合参考图像”(Fuse Reference)

- 点击“开始动画”(Start Animation)

- 摄像头驱动实时动起来(适合直播/录屏)

降低延迟

1)降低 Driving FPS

在 WebUI 里把 Driving FPS 适当调低,能显著减轻计算负载。

2)调整队列读取倍率

修改文件:

PersonaLive/webcam/util.py

找到类似这一行:

read_size = min(queue.qsize(), num_frames_needed * 3)

把 num_frames_needed * 3 改成 num_frames_needed * 4(或更高),让队列读取更匹配你的推理速度(具体看你的显卡情况)。

一件整合包获取

- 微信公众号:InnoTechX 发送关键字 PL

- 远程部署/调试支持/问题咨询: https://t.zsxq.com/L6xGs

浙公网安备 33010602011771号

浙公网安备 33010602011771号