(补交)7.Spark SQL

1.请分析SparkSQL出现的原因,并简述SparkSQL的起源与发展。

SparkSQL的出现,解决了对不同数据源和不同数据的操作,例如结构化和非结构化数据。还有可以支持融合关系查询和复杂分析算法。

SparkSQL的前身是Shark,Shark中提供了类似于Hive的功能。但是Shark设计中导致了两个问题,一是执行计划优化完全依赖Hive, 二是Spark是线程进行,而MapReduce是进程级并行,此此过程会导致线程安全问题。而转向SparkSQL的开发。

2. 简述RDD 和DataFrame的联系与区别?

RDD是分布式的Java对象的集合,但是,对象内部结构对于RDD而言是不可知的。DataFrame是一种以RDD为基础的分布式数据集,提供了详细的结构信息,就相当于数据库的一张表。

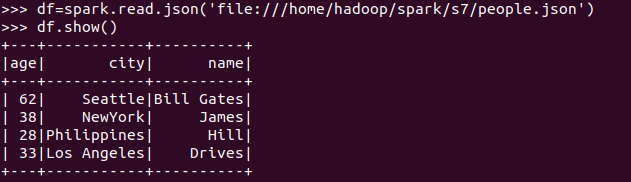

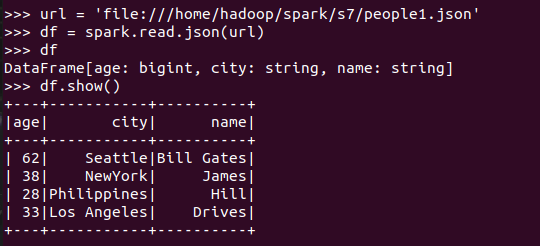

3.DataFrame的创建

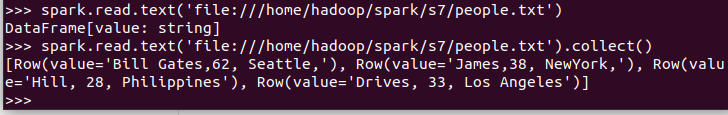

spark.read.text(url)

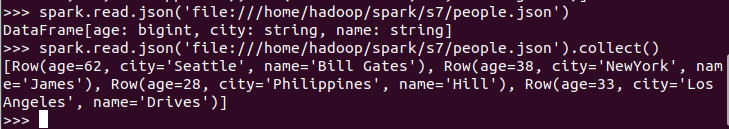

spark.read.json(url)

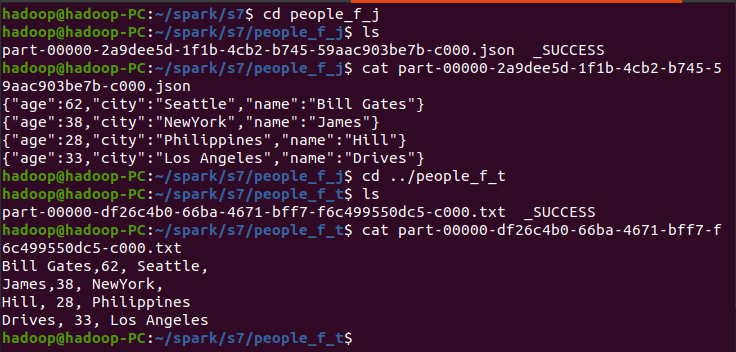

注意从不同文件类型生成DataFrame的区别。

text读出来的是一个value值,json文件读的是一个实体对象

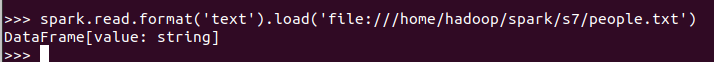

spark.read.format("text").load("people.txt")

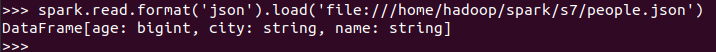

spark.read.format("json").load("people.json")

4. PySpark-DataFrame各种常用操作

基于df的操作:

打印数据 df.show()默认打印前20条数据

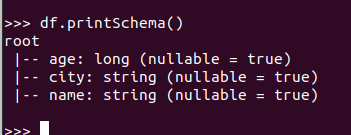

打印概要 df.printSchema()

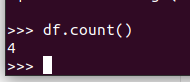

查询总行数 df.count()

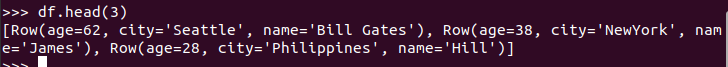

df.head(3) #list类型,list中每个元素是Row类

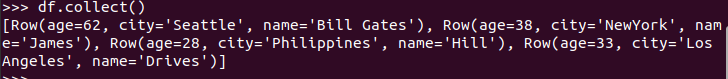

输出全部行 df.collect() #list类型,list中每个元素是Row类

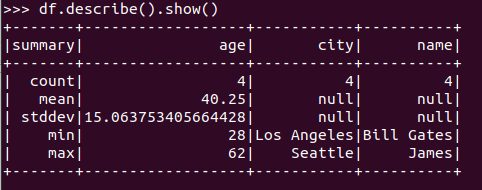

查询概况 df.describe().show()

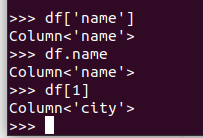

取列 df[‘name’], df.name, df[1]

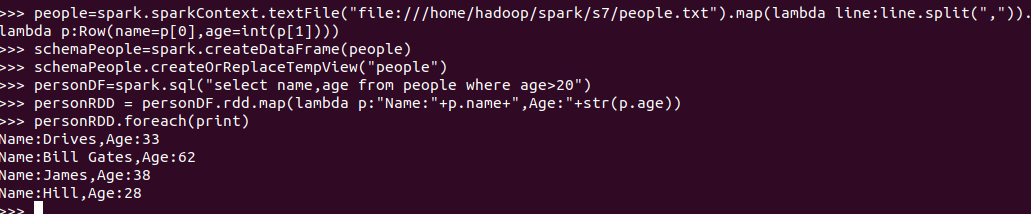

基于spark.sql的操作:

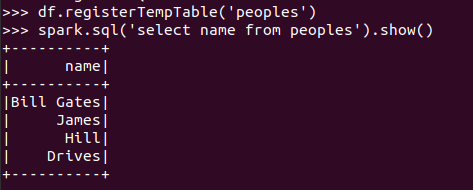

创建临时表虚拟表 df.registerTempTable('people')

spark.sql执行SQL语句 spark.sql('select name from people').show()

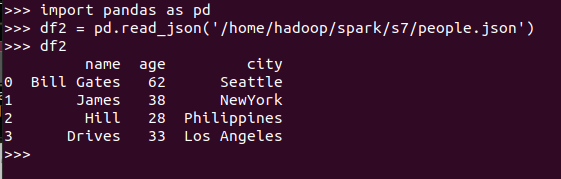

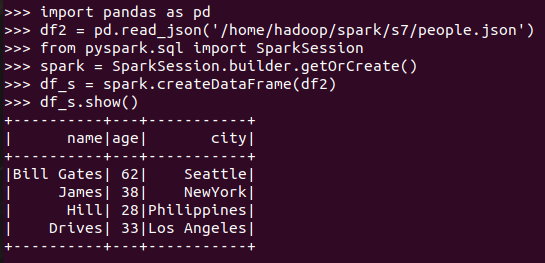

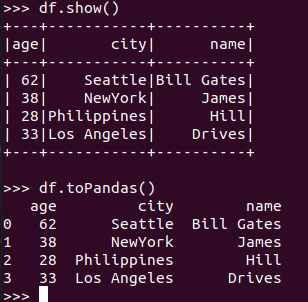

5. Pyspark中DataFrame与pandas中DataFrame

分别从文件创建DataFrame

比较两者的异同

DataFrame数据转换成一行一行的数据。而pandas读的数据会转换成行列数据

pandas中DataFrame转换为Pyspark中DataFrame

Pyspark中DataFrame转换为pandas中DataFrame

6.从RDD转换得到DataFrame

6.1 利用反射机制推断RDD模式

创建RDD sc.textFile(url).map(),读文件,分割数据项

每个RDD元素转换成 Row

由Row-RDD转换到DataFrame

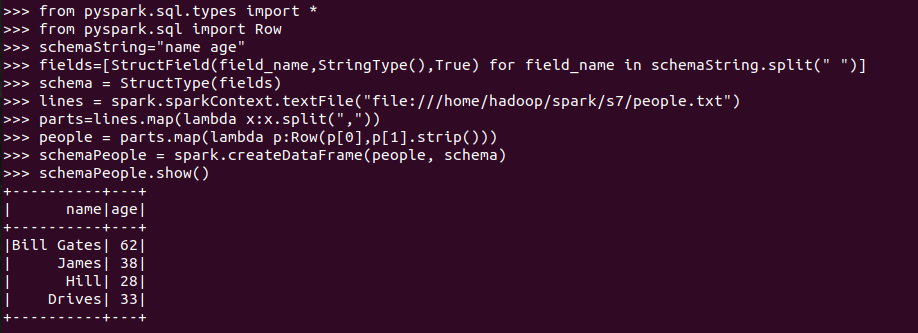

6.2 使用编程方式定义RDD模式

#下面生成“表头”

#下面生成“表中的记录”

#下面把“表头”和“表中的记录”拼装在一起

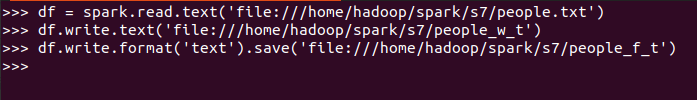

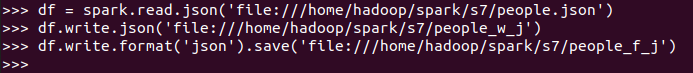

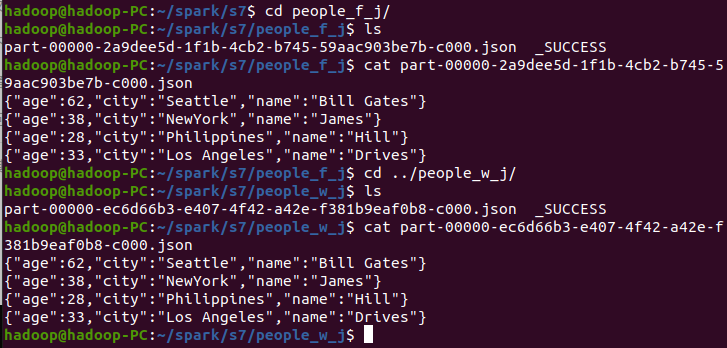

7. DataFrame的保存

df.write.text(dir)

df.write.format("text").save(dir)

df.write.json(dri)

df.write.format("json").save(dir)

浙公网安备 33010602011771号

浙公网安备 33010602011771号