DuLa-Net: A Dual-Projection Network for Estimating Room Layouts from a Single RGB Panorama和BiFuse: Monocular 360◦ Depth Estimation via Bi-Projection Fusion

这两篇论文做的工作都是关于全景图的工作,一篇是做layout的估计,另外一篇是做深度估计,他们相同点是都用了不同视角的图像来作为输入,将全景图和透视图之间的特征进行融合来做高层的任务。

dula-net

这篇文章做的工作做的任务是估计非cuboid的室内场景的layout,作者使用了两路branch,一路是panorama的branch,另外一路是ceilling的branch,通过一个E2P的stn将其特征进行变换和融合,然后将最终的结果也进行融合,并且生成最后的layout

作者的贡献点在于使用了两种不同的输入,以及feature fusion这样的一个层,并且作者说不怎么需要后处理就能够得到比较好的layout,因为作者处理的case不仅仅包含cuboid的shape,作者也处理非规则的cuboid,所以建了个数据集,corners比较多。流程图如下

feature 融合的方式是从panorama向下融合,直接采用相加的方式

注意上图还是有post process的,训练的方式是对两个网络分别使用交叉熵loss,作者做了一些实验验证其方法是有效的,对比对象主要是layoutnet,发现都是超过之前的试验结果的。

感觉这篇文章的主要创新点在于使用了一个E2P的stn layer,下一篇文章也是类似的创新

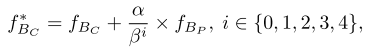

BiFuse

这一篇文章做的是深度估计,和上一篇文章是一样的,ta提出了一个是e2c还有一个是c2e的两个stn,用于融合两个branch的特征,同时作者提出了一种spherecial的padding方法,

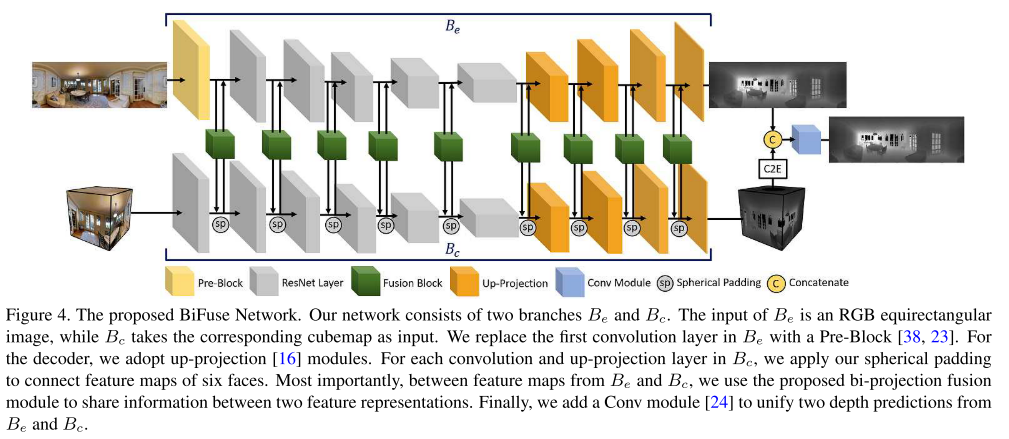

对比的对象有omnidepth的一篇文章,以及FCRN的单目图像估计的文章

作者在消融实验部分也比较了是否添加fuse,两个单路的情况是怎么样的,发现加了fuse对于有些指标提升并不是很大

posted on 2020-11-22 16:21 YongjieShi 阅读(393) 评论(0) 收藏 举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号