GIL 全局解释器锁

一。介绍

在Cpython解释器中,同一个进程下开启的多个线程,同一时刻只能有一个线程执行,无法利用多核优势。

首先需要明确的一点是GIL并不使Python的特性,它是在实现python解释器(CPython) 时引入得一个概念。python同样的一段代码,可以通过CPython,PyPy,Psyco等不同的Python执行环境来执行。其中的JPython就没有GIL。然而因为CPython是大部分环境下默认的Python执行环境。所以在很多人得概念里CPython就是Python,也就把GIL归结为Python语言的缺陷。需要明确的是:GIL并不是Python的特性,Python完全可以不依赖于GIL。

二。GIL介绍

GIL本质是一把互斥锁,既然是互斥锁,所有互斥锁的本质都一样,都是将应发运行变为串行,以此来控制同一时间内共享数据只能被一个任务所修改,进而保证数据安全。

可以肯定的一点是:保护不同数据的安全,就应该加不同的锁。

要想了解GIL,首先确定一点:每次执行python程序,都会产生一个独立的进程。

#验证python test.py只会产生一个进程 #test.py内容 import os,time print(os.getpid()) time.sleep(1000) ''' python3 test.py #在windows下 tasklist |findstr python #在linux下 ps aux |grep python

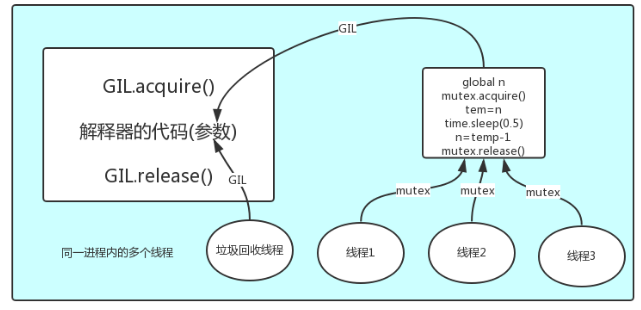

在一个python的进程内,不仅有test.py的主线程或者由该主线程开启的其他线程,还有解释器开启的垃圾回收等解释器级别的线程,总之,所有线程都运行在这一个进程内,毫无疑问,所有数据都是共享的,这其中,代码作为一种数据也是被所有线程共享的(test.py的所有代码以及CPython解释器的所有代码);所有线程的任务,都需要将任务的代码当做参数传给解释器的代码去执行,即所有的线程要想运行自己的任务,首先需要解决的是能够访问到解释器的代码。

综上:

如果多个线程的target=work,那么执行流程是:多个线程先访问到解释器的代码,即拿到执行权限,然后将target的代码交给解释器的代码去执行。

解释器的代码是所有线程共享的,所以垃圾回收线程也可能访问到解释器的代码去执行,这就导致了一个问题:对于同一个数据100,可能线程1执行x=100的同时,而垃圾回收执行的是回收100的操作,解决这种问题没有什么高明的方法,就是加锁处理,如下图的GIL,保证python解释器同一时间只能执行一个任务的代码。

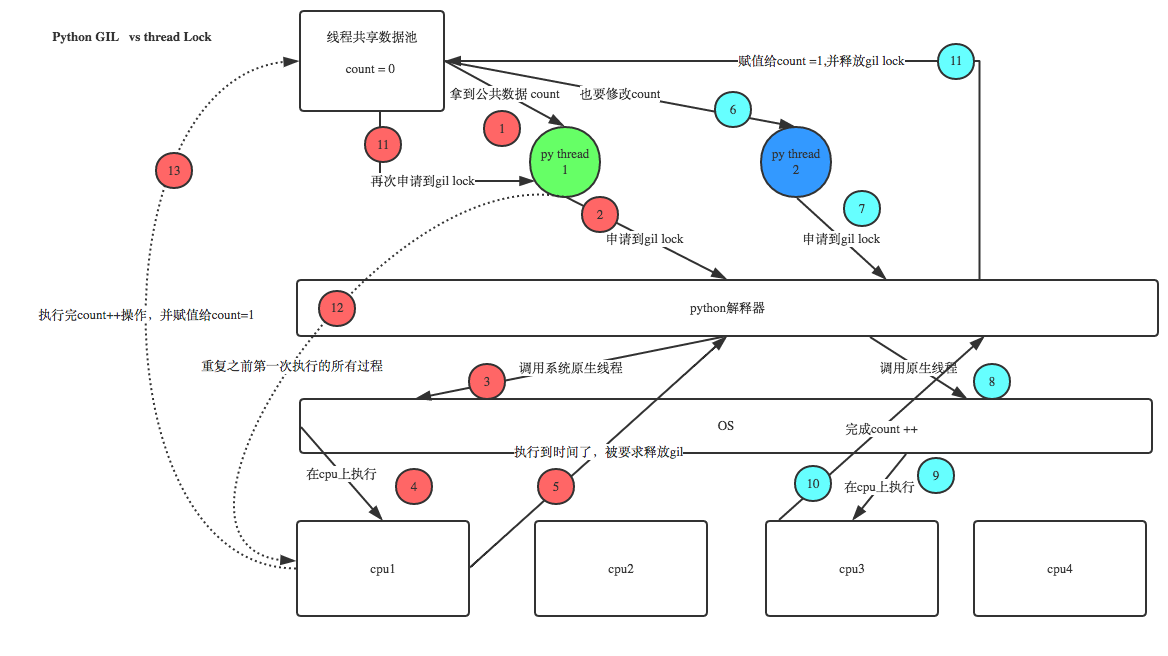

三。GIL与Lock

GIL保护的是解释器级的数据,保护用户自己的数据则需要自己加锁处理

四。GIL与多线程

有了GIL的存在,CPython同一时刻同一进程中只有一个线程被执行。

1.cpu是用来做计算的

2.多CPU,意味着可以有多个核并行完成计算,所以多核提升的是计算性能

3.每个CPU一旦遇到I/O阻塞,仍然需要等待,所以多核对I/O操作没什么用处

结论:

对计算来说,CPU越多越好,但是对与I/O来说,再多的CPU也没用。

当然对运行一个程序来说,随着cpu的增多执行效率肯定会有所提高(提高幅度可大可小),这是因为一个程序基本上不会是纯计算或者纯I/O,所以我们只能相对的去看一个程序到底是计算密集型还是I/O密集型,从而进一步分析python得多线程什么时候使用:

有四个任务需要处理,处理方式需要得到 并发的效果,解决方案一:开启四个进程;方案二:一个进程下,开启四个线程

单核情况下:

如果四个任务是计算密集型,没有多核来并行计算,方案一徒增了创建进程的开销,方案二胜

如果四个任务是I/O密集型,方案一徒增了创建进程的开销,且进程的切换速度远不如线程,方案二胜

多核情况下:

如果四个任务是计算密集型,多核意味着并行计算,方案一胜

如果四个任务是I/O密集型,再多的核也解决不了I/O问题,方案二胜

结论:现在的计算机基本上都是多核,python对于计算密集型的任务开多线程的效率并不能带来多大性能上的提升,甚至不如串行(没有大量切换),但是,对于I/O密集型的任务效率还是有显著提高的。

五。多线程性能测试

多线程用于I/O密集型

from multiprocessing import Process from threading import Thread import threading import os,time def work(): time.sleep(2) print('===>') if __name__ == '__main__': l=[] print(os.cpu_count()) #本机为4核 start=time.time() for i in range(400): # p=Process(target=work) #耗时12s多,大部分时间耗费在创建进程上 p=Thread(target=work) #耗时2s多 l.append(p) p.start() for p in l: p.join() stop=time.time() print('run time is %s' %(stop-start))

多进程用于计算密集型

from multiprocessing import Process from threading import Thread import os,time def work(): res=0 for i in range(100000000): res*=i if __name__ == '__main__': l=[] print(os.cpu_count()) #本机为4核 start=time.time() for i in range(4): p=Process(target=work) #耗时5s多 p=Thread(target=work) #耗时18s多 l.append(p) p.start() for p in l: p.join() stop=time.time() print('run time is %s' %(stop-start))

浙公网安备 33010602011771号

浙公网安备 33010602011771号