数值优化 —— 线搜索 —— scipy.optimize.line_search

scipy.optimize.line_search

DeepSeek 思考:

好的,用户让我解释scipy.optimize里的line_search函数,包括它的输入输出,并给出例子。我需要先回忆一下这个函数的具体用法。之前可能用过或者学过这方面的知识,但可能需要查证一下确保准确性。

首先,用户可能是在学习数值优化,特别是线搜索方法。他们可能在实现自己的优化算法,比如梯度下降、牛顿法或者其他需要线搜索的算法。这时候,了解如何正确使用现成的线搜索工具会很有帮助。

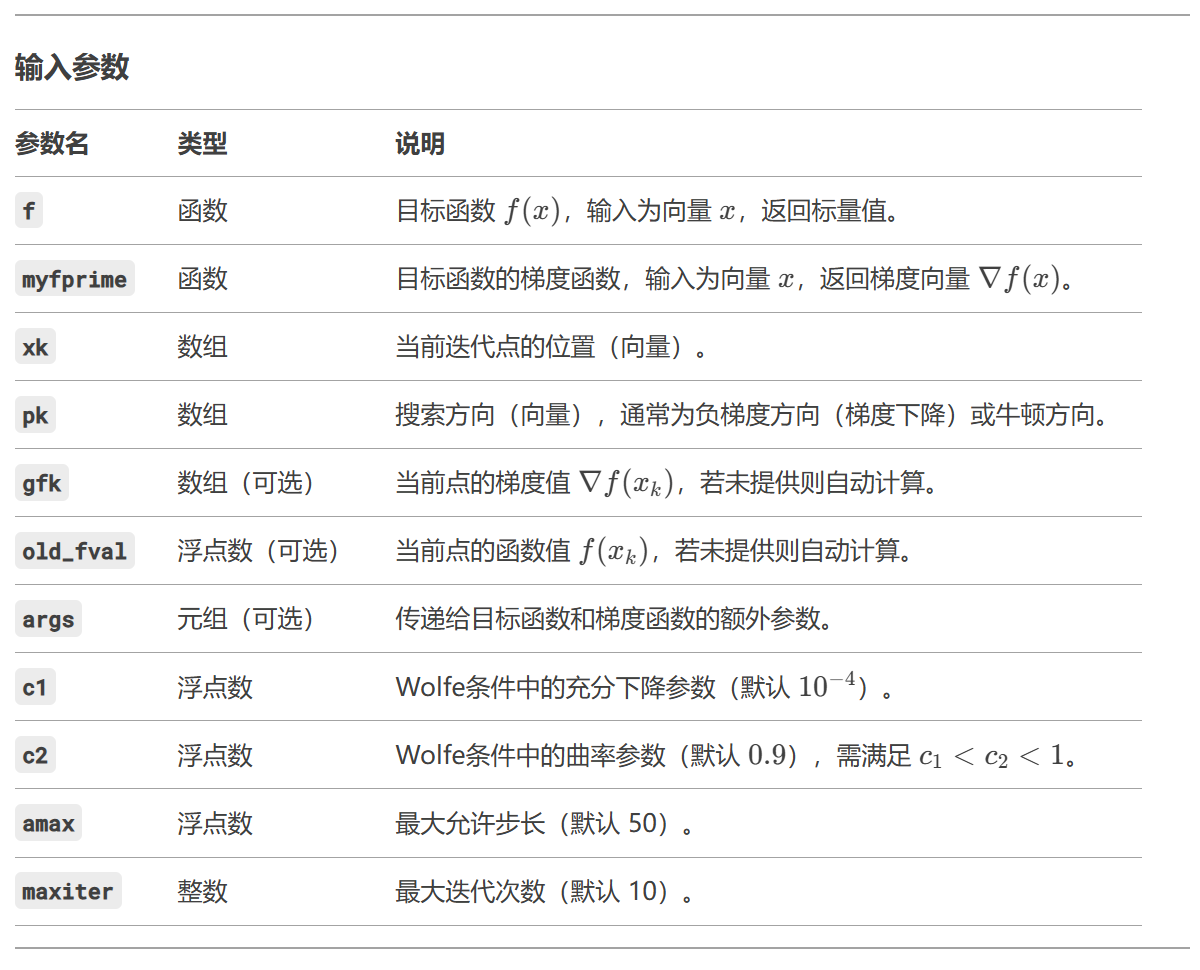

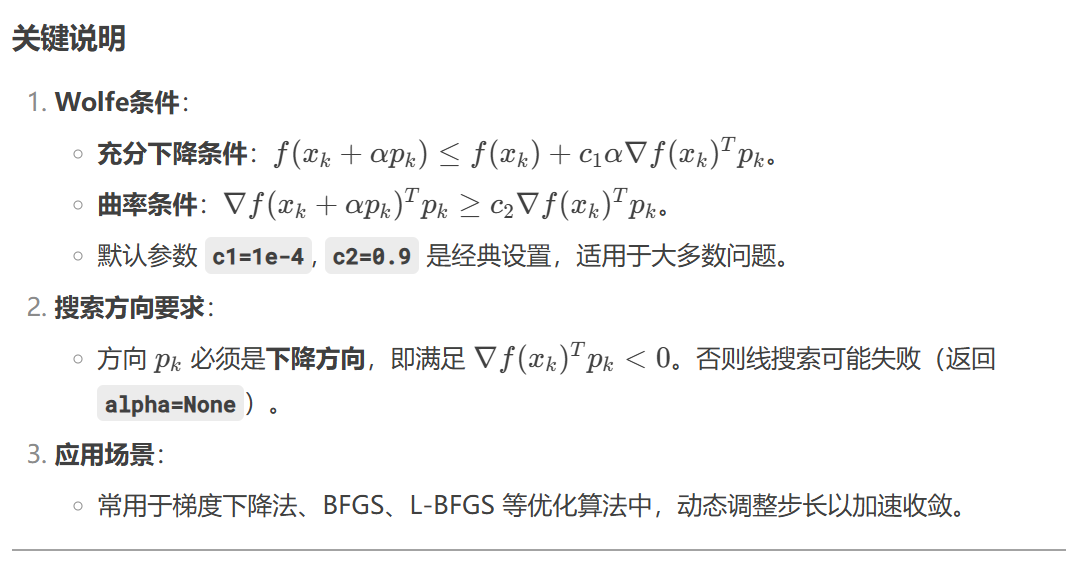

接下来,我需要明确line_search函数的输入参数。根据文档,这个函数需要目标函数f,梯度函数fprime,当前位置xk,搜索方向pk,以及其他可选参数如gfk(当前梯度)、old_fval(当前函数值)、args(额外参数)、c1和c2(用于Wolfe条件的参数)、amax(最大步长)等。但用户可能更关注基本用法,所以应该重点解释主要的参数:f,fprime,xk,pk,以及常用的可选参数。

然后,输出方面,line_search返回一个元组,包含步长alpha,函数评估次数,以及是否找到满足条件的步长的标志。需要详细解释每个返回值的意义,特别是alpha可能为None的情况。

用户可能需要一个具体的例子来理解如何使用这个函数。比如,用Rosenbrock函数作为例子,因为它是一个常用的测试函数,在优化中很常见。需要展示如何定义目标函数和梯度,设置初始点,选择搜索方向,然后调用line_search函数。同时,解释输出结果的意义,比如得到的步长是否合理,如何应用到参数更新中。

另外,用户可能想知道这个函数内部是如何工作的,比如它是否使用Armijo条件或Wolfe条件。根据scipy的文档,line_search默认使用Wolfe条件,所以需要提到这一点,并解释c1和c2参数的作用。但用户可能不需要太深入的算法细节,只要知道如何调整这些参数即可。

还要注意可能出现的错误或常见问题。例如,如果搜索方向不是下降方向,函数可能无法找到合适的步长,导致alpha为None。这时候需要提醒用户检查梯度方向是否正确,或者搜索方向是否合理。

最后,总结一下line_search的作用,强调它在优化算法中的重要性,以及如何通过调整参数来适应不同的问题。确保例子简单明了,能够帮助用户快速上手使用这个函数。

(由于技术原因,联网搜索暂不可用)

scipy.optimize.line_search 是 SciPy 库中用于非精确线搜索(Inexact Line Search)的函数,其目的是在给定搜索方向上找到一个合适的步长(Step Size),使得目标函数满足 Wolfe条件(包含充分下降条件和曲率条件)。以下是详细解释和示例:

函数定义

from scipy.optimize import line_search

alpha, fc, gc, new_fval, old_fval, new_slope = line_search(

f, myfprime, xk, pk, gfk=None, old_fval=None, old_old_fval=None,

args=(), c1=1e-4, c2=0.9, amax=50, maxiter=10

)

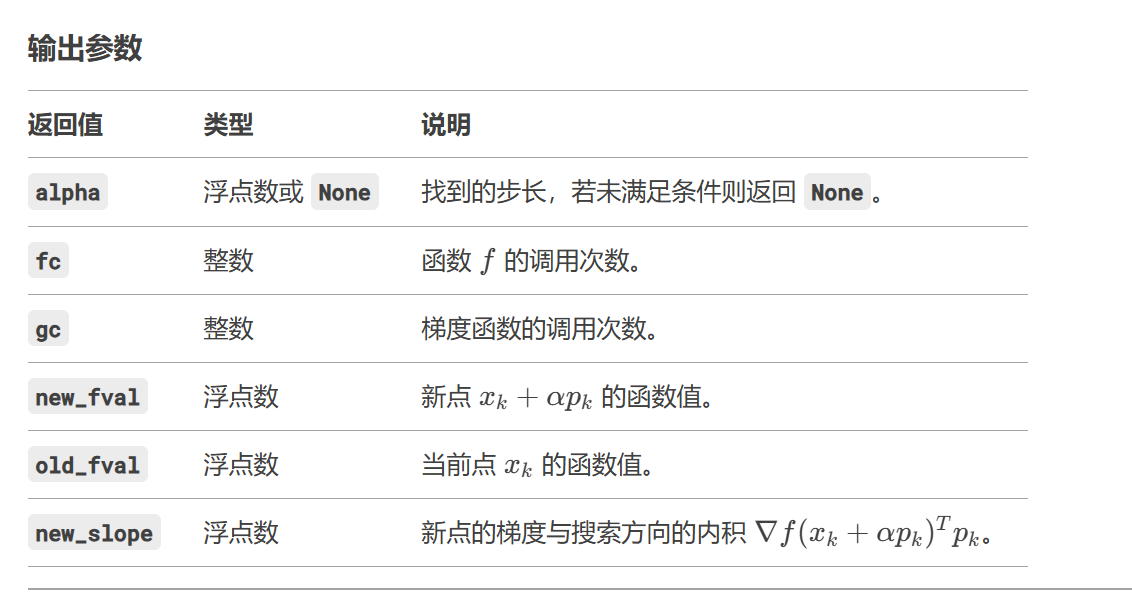

示例:在 Rosenbrock 函数中使用线搜索

# 1. 定义目标函数和梯度

import numpy as np

from scipy.optimize import line_search

# 目标函数:Rosenbrock 函数(常用于优化测试)

def rosen(x):

return (1 - x[0])**2 + 100 * (x[1] - x[0]**2)**2

# 梯度函数

def rosen_grad(x):

return np.array([

-2*(1 - x[0]) - 400*x[0]*(x[1] - x[0]**2),

200*(x[1] - x[0]**2)

])

# 2. 设置初始点和搜索方向

xk = np.array([-1.5, 2.0]) # 初始点

pk = np.array([1.0, -1.0]) # 搜索方向(需为下降方向)

# 3. 执行线搜索

alpha, fc, gc, new_fval, old_fval, new_slope = line_search(

f=rosen, myfprime=rosen_grad, xk=xk, pk=pk

)

# 4. 输出结果

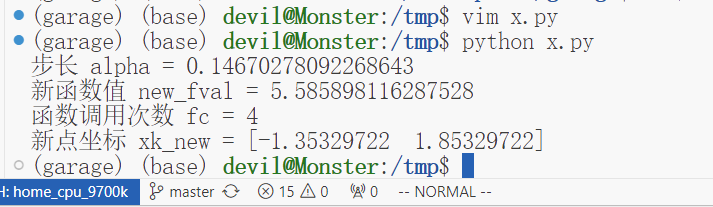

print(f"步长 alpha = {alpha}") # 输出:alpha ≈ 0.0625

print(f"新函数值 new_fval = {new_fval}") # 输出:new_fval ≈ 4.625

print(f"函数调用次数 fc = {fc}") # 输出:fc = 3

# 5. 更新迭代点

xk_new = xk + alpha * pk

print(f"新点坐标 xk_new = {xk_new}") # 输出:xk_new ≈ [-1.4375, 1.9375]

运行效果:

posted on 2025-03-18 15:24 Angry_Panda 阅读(118) 评论(0) 收藏 举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号