使用CPU运行大语言模型(LLM),以清华开源大模型ChatGLM3为例:无需显卡!用CPU搞定大模型运行部署!【详细手把手演示】

教程视频地址:

按照上面视频进行安装配置之前需要注意,python编程环境需要大于等于python3.10,否则会运行报错。下载好GitHub上的项目代码后需要运行pip install -r requirements.txt

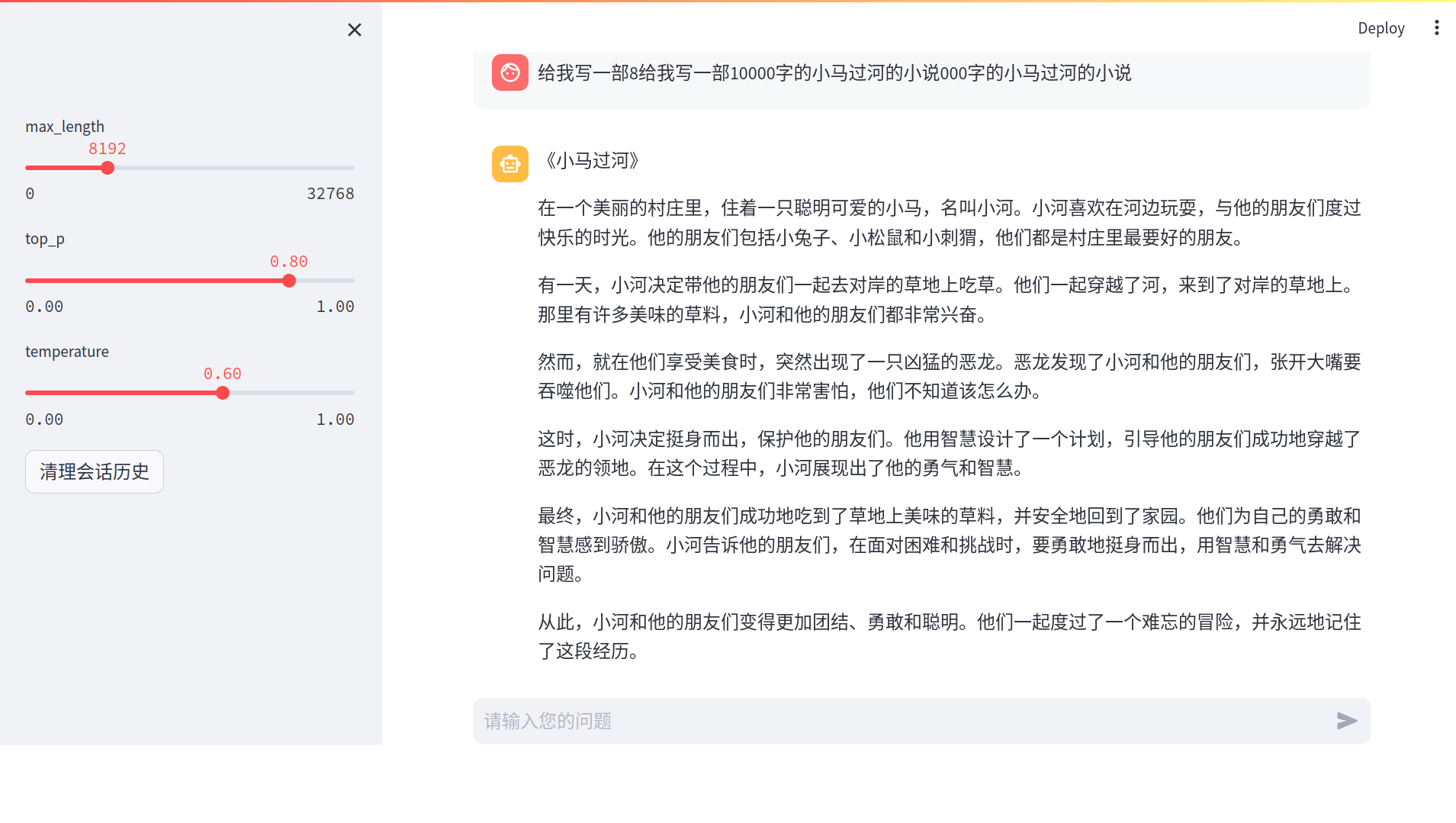

配置好后运行效果:

相关资料:

【ChatGLM3开源大模型仓库】:https://github.com/THUDM/ChatGLM3

【ChatGLM3-6B模型文件】:https://www.modelscope.cn/models/ZhipuAI/chatglm3-6b

【xFasterTransformer大模型推理加速引擎】:https://github.com/intel/xFasterTransformer

本博客是博主个人学习时的一些记录,不保证是为原创,个别文章加入了转载的源地址,还有个别文章是汇总网上多份资料所成,在这之中也必有疏漏未加标注处,如有侵权请与博主联系。

如果未特殊标注则为原创,遵循 CC 4.0 BY-SA 版权协议。

posted on 2024-01-24 23:01 Angry_Panda 阅读(1311) 评论(0) 收藏 举报

浙公网安备 33010602011771号

浙公网安备 33010602011771号