HBase安装配置-单机、伪分布、完全分布

安装前提

安装hbase之前请确保自己的hadoop正常,可以正常启动关闭,并可以运行mapreduce实例。

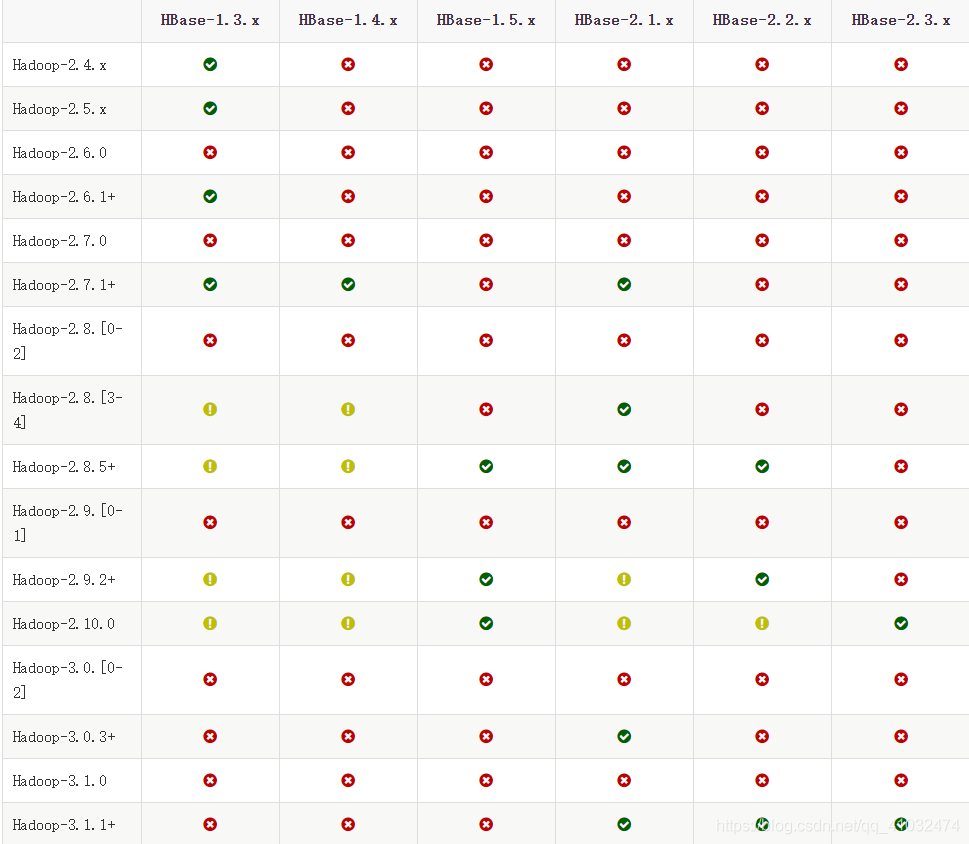

hbase安装需要和hadoop对应版本,随意安装可能导致版本不兼容等问题。以下是对应图表:

下面配置来自头歌平台中Hbase模块,在头歌平台可以在线操作并评测,在这里我只把安装配置部分的文档复制出来做了整理,方便配置虚拟机使用。

头歌访问地址:移动云启 —— HBase从入门到实战 (educoder.net)

HBase单机配置

安装单机版很简单,我们只需要配置JDK的路径即可,我们将JDK的路径配置到conf/下的hbase-env.sh中。

我们先输入echo $JAVA_HOME来复制JAVA_HOME的路径,以方便之后的配置:

接着我们编辑HBase conf目录下的hbase-env.sh文件,将其中的JAVA_HOME指向到你Java的安装目录,最后保存设置:

vim /usr/local/hbase/conf/hbase-env.sh

然后编辑hbase-site.xml文件,在<configuration>标签中添加如下内容:

<configuration>

<property>

<name>hbase.rootdir</name>

<value>file:///root/data/hbase/data</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/root/data/hbase/zookeeper</value>

</property>

<property>

<name>hbase.unsafe.stream.capability.enforce</name>

<value>false</value>

</property>

</configuration>

以上各参数的解释:

hbase.rootdir:这个目录是region server的共享目录,用来持久化Hbase。URL需要是'完全正确'的,还要包含文件系统的scheme。例如,要表示hdfs中的/hbase目录,namenode运行在namenode.example.org的9090端口。则需要设置为hdfs://namenode.example.org:9000 /hbase。默认情况下Hbase是写到/tmp的。不改这个配置,数据会在重启的时候丢失;hbase.zookeeper.property.dataDir:ZooKeeper的zoo.conf中的配置。快照的存储位置,默认是:${hbase.tmp.dir}/zookeeper;hbase.unsafe.stream.capability.enforce:控制HBase是否检查流功能(hflush / hsync),如果您打算在rootdir表示的LocalFileSystem上运行,那就禁用此选项。

配置好了之后我们就可以启动HBase了,在启动之前我们可以将HBase的bin目录配置到/etc/profile中,这样更方便我们以后操作。在/etc/profile的文件末尾添加如下内容:

# SET HBASE_enviroment

HBASE_HOME=/app/hbase-2.1.1

export PATH=$PATH:$HBASE_HOME/bin

HBASE_HOME为你自己本机Hbase的地址。

不要忘了,source /etc/profile使刚刚的配置生效。

接下来我们就可以运行HBase来初步的体验它的功能了:

在命令行输入start-hbase.sh来启动HBase,接着输入jps查看是否启动成功,出现了HMaster进程即表示启动成功了。

启动成功之后,咱们就可以对Hbase进行一些基本的操作了。

HBase伪分布配置

伪分布式意味着HBase仍然在单个主机上运行,但每个HBase的守护程序(HMaster、HRegionServer和Zookeeper)作为单独的进程运行;

实验环境:

hadoop2.7;JDK8;HBase2.1.1;hadoop已安装;JDK已安装,环境变量已配置;HBase压缩包已下载,存放在/opt目录下。

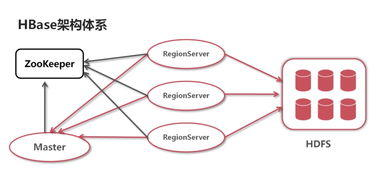

在搭建环境之前我们首先来了解一下HBase分布式环境的整体架构:

我们来简单认识一下与HBase的相关组件:

Zookeeper:

Zookeeper能为HBase提供协同服务,是HBase的一个重要组件,Zookeeper能实时的监控HBase的健康状态,并作出相应处理。

HMaster:

HMaster是HBase的主服务,他负责监控集群中所有的HRegionServer,并对表和Region进行管理操作,比如创建表,修改表,移除表等等。

HRegion:

HRegion是对表进行划分的基本单元,一个表在刚刚创建时只有一个Region,但是随着记录的增加,表会变得越来越大,HRegionServer会实时跟踪Region的大小,当Region增大到某个值时,就会进行切割(split)操作,由一个Region切分成两个Region。

HRegionServer:

HRegionServer是RegionServer的实例,它负责服务和管理多个HRegion 实例,并直接响应用户的读写请求。

总的来说,要部署一个分布式的HBase数据库,需要各个组件的协作,HBase通过Zookeeper进行分布式应用管理,Zookeeper相当于管理员,HBase将数据存储在HDFS(分布式文件系统)中,通过HDFS存储数据,所以我们搭建分布式的HBase数据库的整体思路也在这里,即将各个服务进行整合。

接下来,我们就一起来搭建一个伪分布式的HBase。

配置与启动伪分布式HBase

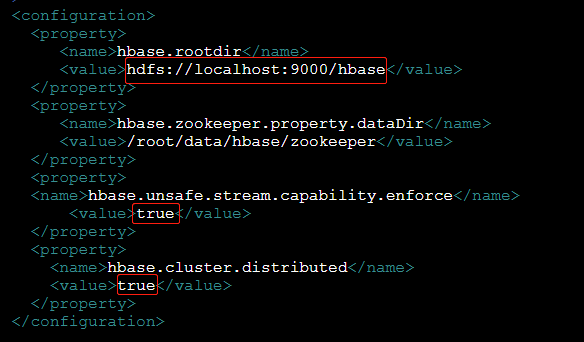

如果你已经完成了单节点HBase的安装,那伪分布式的配置对你来说应该很简单了,只需要修改hbase-site.xml文件即可:

vim /app/hbase-2.1.1/conf/hbase-site.xml

在这里主要有两项配置:

1.开启HBase的分布式运行模式,配置hbase.cluster.distributed为true代表开启HBase的分布式运行模式:

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

2.是设置HBase的数据文件存储位置为HDFS

的/hbase目录,要注意的是在这里我们不需要在HDFS中手动创建hbase目录,因为HBase会帮我们自动创建。

<property>

<name>hbase.rootdir</name>

<value>hdfs://localhost:9000/hbase</value>

</property>

修改之后hbase-site.xml的<configuration>代码:

标红部分为我们需要注意的配置。我们在设置单节点的时候将hbase.unsafe.stream.capability.enforce属性值设置为了false,在这里我们需要注意设置它的值为true,或者干脆删除这个属性也是可以的。

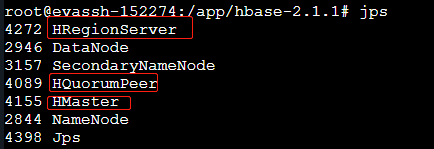

配置完成之后,我们需要先启动Hadoop,命令为:start-dfs.sh,然后启动HBase,最后输入jps查看启动的进程:

如果出现HMaster和HRegionServer以及HQuorumPeer三个服务则代表伪分布式环境已经搭建成功了。

在HDFS中验证

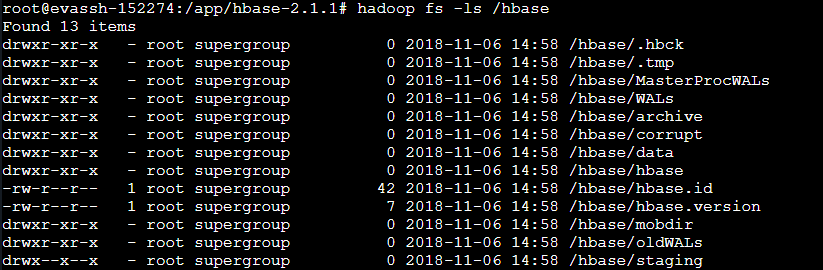

接下来我们进一步验证:在HDFS中检查HBase文件。

如果一切正常,HBase会在HDFS中自动建立自己的文件,在上述配置文件中,设置的文件位置为/hbase,我们输入hadoop fs -ls /hbase即可查看,如下图所示,分布式文件系统(HDFS)中hbase文件夹已经创建了:

HBase完全分布安装配置

1. 下载安装

使用HBase2.4.6版本。下载完成后解压到指定目录,修改文件名为hbase。

tar -zxf hbase-2.4.6-bin.tar.gz

mv hbase-2.4.6 /usr/local/hbase

2. 修改配置文件

hbase-env.sh

为HBase设置Java目录,并从conf文件夹打开hbase-env.sh文件。编辑JAVA_HOME环境变量,改变路径到当前JAVA_HOME变量。

cd /usr/local/hbase/conf

vi hbase-env.sh

export HBASE_MANAGES_ZK=false

export JAVA_HOME=/usr/local/jdk

export HBASE_CLASSPATH=/usr/local/hadoop/etc/hadoop

hbase-site.xml

cd /usr/local/hbase/conf

vi hbase-site.xml

<configuration>

<property>

<name>hbase.rootdir</name>

<value>hdfs://master:9000/hbase</value>

</property>

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<property>

<name>hbase.master</name>

<value>hdfs://master:6000</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>master,slave1,slave2</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/usr/local/zookeeper</value>

</property>

<!-- 在分布式的情况下一定要设置,不然容易出现Hmaster起不来的情况 -->

<property>

<name>hbase.unsafe.stream.capability.enforce</name>

<value>false</value>

</property>

</configuration>

regionservers

在这里列出了希望运行的全部 HRegionServer,一行写一个 host。列在这里 的 server 会随着集群的启动而启动,集群的停止而停止。

vi regionservers

slave1

slave2

hadoop 配置文件拷入 hbase 的 conf 目录下

当前位置为 hbased 的conf 配置文件夹

cp /usr/local/hadoop/etc/hadoop/hdfs-site.xml .

cp /usr/local/hadoop/etc/hadoop/core-site.xml .

3. 分发hbase

scp -r /usr/local/hbase root@slave1:/usr/local/

scp -r /usr/local/hbase root@slave2:/usr/local/

4. 配置环境变量

vi /etc/profile

# set hbase environment

export HBASE_HOME=/usr/local/hbase

export PATH=$PATH:$HBASE_HOME/bin

source /etc/profile

5. 运行测试

开始hadoop,只在master上运行

cd /usr/local/hadoop

sbin/start-all.sh

开启zookeeper,每台虚拟机都执行

cd /usr/local/zookeeper

bin/zkServer.sh start

再在master上执行

cd /usr/local/hbase

bin/start-hbase.sh

三台虚拟机分布执行,master出现HMaster,slave出现HRegionServer

jps

访问master的hbase web界面

http://master IP:16010/master-status

进入hbase shell,分布查看hbase状态和版本

hbase shell

status

version

浙公网安备 33010602011771号

浙公网安备 33010602011771号