神经网络与深度学习学习笔记(三)

神经网络与深度学习学习笔记(三)

一、卷积神经网络基础

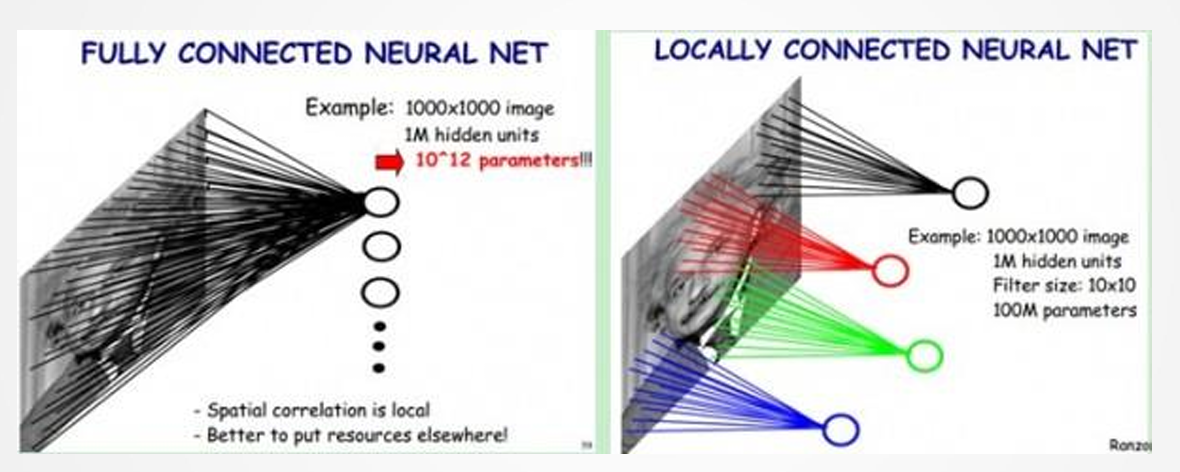

1. 全连接网络问题

1.1 全连接网络的局限性

-

参数爆炸:输入为 \(1000 \times 1000\) 图像时,隐含层1M节点需 \(10^{12}\) 级参数

-

空间相关性未利用:图像局部特征未被有效提取

![]()

-

改进方案:

- 局部连接网络:每个节点仅连接上一层的局部区域

- 分层特征提取:模仿人类视觉分层处理机制

1.2 深度学习平台对比

| 库名 | 发布者 | 特点 |

|---|---|---|

| TensorFlow | 多语言支持,生态完善 | |

| PyTorch | 动态计算图,易用性强 | |

| MXNet | Amazon/DMLC | 分布式训练支持 |

| PaddlePaddle | 百度 | 中文文档丰富,工业级优化 |

2. 卷积神经网络基础

2.1 卷积操作

- 填充(Padding):在矩阵边界补零,控制输出尺寸

- 公式:输出尺寸 = \(\frac{n + 2p - f}{s} + 1\)

- 步长(Stride):卷积核移动步幅,影响特征图降采样速率

- 多通道卷积:RGB三通道分别卷积后求和,输出单通道特征图

2.2 池化操作

- 最大池化:取局部区域最大值,保留显著特征

- 平均池化:取局部区域均值,平滑特征响应

- 作用:降维、平移不变性、防止过拟合

2.3 经典网络结构

- LeNet-5(1998):

- 结构:输入 → 卷积 → 池化 → 卷积 → 池化 → 全连接 → 输出

- 特点:首次应用于手写数字识别,5层可训练层

- 参数量:约6万

- AlexNet(2012):

- 改进:ReLU激活、Dropout、数据增强、双GPU训练

- 结构:5卷积层 + 3全连接层,参数量6000万

- VGG-16(2014):

- 特点:3×3小卷积核堆叠,结构规整

- 参数量:1.38亿,层数16层

3. 残差网络(ResNet)

3.1 残差块设计

- 核心思想:引入跨层连接(Shortcut),解决梯度消失

\[ H(x) = F(x) + x \] - 残差块结构:

- 主路径:卷积 → ReLU → 卷积

- 支路:恒等映射或1×1卷积调整维度

3.2 残差网络优势

- 深层训练稳定性:通过残差学习缓解梯度消失

- 通用规律:

- 网络加深时,特征图尺寸减半,通道数翻倍

- 使用批量归一化(BatchNorm)加速收敛

4. Inception网络

- 多尺度卷积:并行使用1×1、3×3、5×5卷积核,融合多尺度特征

- 1×1卷积降维:减少计算量,增加非线性

- Inception模块:

[ \text{输出} = \text{Concat}(1\times1, 3\times3, 5\times5, \text{MaxPool}) ]

二、深度学习视觉应用

1. 常用数据集

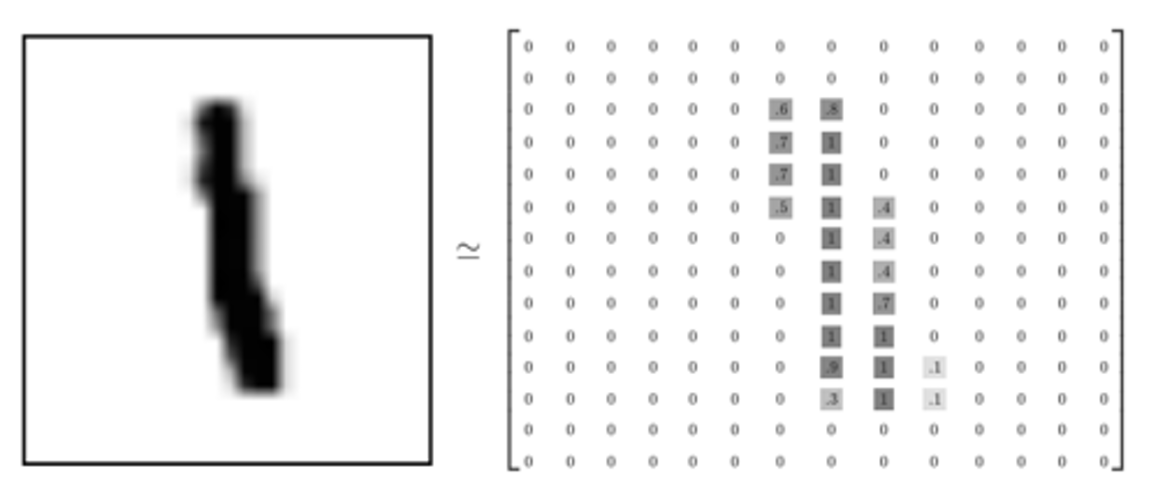

1.1 MNIST/Fashion-MNIST

-

MNIST:6万训练+1万测试,28×28灰度手写数字

![]()

-

Fashion-MNIST:10类服装图像,替代MNIST用于算法测试

1.2 CIFAR-10

- 10类物体,5万训练+1万测试,32×32彩色图像

- 类别:飞机、汽车、鸟、猫、鹿、狗、青蛙、马、船、卡车

1.3 PASCAL VOC

- 20类物体检测与分割,1.1万标注图像

- 标注格式:XML文件描述边界框和类别

1.4 MS COCO

- 80类物体,33万图像,目标检测、分割、关键点任务

- 特点:复杂场景,小目标密集

2. 评价指标

2.1 精确率与召回率

-

混淆矩阵:

预测正类 预测负类 实际正类 TP FN 实际负类 FP TN -

计算公式:

[ \text{精确率} = \frac{TP}{TP + FP}, \quad \text{召回率} = \frac{TP}{TP + FN} ]

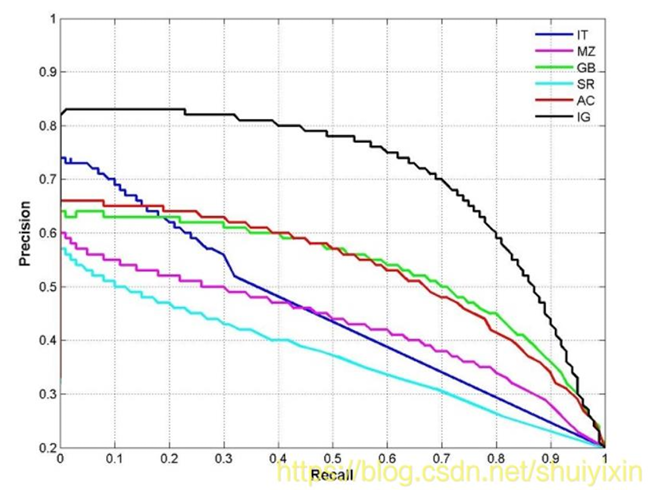

2.2 平均精度(mAP)

-

AP计算:对P-R曲线积分,取各类别AP的平均值

\[ AP = \sum_{k=1}^{N} P(k) \Delta r(k) \]

![]()

-

mAP意义:综合反映多类别检测性能

3. 目标检测与YOLO

3.1 YOLO核心思想

- 一步检测:将检测任务转化为回归问题,直接输出边界框和类别

- 网格划分:图像分为 \(S \times S\) 网格,每个网格预测 \(B\) 个边界框

- 输出张量:7×7×30(YOLOv1),包含坐标、置信度、类别概率

3.2 YOLO损失函数

- 五项损失:

\[ \lambda_{\text{coord}} \sum (x-\hat{x})^2 + \lambda_{\text{coord}} \sum (\sqrt{w}-\sqrt{\hat{w}})^2 \]

\[ + \sum (C-\hat{C})^2 + \lambda_{\text{noobj}} \sum (C-\hat{C})^2 + \sum (p-\hat{p})^2 \] - 超参数:\(\lambda_{\text{coord}} = 5\), \(\lambda_{\text{noobj}} = 0.5\)

3.3 非极大值抑制(NMS)

- 步骤:

- 按置信度排序,保留最高得分的边界框

- 计算IoU,剔除重叠度高的框

- 重复直至处理完所有候选框

3.4 YOLO发展

- YOLOv3:

- DarkNet-53骨干网络,多尺度预测(13×13, 26×26, 52×52)

- 使用CIoU损失,提升定位精度

- YOLOv5:

- 引入CSP结构,Focus切片操作

- 自适应锚框计算,Mosaic数据增强

4. 全卷积网络与语义分割

4.1 FCN(全卷积网络)

- 核心思想:将全连接层替换为卷积层,支持任意尺寸输入

- 跳层连接:融合浅层细节与深层语义信息

4.2 DeepLab系列

- 空洞卷积:扩大感受野,保留空间分辨率

- 条件随机场(CRF):后处理优化边界

三、总结与实践建议

1. 关键总结

- 经典网络:LeNet-5→AlexNet→VGG→ResNet→Inception,结构逐渐深化

- 目标检测:YOLO系列兼顾速度与精度,适合实时应用

- 评价指标:mAP是目标检测的核心指标,需关注类别平衡

2. 实践建议

- 数据预处理:标准化、数据增强(翻转、裁剪、Mosaic)

- 模型选择:

- 轻量级任务:YOLOv5s

- 高精度需求:YOLOv8/9

- 调参重点:学习率调度、损失函数权重、NMS阈值

浙公网安备 33010602011771号

浙公网安备 33010602011771号