数据挖掘学习笔记_第五章 支持向量机

第五章 支持向量机

Support vector machines 支持向量机是通过支持向量运算的一种分类器。

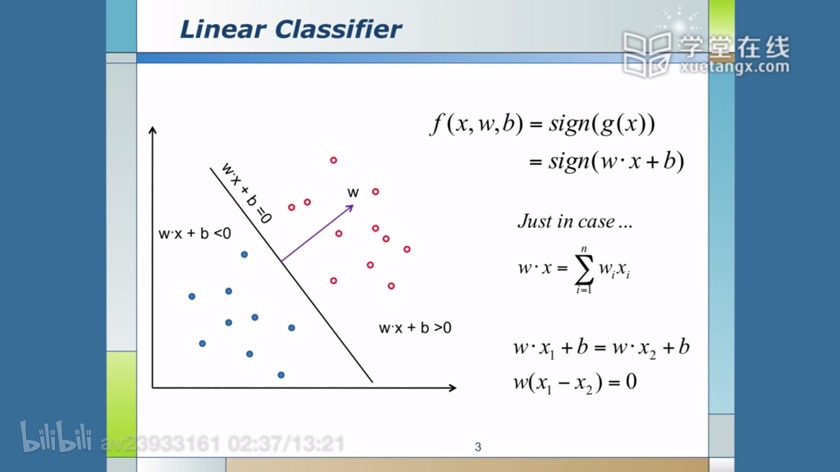

Linear Classfiers 线性分类:在二维空间中,通过一条直线分类,在n维空间中可以通过p-1维的超平面分类。

Distance to Hyperplane 到超平面的距离

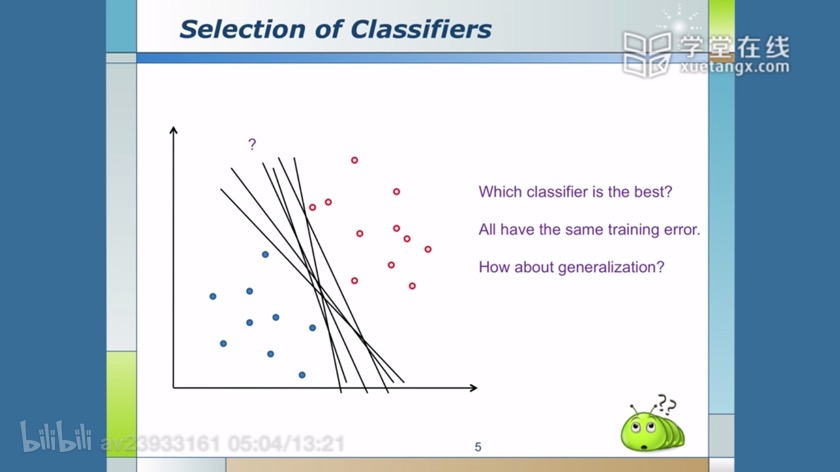

Selection of Classfiers 如何选择分类器呢??

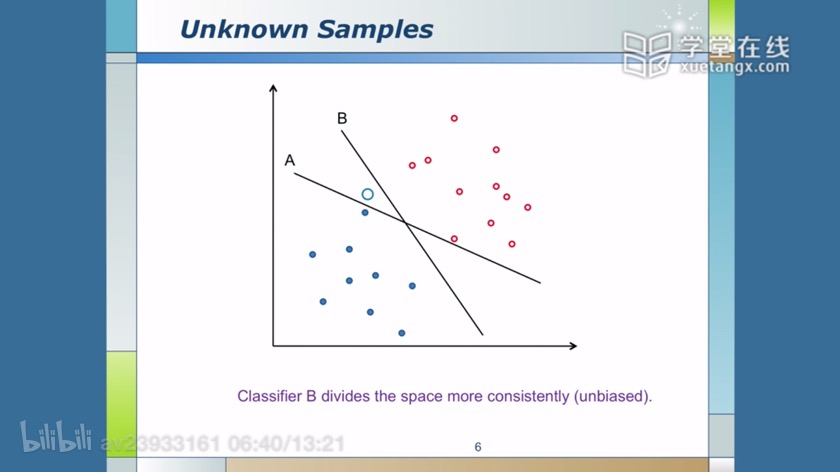

Unknow Sample B分类明显更好些

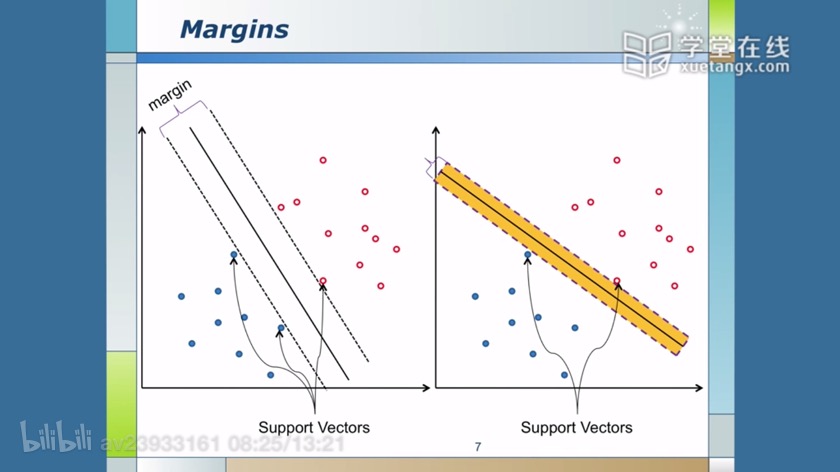

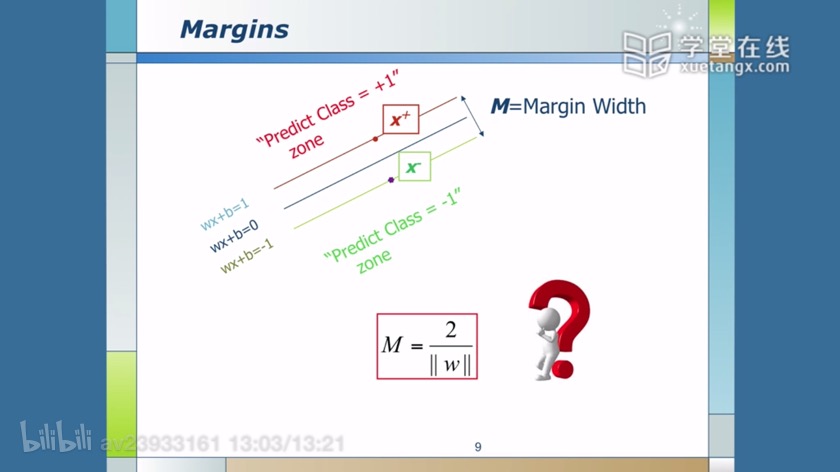

Margins and Support vectors 超平面有很多,我们要找到一个最佳的。因此,增加一个约束条件:这个超平面到每边最近数据点的距离是最大的。也成为最大间隔超平面(maximum-margin hyperplane)。这个分类器也成为最大间隔分类器(maximum-margin classifier)。

核心思想:SVM的目的是找到一个线性分类的最佳超平面

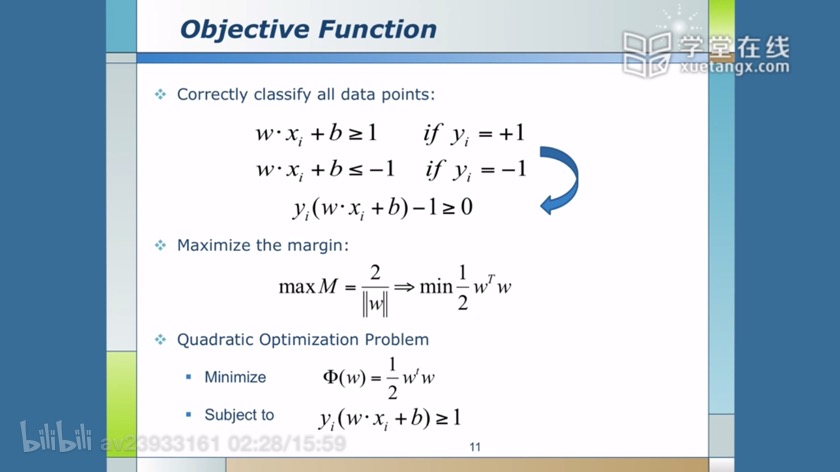

Objective Function SVM的解决问题的思路是找到离超平面的最近点,通过其约束条件求出最优解。

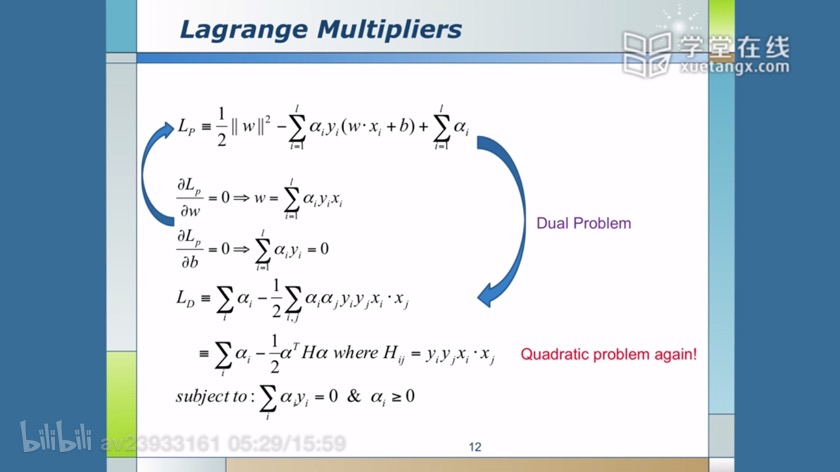

Lagrange Multifiers 使用拉格朗日乘数法

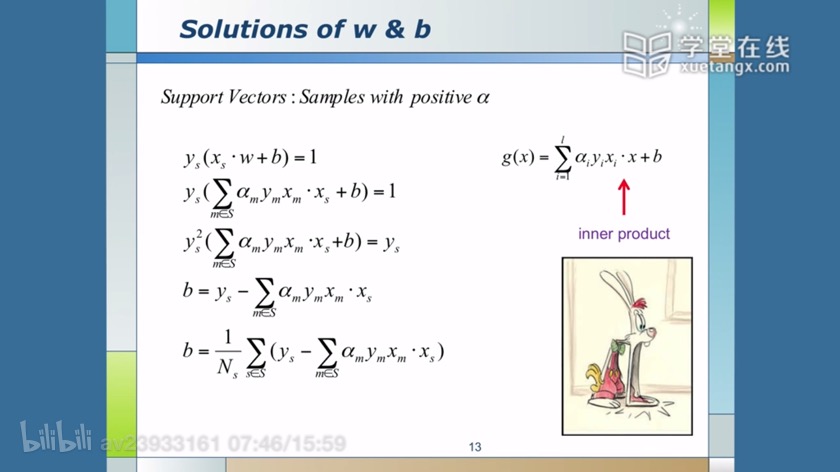

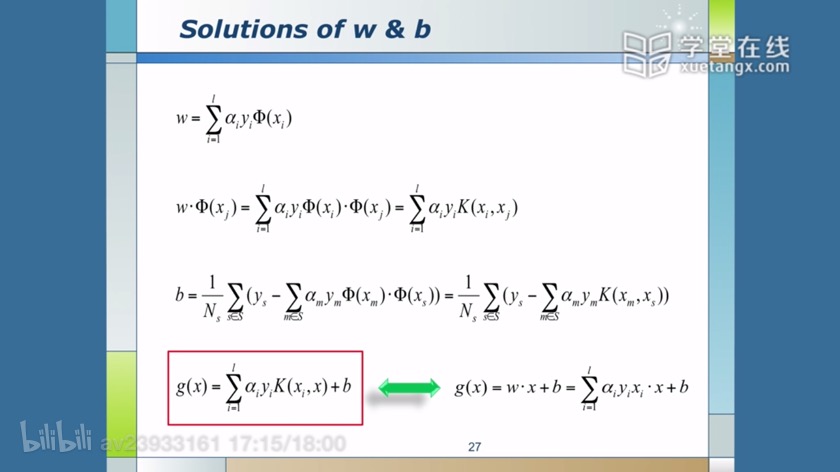

Solutions of w & b 求解出w和b

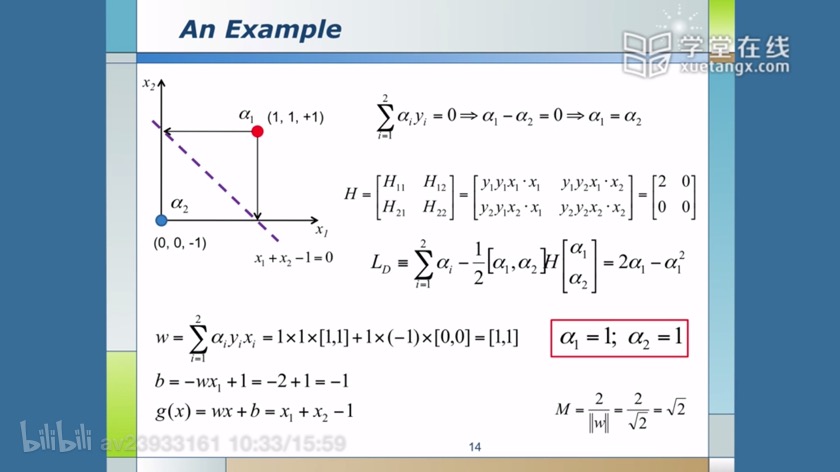

An Example 如下面这个例子。

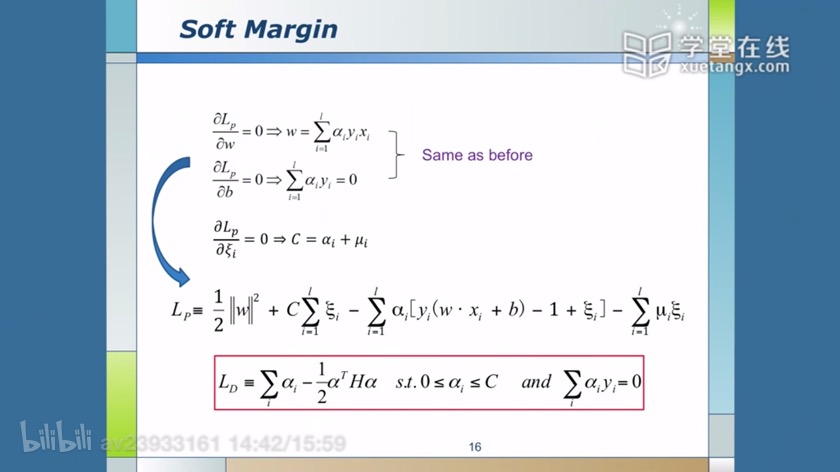

Soft Maigins 有时候往往会存在少数的异常点,导致无法找到一个合适的超平面,为了解决这个问题,引入了松弛变量

- 参数C,越大表明影响越严重。C应该一个大于0值。其实C也不能太小,太小了就约束α了,比如200。

- 参数ξ,对所有样本数据起效的松弛变量,比如:0.0001。

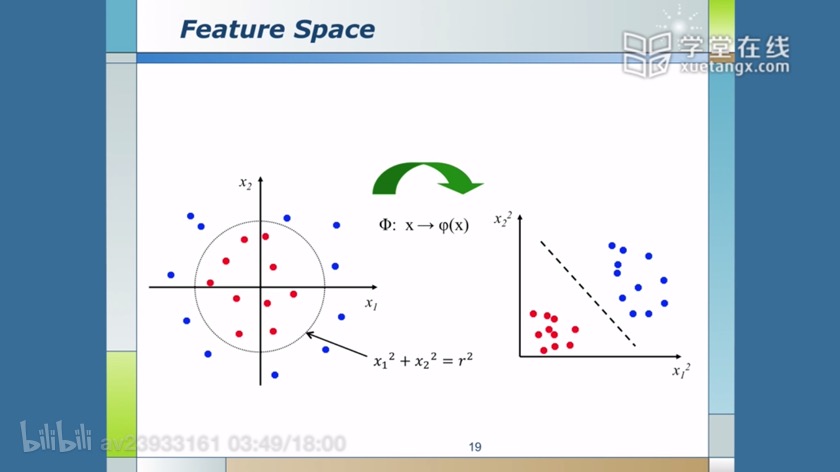

Non-linear SVMs 非线性分类的问题:映射到高纬度,使用核函数

Feature Space 特征空间

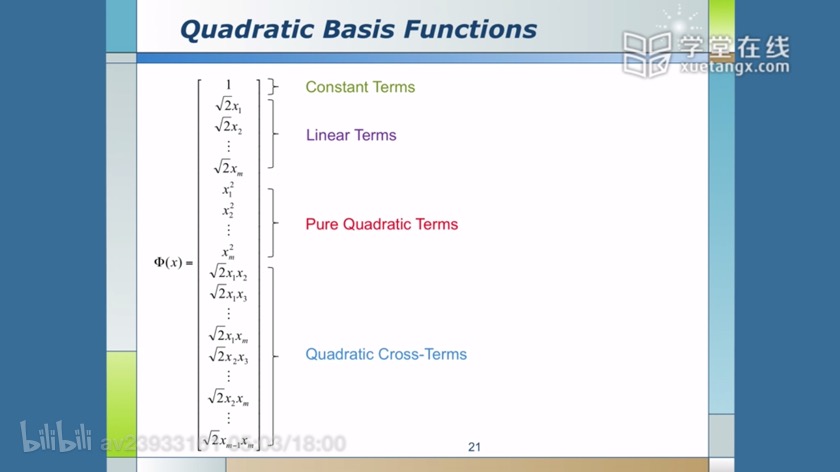

Quadratic Basis Function

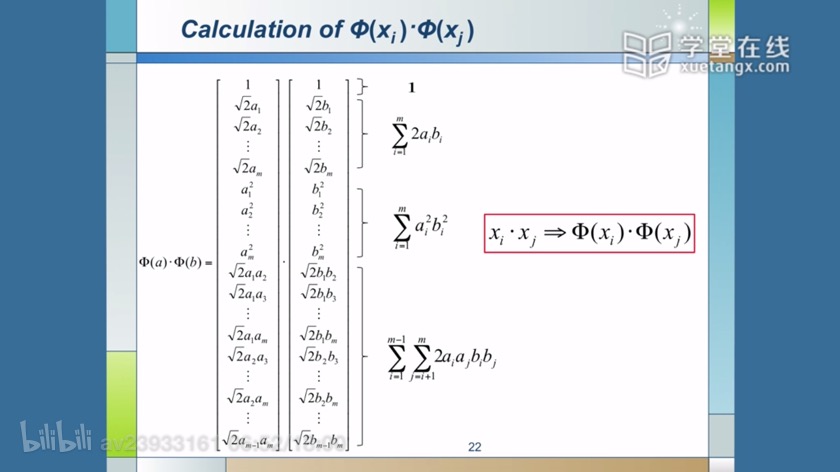

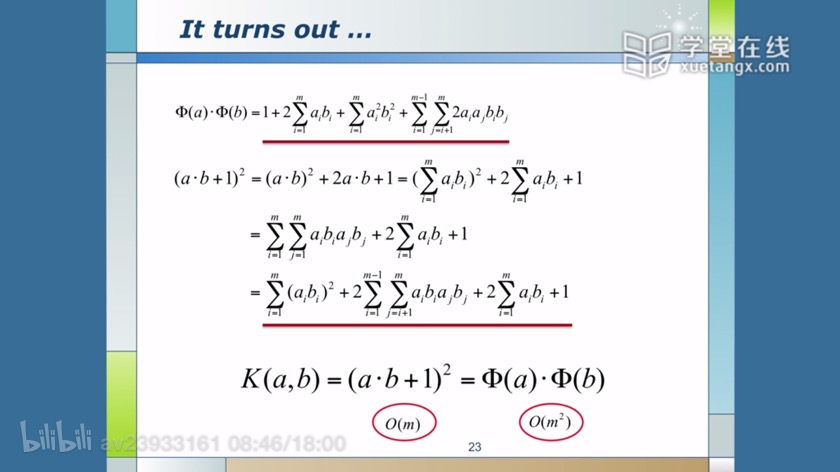

Calculation of them 计算高维空间先的内积,结果变成只用计算低维空间的内积

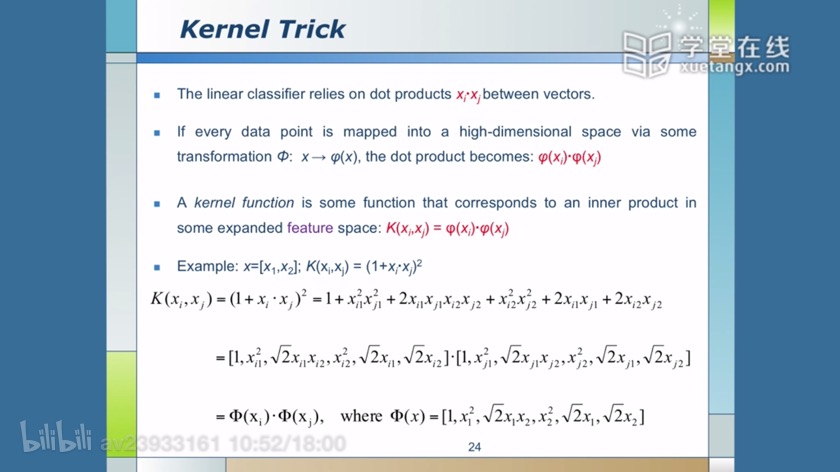

Kernel Trick 核函数也叫核技巧

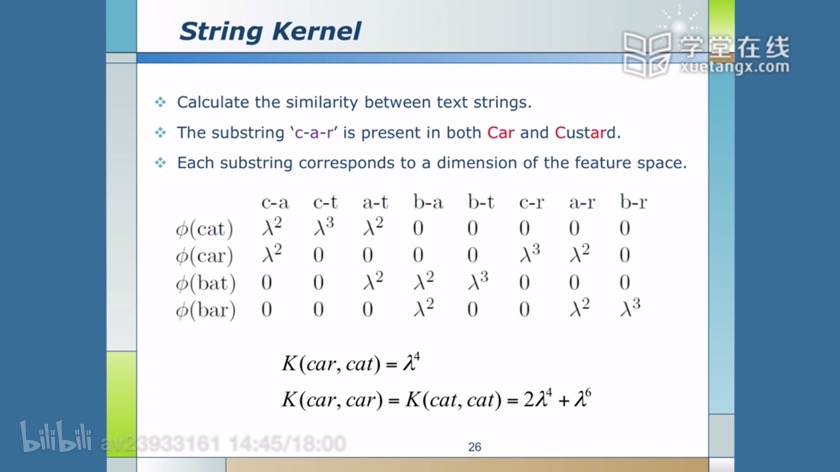

String Kernel 下面是一个运用到单词字符中的例子

Solution of w & b 计算出w和b

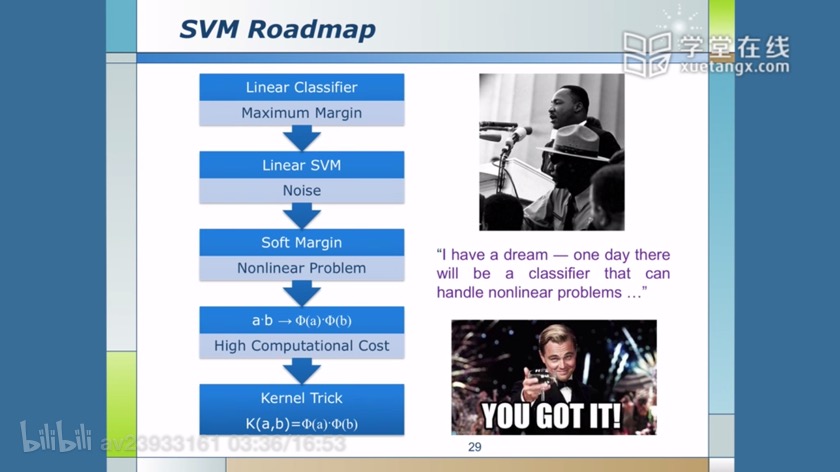

SVM Roadmap svm的研究路程

Reading Martials 阅读资料

N. Cristianini and J. Shawe-Taylor, An Introduction to Support Vector Machines and Other Kernel-Based Learning Methods. Cambridge University Press, 2000.

C. Burges, “A Tutorial on Support Vector Machines for Pattern Recognition”. Data Mining and Knowledge Discovery, vol. 2, pp. 121-167, 1998.

H. Lodhi et al., “Text Classification Using String Kernels”. The Journal of Machine Learning Research, vol. 2, pp. 419-444, 2002.

Online Resources

http://www.kernel-machines.org/

http://www.support-vector-machines.org/

http://www.tristanfletcher.co.uk/SVM%20Explained.pdf

http://www.csie.ntu.edu.tw/~cjlin/libsvm/