Transformer

transformer的整体结构

在机器翻译中,transformer可以将语言翻译成另一种语言,如果把transformer看成一个黑盒,那么其结构如下图所示:

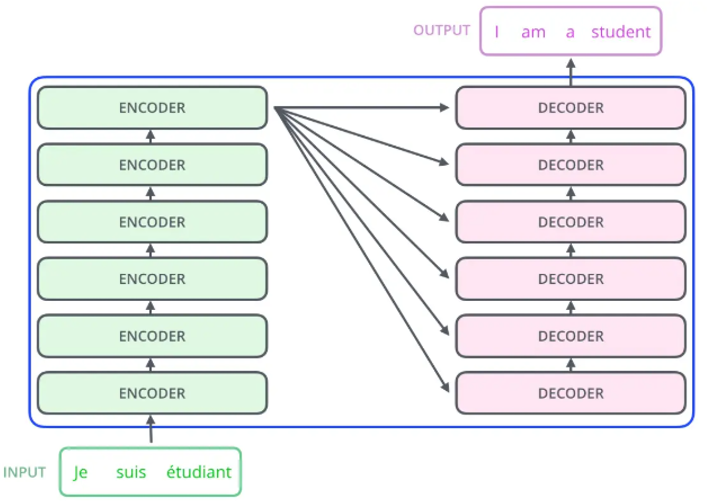

拆开这个黑盒子,可以看到transformer由若干个编码器和解码器组成,如下图所示:

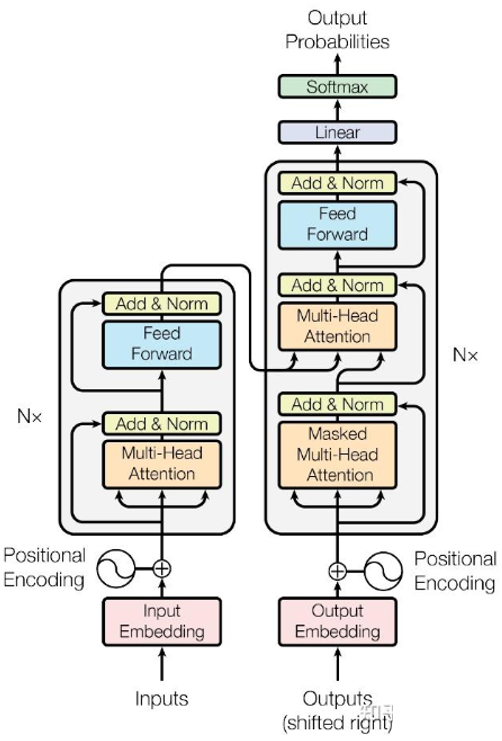

继续讲encoder和decoder拆开,可以看到完整的结构,如下图所示:

可以看到encoder包含一个multi-head attention模块,是由多个self-attention组成,而decoder包含两个multi-head attention。multi-head attention 上方还包括一个Add & Norm 层,Add表示残差连接用于防止网络退化,Norm表示Layer Normalization,用于对每一层的激活值进行归一化。

浙公网安备 33010602011771号

浙公网安备 33010602011771号