scikit基础与机器学习入门(1)背景介绍

scikit基础与机器学习入门(1)

第一章仅对概念进行大略地描述,具体算法的具体原理后续再说

0-4

机器学习的分类

第一类是无监督学习(unsupervised learning),指的是从信息出发自动寻找规律,分析数据的结 构,常见的无监督学习任务有聚类,降维,密度估计,关联分析等。

第二类是监督学习(supervised learning),监督学习指的是使用带标签的数据去训练模型,并预测未 知数据的标签。监督学习有两种,当预测的结果是离散值时属于分类(classification)问题,当预测的 结果是连续值时属于回归(regression)问题。

第三类为强化学习(reinforcement learning),是学习系统从环境到行为映射的学习,以使奖励信号 (强化信号)函数值最大。常用于智能控制机器人和决策问题

逻辑回归,决策树,支持向量机

逻辑回归

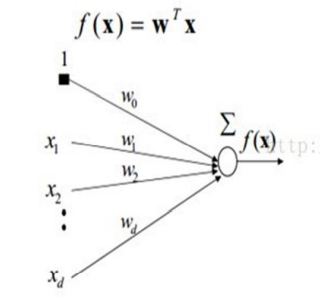

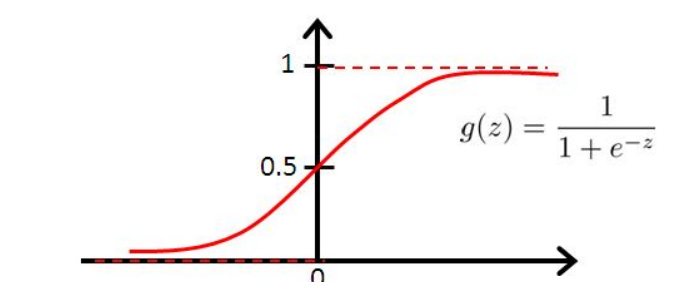

logistic regression 算法是经典的分类算法,基本思想是构造一个概率的拟合函数

逻辑回归模型的基本结构相当于在线性回归基础上增加了一个sigmoid激活函数。

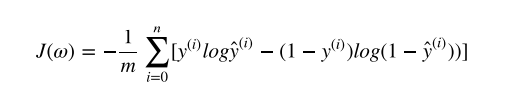

回归时通过使损失函数极小化进行求解

决策树

决策树的基本思想是根据样例去推断其背后的树形知识表征

根据条件层层筛选的过程都可以看成决策树

如下图的择偶标准(属鼠哭了)

支持向量机

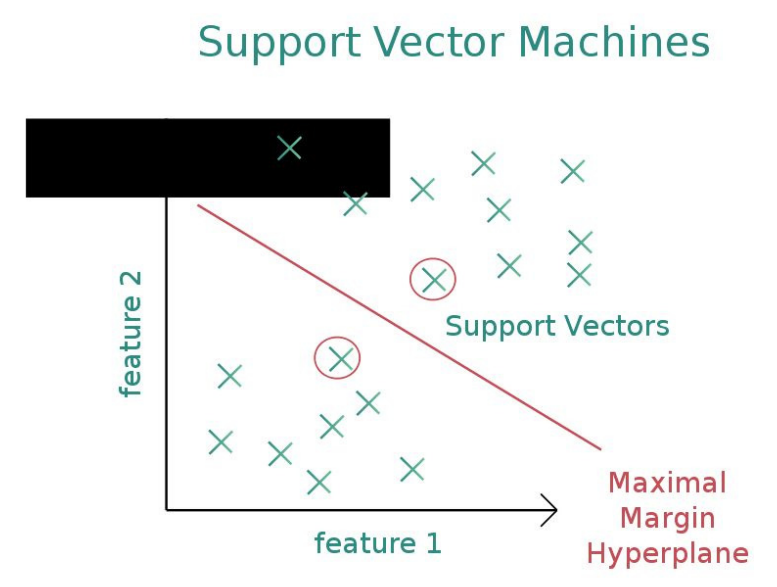

支持向量机SVM(support vector machine)的基本思想是寻找最大间隔的分割超平面。离分割超平面 最近的这些样本点称为支持向量。

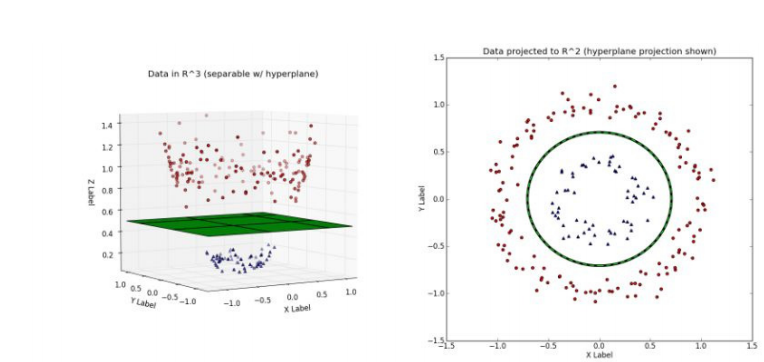

有时候,会出现线性不可分的情况,可以引入核函数对特征空间作适当变换

DNN,CNN,RNN

DNN

DNN(Deep Neural Networks,深度神经网络)是一种相对浅层机器学习模型具有更多参数,需要更多 数据进行训练的机器学习算法。

神经网络中的单个神经元和逻辑回归具有相似的结构。 神经网络通过在数据集上使用正向传播(Forward propagation)和反向传播(backward propagation)算法来寻找使得损失函数最小的神经元参数

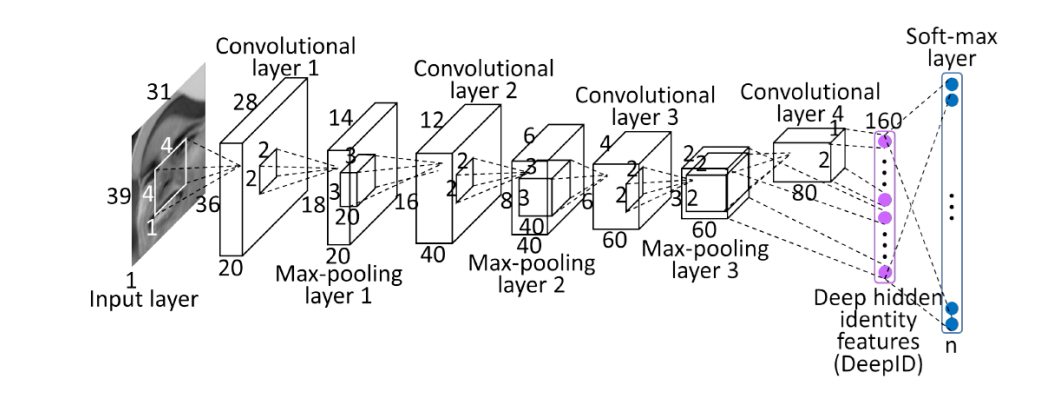

CNN

CNN(Convolutional Neural Networks,卷积神经网络)是一种从局部特征开始学习并逐渐整合的神经 网络。卷积神经网络通过卷积层来进行特征提取,通过池化层进行降维,相比较全连接的神经网络, 卷积神经网络降低了模型复杂度,减少了模型的参数,可以减少过拟合。卷积神经网络在图像识 别,语音识别等领域都有非常好的效果

RNN

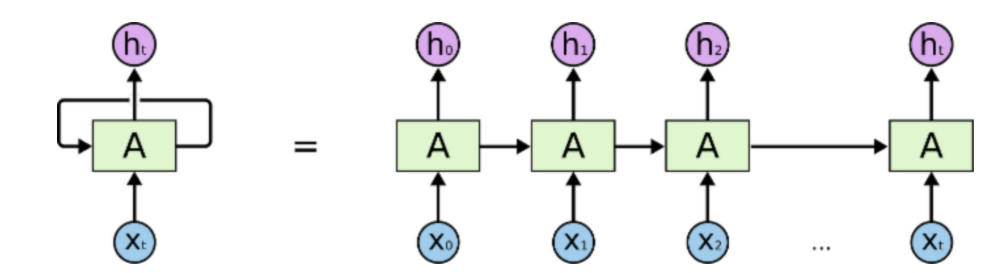

RNN(Recurrent Neural Networks,循环神经网络)是一种能够处理序列模型的神经网络,其输入和输 出可以是序列。RNN的显著特点是某个神经元在某一时刻的输出会在下一个时刻作为该神经元的输 入信号。RNN 在语音识别,语言建模,翻译,图片描述等问题上取得了较大的成功

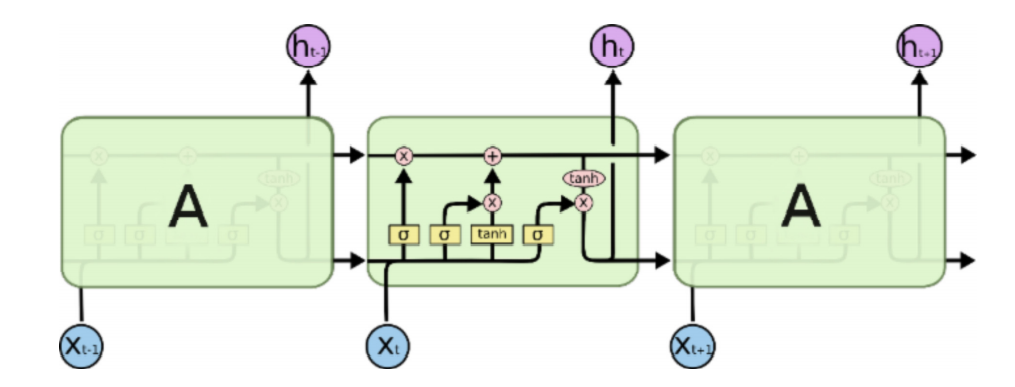

在普通的RNN中,较久远的相关信息容易被遗忘。为了解决对长期信息的依赖问题,LSTM(Long Short Term 长短记忆模型)应运而生。和普通的RNN相比,LSTM模型的神经元具有一种可以有效保 留长期信息的结构。

通过观察下图可以看到每个神经元有两个输入,分别是代表近期记忆和长期记忆

浙公网安备 33010602011771号

浙公网安备 33010602011771号