【第4次作业】CNN实战

使用VGG模型进行猫狗大战

我们将建一个模型来完成 Kaggle 中的猫狗大战竞赛题目。在这个比赛中,有25000张标记好的猫和狗的图片用做训练,有12500张图片用做测试。

判断是否使用GPU

1 import numpy as np 2 import matplotlib.pyplot as plt 3 import os 4 import torch 5 import torch.nn as nn 6 import torchvision 7 from torchvision import models,transforms,datasets 8 import time 9 import json 10 11 12 # 判断是否存在GPU设备 13 device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu") 14 print('Using gpu: %s ' % torch.cuda.is_available())

1. 下载数据

Jeremy Howard 提供了数据的下载,链接为:http://files.fast.ai/data/dogscats.zip

因为这个代码需要在colab上跑,速度会相对较慢。因此,我们重新整理了数据,制作了新的数据集,训练集包含1800张图(猫的图片900张,狗的图片900张),测试集包含2000张图。

下载地址为:http://fenggao-image.stor.sinaapp.com/dogscats.zip

1 ! wget http://fenggao-image.stor.sinaapp.com/dogscats.zip 2 ! unzip dogscats.zip

2. 数据处理

datasets 是 torchvision 中的一个包,可以用做加载图像数据。它可以以多线程(multi-thread)的形式从硬盘中读取数据,使用 mini-batch 的形式,在网络训练中向 GPU 输送。在使用CNN处理图像时,需要进行预处理。图片将被整理成 的大小,同时还将进行归一化处理。

torchvision 支持对输入数据进行一些复杂的预处理/变换 (normalization, cropping, flipping, jittering 等)。

1 normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) 2 3 vgg_format = transforms.Compose([ 4 transforms.CenterCrop(224), 5 transforms.ToTensor(), 6 normalize, 7 ]) 8 9 data_dir = './dogscats' 10 11 dsets = {x: datasets.ImageFolder(os.path.join(data_dir, x), vgg_format) 12 for x in ['train', 'valid']} 13 14 dset_sizes = {x: len(dsets[x]) for x in ['train', 'valid']} 15 dset_classes = dsets['train'].classes

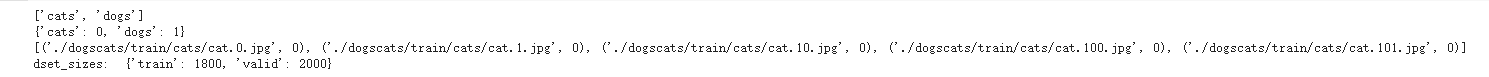

1 # 通过下面代码可以查看 dsets 的一些属性 2 print(dsets['train'].classes) 3 print(dsets['train'].class_to_idx) 4 print(dsets['train'].imgs[:5]) 5 print('dset_sizes: ', dset_sizes)

1 loader_train = torch.utils.data.DataLoader(dsets['train'], batch_size=64, shuffle=True, num_workers=6) 2 loader_valid = torch.utils.data.DataLoader(dsets['valid'], batch_size=5, shuffle=False, num_workers=6) 3 4 5 ''' 6 valid 数据一共有2000张图,每个batch是5张,因此,下面进行遍历一共会输出到 400 7 同时,把第一个 batch 保存到 inputs_try, labels_try,分别查看 8 ''' 9 count = 1 10 for data in loader_valid: 11 print(count, end='\n') 12 if count == 1: 13 inputs_try,labels_try = data 14 count +=1 15 16 print(labels_try) 17 print(inputs_try.shape)

1 # 显示图片的小程序 2 3 def imshow(inp, title=None): 4 # Imshow for Tensor. 5 inp = inp.numpy().transpose((1, 2, 0)) 6 mean = np.array([0.485, 0.456, 0.406]) 7 std = np.array([0.229, 0.224, 0.225]) 8 inp = np.clip(std * inp + mean, 0,1) 9 plt.imshow(inp) 10 if title is not None: 11 plt.title(title) 12 plt.pause(0.001) # pause a bit so that plots are updated

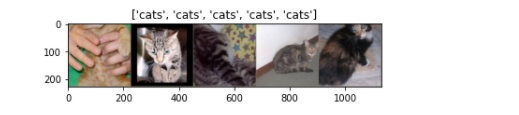

1 # 显示 labels_try 的5张图片,即valid里第一个batch的5张图片 2 out = torchvision.utils.make_grid(inputs_try) 3 imshow(out, title=[dset_classes[x] for x in labels_try])

3. 创建 VGG Model

torchvision中集成了很多在 ImageNet (120万张训练数据) 上预训练好的通用的CNN模型,可以直接下载使用。

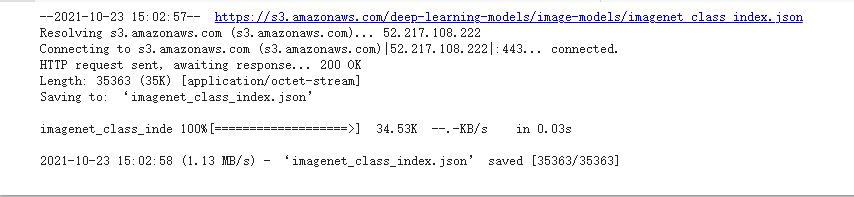

我们直接使用预训练好的 VGG 模型。同时,为了展示 VGG 模型对本数据的预测结果,还下载了 ImageNet 1000 个类的 JSON 文件。

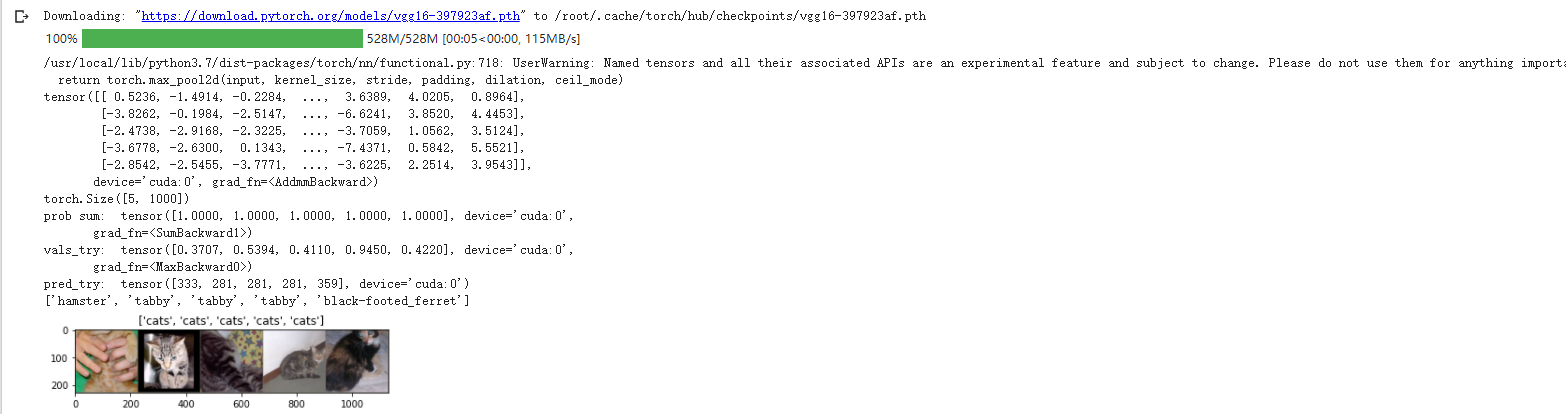

在这部分代码中,对输入的5个图片利用VGG模型进行预测,同时,使用softmax对结果进行处理,随后展示了识别结果。可以看到,识别结果是比较非常准确的。

1 !wget https://s3.amazonaws.com/deep-learning-models/image-models/imagenet_class_index.json

1 model_vgg = models.vgg16(pretrained=True) 2 3 with open('./imagenet_class_index.json') as f: 4 class_dict = json.load(f) 5 dic_imagenet = [class_dict[str(i)][1] for i in range(len(class_dict))] 6 7 inputs_try , labels_try = inputs_try.to(device), labels_try.to(device) 8 model_vgg = model_vgg.to(device) 9 10 outputs_try = model_vgg(inputs_try) 11 12 print(outputs_try) 13 print(outputs_try.shape) 14 15 ''' 16 可以看到结果为5行,1000列的数据,每一列代表对每一种目标识别的结果。 17 但是我也可以观察到,结果非常奇葩,有负数,有正数, 18 为了将VGG网络输出的结果转化为对每一类的预测概率,我们把结果输入到 Softmax 函数 19 ''' 20 m_softm = nn.Softmax(dim=1) 21 probs = m_softm(outputs_try) 22 vals_try,pred_try = torch.max(probs,dim=1) 23 24 print( 'prob sum: ', torch.sum(probs,1)) 25 print( 'vals_try: ', vals_try) 26 print( 'pred_try: ', pred_try) 27 28 print([dic_imagenet[i] for i in pred_try.data]) 29 imshow(torchvision.utils.make_grid(inputs_try.data.cpu()), 30 title=[dset_classes[x] for x in labels_try.data.cpu()])

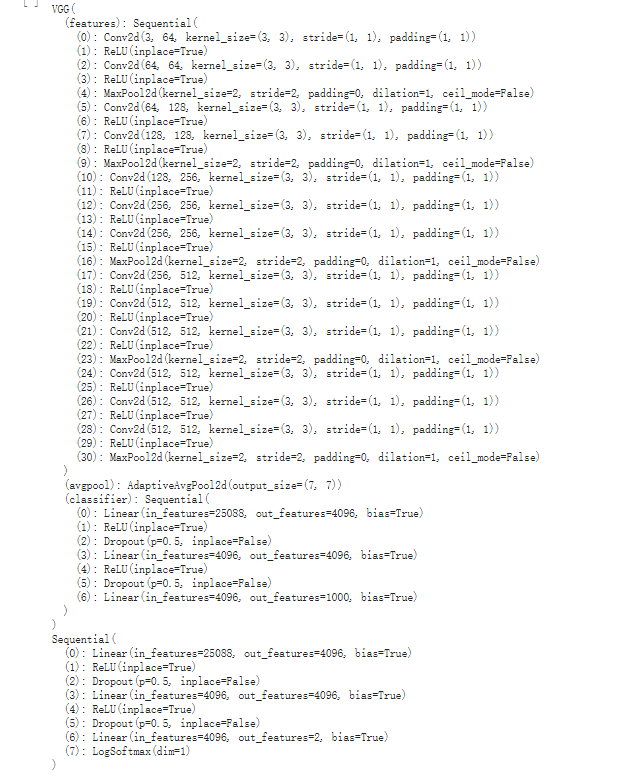

4. 修改最后一层,冻结前面层的参数

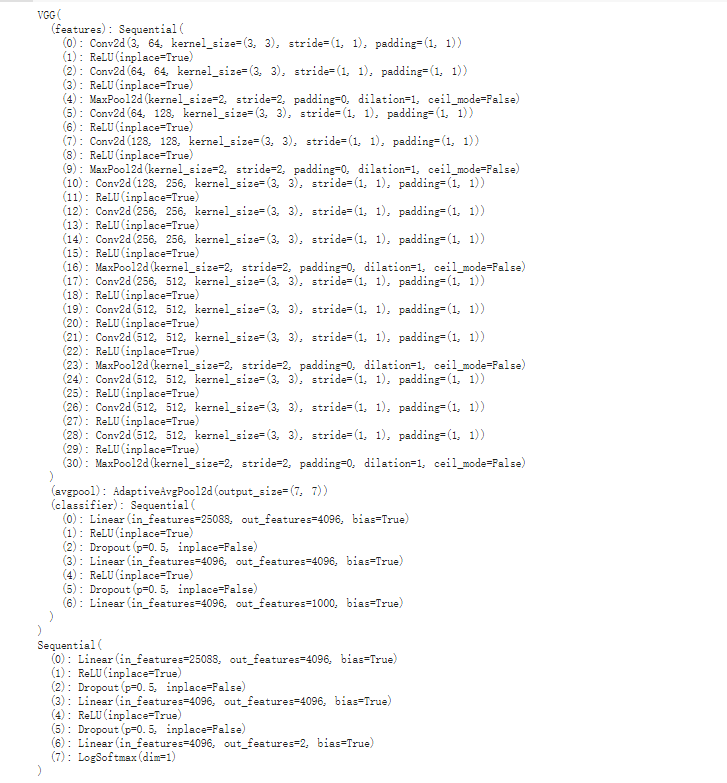

VGG 模型,注意该网络由三种元素组成:

- 卷积层(CONV)是发现图像中局部的 pattern

- 全连接层(FC)是在全局上建立特征的关联

- 池化(Pool)是给图像降维以提高特征的 invariance

我们的目标是使用预训练好的模型,因此,需要把最后的 nn.Linear 层由1000类,替换为2类。为了在训练中冻结前面层的参数,需要设置 required_grad=False。这样,反向传播训练梯度时,前面层的权重就不会自动更新了。训练中,只会更新最后一层的参数。

1 print(model_vgg) 2 3 model_vgg_new = model_vgg; 4 5 for param in model_vgg_new.parameters(): 6 param.requires_grad = False 7 model_vgg_new.classifier._modules['6'] = nn.Linear(4096, 2) 8 model_vgg_new.classifier._modules['7'] = torch.nn.LogSoftmax(dim = 1) 9 10 model_vgg_new = model_vgg_new.to(device) 11 12 print(model_vgg_new.classifier)

5. 训练并测试全连接层

包括三个步骤:第1步,创建损失函数和优化器;第2步,训练模型;第3步,测试模型。

1 from tqdm import trange,tqdm 2 ''' 3 第一步:创建损失函数和优化器 4 损失函数 NLLLoss()的输入是一个对数概率向量和一个目标标签. 5 它不会为我们计算对数概率,适合最后一层是log_softmax()的网络. 6 ''' 7 criterion = nn.NLLLoss() 8 # 学习率 9 lr = 0.0003 10 # 随机梯度下降优化为adam 11 optimizer_vgg = torch.optim.Adam([{'params': model_vgg_new.classifier[6].parameters()},{'params': model_vgg_new.classifier[9].parameters()}],lr = lr) 12 13 ''' 14 第二步:训练模型 15 ''' 16 def train_model(model,dataloader,size,epochs=1,optimizer=None): 17 model.train() 18 max_acc = 0 19 for epoch in range(epochs): 20 running_loss = 0.0 21 running_corrects = 0 22 count = 0 23 for inputs,classes in dataloader: 24 inputs = inputs.to(device) 25 classes = classes.to(device) 26 outputs = model(inputs) 27 loss = criterion(outputs,classes) 28 optimizer = optimizer 29 optimizer.zero_grad() 30 loss.backward() 31 optimizer.step() 32 _,preds = torch.max(outputs.data,1) 33 # statistics 34 running_loss += loss.data.item() 35 running_corrects += torch.sum(preds == classes.data) 36 count += len(inputs) 37 #print('Training: No. ', count, ' process ... total: ', size) 38 epoch_loss = running_loss / size 39 epoch_acc = running_corrects.data.item() / size 40 if epoch_acc>max_acc: 41 max_acc = epoch_acc 42 torch.save(model, '/content/drive/MyDrive/Colab Notebooks/cats_vs_dogs/model_best_new.pth') 43 tqdm.write("\n Got A Nice Model Acc:{:.8f}".format(max_acc)) 44 tqdm.write('\nepoch: {} \tLoss: {:.8f} Acc: {:.8f}'.format(epoch,epoch_loss, epoch_acc)) 45 time.sleep(0.1) 46 47 48 #print('Loss: {:.4f} Acc: {:.4f}'.format(epoch_loss, epoch_acc)) 49 torch.save(model, '/content/drive/MyDrive/Colab Notebooks/cats_vs_dogs/model.pth') 50 tqdm.write("Got A Nice Model") 51 52 53 # 模型训练 54 train_model(model_vgg_new,loader_train,size=dset_sizes['train'], epochs=100,optimizer=optimizer_vgg)

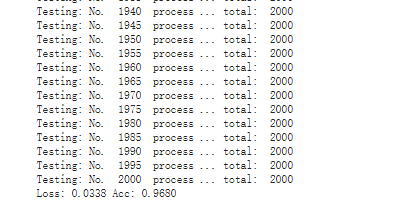

1 def test_model(model,dataloader,size): 2 model.eval() 3 predictions = np.zeros(size) 4 all_classes = np.zeros(size) 5 all_proba = np.zeros((size,2)) 6 i = 0 7 running_loss = 0.0 8 running_corrects = 0 9 for inputs,classes in dataloader: 10 inputs = inputs.to(device) 11 classes = classes.to(device) 12 outputs = model(inputs) 13 loss = criterion(outputs,classes) 14 _,preds = torch.max(outputs.data,1) 15 # statistics 16 running_loss += loss.data.item() 17 running_corrects += torch.sum(preds == classes.data) 18 predictions[i:i+len(classes)] = preds.to('cpu').numpy() 19 all_classes[i:i+len(classes)] = classes.to('cpu').numpy() 20 all_proba[i:i+len(classes),:] = outputs.data.to('cpu').numpy() 21 i += len(classes) 22 print('Testing: No. ', i, ' process ... total: ', size) 23 epoch_loss = running_loss / size 24 epoch_acc = running_corrects.data.item() / size 25 print('Loss: {:.4f} Acc: {:.4f}'.format( 26 epoch_loss, epoch_acc)) 27 return predictions, all_proba, all_classes 28 29 predictions, all_proba, all_classes = test_model(model_vgg_new,loader_valid,size=dset_sizes['valid'])

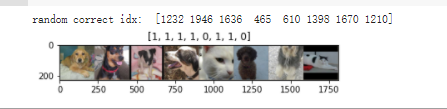

6. 可视化模型预测结果(主观分析)

主观分析就是把预测的结果和相对应的测试图像输出出来看看,一般有四种方式:

- 随机查看一些预测正确的图片

- 随机查看一些预测错误的图片

- 预测正确,同时具有较大的probability的图片

- 预测错误,同时具有较大的probability的图片

- 最不确定的图片,比如说预测概率接近0.5的图片

1 # 单次可视化显示的图片个数 2 n_view = 8 3 correct = np.where(predictions==all_classes)[0] 4 from numpy.random import random, permutation 5 idx = permutation(correct)[:n_view] 6 print('random correct idx: ', idx) 7 loader_correct = torch.utils.data.DataLoader([dsets['valid'][x] for x in idx], 8 batch_size = n_view,shuffle=True) 9 for data in loader_correct: 10 inputs_cor,labels_cor = data 11 # Make a grid from batch 12 out = torchvision.utils.make_grid(inputs_cor) 13 imshow(out, title=[l.item() for l in labels_cor]) 14 15 # 类似的思路,可以显示错误分类的图片,这里不再重复代码

7.VGG模型的加载及迁移学习

1.加载VGG模型。

1 model_vgg = models.vgg16(pretrained=True) 2 model_vgg = model_vgg.to(device)

2.冻结VGG模型前面层的参数,修改最后一层。

1 print(model_vgg) 2 3 model_vgg_new = model_vgg; 4 5 for param in model_vgg_new.parameters(): 6 param.requires_grad = False 7 model_vgg_new.classifier._modules['6'] = nn.Linear(4096, 2) 8 model_vgg_new.classifier._modules['7'] = torch.nn.LogSoftmax(dim = 1) 9 10 model_vgg_new = model_vgg_new.to(device) 11 12 print(model_vgg_new.classifier)

1 import time

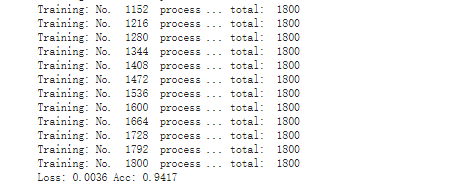

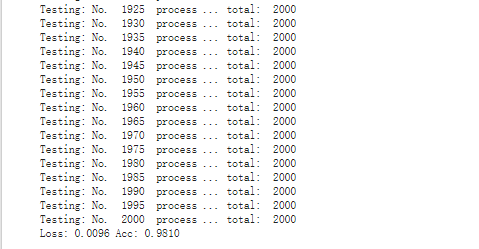

1 ''' 2 第一步:创建损失函数和优化器 3 4 损失函数 NLLLoss() 的 输入 是一个对数概率向量和一个目标标签. 5 它不会为我们计算对数概率,适合最后一层是log_softmax()的网络. 6 ''' 7 criterion = nn.NLLLoss() 8 9 # 学习率 10 lr = 0.001 11 12 # 随机梯度下降 13 optimizer_vgg = torch.optim.SGD(model_vgg_new.classifier[6].parameters(),lr = lr) 14 15 #保存模型的路径 16 log_dir = '/content/drive/MyDrive/ColabNotebooks/model/' 17 ''' 18 第二步:训练模型 19 ''' 20 21 def train_model(model,dataloader,size,epochs=1,optimizer=None): 22 model.train() 23 24 for epoch in range(epochs): 25 running_loss = 0.0 26 running_corrects = 0 27 count = 0 28 for inputs,classes in dataloader: 29 inputs = inputs.to(device) 30 classes = classes.to(device) 31 outputs = model(inputs) 32 loss = criterion(outputs,classes) 33 optimizer = optimizer 34 optimizer.zero_grad() 35 loss.backward() 36 optimizer.step() 37 _,preds = torch.max(outputs.data,1) 38 # statistics 39 running_loss += loss.data.item() 40 running_corrects += torch.sum(preds == classes.data) 41 count += len(inputs) 42 print('Training: No. ', count, ' process ... total: ', size) 43 epoch_loss = running_loss / size 44 epoch_acc = running_corrects.data.item() / size 45 if epoch_acc >= 0.96: #当准确率超过一定数值时,保存模型 46 localtime = time.strftime('%Y-%m-%d_%H:%M:%S') 47 path = log_dir + str(epoch) + '_' + str(epoch_acc) + '_' + localtime 48 torch.save(model, path) 49 print("save: ", path,"\n") 50 print('Loss: {:.4f} Acc: {:.4f} Epoch: {:d}'.format( 51 epoch_loss, epoch_acc, epoch)) 52 53 54 # 模型训练 55 train_model(model_vgg_new,loader_train,size=dset_sizes['train'], epochs=20, 56 optimizer=optimizer_vgg)

3.测试训练好的模型。

1 model_vgg_new_1 = torch.load("/content/model/19_0.9944444444444445_2021-10-24_05:45:28")#之前保存的训练效果较好的模型 2 def test_model(model,dataloader,size): 3 model.eval() 4 predictions = np.zeros(size) 5 all_classes = np.zeros(size) 6 all_proba = np.zeros((size,2)) 7 i = 0 8 running_loss = 0.0 9 running_corrects = 0 10 for inputs,classes in dataloader: 11 inputs = inputs.to(device) 12 classes = classes.to(device) 13 outputs = model(inputs) 14 loss = criterion(outputs,classes) 15 _,preds = torch.max(outputs.data,1) 16 # statistics 17 running_loss += loss.data.item() 18 running_corrects += torch.sum(preds == classes.data) 19 predictions[i:i+len(classes)] = preds.to('cpu').numpy() 20 all_classes[i:i+len(classes)] = classes.to('cpu').numpy() 21 all_proba[i:i+len(classes),:] = outputs.data.to('cpu').numpy() 22 i += len(classes) 23 print('Testing: No. ', i, ' process ... total: ', size) 24 epoch_loss = running_loss / size 25 epoch_acc = running_corrects.data.item() / size 26 print('Loss: {:.4f} Acc: {:.4f}'.format( 27 epoch_loss, epoch_acc)) 28 29 30 test_model(model_vgg_new_1,loader_valid,size=dset_sizes['valid'])

8.在AI研习社猫狗大战赛题的测试集上的表现

1.数据加载

1 device = torch.device("cuda:0" ) 2 normalize = transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) 3 vgg_format = transforms.Compose([ 4 transforms.CenterCrop(224), 5 transforms.ToTensor(), 6 normalize, 7 ]) 8 9 dsets_mine = datasets.ImageFolder(r"/content/cat_dog", vgg_format)#这里的地址是我存放赛题数据集的地址,需要注意的是这个地址只包含test 10 loader_test = torch.utils.data.DataLoader(dsets_mine, batch_size=1, shuffle=False, num_workers=0) 11 12 model_vgg_new = torch.load(r'/content/model/19_0.9944444444444445_2021-10-24_05:45:28')#加载之前保存的模型 13 model_vgg_new = model_vgg_new.to(device)

2.测试模型,并使用一个字典保存结果。

1 dic = {} 2 def test(model,dataloader,size): 3 model.eval() 4 predictions = np.zeros(size) 5 cnt = 0 6 for inputs,_ in tqdm(dataloader): 7 inputs = inputs.to(device) 8 outputs = model(inputs) 9 _,preds = torch.max(outputs.data,1) 10 #这里是切割路径,因为dset中的数据不是按1-2000顺序排列的 11 key = dsets_mine.imgs[cnt][0].split("\\")[-1].split('.')[0] 12 dic[key] = preds[0] 13 cnt = cnt +1 14 test(model_vgg_new,loader_test,size=2000)

3.将上面得到的字典数据按赛题要求封装成csv文件并上传进行在线测试。

1 with open("/content/result6.csv",'a+') as f: 2 for key in range(2000): 3 #这里的yanxishe/test/是我的图片路径,按需更换 4 f.write("{},{}\n".format(key,dic["/content/cat_dog/test/"+str(key)]))

4.进行优化,首先很自然想到的就是将SGD换成Adam。

1 # 随机梯度下降 2 optimizer_vgg = torch.optim.Adam(model_vgg_new.classifier[6].parameters(),lr = lr)

5、查看两次所得的结果,分数略有提升

9.分析小结

代码基本上还是逃不出老师所给的框架,基本都在“代码复现”。主要难点还是在于对整个网络的理解,数据预处理的一些细节,以及对迁移学习的过程的理解。

本次作业同时也让我对colab平台有了更深的了解。通过修改优化器有一定的提升效果,epoch在一定程度上的增加也能够让训练效果更优。

浙公网安备 33010602011771号

浙公网安备 33010602011771号