联邦学习白皮书

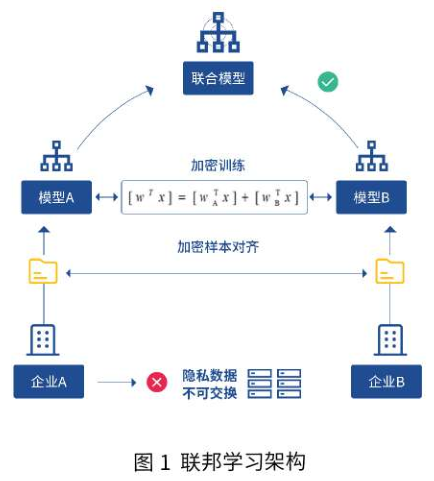

1.联邦学习定义

隐私保护的分布式机器学习框架,各参与方无需共享数据资源,就可以进行数据联合训练,建立最终机器学习模型。(合作共赢模式,共同富裕策略)

特征:

- 参与方数据保留在本地,一定程度上保证数据安全性

- 参与者联合训练模型,共同富裕

- 参与方地位平等

- 与中心化的机器学习建模效果相差不大 $ |{V_{fed}} - {V_{sum}}|< \delta $

每个参与方生成自己模型,再去聚合全局模型

联邦学习亮点在于保障隐私信息和数据安全,虽然增加了通讯等开销,但是通过本机进行模型训练,然后加密机制下的参数交换与安全聚合,最终实现一定程度上的隐私保护。

2.FL与DP 区别

FL的隐私保护通过HE加密等手段完成,数据和模型本身不进行传输,而且数据是准确的。

DP通过添加噪音,k-匿名、l-多样性、t-紧密性采用概括化方法模糊敏感属性,这些都进行了数据传输,而且处理后的数据是接近准确的。

3.FL与Distributed ML 区别

DistributedML包括机器学习的训练数据分布式存储、计算任务分布式运行、模型结果分布式发布,参数服务器作为加速机器学习模型训练的一种工具,将数据存储在分布式工作节点上,通过一个中心式调度节点调配数据分布和分配计算资源,以便高效获得最终训练模型。这些和FL相似。

白皮书提到FL不同于 参与方完全自治且更强调对数据拥有这的数据隐私保护。

FL面向海量终端,其不同于DistributedML:具有昂贵的通讯、系统的异构性、统计的异质性等特征。

4. FL与Blockchain 关系

都是去中心化的架构,区块链是一种完全P2P网络结构;FL中第三方承担聚合模型等功能。

都涉及到加密算法,区块链包括Hash、非对称加密;FL使用HE。

Blockchain在各个节点保存完整数据;FL数据只保存在本地。

Blockchain不同节点竞争记账获得奖励;FL依据每一方的贡献分配奖励。

Paper List:

McMahan[15]指出联邦学习可以通过差分隐私,多方安全计算,或它们的结合等技术来提供更强的安全保障。

Bonawitz[16]指出联邦学习中,可以利用多方安全计算以安全的方式计算来自用户设备的模型参数更新的总和。

Truex[17]中提出了一种利用差分隐私和多方安全计算来保护隐私的联邦学习方法。

Liu[18]提出将加性同态加密 (AHE) 应用于神经网络的多方计算。

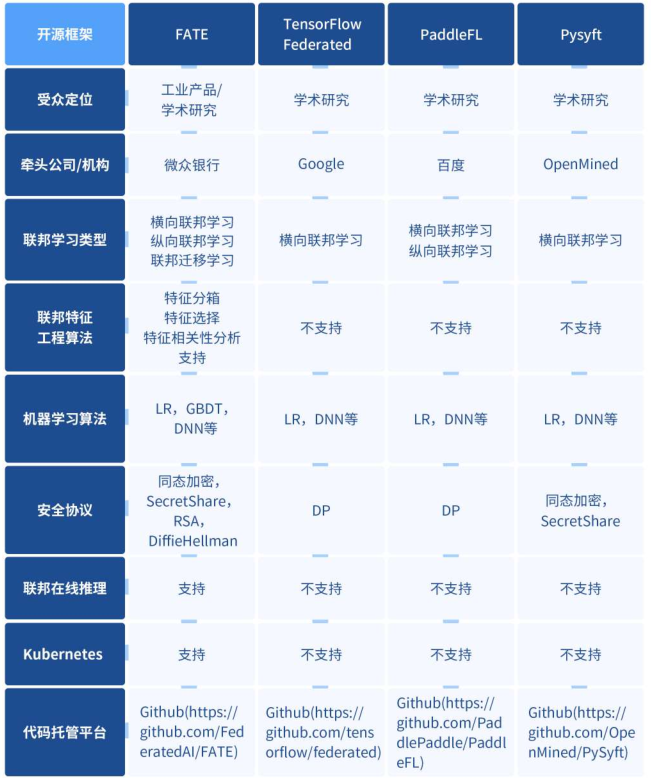

5.FL分类与框架

- 横向:按横向用户维度切分,取特征相同 用户不完全相同的数据训练。同行不同地

- 纵向:按纵向特征维度切分,取双方用户相同 特征不完全相同的数据训练。同地不同行

- 迁移:不对数据进行切分,适用数据或标签不足的场景。

6.应用场景

车险定价、信贷风控、销量预测、视觉安防、医疗诊断、隐私保护广告、自动驾驶

7.研究方向

从攻击对象划分

- 客户端攻击:参与迭代,检查收到消息和模型、篡改训练过程

- 服务端攻击:参与迭代,检查收到消息和梯度更新、篡改训练过程

从攻击手段划分

- 模型更新攻击:敌手控制客户端产生任意输出(拜占庭攻击),导致模型损失函数$ \mathcal{L}$收敛到次优模型,甚至模型发散

- 数据攻击:篡改客户端数据

- 逃逸攻击:构造特定输入样本,欺骗目标系统,完成模型推理

浙公网安备 33010602011771号

浙公网安备 33010602011771号