AI多模态融合算法及应用场景分析

一、引言

多模态融合的定义

多模态融合(Multimodal Fusion)是指结合来自不同模态(如视觉、听觉、文本等)的数据,以提升信息处理和理解能力的技术方法。多模态数据通常具有不同的物理性质和信息特征,通过融合这些多模态信息,可以获得更全面和准确的理解。这种融合过程可以发生在数据层、特征层和决策层:

-

数据层融合:直接对不同模态的数据进行融合。

-

特征层融合:提取不同模态的数据特征后进行融合。

-

决策层融合:对不同模态的处理结果进行融合。

添加图片注释,不超过 140 字(可选)

多模态融合的重要性

多模态融合在人工智能领域中具有重要意义,主要体现在以下几个方面:

-

提高信息理解能力:单一模态的数据往往不能提供全面的信息。例如,仅依靠视觉数据可能无法准确判断一个人的情感状态,但结合语音和文本数据,可以显著提高情感识别的准确性。

-

增强模型的鲁棒性:多模态融合能够增强模型对不同环境和场景的适应能力。例如,在自动驾驶中,结合视觉、雷达和激光雷达数据,可以提高环境感知的准确性和安全性。

-

提供丰富的上下文信息:通过融合多模态数据,可以获得更加丰富的上下文信息,从而改进任务的执行效果。例如,在人机交互中,结合语音和手势信息,可以提供更加自然和直观的交互体验。

-

改进生成任务的质量:在生成任务中(如图文生成),多模态融合能够生成更加逼真和一致的内容。例如,结合文本描述和图像数据,可以生成符合描述的高质量图像。

多模态融合的应用场景

多模态融合技术在各个领域有着广泛的应用,以下是一些典型的应用场景:

-

图文生成与理解

-

图像描述生成:根据图像内容生成自然语言描述。

-

文本到图像生成:根据文本描述生成对应的图像。

-

语音和视觉结合的情感分析

-

通过结合语音和视觉数据,识别用户的情感状态,提高情感分析的准确性。

-

自动驾驶

-

通过融合摄像头、雷达、激光雷达等多种传感器数据,实现对驾驶环境的全面感知,提高自动驾驶的安全性和可靠性。

-

人机交互

-

结合语音、手势和面部表情,实现自然的人机交互。例如,智能家居中的语音助手结合视觉数据,可以识别用户的手势命令和表情变化,提供更加智能的服务。

-

医疗影像分析

-

将不同模态的医疗影像(如MRI、CT、超声波等)融合在一起,提高疾病诊断的准确性和早期发现能力。

-

多模态推荐系统

-

在推荐系统中结合用户的浏览历史、评论、图像和视频等多种模态数据,提供个性化和精准的推荐服务。

以下表格总结了不同应用场景中使用的模态及其融合方式:

通过以上对多模态融合定义、重要性和应用场景的介绍,可以看出,多模态融合在提升信息处理和理解能力方面具有显著优势,广泛应用于各个领域,成为推动人工智能技术进步的重要力量。

二、多模态融合的背景

背景与定义

多模态融合(Multimodal Fusion)是指将来自不同模态的数据进行结合,以提高信息处理和理解能力的一种技术方法。多模态数据可能包括视觉、听觉、文本等不同类型的信息,通过融合这些数据,我们可以获得更加全面和准确的理解。这种融合过程可以在数据层、特征层和决策层进行。

历史发展

多模态融合技术的发展经历了几个关键阶段,每个阶段都代表了技术进步和应用场景的扩展。以下是多模态融合发展的主要里程碑:

1. 早期探索阶段(20世纪60年代 - 90年代)

在计算机科学和人工智能的早期阶段,多模态融合的概念已经开始萌芽。早期的研究主要集中在基础理论和概念模型上,试图理解和模拟人类多感官信息处理的机制。

-

1960年代:信息论和控制论的兴起,为多模态信息处理提供了理论基础。

-

1970年代:自然语言处理(NLP)和计算机视觉(CV)开始独立发展,分别研究语言和视觉信息的处理方法。

-

1980年代:初步尝试将语音识别和文本处理结合,开启了跨模态信息处理的研究。

2. 技术融合阶段(1990年代 - 2000年代初)

随着计算能力的提升和传感技术的发展,多模态融合进入了实质性的发展阶段。这一时期的研究开始关注如何有效地将不同模态的信息进行融合,以解决实际应用中的问题。

-

1990年代:语音和图像的融合研究逐渐兴起,主要应用于多媒体信息检索和人机交互。Huang et al. (1993) 提出了基于语音和视觉信息的多模态接口。

-

2000年代初:基于概率模型和机器学习的方法开始应用于多模态融合。例如,Hidden Markov Models (HMMs) 和 Gaussian Mixture Models (GMMs) 被用于融合语音和图像数据。

3. 深度学习驱动阶段(2010年代 - 现在)

深度学习的兴起为多模态融合带来了新的机遇。基于深度神经网络的方法能够自动提取和融合多模态特征,显著提升了多模态信息处理的效果。

-

2010年代初:深度学习方法在计算机视觉和自然语言处理领域取得突破,推动了多模态融合技术的发展。Multimodal Deep Boltzmann Machines (DBMs) 和 Deep Belief Networks (DBNs) 等模型被提出用于多模态融合。

-

2014年:Vinyals et al. 提出了图像描述生成模型,结合卷积神经网络(CNN)和循环神经网络(RNN),实现了图像和文本的有效融合。

-

2015年:Google的Neural Machine Translation (NMT) 系统使用了多模态信息,提高了翻译的准确性和流畅性。

4. 多模态融合的应用扩展阶段(2020年代 - 未来)

进入2020年代,多模态融合技术在各个领域的应用得到了进一步扩展,从自动驾驶到医疗诊断,从虚拟现实到智能家居,多模态融合技术展示了其广泛的应用前景。

-

2020年:OpenAI推出了DALL-E,结合文本和图像生成技术,实现了基于文本描述生成图像的能力。

-

2021年:Meta (前Facebook) 发布了HoloLens,利用多模态融合技术实现了增强现实(AR)和虚拟现实(VR)的创新应用。

-

2023年:在自然语言处理和视觉理解的融合研究中,Transformer-based 模型(如 CLIP, DALL-E 2)展示了强大的多模态信息处理能力,推动了多模态融合技术的发展。

多模态融合的研究现状

目前,多模态融合已经成为人工智能研究的一个重要方向。研究热点主要集中在以下几个方面:

-

模型架构设计:如何设计高效的多模态融合模型架构,如Transformer、混合神经网络等。

-

特征提取与表示:如何从不同模态的数据中提取有效的特征,并进行统一的表示。

-

跨模态对齐:如何在不同模态之间建立关联和对齐机制,以实现信息的无缝融合。

-

应用场景扩展:探索多模态融合在新兴领域的应用,如智能家居、智能医疗、自动驾驶等。

关键技术与工具

在多模态融合的研究与应用中,以下技术与工具起到了关键作用:

-

深度学习框架:如TensorFlow、PyTorch,为多模态模型的训练和部署提供了基础设施。

-

预训练模型:如BERT、GPT-3、CLIP,为多模态融合任务提供了强大的预训练特征表示。

-

数据集:如MS COCO、Flickr30k、AudioSet,提供了多模态融合研究所需的大规模数据。

三、多模态数据的类型和特征

多模态融合技术的核心在于有效地处理和结合不同模态的数据。理解各类模态数据的特征和相应的处理方法,是实现多模态融合的关键。以下是对多模态数据类型及其特征的详细介绍。

图像数据

图像数据是视觉模态的主要表现形式,具有丰富的空间信息和视觉特征。

特征描述

-

空间分辨率:图像数据由像素组成,每个像素代表图像在特定位置的颜色和亮度值。高分辨率图像包含更多的细节信息。

-

颜色信息:通常以RGB(红、绿、蓝)三通道表示,有时也会使用其他颜色空间如HSV、YUV等。

-

纹理和边缘特征:通过边缘检测、SIFT(Scale-Invariant Feature Transform)、HOG(Histogram of Oriented Gradients)等方法提取。

举例

-

自然图像:如风景、人物、物体的照片。

-

医学影像:如X光片、MRI(磁共振成像)、CT(计算机断层扫描)图像。

-

卫星图像:如遥感卫星拍摄的地球表面图像。

文本数据

文本数据是语言模态的主要表现形式,包含丰富的语义和上下文信息。

特征描述

-

词汇特征:词汇的频率、词性(如名词、动词、形容词等)。

-

语义特征:通过词向量(如Word2Vec、GloVe)、上下文表示(如BERT)来捕捉词汇的语义。

-

句法特征:句子的结构和依赖关系,使用句法树或依赖图表示。

-

上下文特征:基于上下文的信息捕捉,通常使用序列模型(如LSTM、Transformer)来提取。

举例

-

自然语言文本:如新闻文章、对话记录、社交媒体帖子。

-

技术文档:如API文档、研究论文、专利文件。

-

字幕和脚本:如电影字幕、视频脚本。

音频数据

音频数据是听觉模态的主要表现形式,包含声音的频率、幅度和时间特征。

特征描述

-

时域特征:如波形信号的时间序列,常用特征包括音量、能量等。

-

频域特征:通过傅里叶变换获取,如频谱图、梅尔频谱。

-

时频特征:结合时域和频域信息,如MFCC(梅尔频率倒谱系数)。

-

语音特征:如音素、韵律、情感特征。

举例

-

语音数据:如对话录音、语音命令。

-

音乐数据:如歌曲、乐器演奏。

-

环境声音:如自然声音、城市噪音。

视频数据

视频数据是时序的视觉模态,结合了图像和时间序列信息。

特征描述

-

帧级特征:每一帧的视频可以视为一张图像,包含图像特征。

-

时序特征:帧与帧之间的时间关联,捕捉运动信息和动态变化。

-

光流特征:通过分析视频中像素点的移动,提取运动信息。

举例

-

电影和视频片段:如电影、电视剧、网络视频。

-

监控视频:如交通监控、安防监控。

-

运动捕捉:如体育比赛录像、动作捕捉数据。

传感器数据

传感器数据包括各种物理传感器采集到的信号,具有高维度和时序性。

特征描述

-

时间序列特征:如传感器信号的时间序列。

-

频域特征:通过频域分析提取的特征,如振动频率、功率谱密度。

-

多模态传感:结合多个传感器的数据,如加速度计、陀螺仪、温度传感器等。

举例

-

移动设备传感器数据:如智能手机中的加速度计、陀螺仪数据。

-

工业传感器数据:如机器振动传感器、温度传感器数据。

-

健康监测数据:如心率监测、血氧水平监测数据。

跨模态数据的融合特性

多模态数据的融合不仅需要理解每种模态的独特特征,还需要解决跨模态的对齐和互补问题。以下是一些常见的融合特性和挑战:

-

对齐问题:不同模态的数据可能存在时间或空间上的对齐问题,需要通过对齐算法进行处理。例如,视频和音频数据的同步处理。

-

信息互补性:不同模态的数据可以提供互补信息,通过融合可以增强整体信息的完整性和准确性。

-

数据噪声和冗余:多模态数据可能包含噪声和冗余信息,需要通过特征选择和降维技术进行处理。

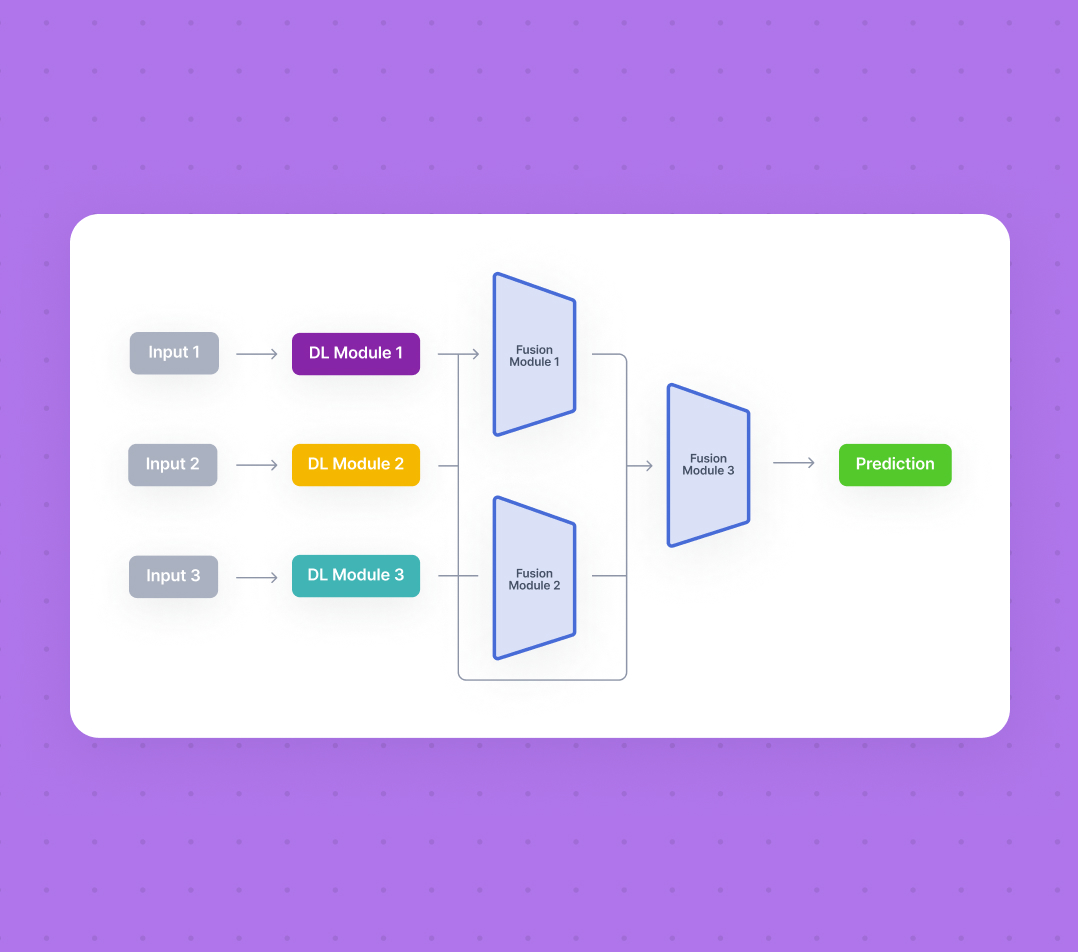

融合方法与策略

添加图片注释,不超过 140 字(可选)

在实际应用中,针对多模态数据的融合可以采用以下几种策略:

-

早期融合:在数据层进行融合,将不同模态的数据直接拼接在一起作为模型的输入。

-

中期融合:在特征层进行融合,分别提取不同模态的数据特征后进行结合。

-

晚期融合:在决策层进行融合,将各模态独立处理后的结果进行组合。

通过理解和处理多模态数据的类型和特征,我们可以设计出更加高效和鲁棒的多模态融合模型,解决复杂的跨模态信息处理问题,并在实际应用中取得更好的效果。

四、多模态融合-数据层融合

数据层融合是多模态融合技术中最基础的一种方法,即将来自不同模态的原始数据在输入层直接进行拼接或组合。该方法简单直接,但在实际应用中需要处理数据对齐、尺度差异和噪声等问题。下面将详细介绍数据层融合的基本方法和实现细节,并提供代码举例。

数据层融合的基本方法

数据层融合通常涉及以下几个步骤:

-

数据预处理:对不同模态的数据进行预处理,包括数据清洗、归一化和对齐等。

-

数据拼接:将不同模态的数据在输入层直接拼接或组合在一起,形成统一的输入表示。

-

模型训练:使用融合后的数据训练一个单一模型,进行下游任务的预测。

数据预处理

不同模态的数据可能具有不同的尺度和格式,因此在融合之前需要进行预处理。常见的预处理方法包括:

-

归一化:将不同模态的数据归一化到相同的尺度。例如,对于图像数据,可以进行像素值归一化;对于文本数据,可以使用词向量表示。

-

对齐:将不同模态的数据在时间或空间上进行对齐。例如,对于视频和音频数据,可以通过时间戳进行同步。

数据拼接

数据拼接是数据层融合的关键步骤。常见的拼接方法包括:

-

向量拼接:将不同模态的数据向量直接拼接成一个长向量。例如,将图像的像素值向量和文本的词向量拼接在一起。

-

矩阵拼接:对于二维数据(如图像和矩阵),可以在维度上进行拼接。例如,将多个图像通道拼接成一个多通道的输入。

模型训练

使用拼接后的数据进行模型训练是最后一步。由于输入数据已经融合,因此可以直接使用常见的深度学习模型进行训练。以下是一个简单的代码示例,展示如何进行数据层融合。

代码示例

以下代码示例展示了如何使用PyTorch进行数据层融合,以图像和文本数据为例。假设我们有图像数据和对应的文本描述,我们将它们进行数据层融合,输入到一个简单的神经网络模型中进行分类任务。

import torch import torch.nn as nn import torch.optim as optim from torchvision import transforms, models from torch.utils.data import Dataset, DataLoader import numpy as np # 定义数据集类 class MultimodalDataset(Dataset): def __init__(self, image_data, text_data, labels, transform=None): self.image_data = image_data self.text_data = text_data self.labels = labels self.transform = transform def __len__(self): return len(self.labels) def __getitem__(self, idx): image = self.image_data[idx] text = self.text_data[idx] label = self.labels[idx] if self.transform: image = self.transform(image) # 数据拼接 combined_data = np.concatenate((image.flatten(), text), axis=0) return combined_data, label # 示例数据(使用随机数据进行演示) num_samples = 100 image_size = (3, 224, 224) text_vector_size = 300 num_classes = 10 image_data = np.random.rand(num_samples, *image_size) text_data = np.random.rand(num_samples, text_vector_size) labels = np.random.randint(0, num_classes, num_samples) # 数据归一化和转换 transform = transforms.Compose([ transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), ]) # 创建数据集和数据加载器 dataset = MultimodalDataset(image_data, text_data, labels, transform=transform) dataloader = DataLoader(dataset, batch_size=16, shuffle=True) # 定义简单的神经网络模型 class MultimodalModel(nn.Module): def __init__(self, input_size, hidden_size, num_classes): super(MultimodalModel, self).__init__() self.fc1 = nn.Linear(input_size, hidden_size) self.relu = nn.ReLU() self.fc2 = nn.Linear(hidden_size, num_classes) def forward(self, x): out = self.fc1(x) out = self.relu(out) out = self.fc2(out) return out input_size = np.prod(image_size) + text_vector_size hidden_size = 512 model = MultimodalModel(input_size, hidden_size, num_classes) # 定义损失函数和优化器 criterion = nn.CrossEntropyLoss() optimizer = optim.Adam(model.parameters(), lr=0.001) # 训练模型 num_epochs = 10 for epoch in range(num_epochs): for i, (inputs, labels) in enumerate(dataloader): inputs = inputs.float() labels = labels.long() # 前向传播 outputs = model(inputs) loss = criterion(outputs, labels) # 反向传播和优化 optimizer.zero_grad() loss.backward() optimizer.step() if (i+1) % 10 == 0: print(f'Epoch [{epoch+1}/{num_epochs}], Step [{i+1}/{len(dataloader)}], Loss: {loss.item():.4f}') print("Training completed.")

代码解释

-

数据集类:MultimodalDataset 类继承自 torch.utils.data.Dataset,用于加载和预处理图像和文本数据。数据拼接在 __getitem__ 方法中完成,将图像数据和文本数据拼接成一个长向量。

-

数据加载器:使用 torch.utils.data.DataLoader 创建数据加载器,批量加载数据以供模型训练。

-

模型定义:MultimodalModel 是一个简单的全连接神经网络模型,包含一个隐藏层和一个输出层。输入层接收拼接后的数据向量。

-

训练过程:定义损失函数(交叉熵损失)和优化器(Adam),然后进行模型训练。

通过以上代码示例,可以看到数据层融合的实现过程。尽管这种方法简单直接,但在实际应用中需要注意数据对齐和归一化等问题,以确保不同模态的数据能够有效融合。

实际应用中的考虑

在实际应用中,数据层融合面临以下几个挑战和考虑:

-

数据对齐:确保不同模态的数据在时间或空间上对齐。例如,视频和音频数据需要通过时间戳进行同步。

-

尺度差异:不同模态的数据可能具有不同的尺度和单位,需要进行归一化处理。

-

数据噪声:多模态数据可能包含噪声,需要通过预处理方法进行降噪。

五、多模态融合-特征层融合

特征层融合是多模态融合技术中一种重要的方法,它通过分别提取不同模态的数据特征,并在特征层进行融合。这种方法可以更好地捕捉各模态之间的互补信息,提高信息处理的效果。以下是对特征层融合的详细介绍及代码举例。

特征层融合的基本方法

特征层融合通常涉及以下几个步骤:

-

特征提取:使用专门的模型从不同模态的数据中提取高维特征表示。

-

特征对齐:对提取的特征进行对齐,以确保在融合时能够正确结合。

-

特征融合:将对齐后的特征进行融合,形成综合特征表示。

-

模型训练:使用融合后的特征训练一个下游任务模型。

特征提取

特征提取是特征层融合的关键步骤。不同模态的数据需要使用不同的方法和模型进行特征提取。例如:

-

图像数据:常用卷积神经网络(CNN)提取图像特征。

-

文本数据:常用循环神经网络(RNN)、Transformer等提取文本特征。

-

音频数据:常用卷积神经网络(CNN)和长短期记忆网络(LSTM)提取音频特征。

特征对齐

特征对齐是指将不同模态提取的特征进行规范化处理,以确保它们在同一空间中具有可比性。常见的方法包括:

-

维度对齐:将不同模态的特征映射到相同的维度。

-

时间对齐:对于时间序列数据(如视频和音频),通过时间戳进行同步。

特征融合

特征融合是将对齐后的特征进行组合,常见的方法包括:

-

拼接:将特征向量直接拼接。

-

加权求和:将特征向量进行加权求和。

-

注意力机制:使用注意力机制对特征进行加权组合。

代码示例

以下代码示例展示了如何使用PyTorch进行特征层融合,以图像和文本数据为例。假设我们有图像数据和对应的文本描述,我们将它们分别提取特征后进行特征层融合,并输入到一个神经网络模型中进行分类任务。

import torch import torch.nn as nn import torch.optim as optim from torchvision import models, transforms from torch.utils.data import Dataset, DataLoader import numpy as np # 定义图像特征提取网络 class ImageFeatureExtractor(nn.Module): def __init__(self): super(ImageFeatureExtractor, self).__init__() self.model = models.resnet18(pretrained=True) self.model.fc = nn.Identity() # 移除最后的全连接层 def forward(self, x): features = self.model(x) return features # 定义文本特征提取网络 class TextFeatureExtractor(nn.Module): def __init__(self, vocab_size, embedding_dim, hidden_dim): super(TextFeatureExtractor, self).__init__() self.embedding = nn.Embedding(vocab_size, embedding_dim) self.lstm = nn.LSTM(embedding_dim, hidden_dim, batch_first=True) self.fc = nn.Linear(hidden_dim, hidden_dim) def forward(self, x): embedded = self.embedding(x) _, (hidden, _) = self.lstm(embedded) features = self.fc(hidden[-1]) return features # 定义融合网络 class MultimodalModel(nn.Module): def __init__(self, image_feature_dim, text_feature_dim, hidden_dim, num_classes): super(MultimodalModel, self).__init__() self.image_extractor = ImageFeatureExtractor() self.text_extractor = TextFeatureExtractor(vocab_size=10000, embedding_dim=300, hidden_dim=512) self.fc1 = nn.Linear(image_feature_dim + text_feature_dim, hidden_dim) self.relu = nn.ReLU() self.fc2 = nn.Linear(hidden_dim, num_classes) def forward(self, image, text): image_features = self.image_extractor(image) text_features = self.text_extractor(text) combined_features = torch.cat((image_features, text_features), dim=1) out = self.fc1(combined_features) out = self.relu(out) out = self.fc2(out) return out # 示例数据(使用随机数据进行演示) num_samples = 100 image_size = (3, 224, 224) text_length = 20 num_classes = 10 image_data = np.random.rand(num_samples, *image_size) text_data = np.random.randint(0, 10000, (num_samples, text_length)) labels = np.random.randint(0, num_classes, num_samples) # 数据归一化和转换 transform = transforms.Compose([ transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), ]) # 定义自定义数据集 class MultimodalDataset(Dataset): def __init__(self, image_data, text_data, labels, transform=None): self.image_data = image_data self.text_data = text_data self.labels = labels self.transform = transform def __len__(self): return len(self.labels) def __getitem__(self, idx): image = self.image_data[idx] text = self.text_data[idx] label = self.labels[idx] if self.transform: image = self.transform(image) return image, text, label # 创建数据集和数据加载器 dataset = MultimodalDataset(image_data, text_data, labels, transform=transform) dataloader = DataLoader(dataset, batch_size=16, shuffle=True) # 初始化模型、损失函数和优化器 model = MultimodalModel(image_feature_dim=512, text_feature_dim=512, hidden_dim=1024, num_classes=num_classes) criterion = nn.CrossEntropyLoss() optimizer = optim.Adam(model.parameters(), lr=0.001) # 训练模型 num_epochs = 10 for epoch in range(num_epochs): for i, (images, texts, labels) in enumerate(dataloader): images = images.float() texts = texts.long() labels = labels.long() # 前向传播 outputs = model(images, texts) loss = criterion(outputs, labels) # 反向传播和优化 optimizer.zero_grad() loss.backward() optimizer.step() if (i+1) % 10 == 0: print(f'Epoch [{epoch+1}/{num_epochs}], Step [{i+1}/{len(dataloader)}], Loss: {loss.item():.4f}') print("Training completed.")

代码解释

-

特征提取网络:

-

ImageFeatureExtractor 使用预训练的ResNet18模型提取图像特征,并移除最后的全连接层。

-

TextFeatureExtractor 使用嵌入层和LSTM网络提取文本特征,并通过全连接层进行进一步处理。

-

融合网络:

-

MultimodalModel 包含图像和文本特征提取模块,特征提取后将特征向量拼接,通过全连接层进行融合处理。

-

数据加载器:

-

自定义数据集类 MultimodalDataset 负责加载和预处理图像和文本数据。

-

使用 torch.utils.data.DataLoader 创建数据加载器,批量加载数据以供模型训练。

-

训练过程:

-

定义损失函数(交叉熵损失)和优化器(Adam)。

-

进行模型训练,输出训练过程中的损失值。

通过以上代码示例,可以看到特征层融合的实现过程。特征层融合方法通过分别提取不同模态的特征,并在特征层进行融合,能够更好地捕捉多模态数据的互补信息,提高信息处理的效果。

实际应用中的考虑

在实际应用中,特征层融合面临以下几个挑战和考虑:

-

特征对齐:确保不同模态的特征在融合前已经对齐。例如,对于视频和音频数据,通过时间戳进行同步。

-

特征维度一致性:将不同模态的特征映射到相同的维度,以便在融合时能够正确结合。

-

模型复杂度:特征层融合方法可能会增加模型的复杂度,需要平衡模型性能和计算资源的消耗。

六、多模态融合-决策层融合

决策层融合是多模态融合技术中一种高级的方法,通过在各模态的独立决策结果上进行融合来提高整体的决策性能。这种方法通常包括独立的模态特征提取和决策步骤,最后将各模态的决策结果进行融合。以下是对决策层融合的详细介绍及代码举例。

决策层融合的基本方法

决策层融合通常涉及以下几个步骤:

-

独立特征提取:分别从每个模态中提取特征。

-

独立模型训练:对每个模态分别训练独立的模型。

-

决策结果融合:将每个模态的独立决策结果进行融合,形成最终的决策。

独立特征提取

不同模态的数据需要使用专门的方法进行特征提取。例如:

-

图像数据:使用卷积神经网络(CNN)提取图像特征。

-

文本数据:使用循环神经网络(RNN)、Transformer等提取文本特征。

-

音频数据:使用卷积神经网络(CNN)和长短期记忆网络(LSTM)提取音频特征。

独立模型训练

对每个模态的数据分别训练独立的模型,这些模型可以是同质的(同样的网络结构)或异质的(不同的网络结构)。例如:

-

对图像数据训练一个CNN模型。

-

对文本数据训练一个LSTM模型。

-

对音频数据训练一个CNN-LSTM混合模型。

决策结果融合

常见的决策融合方法包括:

-

投票机制:如多数投票、加权投票等。

-

概率平均:计算各模型输出的概率值的平均值。

-

基于学习的融合:如使用一个额外的模型(如逻辑回归、神经网络)对各模态的决策结果进行融合。

代码示例

以下代码示例展示了如何使用PyTorch进行决策层融合,以图像和文本数据为例。假设我们有图像数据和对应的文本描述,我们将它们分别训练独立的模型,并在决策层进行融合。

独立模型定义和训练

import torch import torch.nn as nn import torch.optim as optim from torchvision import models, transforms from torch.utils.data import Dataset, DataLoader import numpy as np # 定义图像特征提取网络 class ImageModel(nn.Module): def __init__(self, num_classes): super(ImageModel, self).__init__() self.model = models.resnet18(pretrained=True) self.model.fc = nn.Linear(self.model.fc.in_features, num_classes) def forward(self, x): return self.model(x) # 定义文本特征提取网络 class TextModel(nn.Module): def __init__(self, vocab_size, embedding_dim, hidden_dim, num_classes): super(TextModel, self).__init__() self.embedding = nn.Embedding(vocab_size, embedding_dim) self.lstm = nn.LSTM(embedding_dim, hidden_dim, batch_first=True) self.fc = nn.Linear(hidden_dim, num_classes) def forward(self, x): embedded = self.embedding(x) _, (hidden, _) = self.lstm(embedded) out = self.fc(hidden[-1]) return out # 示例数据(使用随机数据进行演示) num_samples = 100 image_size = (3, 224, 224) text_length = 20 num_classes = 10 image_data = np.random.rand(num_samples, *image_size) text_data = np.random.randint(0, 10000, (num_samples, text_length)) labels = np.random.randint(0, num_classes, num_samples) # 数据归一化和转换 transform = transforms.Compose([ transforms.ToTensor(), transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]), ]) # 定义自定义数据集 class MultimodalDataset(Dataset): def __init__(self, image_data, text_data, labels, transform=None): self.image_data = image_data self.text_data = text_data self.labels = labels self.transform = transform def __len__(self): return len(self.labels) def __getitem__(self, idx): image = self.image_data[idx] text = self.text_data[idx] label = self.labels[idx] if self.transform: image = self.transform(image) return image, text, label # 创建数据集和数据加载器 dataset = MultimodalDataset(image_data, text_data, labels, transform=transform) dataloader = DataLoader(dataset, batch_size=16, shuffle=True) # 初始化图像和文本模型 image_model = ImageModel(num_classes=num_classes) text_model = TextModel(vocab_size=10000, embedding_dim=300, hidden_dim=512, num_classes=num_classes) # 定义损失函数和优化器 criterion = nn.CrossEntropyLoss() image_optimizer = optim.Adam(image_model.parameters(), lr=0.001) text_optimizer = optim.Adam(text_model.parameters(), lr=0.001) # 训练图像模型 def train_model(model, optimizer, dataloader, num_epochs, model_type='image'): for epoch in range(num_epochs): for i, (images, texts, labels) in enumerate(dataloader): if model_type == 'image': inputs = images.float() elif model_type == 'text': inputs = texts.long() labels = labels.long() # 前向传播 outputs = model(inputs) loss = criterion(outputs, labels) # 反向传播和优化 optimizer.zero_grad() loss.backward() optimizer.step() if (i+1) % 10 == 0: print(f'Epoch [{epoch+1}/{num_epochs}], Step [{i+1}/{len(dataloader)}], Loss: {loss.item():.4f}') print("Training Image Model") train_model(image_model, image_optimizer, dataloader, num_epochs=10, model_type='image') print("Training Text Model") train_model(text_model, text_optimizer, dataloader, num_epochs=10, model_type='text')

决策结果融合

在完成独立模型的训练之后,我们需要将各模态的决策结果进行融合。以下代码展示了如何在决策层进行融合。

# 定义融合网络 class DecisionFusionModel(nn.Module): def __init__(self, num_classes): super(DecisionFusionModel, self).__init__() self.fc = nn.Linear(num_classes * 2, num_classes) def forward(self, image_logits, text_logits): combined_logits = torch.cat((image_logits, text_logits), dim=1) out = self.fc(combined_logits) return out # 初始化融合网络 fusion_model = DecisionFusionModel(num_classes=num_classes) # 定义损失函数和优化器 fusion_criterion = nn.CrossEntropyLoss() fusion_optimizer = optim.Adam(fusion_model.parameters(), lr=0.001) # 训练融合网络 def train_fusion_model(image_model, text_model, fusion_model, dataloader, num_epochs): image_model.eval() text_model.eval() for epoch in range(num_epochs): for i, (images, texts, labels) in enumerate(dataloader): images = images.float() texts = texts.long() labels = labels.long() # 获取图像和文本模型的输出 with torch.no_grad(): image_logits = image_model(images) text_logits = text_model(texts) # 融合决策 fusion_inputs = (image_logits, text_logits) outputs = fusion_model(*fusion_inputs) loss = fusion_criterion(outputs, labels) # 反向传播和优化 fusion_optimizer.zero_grad() loss.backward() fusion_optimizer.step() if (i+1) % 10 == 0: print(f'Epoch [{epoch+1}/{num_epochs}], Step [{i+1}/{len(dataloader)}], Loss: {loss.item():.4f}') print("Training Fusion Model") train_fusion_model(image_model, text_model, fusion_model, dataloader, num_epochs=10)

代码解释

-

独立模型定义和训练:

-

ImageModel 和 TextModel 分别用于提取图像和文本特征,并进行分类。

-

通过自定义数据集类 MultimodalDataset 加载和预处理图像和文本数据。

-

使用 train_model 函数分别训练图像模型和文本模型。

-

融合网络定义和训练:

-

DecisionFusionModel 用于将图像模型和文本模型的输出进行融合,并进行最终的分类。

-

在 train_fusion_model 函数中,首先获取独立模型的输出,再将其输入到融合网络进行训练。

通过以上代码示例,可以看到决策层融合的实现过程。决策层融合方法通过分别训练独立的模态模型,并在决策层进行融合。

六、多模态融合算法框架盘点

多模态融合技术涵盖了多种算法和神经网络结构,每种方法都有其独特的逻辑、特点和适用场景。以下是对常见多模态融合算法的盘点,以表格的形式展示它们的主要逻辑、特点和适用场景。

参考文献链接

人工智能芯片与自动驾驶

浙公网安备 33010602011771号

浙公网安备 33010602011771号