Python 爬虫从入门到进阶之路(五)

在之前的文章中我们带入了 opener 方法,接下来我们看一下 opener 应用中的 ProxyHandler 处理器(代理设置)。

使用代理IP,这是爬虫/反爬虫的第二大招,通常也是最好用的。

很多网站会检测某一段时间某个IP的访问次数(通过流量统计,系统日志等),如果访问次数多的不像正常人,它会禁止这个IP的访问。

所以我们可以设置一些代理服务器,每隔一段时间换一个代理,就算IP被禁止,依然可以换个IP继续爬取。

urllib.request 中通过ProxyHandler来设置使用代理服务器,下面代码说明如何使用自定义 opener 来使用代理:

1 import urllib.request 2 3 # 构建了两个代理Handler,一个有代理IP,一个没有代理IP 4 httpproxy_handler = urllib.request.ProxyHandler({"https": "27.191.234.69:9999"}) 5 nullproxy_handler = urllib.request.ProxyHandler({}) 6 7 # 定义一个代理开关 8 proxySwitch = True 9 10 # 通过 urllib.request.build_opener()方法使用这些代理Handler对象,创建自定义opener对象 11 # 根据代理开关是否打开,使用不同的代理模式 12 if proxySwitch: 13 opener = urllib.request.build_opener(httpproxy_handler) 14 else: 15 opener = urllib.request.build_opener(nullproxy_handler) 16 17 request = urllib.request.Request("http://www.baidu.com/") 18 19 # 1. 如果这么写,只有使用opener.open()方法发送请求才使用自定义的代理,而urlopen()则不使用自定义代理。 20 response = opener.open(request) 21 22 # 2. 如果这么写,就是将opener应用到全局,之后所有的,不管是opener.open()还是urlopen() 发送请求,都将使用自定义代理。 23 # urllib.request.install_opener(opener) 24 # response = urllib.request.urlopen(request) 25 26 # 获取服务器响应内容 27 html = response.read().decode("utf-8") 28 29 # 打印字符串 30 print(html)

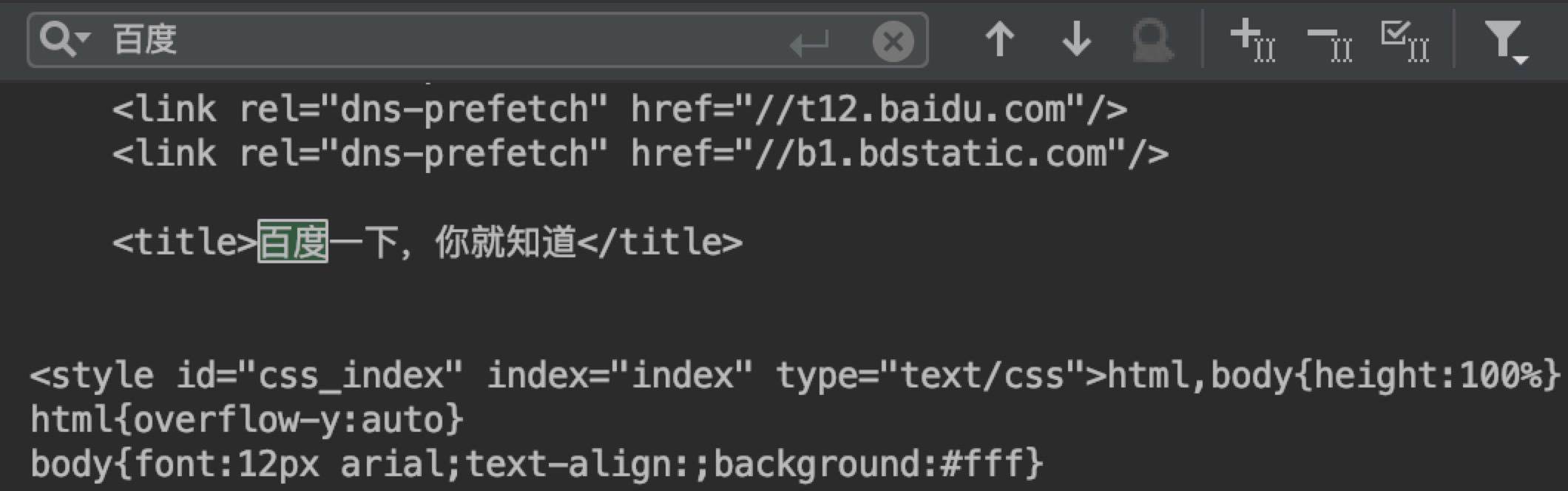

最终结果如下:

在上面的代码第 4 行,我们使用了一个免费的代理 IP,国内有很多免费的代理 IP 地址,如下:

但是上面的免费代理只支持短期的,就是说在我们在短期爬取信息或者自己做测试可以去上面找可以使用的,但是如果要是长期的话我们需要自己购买代理 IP 比较稳妥。

为了避免我们的代理 IP 被封后爬取失败,我们可以使用多个代理 Ip,然后不定时切换就可以了,如下:

1 import urllib.request 2 import random 3 4 # 代理列表 5 proxy_list = [ 6 {"http": "27.191.234.69:9999"}, 7 {"http": "27.191.234.69:9999"}, 8 {"http": "27.191.234.69:9999"}, 9 {"http": "27.191.234.69:9999"}, 10 ] 11 # 随机选择一个代理 12 proxy = random.choice(proxy_list) 13 # 使用选择的代理构建代理处理器对象 14 httpproxy_handler = urllib.request.ProxyHandler(proxy) 15 16 # 通过 urllib.request.build_opener()方法使用这些代理Handler对象,创建自定义opener对象 17 opener = urllib.request.build_opener(httpproxy_handler) 18 19 request = urllib.request.Request("http://www.baidu.com/") 20 response = opener.open(request) 21 html = response.read().decode("utf-8") 22 print(html)

接下来我们看一下自己购买的私密 IP 该如何使用代理。

1 import urllib.request 2 3 # 私密代理授权的账户 4 user = "user" 5 # 私密代理授权的密码 6 passwd = "passwd" 7 # 私密代理 IP 8 proxyserver = "62.151.164.138:12816" 9 10 # 1. 构建一个密码管理对象,用来保存需要处理的用户名和密码 11 passwdmgr = urllib.request.HTTPPasswordMgrWithDefaultRealm() 12 13 # 2. 添加账户信息,第一个参数realm是与远程服务器相关的域信息,一般没人管它都是写None,后面三个参数分别是 代理服务器、用户名、密码 14 passwdmgr.add_password(None, proxyserver, user, passwd) 15 16 # 3. 构建一个代理基础用户名/密码验证的 ProxyBasicAuthHandler 处理器对象,参数是创建的密码管理对象 17 # 注意,这里不再使用普通 ProxyHandler 类了 18 proxyauth_handler = urllib.request.ProxyBasicAuthHandler(passwdmgr) 19 20 # 4. 通过 build_opener()方法使用这些代理 Handler 对象,创建自定义 opener 对象,参数包括构建的 proxy_handler 和 proxyauth_handler 21 opener = urllib.request.build_opener(proxyauth_handler) 22 23 # 5. 构造Request 请求 24 request = urllib.request.Request("http://www.baidu.com/") 25 26 # 6. 使用自定义opener发送请求 27 response = opener.open(request) 28 29 # 7. 打印响应内容 30 html = response.read().decode("utf-8") 31 print(html)

免费开放代理一般会有很多人都在使用,而且代理有寿命短,速度慢,匿名度不高,HTTP/HTTPS支持不稳定等缺点(免费没好货)。

专业爬虫工程师或爬虫公司会使用高品质的私密代理,这些代理通常需要找专门的代理供应商购买,再通过用户名/密码授权使用(舍不得孩子套不到狼)。

.jpg) Python 爬虫从入门到进阶之路(五)Python opener 应用中的 ProxyHandler 处理器(代理设置)。

Python 爬虫从入门到进阶之路(五)Python opener 应用中的 ProxyHandler 处理器(代理设置)。

浙公网安备 33010602011771号

浙公网安备 33010602011771号