使用Ollama部署本地DeepSeek大模型并搭建三种WebUI界面:Page Assist、Open-WebUI与Chatbox完整指南

本文详细介绍了如何在本地环境中通过Ollama部署强大的DeepSeek大语言模型,并展示了从安装到运行的全过程。涵盖以下核心内容:

Ollama环境配置与DeepSeek模型部署:一步步教你如何安装Ollama并在其上加载DeepSeek模型,包括启动服务和验证模型功能。

三种WebUI界面搭建实战:

Page Assist:展示如何为DeepSeek集成直观的网页交互界面。

Open-WebUI:基于开源项目构建,支持多用户对话与高级设置。

Chatbox:轻量级聊天界面,适合快速体验模型能力。

界面展示详解:包括对话页面、设置页面等关键部分的截图与操作说明,助你全面了解各WebUI的功能与使用方式。

无论你是AI爱好者还是开发者,这篇文章都将为你提供一个清晰的技术路径,帮助你在本地轻松部署并使用先进的大语言模型。

本地安装大模型

启动ollama

Ollama 会自动下载并运行 DeepSeek R1 8b 模型

ollama run deepseek-r1:8b

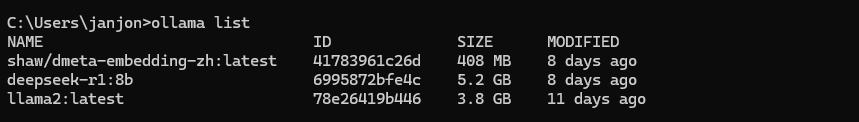

查看Ollama安装列表

安装大模型的webui页面

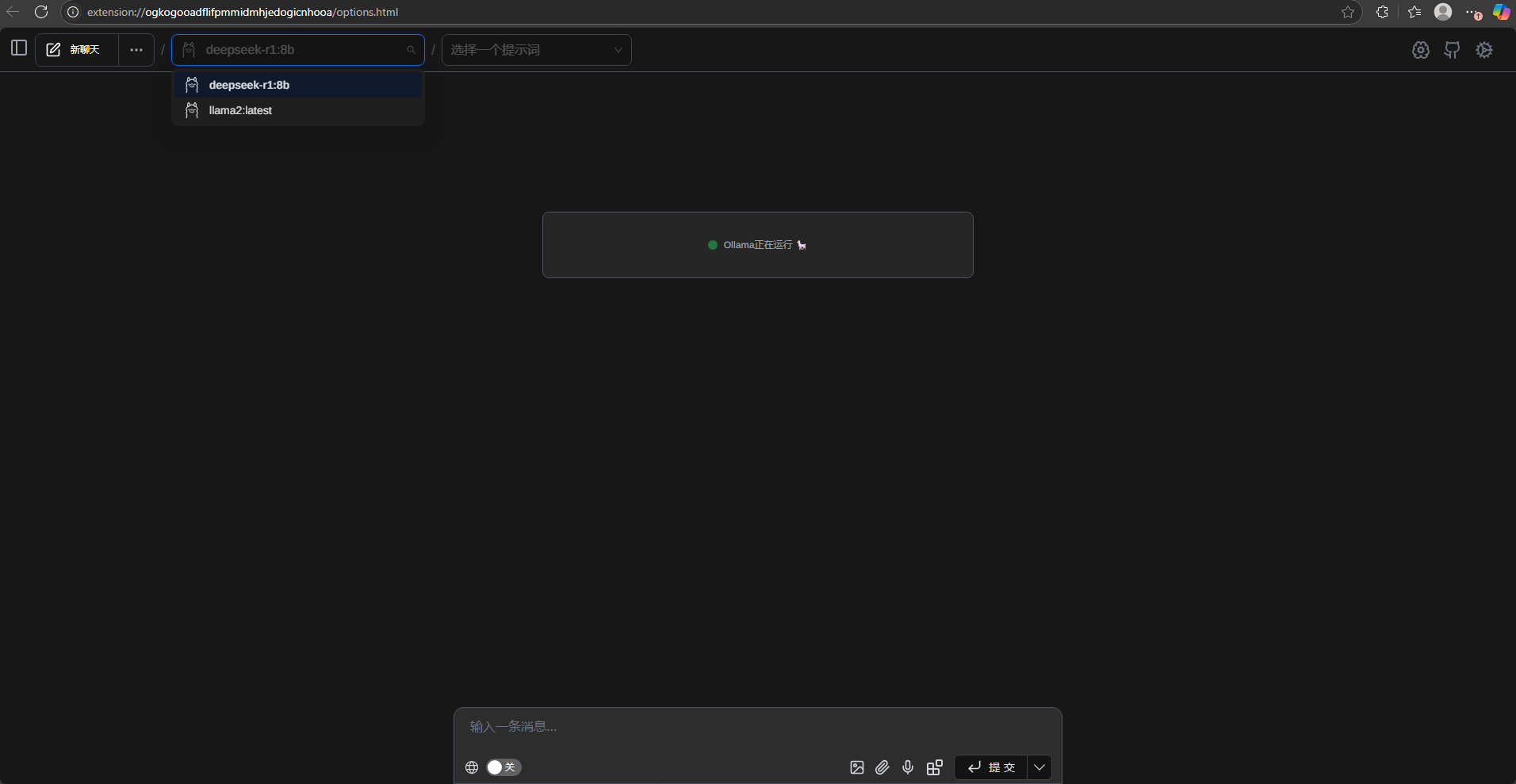

Page Assist - 本地 AI 模型的 Web UI

Page Assist 是一个浏览器插件,安装简单,体积小,国外开发

Page Assist聊天页面

Page Assist设置页面

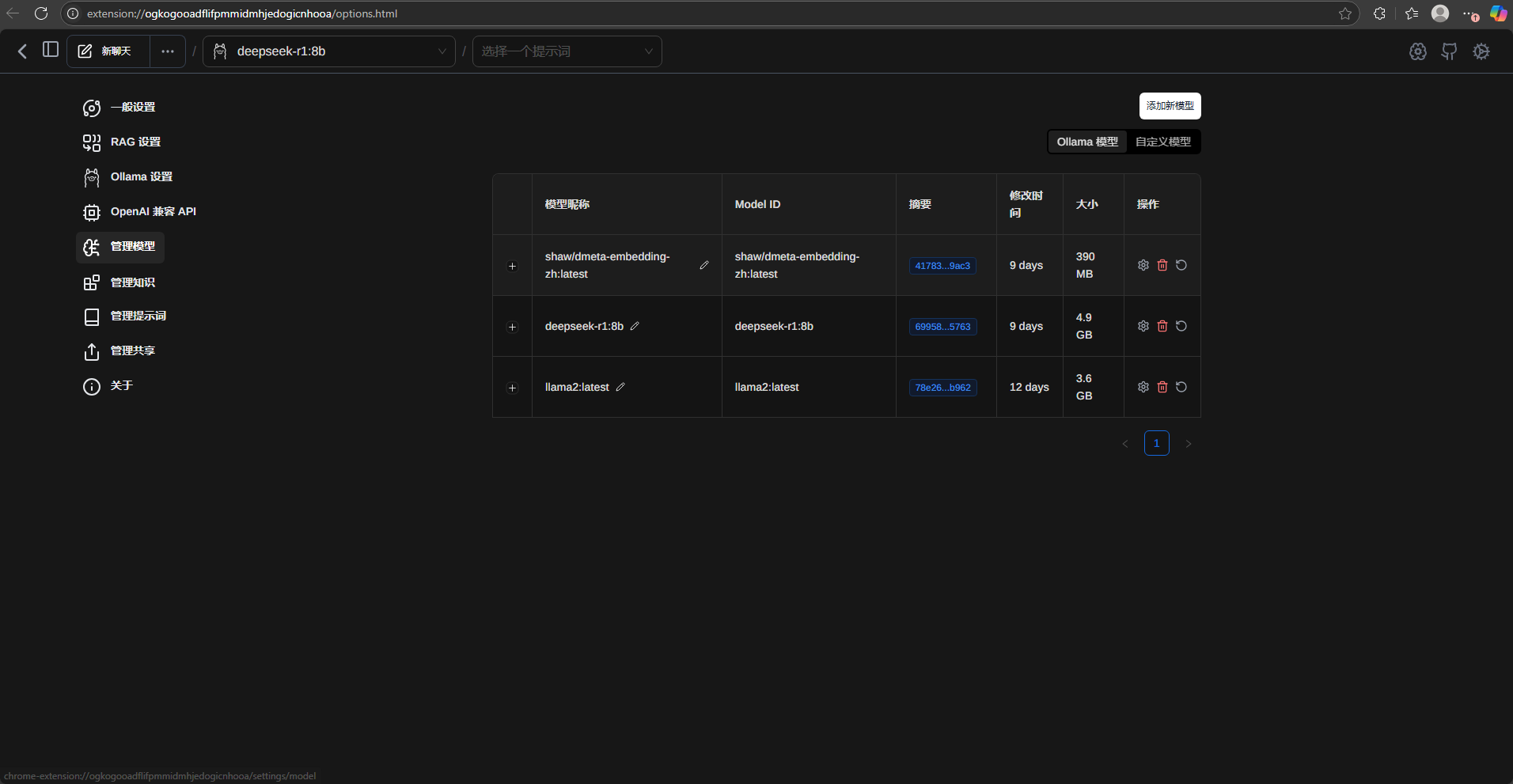

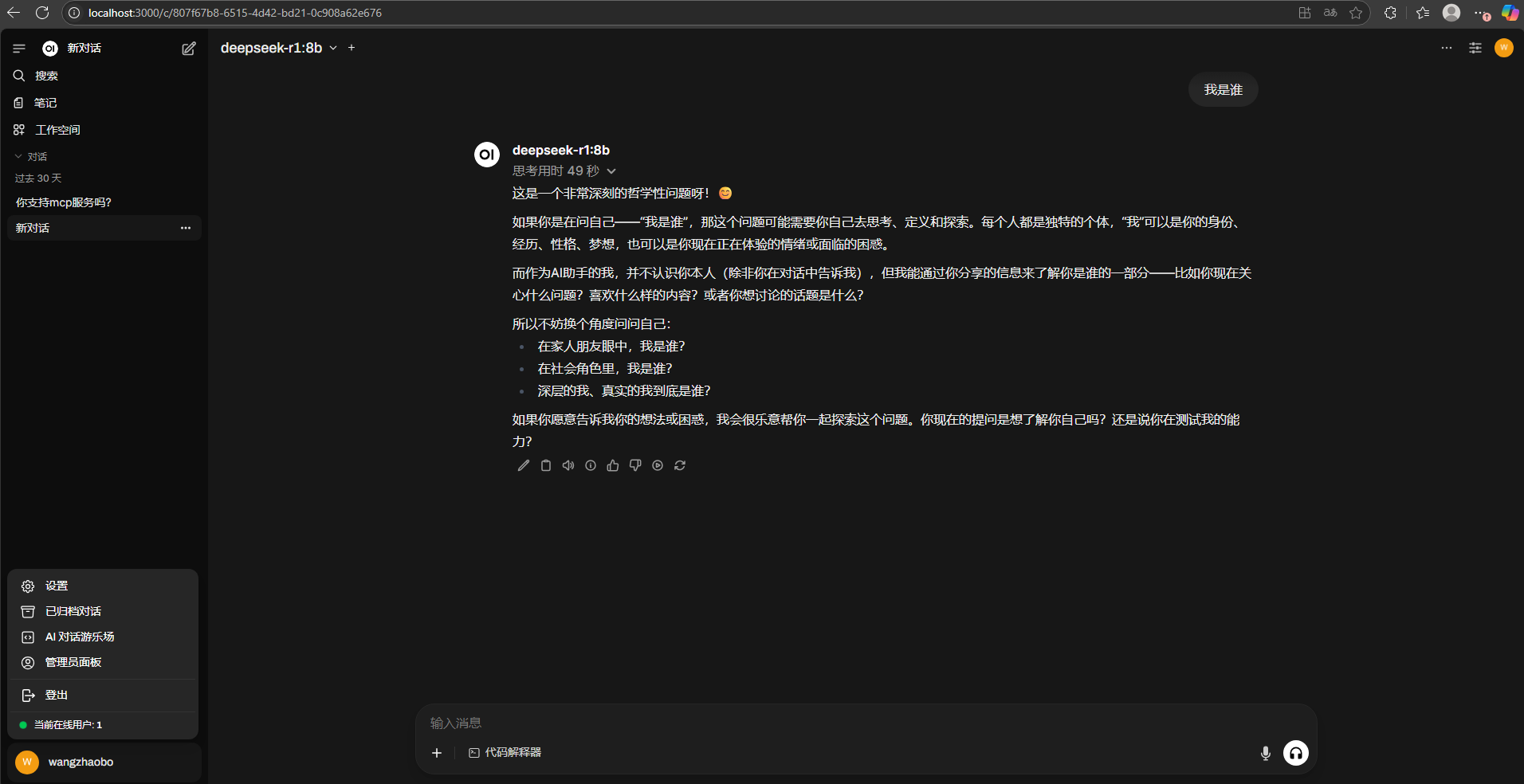

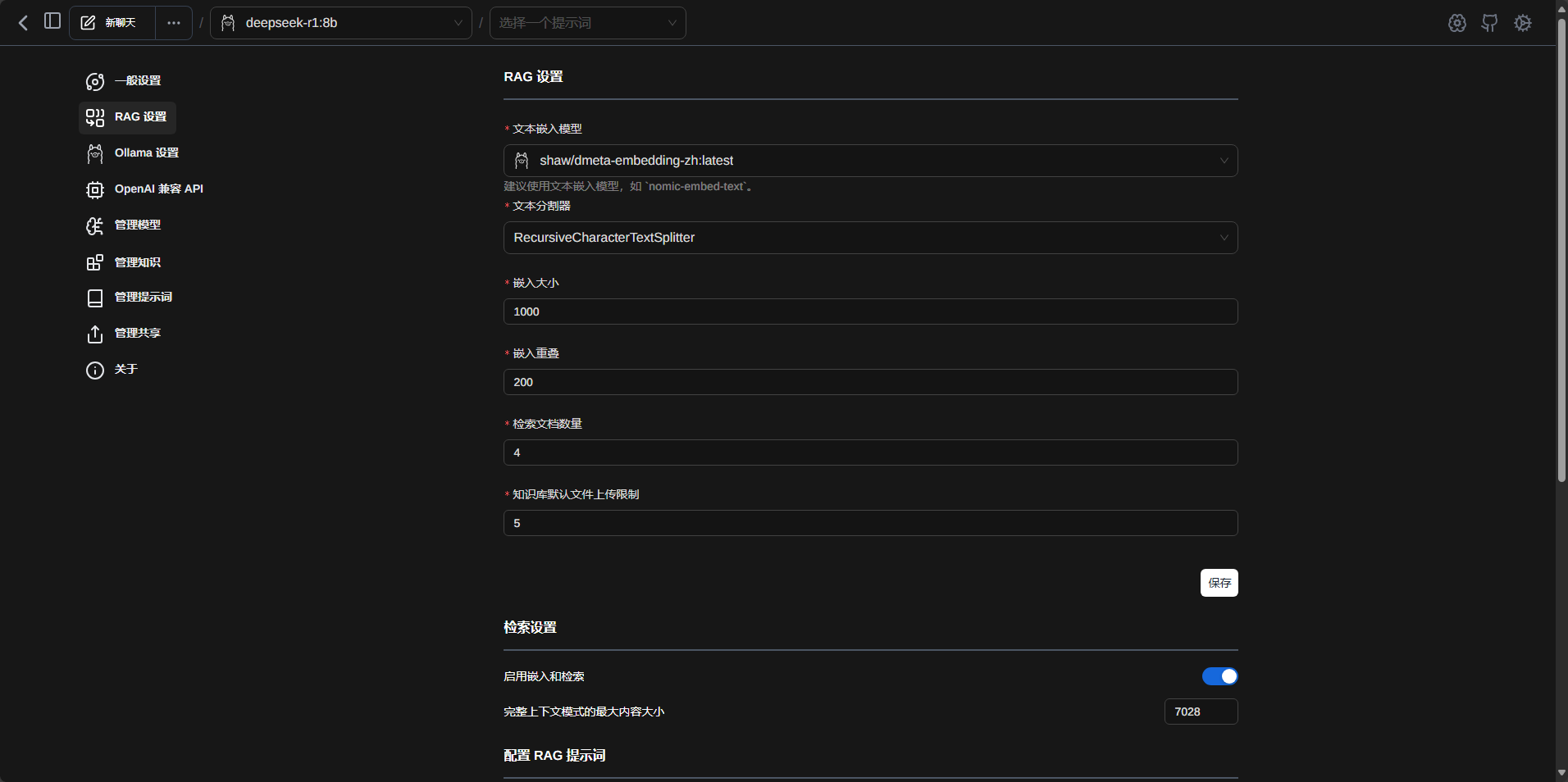

open-webui

比较麻烦,体积大,功能更全,国外开发

docker启动open-webui

open-webui页面

open-webui设置

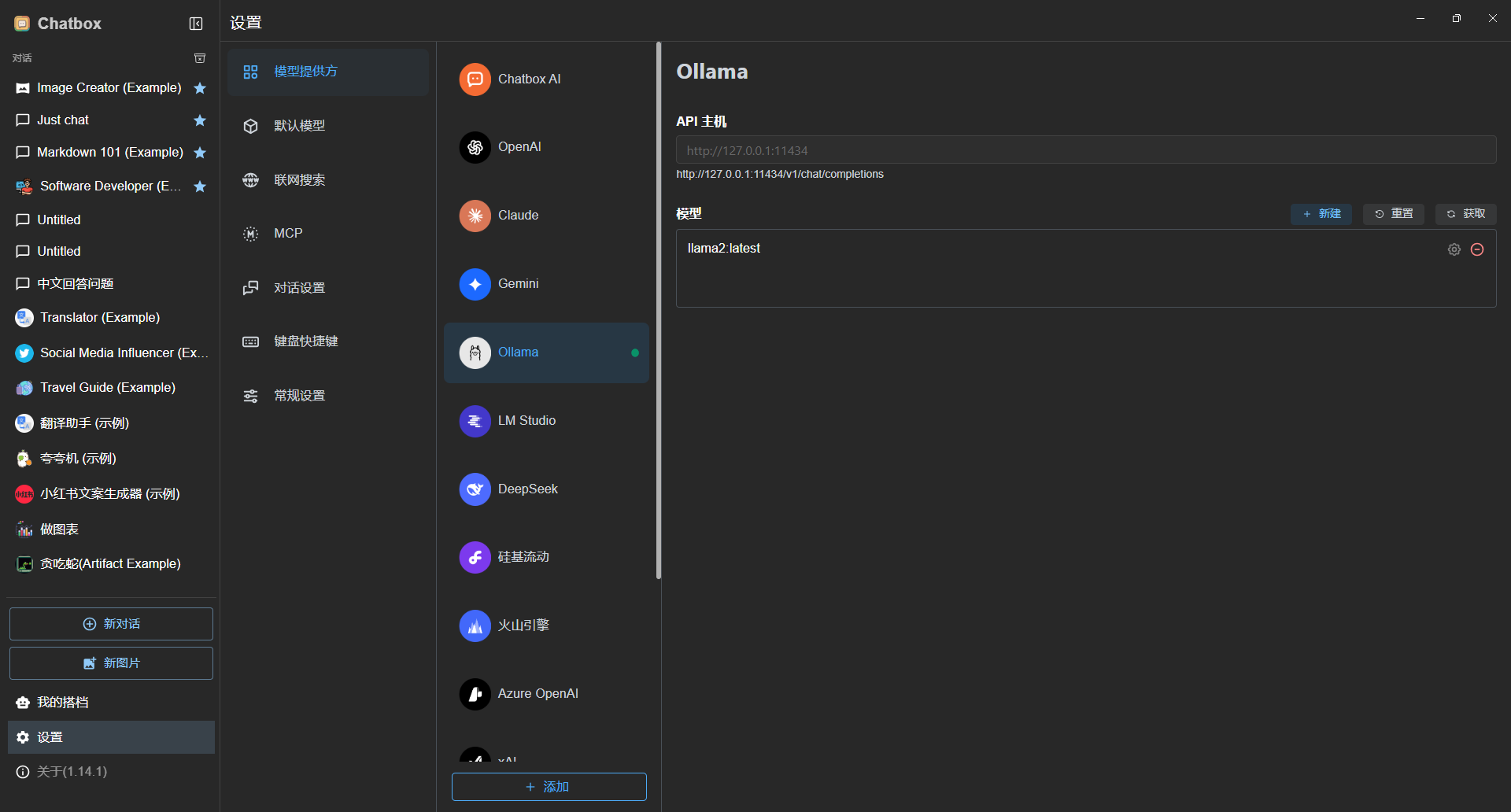

Chatbox

安装简单,安装包一直下一步就可以,国内开发

Chatbox对话页面

Chatbox设置页面

浙公网安备 33010602011771号

浙公网安备 33010602011771号