2024-04-13 - ChatGPT提示工程师 - 吴恩达

摘要

2024-04-13 周六 杭州 阴雨绵绵

小记: 一会儿要去学校图书馆,赶着中午饭的餐点过去,这个时间打扫下房间,学习下提示词,提示词我已经有自己的一套经验体系了,不过还是要和原作者对齐下,不能自嗨式的学习。

课程内容

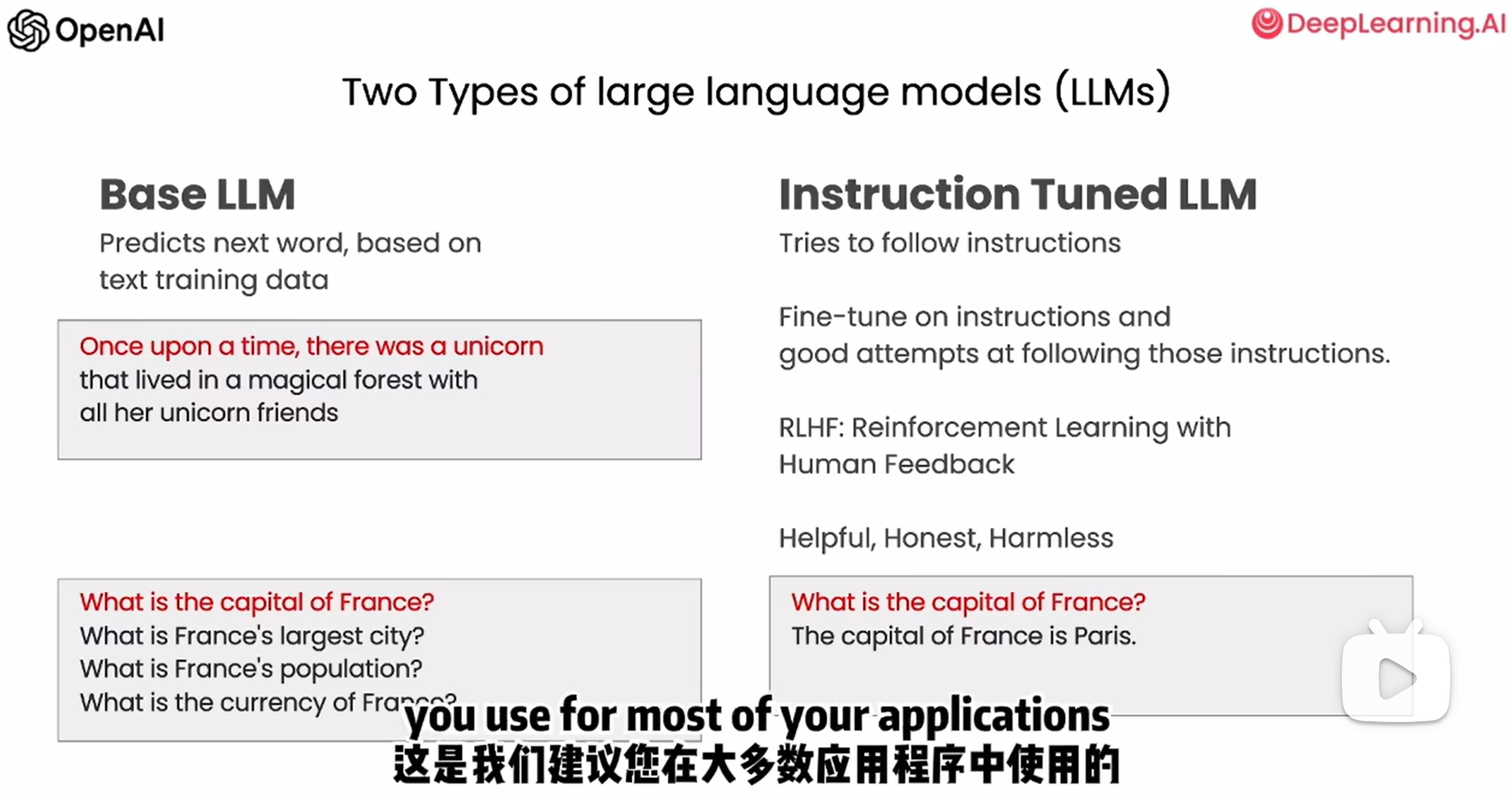

1. 引言

小结: 基础大模型存在幻性的问题,通过指令微调的方式我们可以给大模型加以规范化和条件约束,齐天大圣能力通天又如何,只有戴上金箍才算孙悟空,方能为我所用。

心得: 这个社会不就是如此吗?金钱,美色,权力,信仰都是禁锢那些强者的工具罢了,如果一个人无欲无求,这个社会才算真正是完蛋的,人类用所谓的激励手段训练 AI ,不和统治者用所谓的荣誉和名利控制人民一样吗?别太天真,别太认真。

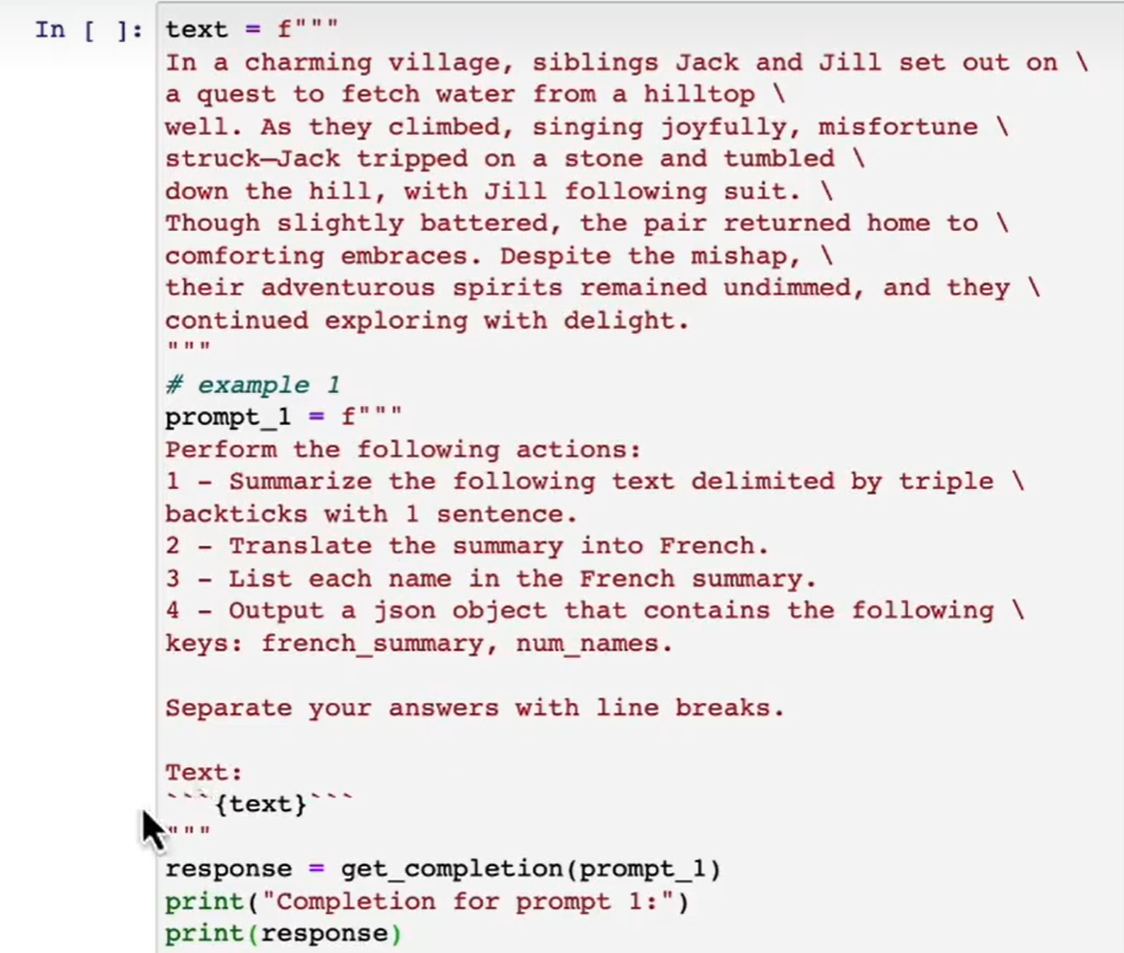

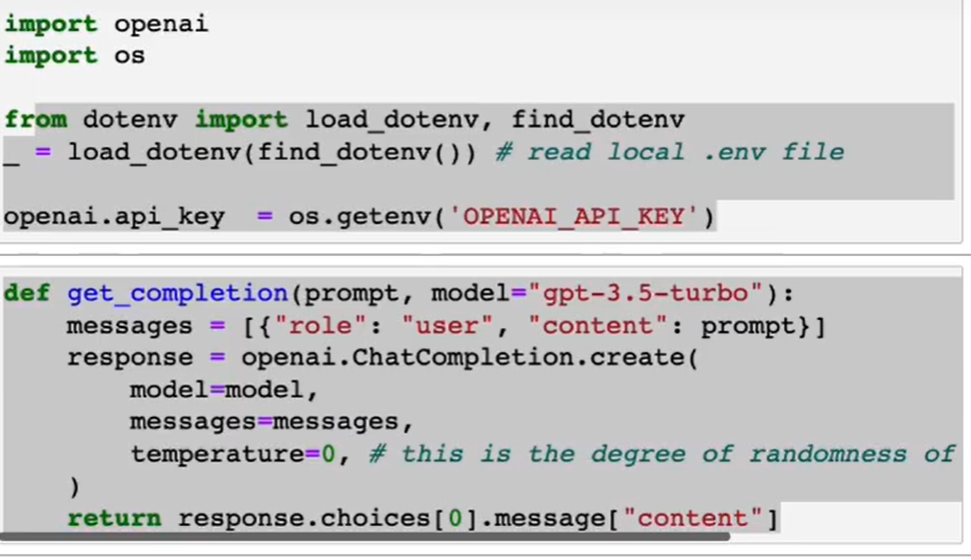

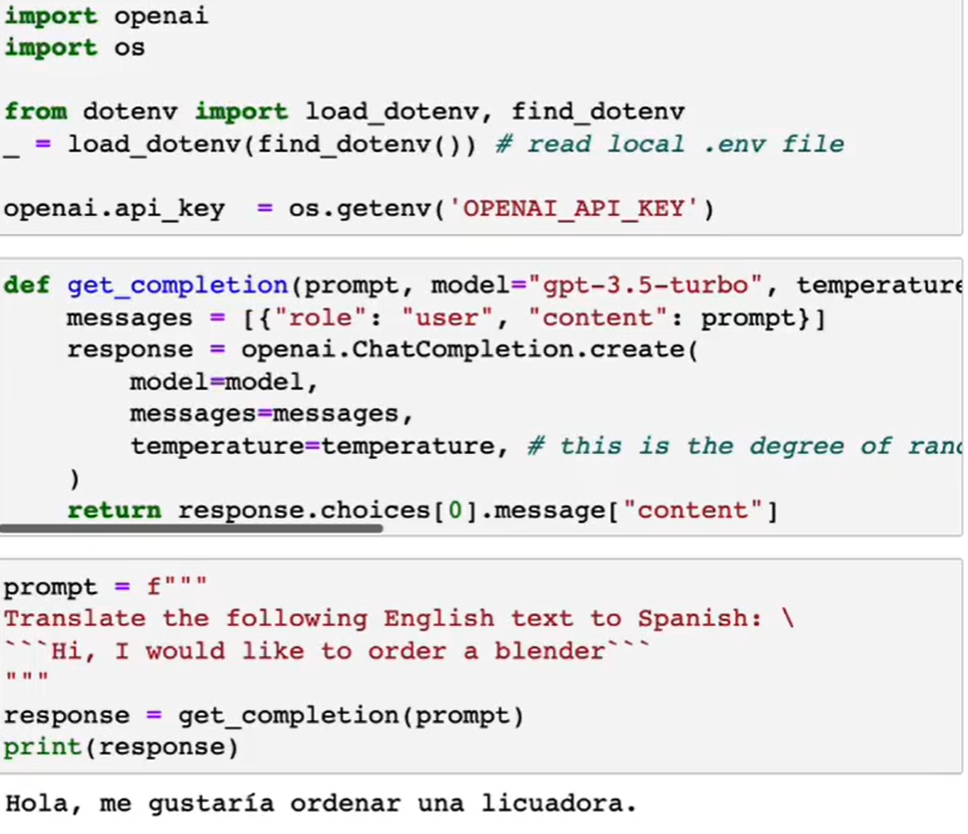

2. 指南

-

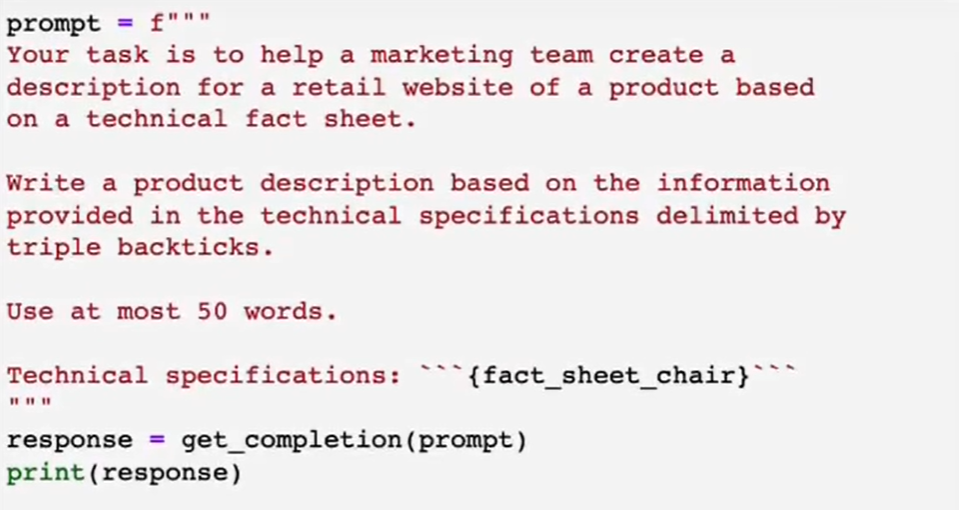

策略原则

a. 编写意图明确的指令

b. 给大模型足够的时间进行思考 -

流程

a. 条理清晰的进行询问,分类输入

b. 结果结构化输出,统一规范对接格式,JSON or HTML,便于接下来进一步的数据处理

c. 基于大模型进行问题的进一步检查确保问题的准确性,优化输入输出提示,基于大模型进行需求描述任务拆分

d. 提供少量有效的训练提示 -

反思

a. 大模型在判断问题时,可能为了快速回答场景问题,没有进行有效的拆解分析

b. 给大模型足够的时间,通过大模型的自我反思不断优化自己的问题从而解决此问题 -

局限性

a. 大模型幻觉,捏造事实,可以基于文本描述减少出现幻觉的可能性

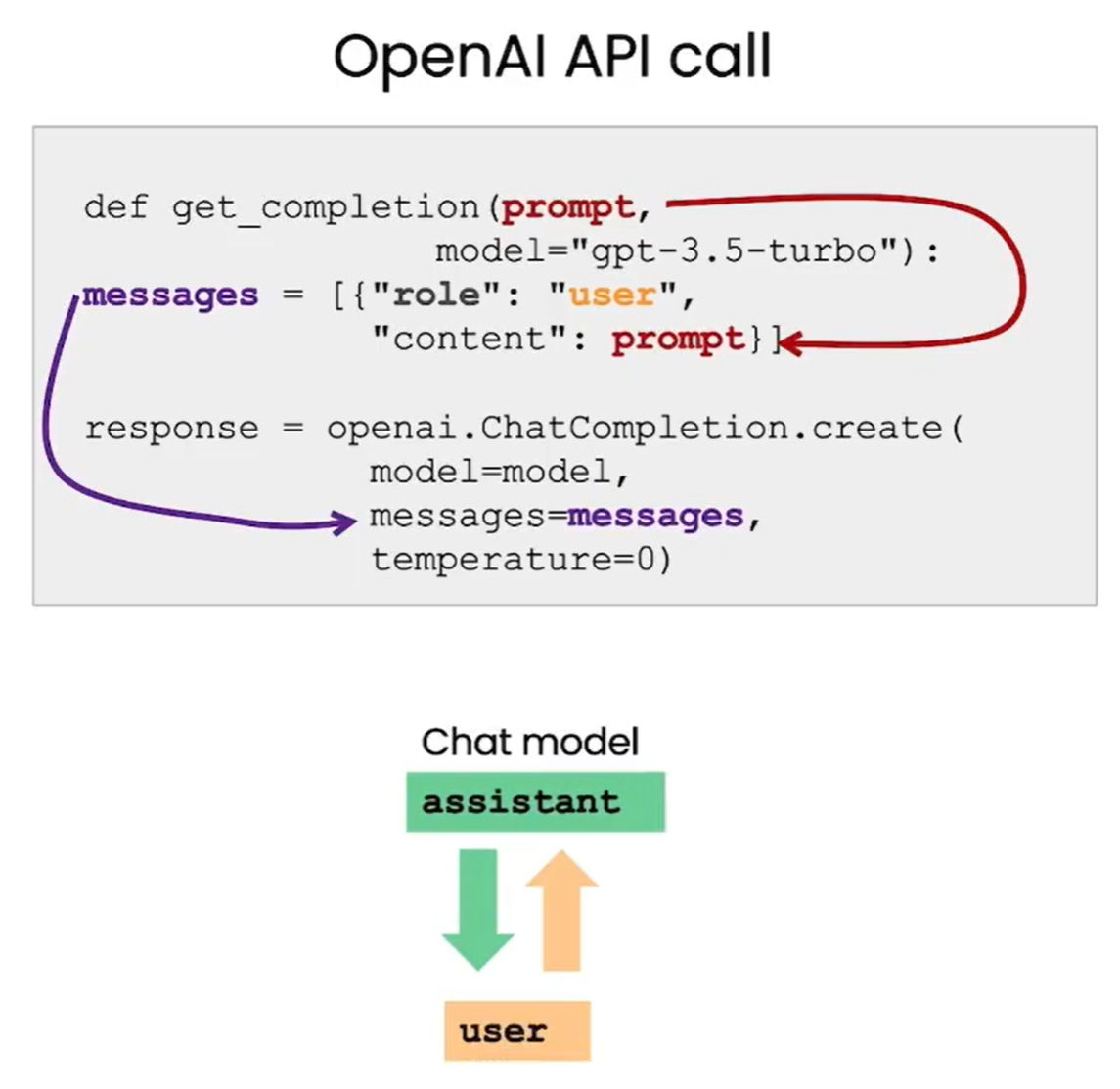

# 安装依赖

pip install openai

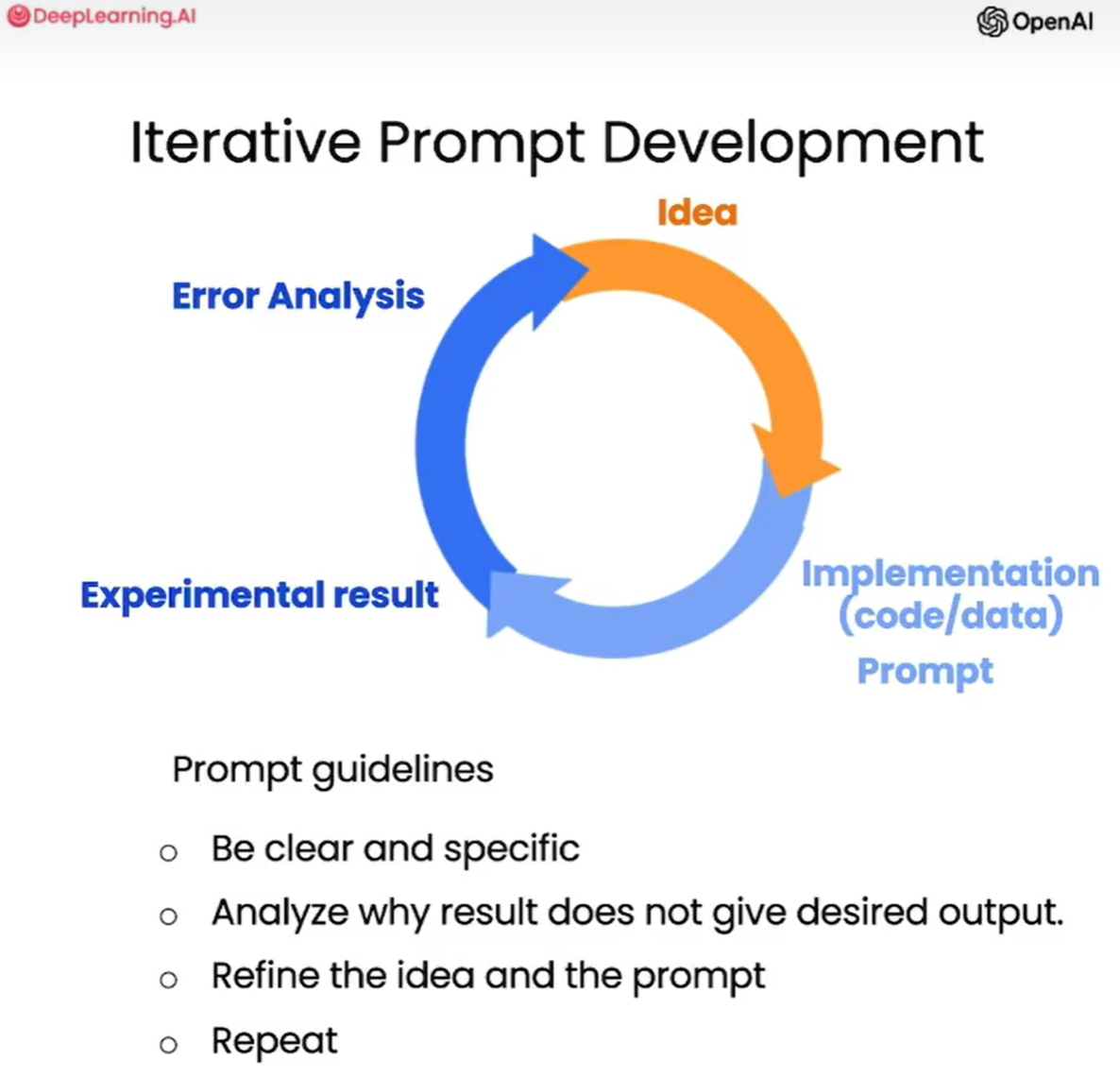

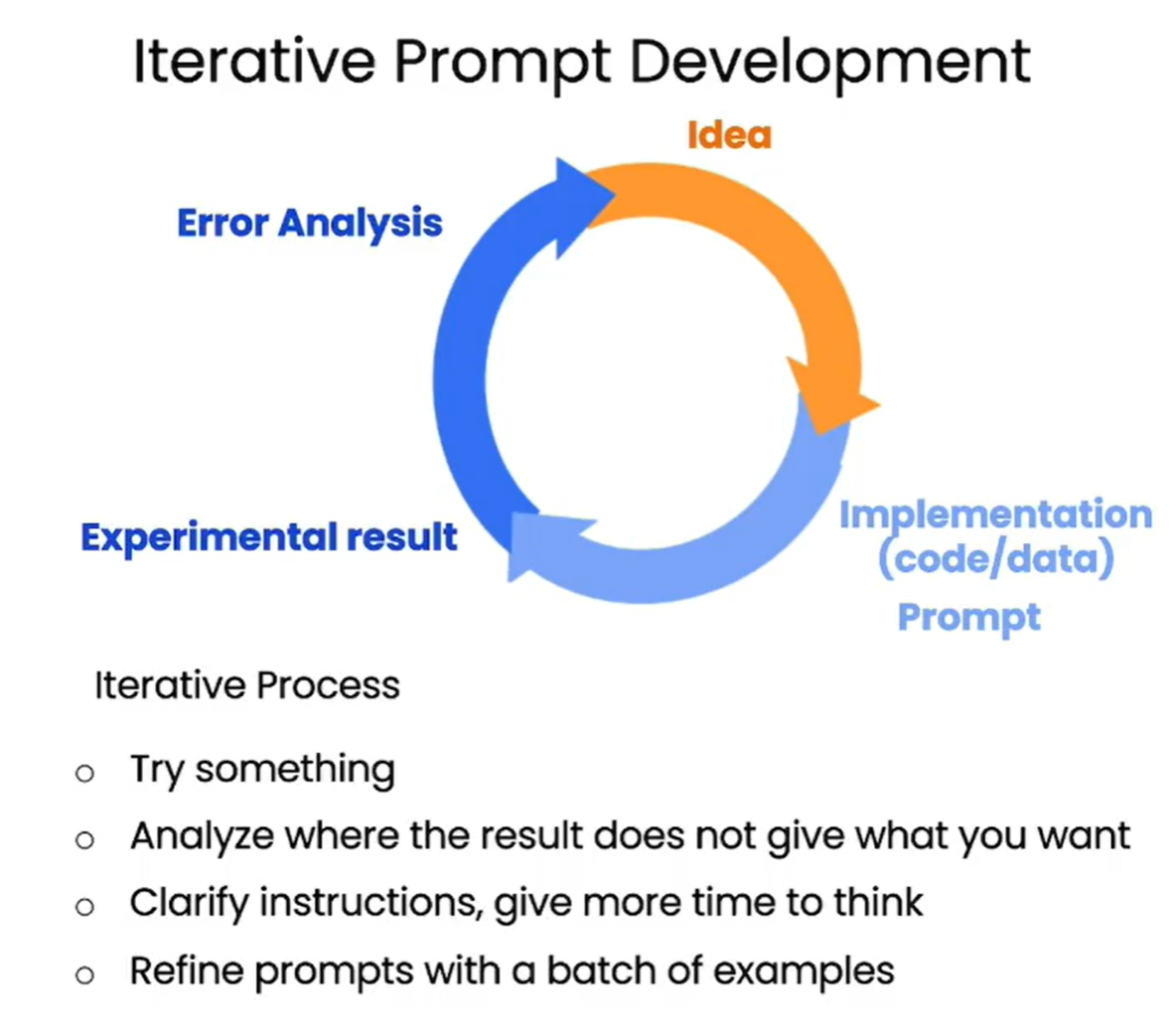

3. 迭代

小结: 大模型的提示词优化过程和机器学习的迭代过程类似,我们很难把自己的提示词一开始就描述到位,这是很难的,这个过程可能会出现很多的问题需要不断的调整和优化。

a. 尽可能清晰有条理的描述自己的需求;

b. 分析总结为什么自己的描述未达到自己的预期;

c. 优化需求描述,更新描述词;

d. 迭代,反反复复;

小结: 提示词过程优化一般流程如下:

a. 尝试提出某个问题;

b. 分析为什么大模型的回答结果不满足预期;

c. 梳理结构,指定输出格式,通过大模型进行优化思考;

d. 通过一系列的demo优化提示词;

心得: 这个世界除了死亡可以一步到位以外,其他任何事情都不会这么轻而易举,上述方法我去年就做过类似的探索,回过头反思的时候这些东西便内化成为了自己的了,聪明人的想法大致相同的,愚蠢的人的思考方向总是千奇百怪。

4. 摘要

信息大爆发的社会,我们不必要再从四书五经中反复咀嚼,但是人无论怎么强大,也是有一定限度的,因此如何让快速的从日常的海量信息中撷取关键信息将会越来越重要。

本来一句话的新闻,人们总爱用各种辞藻修饰,一篇文章可能核心思想也就2-3点,借助AI将依据一定的策略将摘要信息快速的总结未尝不是一种有效的方式。

# 伪代码

for i in range("核心分论点"):

prompt("解读论点的方式")

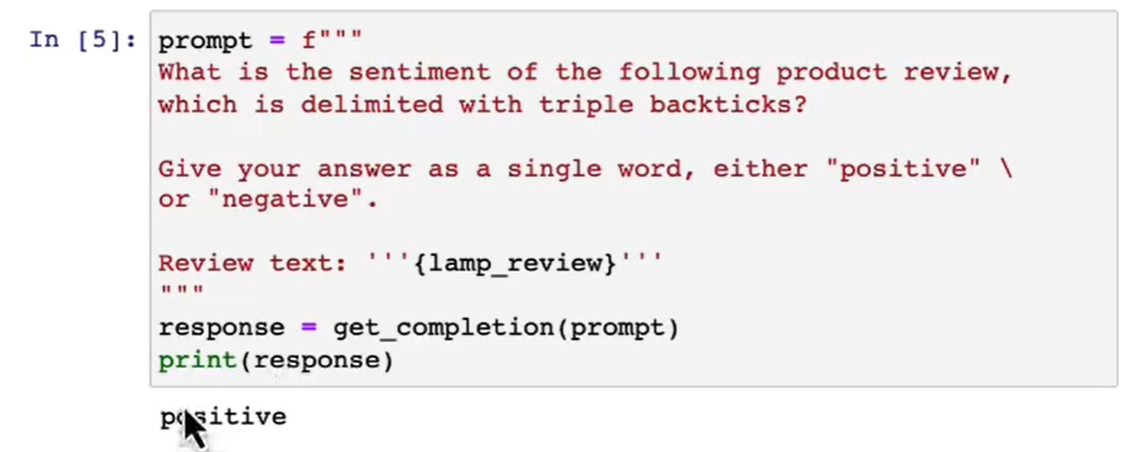

5. 推理

推理统计,利用大模型可以完成高效的推理统计工作,比如之前的情感分析和舆情监控,虽然通过机器学习也可以完成类似的任务,但是总归流程过于繁琐,因此通过大模型技术可以很好的完成推理工作并进行数据整合输出。

6. 转换

小结: 利用大模型进行文本转换可能是大多数使用对话大模型的一种选择,比如平时编码时,我就经常让大模型把文本进行结构化转换,比如结构体向 gorm 的 sql 进行转换,提示词国际化时,把提示词转换为各国语言。

心得: 老家的教育很难讲,尤其英语一直很差,就算勉强考上大学后,对英语却也是没有什么热情,除非是为了考试,否则不太想学英语。不过这两年确实有很大的改观,当我意识到中国有人将英语能力作为一种阶级区分的指标的时候,我便不再那么讨厌学英语了。应为这样子,英语便拥有了实用性。

7. 扩展

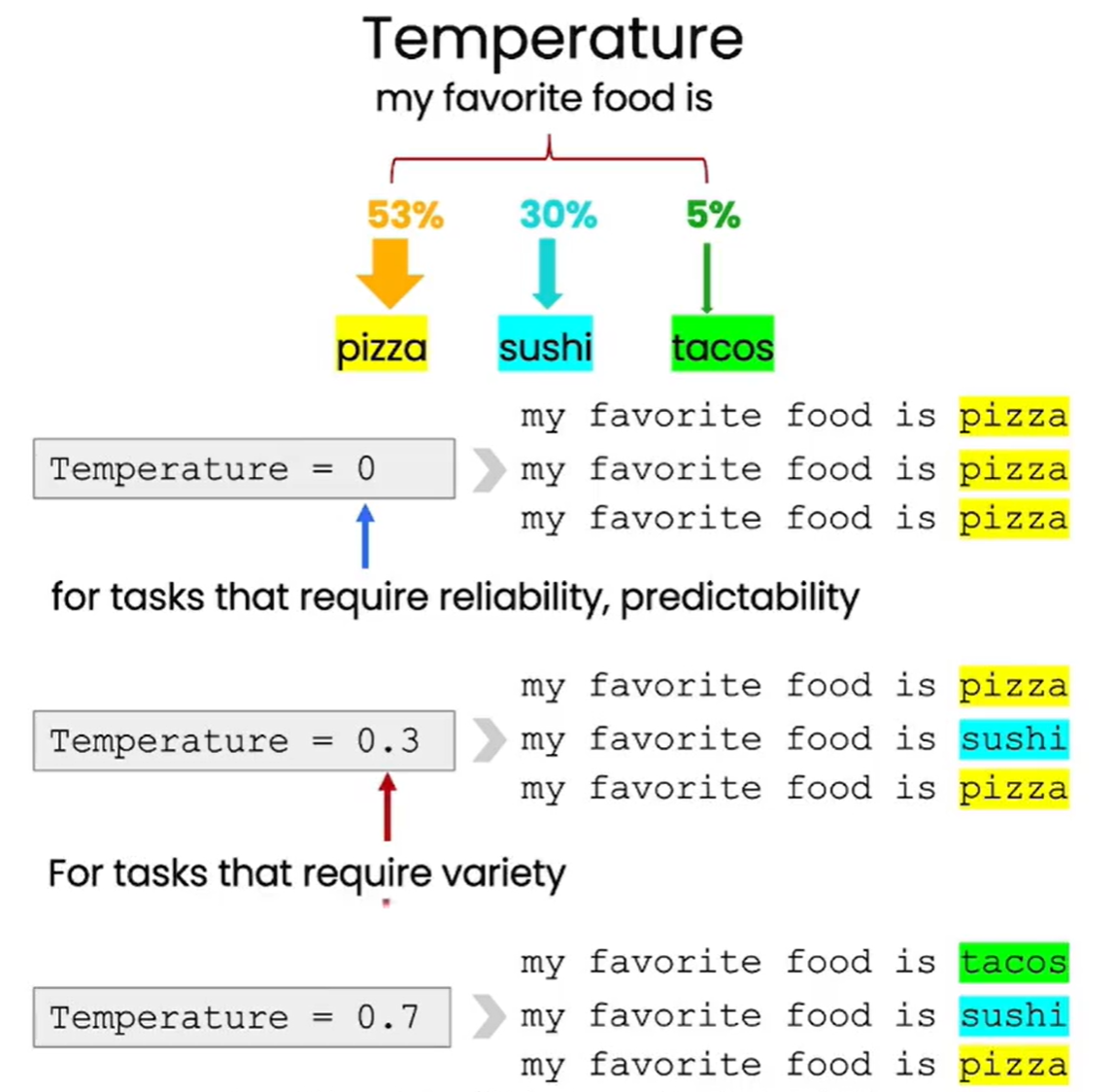

小结: 扩展就是基于模型更多的随机性,创造性,毕竟像人一样耍无赖也是一种技能。

8. 聊天机器人

- 智能助手原理

小结: 就是套框架,做一个对话框,技术还是原有技术,只是因为多了一个大模型的大脑所以才十分有趣。

总结

怎么讲呢?23年初的时候,自己就通过使用大模型总结了一套自己的使用模式,和本课程中的介绍类似且相似,但是没有做高度总结。23年我一直在做相关实验,但是并没有进行太多课程的学习,原理性的知识也没有太深入。使用大模型重构应用程序,利用大模型进行软件项目开发将会是一个很明显的趋势,这样的过程需要不断的探索和总结。这种课对我来说意义不大,顶天了学习下英语,反思下自己的思考模式。这种课也是常识课对于每一个人来讲都要掌握的,因为这种课程并不依赖微积分和大学高数。

浙公网安备 33010602011771号

浙公网安备 33010602011771号