2024-02-03-人工智能一般常识-卢菁

摘要

2024-02-03 周六 快乐老家 暴雪

小记: 飞雪,灯火,小年夜

课程内容

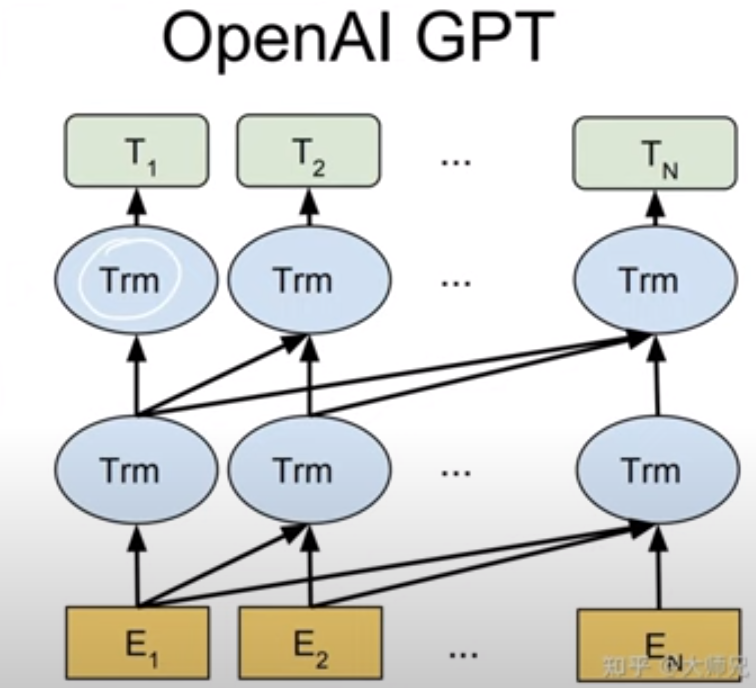

1. 模型基础(transformer)

2. 为什么要学数学

关键词(高数,线性代数,概率论,数字逻辑):

a. 加深对问题的理解;

b. 可以更好的进行创新

c. 面试需要

3. 学数学学哪些?

- 线性代数

- 微积分

- 概率论

4. 人工智能中的数学怎么学?

- 快速过一遍,不要陷入细节;

- 拿到模型先运行起来再说其他,先跑通代码再看细节;

- 根据背后原理进行模型优化和改进;

- 总结 + 归纳

5. 大模型训练为什么如此难?

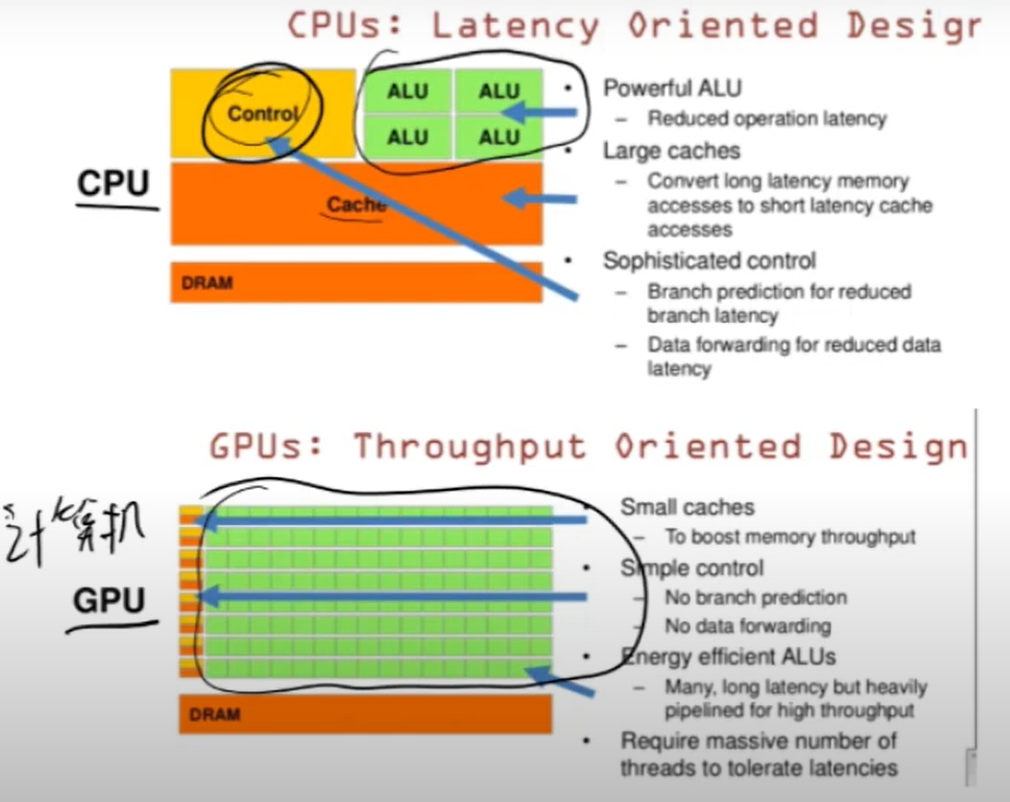

- CPU vs GPU

关键词: 从架构设计上看,gpu 并行能力天然优于 CPU ;

a. gpu 设计架构天然是多计算单元;

b. 并性能力强大;

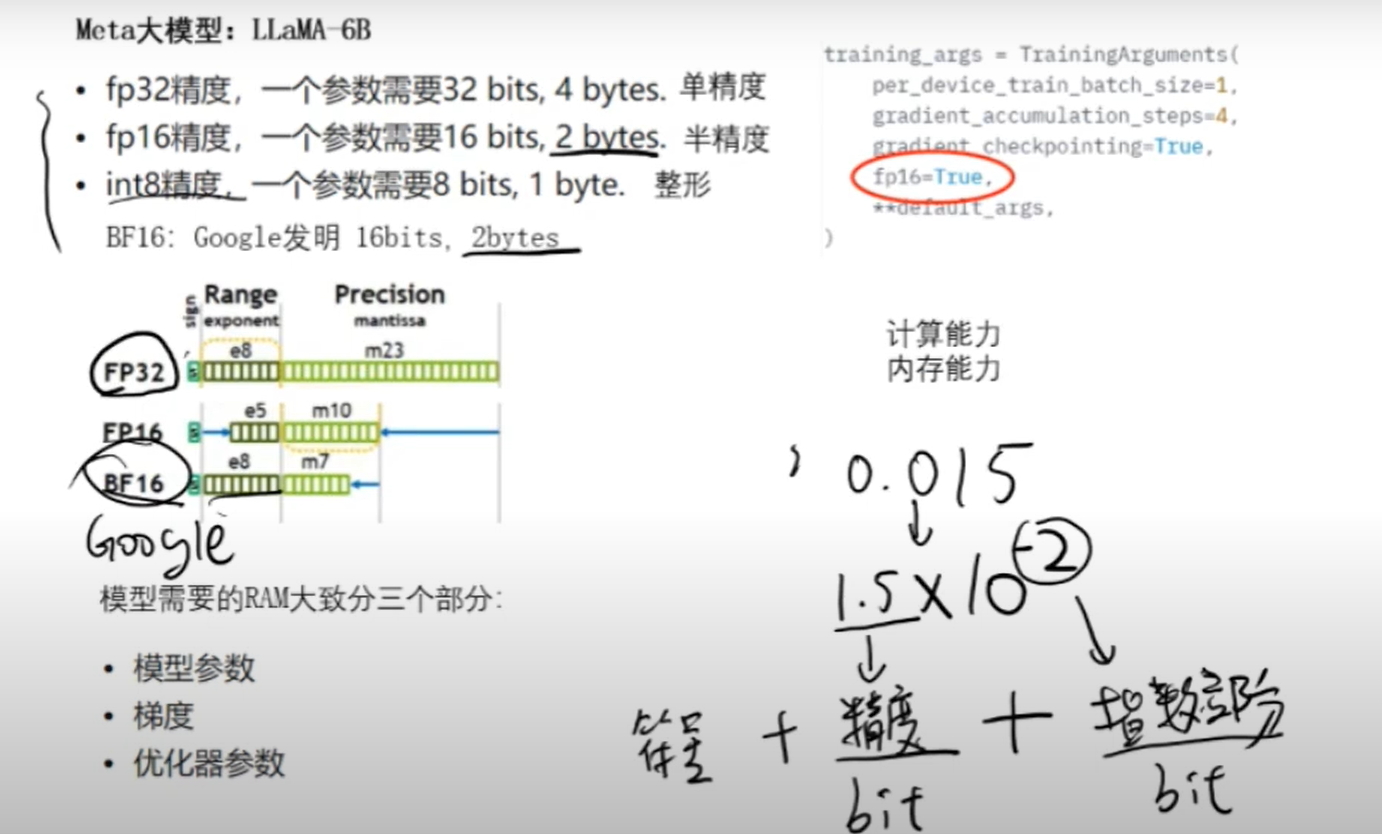

- 精度

关键词: 指数对于名训练的准确性更为重要;

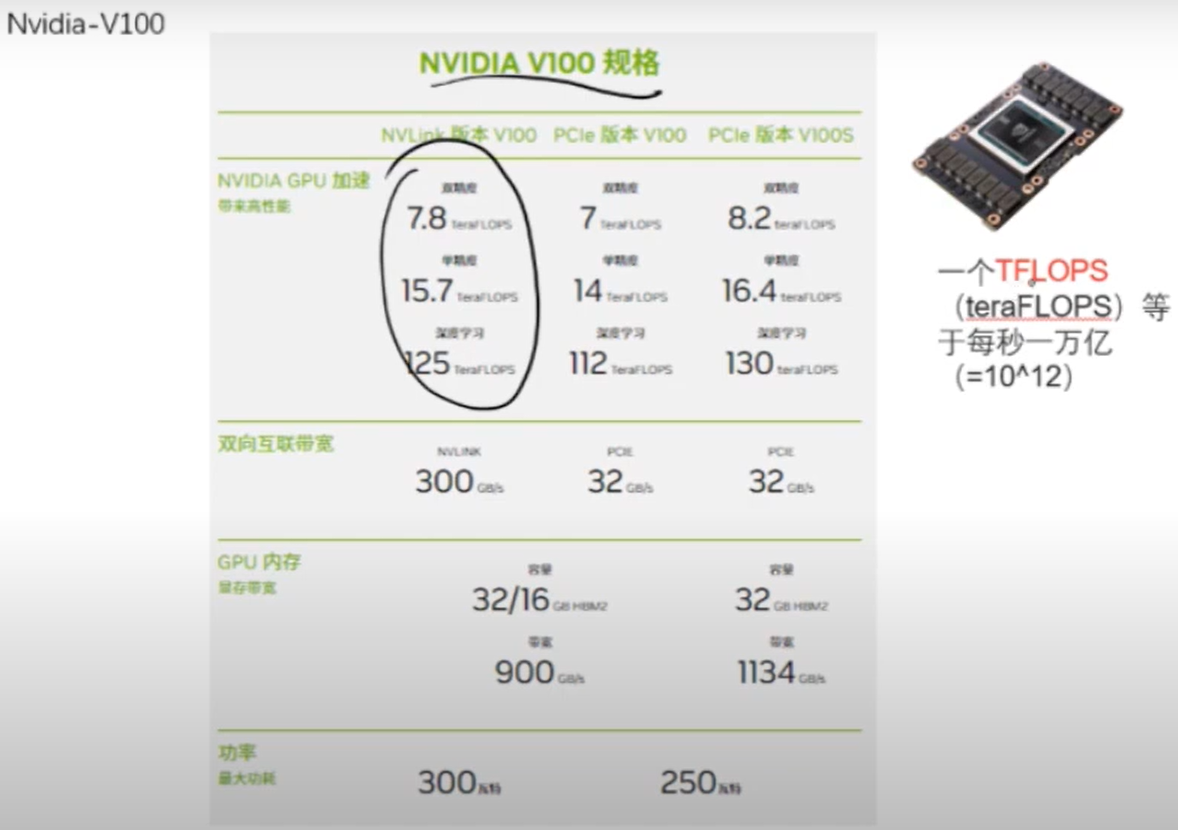

- V100 规格

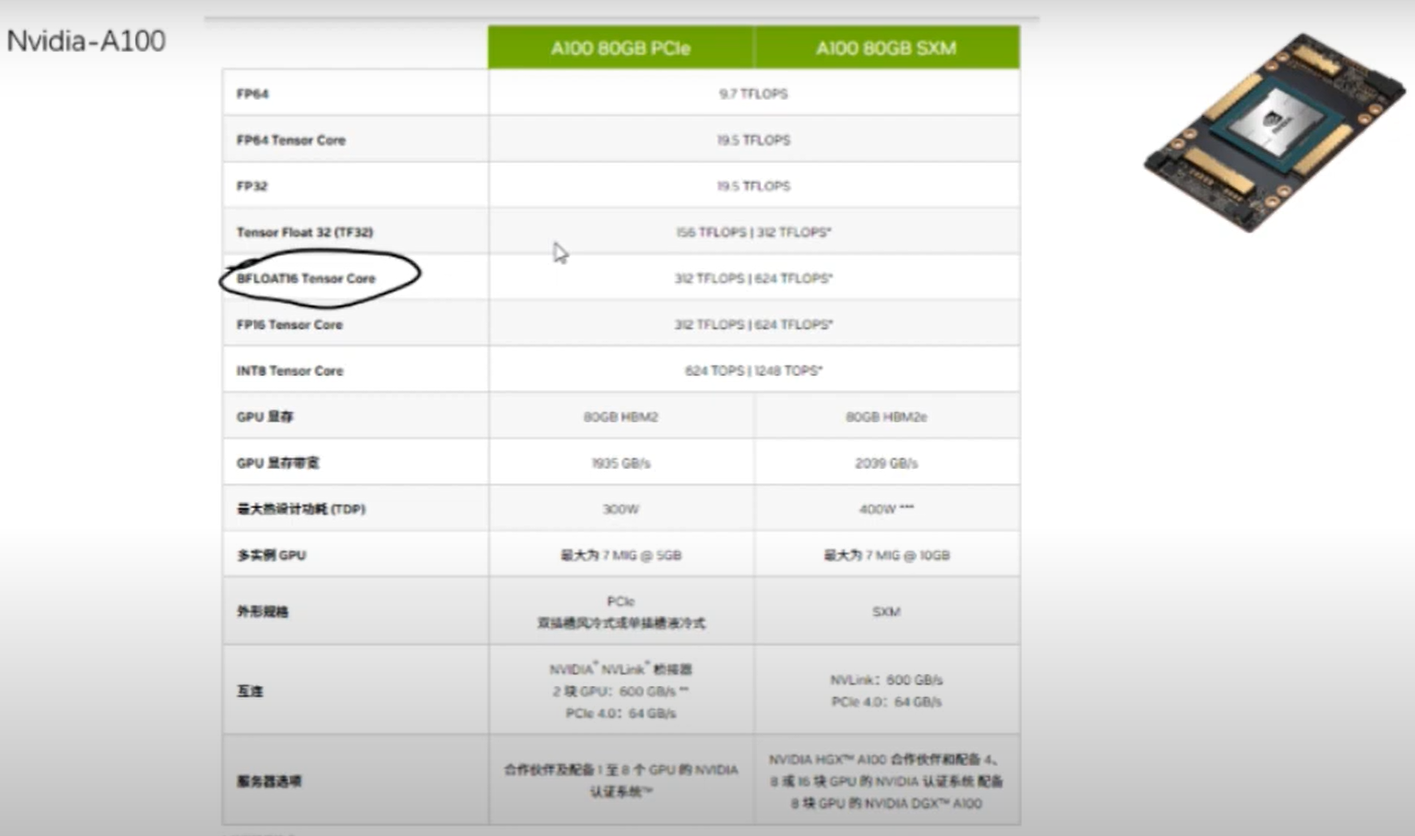

- A100 规格

关键词: A100 支持最适合深度学习的精度格式,并且性能远高于 V100 ;

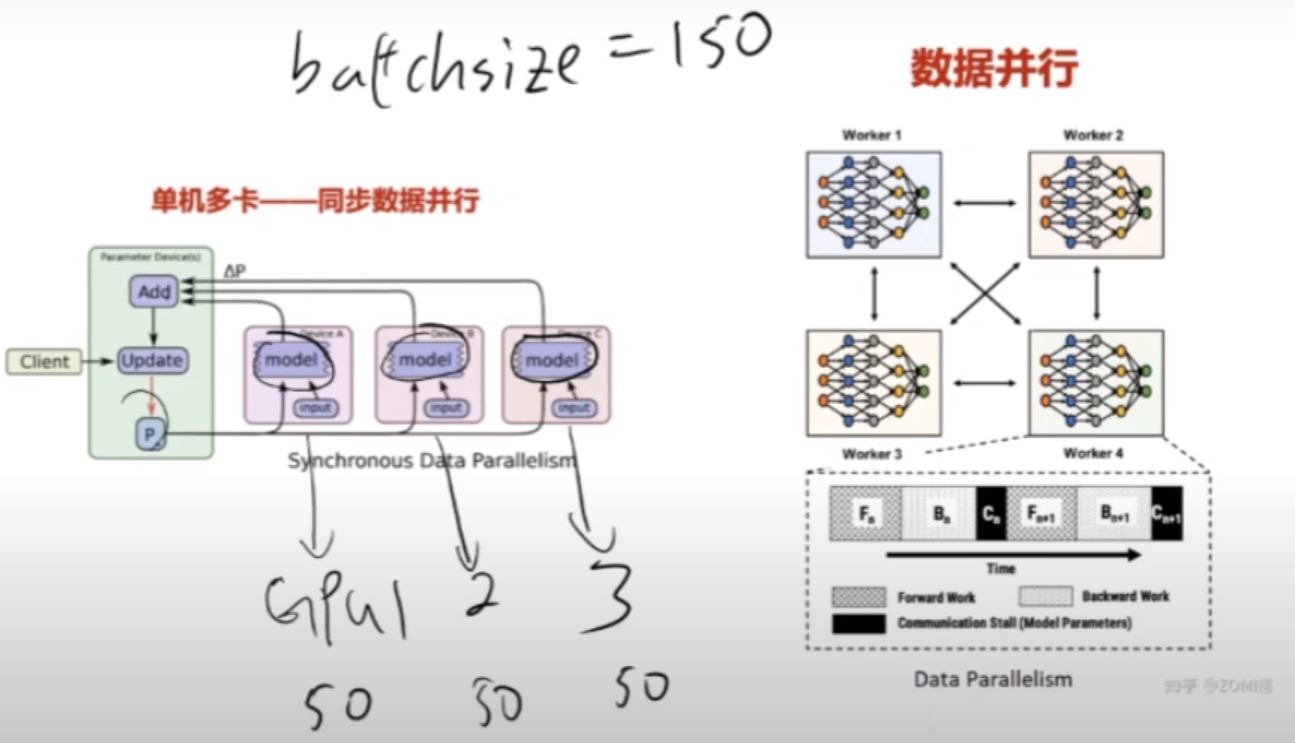

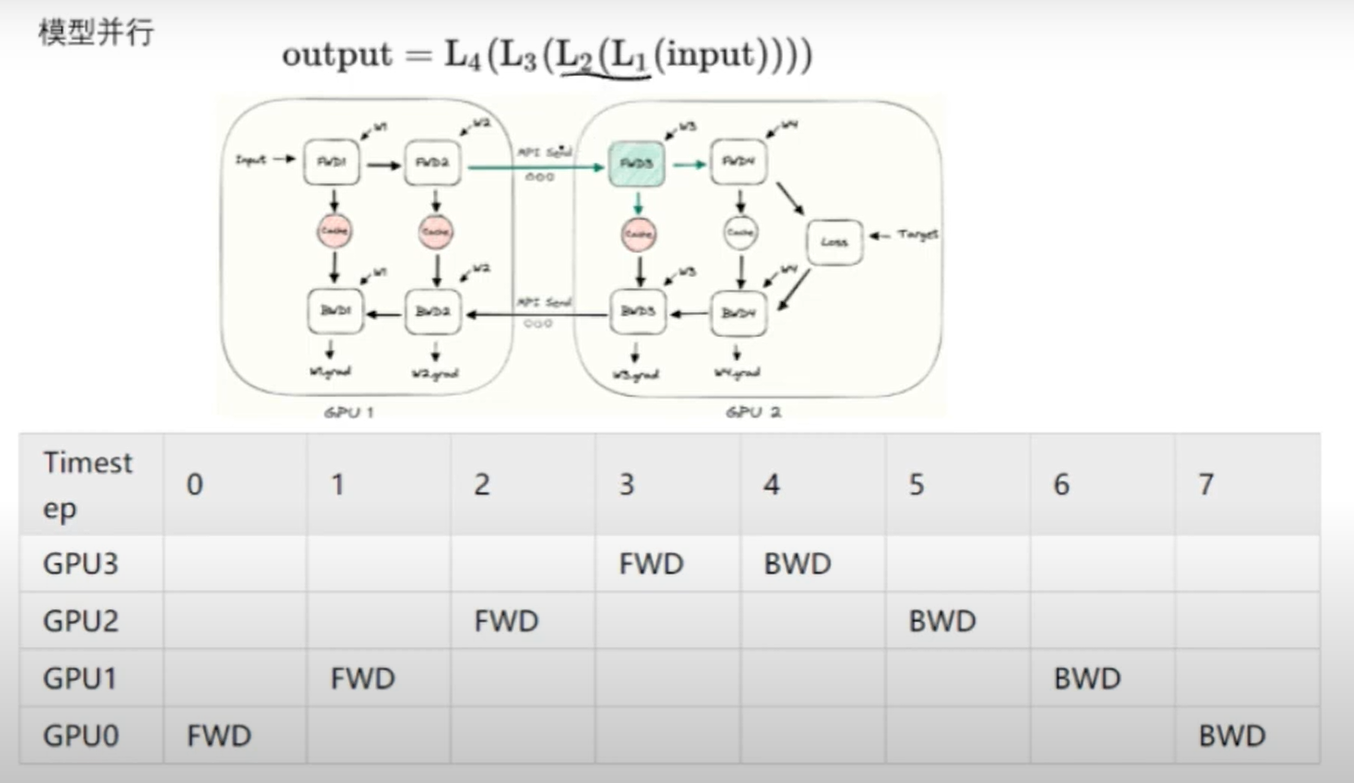

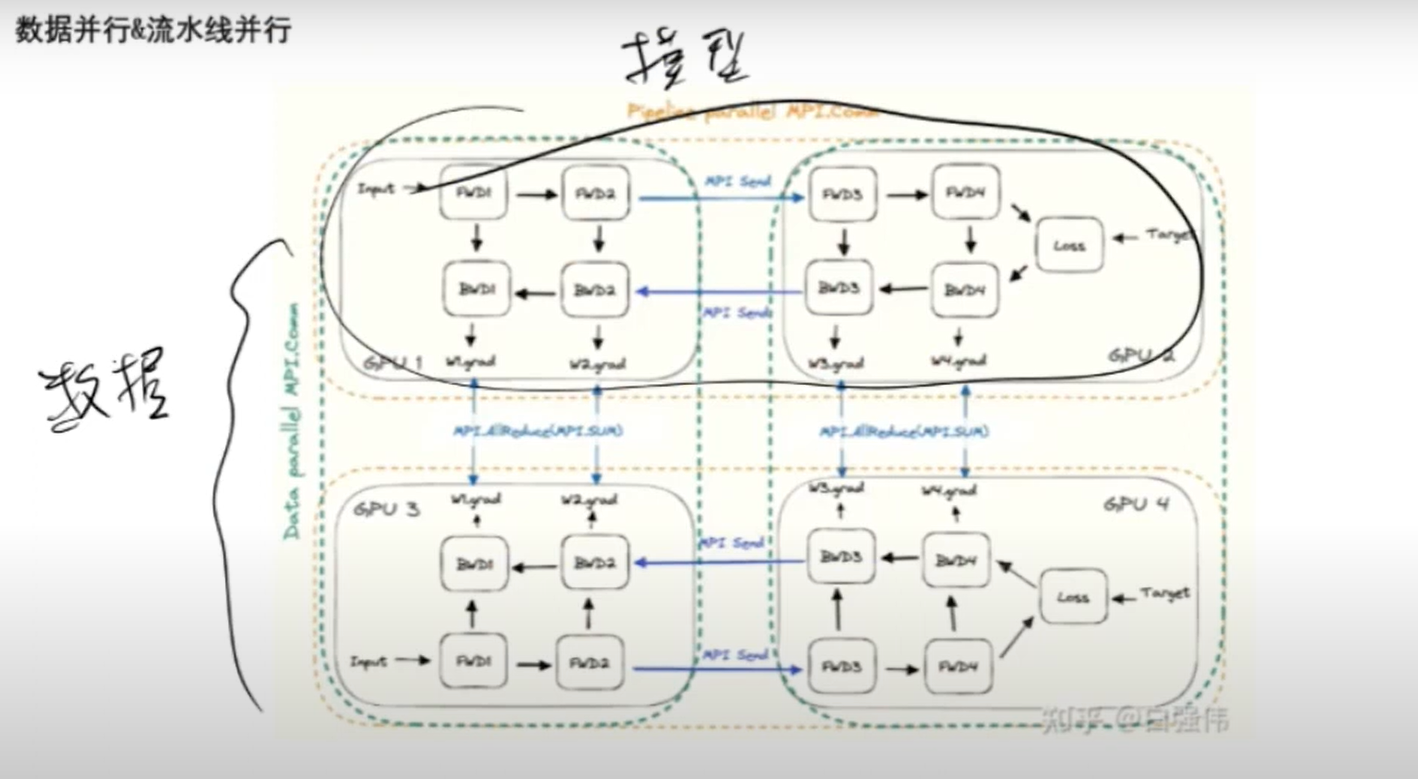

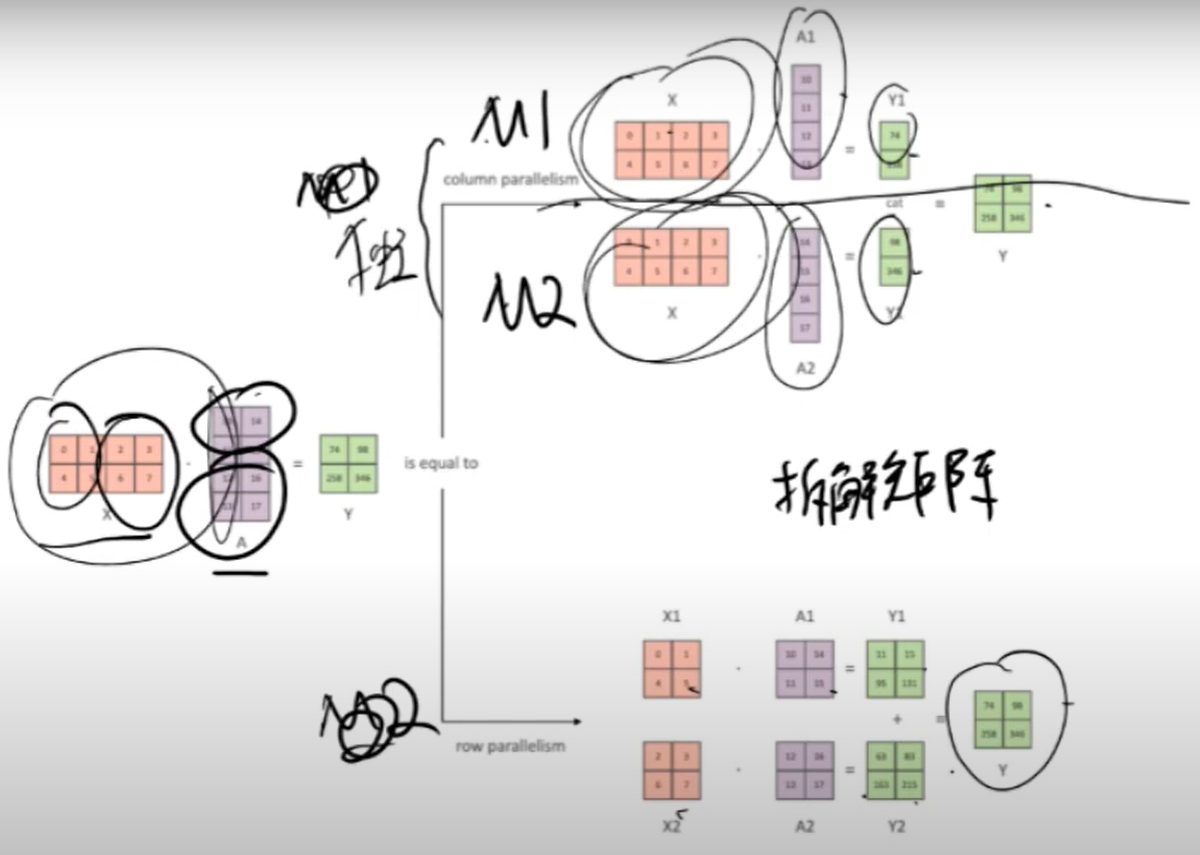

- 并行计算方式

a 单机多卡(浪费资源空间)

b 模型并行(串行执行,资源浪费)

c 矩阵拆解

关键词: 大模型训练的时候,涉及到很多的矩阵运算逻辑,如何更好更合理的利用 GPU 资源,不仅要从资源整合,算力调度,算法模型等角度考量,也可以通过合理的策略拆解大的矩阵模型从而实现最佳的调度优化。也是管理学应用的体现,机器资源是切实的最佳员工,不会像人一样抱怨,不会像人一样拉帮结派,勾心斗角。只要策略资源合理,机器便会给你等同的回馈。

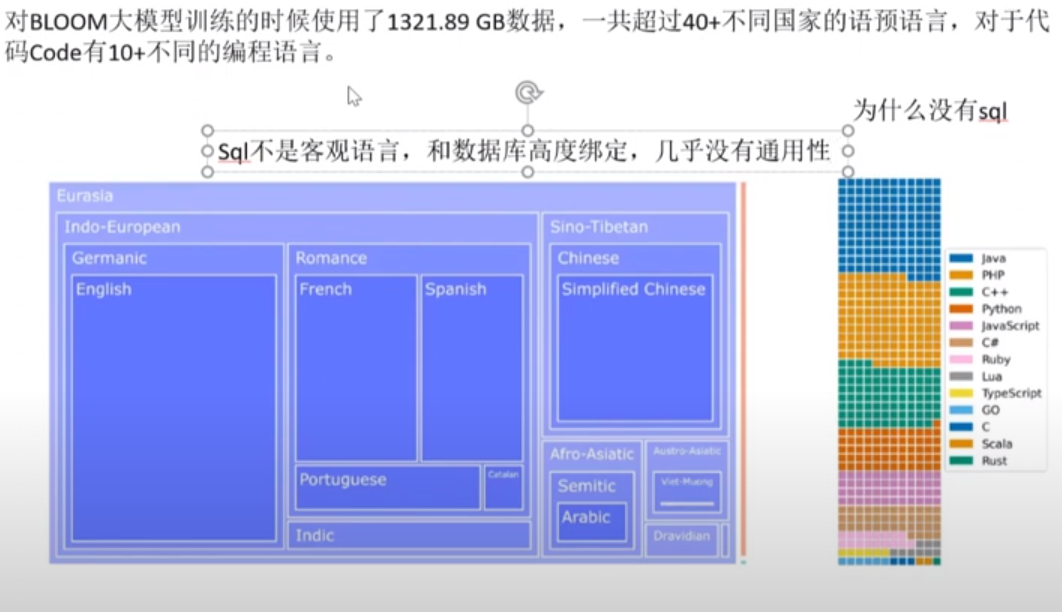

6. 大模型分类

- 基座模型: GLM , gpt 具备语言理解能力,但是不具备对话能力;

- 对话模型: chatGLM, chatGPT 在基座模型的基础上进行对话的专项训练

备注: sql 不是客观语言,sql 和数据库高度绑定的,因此不会专门将 sql 进行专门的训练。

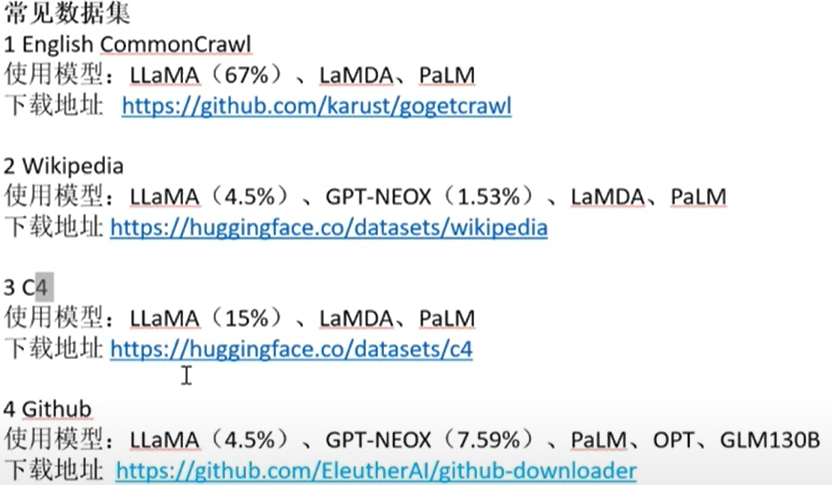

7. 大模型常用训练数据集

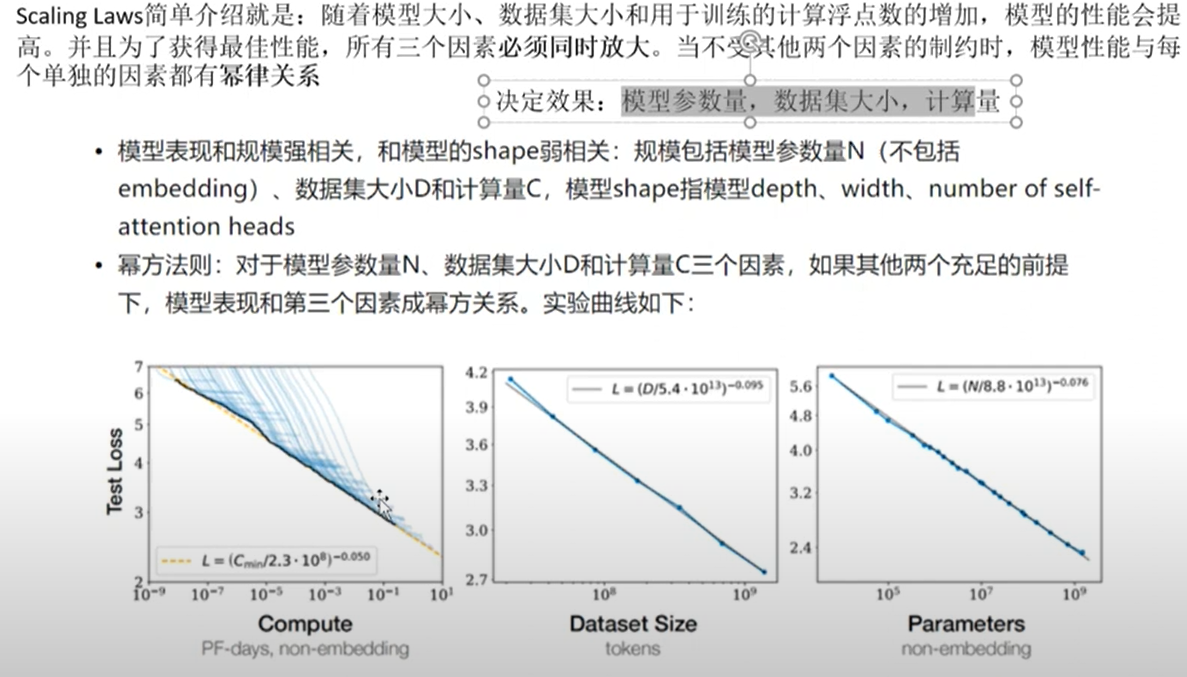

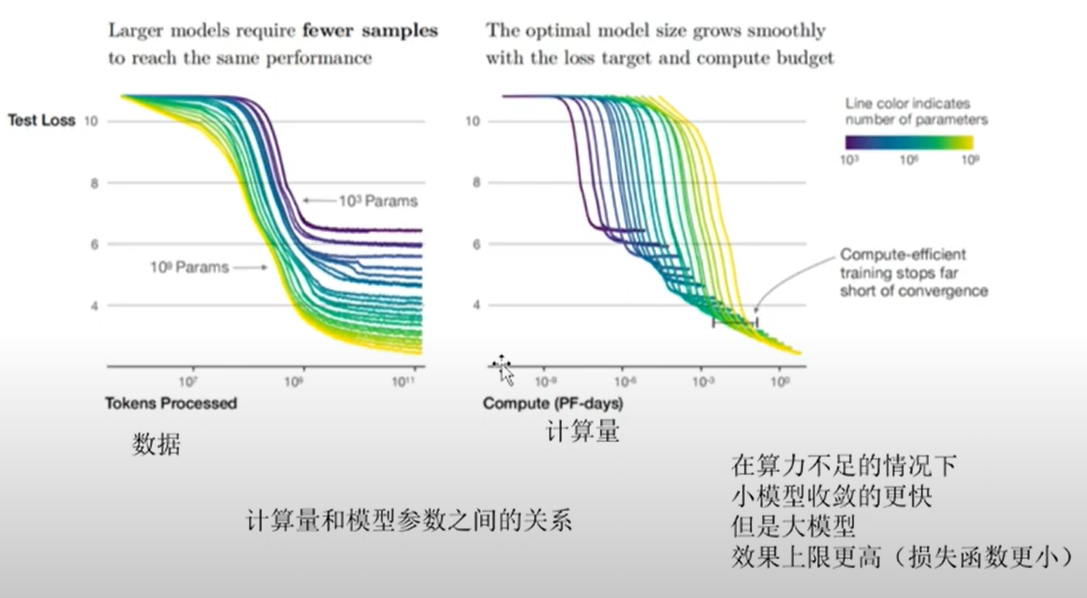

8. 幂律关系

关键词: 算力不足的情况下,使用小模型进行训练,收敛更快,因此相对效果更好。不要小牛拉大车,不然做不到收敛,麻烦的是自己。

9. 特定领域大模型训练

-

需要训练生成新的子词:

a. 完全替换以前的词表(从基础模型开始,整个模型全部重新训练);

b. 增量补充(只需要训练新的子词) -

不训练词表:

专业词汇通过模型本身学习(建议,成本低)

关键词: 大模型训练一次的成本极高,因此为了项目稳定性一开始追求成功率,不要胡搞,公司或者项目经不起自己的异想天开的。

总结

心得: 大模型时代,我们必须了解GPU底层的调度逻辑,因为工作需要越来越多的和 GPU 打交道了。

后会无期,未来可期!

浙公网安备 33010602011771号

浙公网安备 33010602011771号