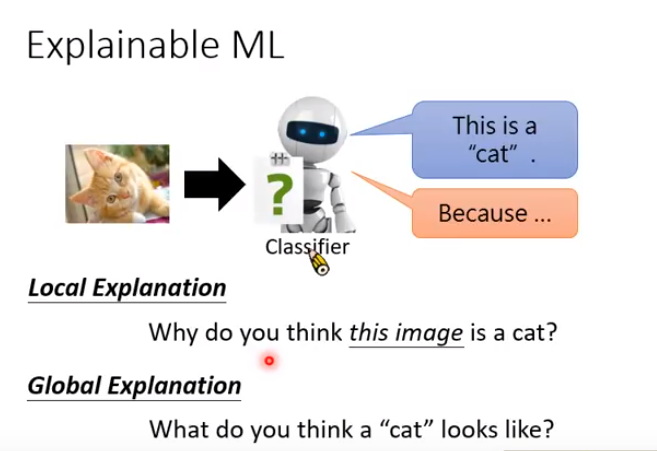

Explainable ML

定义: 不仅可以(分类),还要输出分类的理由是什么(局部),以及某一个分类的判断标准(全局)

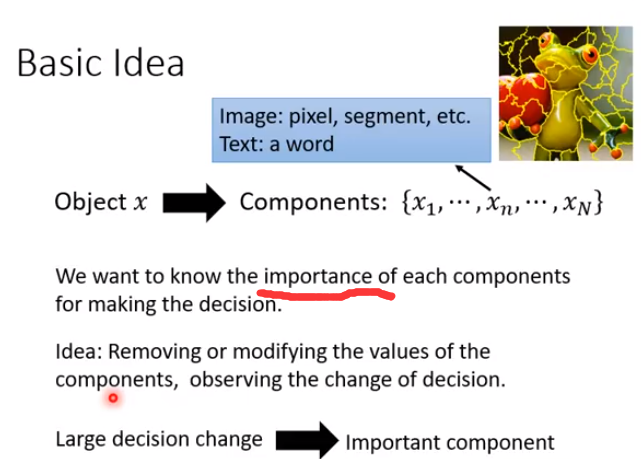

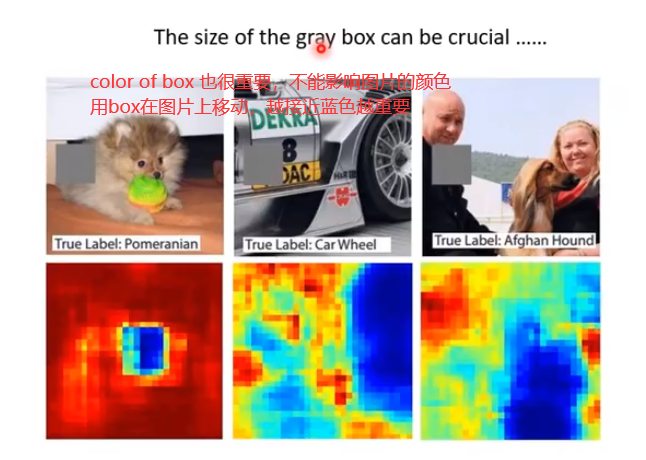

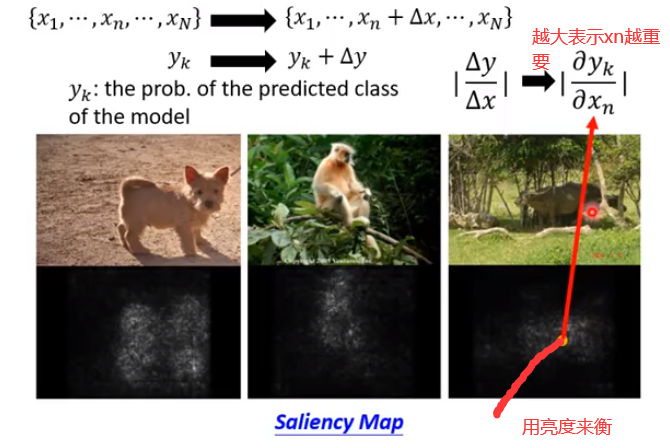

- 局部: silence map. 把{x1.....xn}中每一个像素加一个偏移量之后,得到的y偏移量与x偏移相除,类似于微分的结果,表示成一张图片。可以看到图片上对与判断结果来说重要的部分。

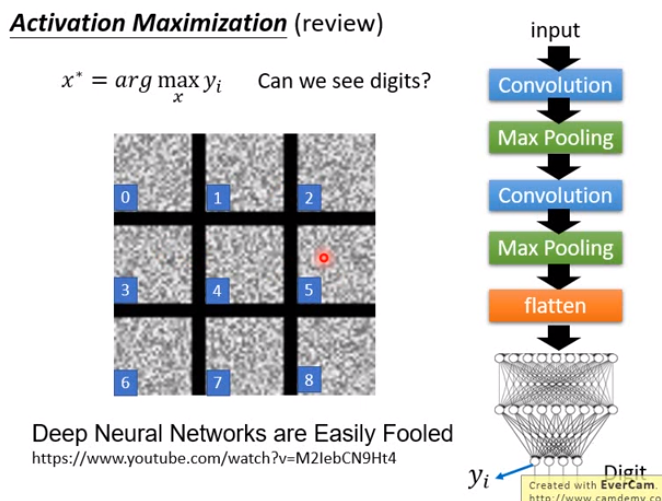

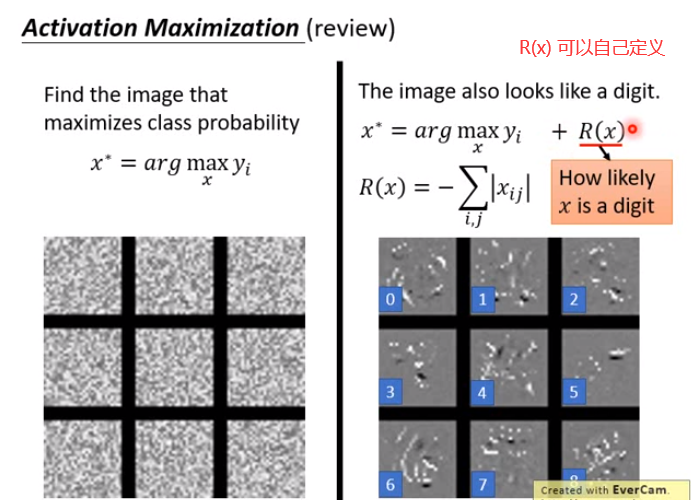

- 全局: 对某个分类,可以找出使它信心分数最高的x(要加一些regularization),可以画出机器“看到”的样子。

Local explainable

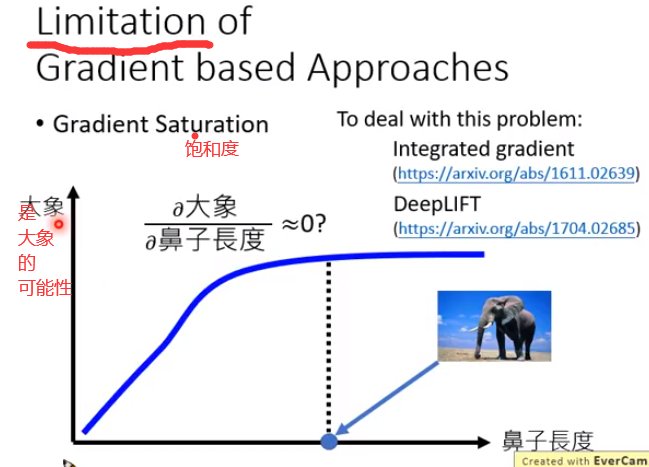

求梯度的方法具有一定的局限性:

global explanation

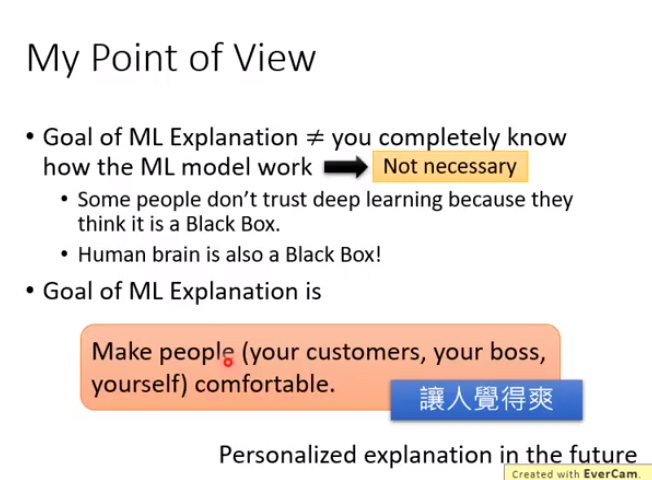

以上都是从人的想法的角度分析的

用GD找到使得yi最大的z,然后通过z得到x,那么我们就说x是机器觉得最像yi的东西

Generator 和Classifier都是事先训练好的(固定)

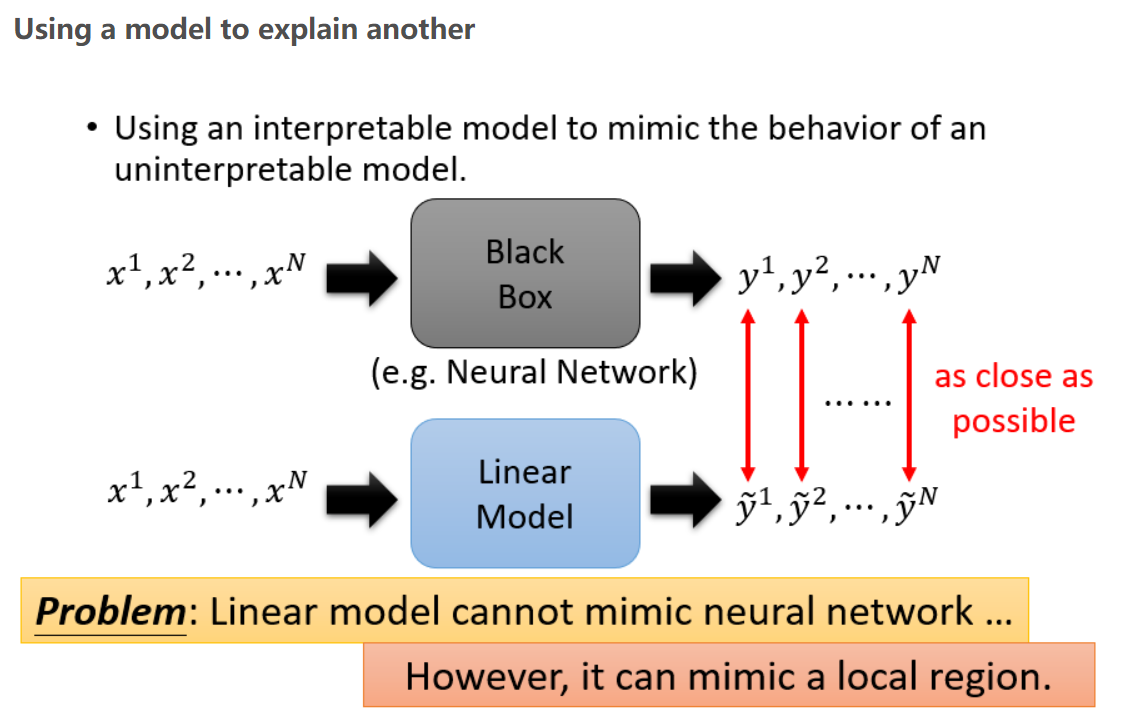

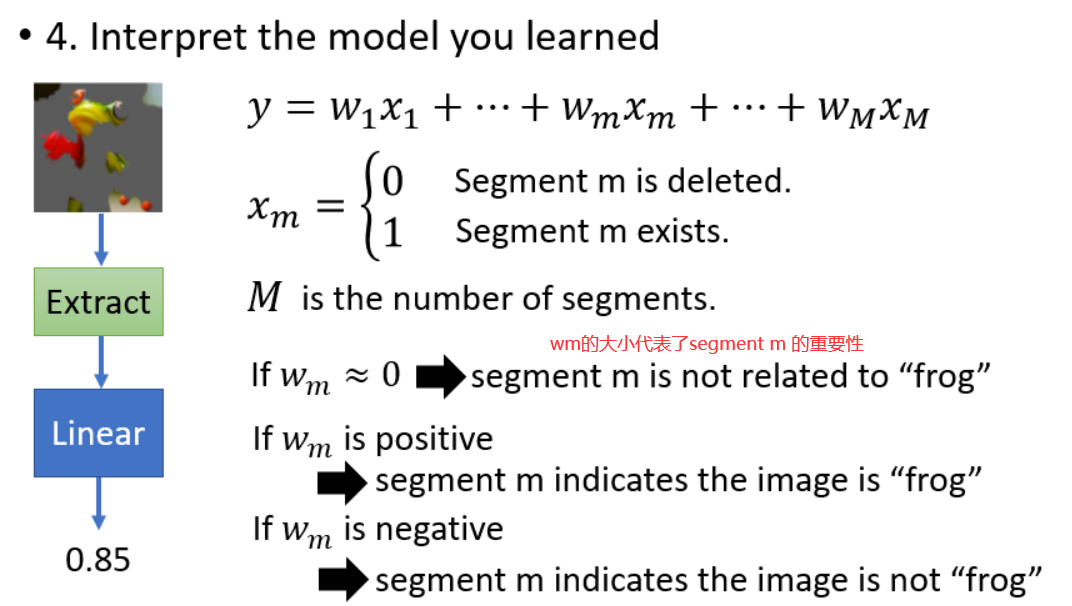

interpretable model 来模仿black box

分析这个interpretable model,假设这个interpretable model是一个linear model

因为他们的capacity不同,那么Linear model 不能mimic 这个black model 的全部

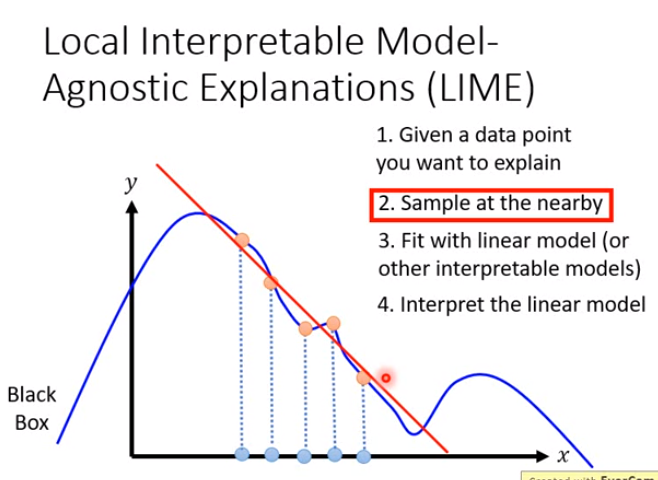

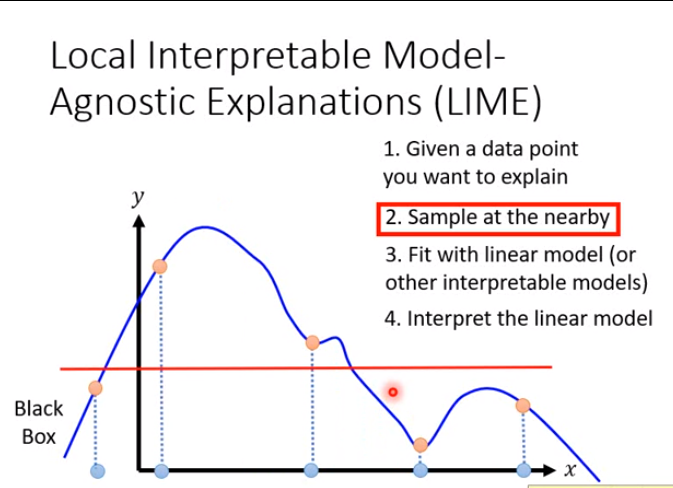

到底什么是nearby?

对于这条红线(nearby的限制很宽松),接下来还需要调节,直到你满意

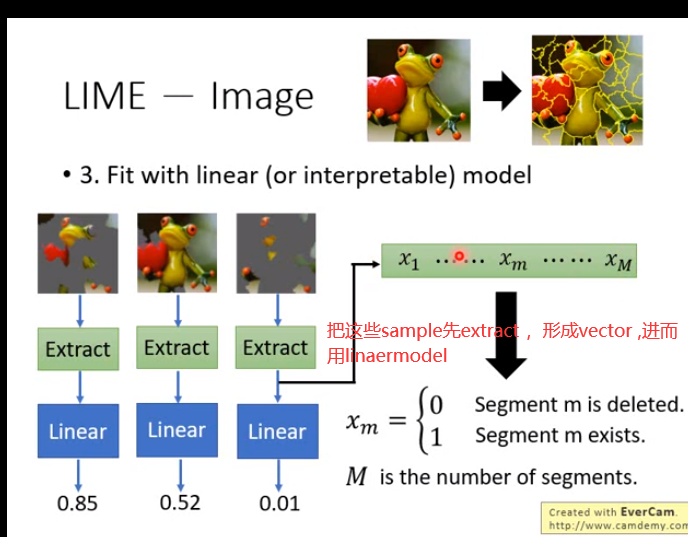

下面以frog为例解释LIME的过程

M 也是可以调节的

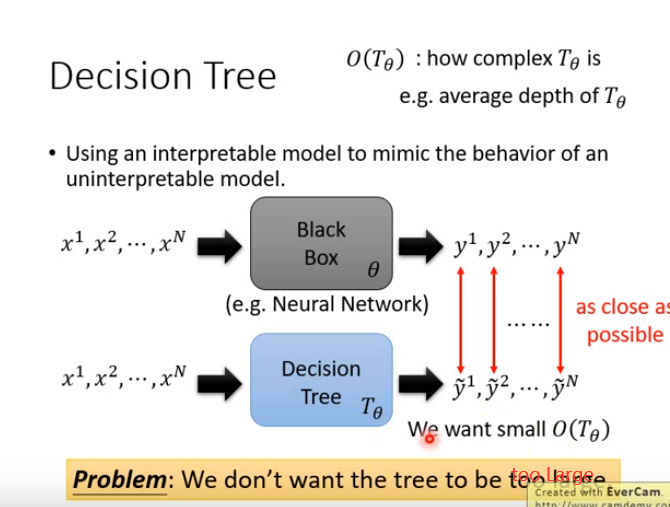

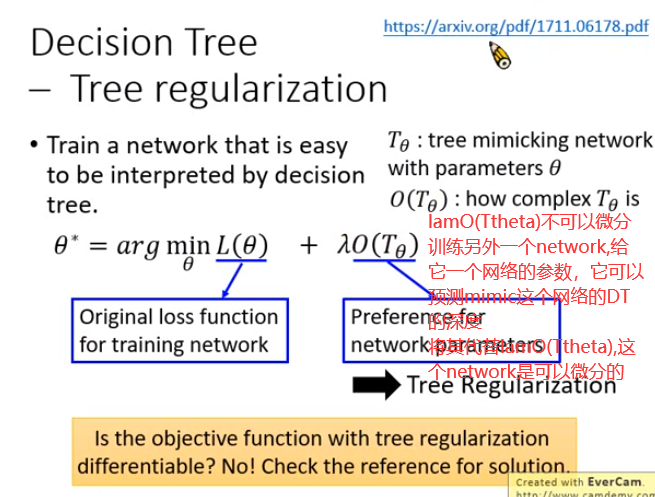

以上都是用linear model mimic ,下面用decision tree mimic

浙公网安备 33010602011771号

浙公网安备 33010602011771号