Windows 11 引入对 NPU(神经网络处理单元,Neural Processing Unit)的支持,主要是为了提升设备的人工智能(AI)处理能力,尤其是在智能化、边缘计算和机器学习推理方面。CPU、GPU 和 NPU 的区别对比表格:CPU、GPU 和 NPU 在不同应用场景中的优势各异,下面是它们在常见应用场景中的详细对比:

Windows 11 引入对 NPU(神经网络处理单元,Neural Processing Unit)的支持,主要是为了提升设备的人工智能(AI)处理能力,尤其是在智能化、边缘计算和机器学习推理方面。NPU 为现代计算机带来了许多新的功能和价值,尤其是对于需要强大计算能力的 AI 应用。

Windows 11 中 NPU 的功能和价值

-

增强 AI 加速与优化:

- AI 加速:NPU 通过硬件加速神经网络推理,能够大幅提升 AI 模型的执行效率。在 Windows 11 上,设备可以在本地实现更快的 AI 推理和任务处理,而无需依赖云端。

- 低延迟 AI 体验:由于 NPU 具备专门为 AI 推理设计的硬件架构,能在低延迟下完成复杂的计算,改善了实时应用的响应时间,比如语音助手、图像处理等任务。

-

智能图像和视频处理:

- 图像增强与处理:借助 NPU,Windows 11 可以对图像进行更加智能化的优化。例如,图像降噪、人脸识别和表情增强等都可以在本地设备上通过 AI 加速处理,提高用户体验。

- 实时视频特效:NPU 可用于处理实时视频流中的 AI 特效,如虚拟背景、图像模糊或虚拟角色的叠加等,提供更智能的视频会议和实时互动体验。

-

智能语音识别与语音助手:

- 语音识别和命令处理:通过集成 NPU,Windows 11 能够更高效地处理语音识别任务,比如 Cortana 或其他语音助手的快速响应与执行。NPU 加速了自然语言处理的速度和准确度。

- 语音转文本和语音合成:NPU 可以在本地设备上加速语音到文本的转化,提供更自然的语音交互体验,且无需持续依赖互联网连接。

-

增强的安全性与隐私保护:

- 面部识别和生物识别:Windows 11 使用 NPU 加速面部识别(如 Windows Hello)和其他生物识别技术的处理,提高身份验证的安全性和效率。

- 隐私保护:通过本地硬件加速的推理,敏感的数据处理(如面部、指纹信息)可以在本地进行,而不需要上传到云端,增强了隐私保护。

-

AI 边缘计算:

- 边缘设备支持:随着边缘计算的普及,Windows 11 能够支持在智能终端上直接处理 AI 任务(如无人机、智能摄像头等设备)。NPU 使得设备无需与云端频繁交互,减少了网络延迟和带宽消耗,提高了处理效率。

- 智能推荐和个性化体验:例如,通过用户行为数据分析,系统可以智能地优化任务管理、资源分配以及应用推荐等内容,提升系统响应和个性化程度。

-

优化电池性能和能效:

- 节能 AI 处理:NPU 的设计相较于 CPU 和 GPU 更加节能。它能高效地完成 AI 推理任务,并且能在较低功耗下运行,这对于笔记本电脑和移动设备至关重要,延长电池使用时间。

NPU 在 Windows 11 中的应用示例

-

AI 驱动的图像和视频编辑:在 Windows 11 中,用户可以利用 NPU 加速的 AI 技术来进行图像增强、背景去除、视频编辑等任务。例如,AI 驱动的图像增强可以自动提升照片质量,或者通过 AI 生成的视频特效来改善视频流的质量。

-

智能办公助手:在微软 365 中,NPU 可以帮助提升文字输入、语音识别、实时翻译等功能的速度和准确性。语音转文字、自动校对和建议功能将变得更加智能和高效。

-

实时翻译与跨语言沟通:NPU 加速的翻译功能可以在 Windows 11 中实现更高效的实时语音翻译,为多语言环境下的用户提供更流畅的沟通体验。

-

健康监测和预测:一些智能设备和应用可以利用 NPU 进行健康数据分析,如通过智能手表、健身追踪器等设备监测用户的健康状况,并通过 Windows 11 提供实时反馈。

Windows 11 中的 NPU 主要通过加速 AI 相关任务,为用户带来了更智能、更高效和更省电的计算体验。它在 图像和视频处理、语音识别、安全性、边缘计算等方面的应用,推动了 Windows 设备朝着更智能、更高效、更个性化的方向发展。

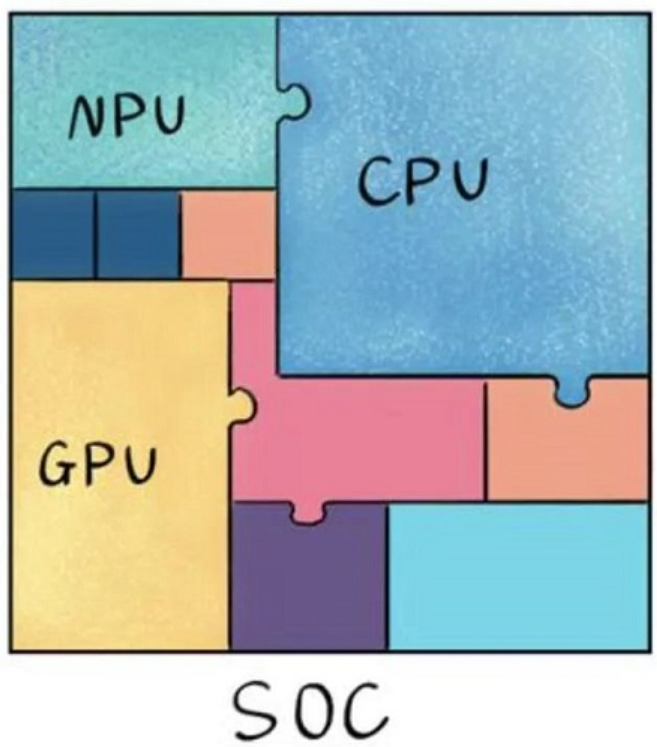

CPU、GPU 和 NPU 的区别对比表格:

| 特性 | CPU (中央处理器) | GPU (图形处理单元) | NPU (神经网络处理单元) |

|---|---|---|---|

| 用途 | 处理通用计算任务,适用于各种应用 | 专门用于图形渲染,图像处理,视频处理 | 专为人工智能和深度学习任务设计 |

| 核心数 | 少量高性能核心(通常 4~16 核) | 大量低性能核心(几百到几千个核心) | 多数核心针对特定神经网络任务优化 |

| 任务类型 | 通用计算任务,单线程性能强 | 并行处理图形、矩阵运算等大规模任务 | 深度学习任务,如矩阵乘法、卷积等 |

| 并行处理 | 支持有限并行,主要依赖单核性能 | 高度并行,擅长大规模并行计算任务 | 极高并行性,针对神经网络运算高度优化 |

| 架构 | 顺序执行,强大的控制能力 | SIMD(单指令多数据)架构,适合并行计算 | 结合了专门的矩阵计算、向量运算架构 |

| 性能优化 | 强调单线程性能,适合复杂控制和逻辑运算 | 强调浮点计算、图形处理和大规模并行计算 | 针对深度学习算法优化,特别是卷积和矩阵运算 |

| 应用领域 | 日常计算,操作系统,应用程序 | 游戏、视频编辑、图像处理,科学计算 | 人工智能推理与训练,机器学习模型优化 |

| 功耗 | 较低,适合长时间稳定运行 | 较高,尤其是在进行大量并行计算时 | 较高,特别是在AI计算时,且可针对性优化功耗 |

| 计算单元 | ALU(算术逻辑单元),用于复杂运算 | 多个流处理单元,用于并行处理 | 特定的神经网络加速单元,针对AI运算设计 |

| 代表产品 | Intel Core,AMD Ryzen,Apple M1 | NVIDIA GeForce,AMD Radeon,Tesla | Google TPU,华为Ascend,苹果Neural Engine |

- CPU:通用计算,适合处理多种任务,单线程性能强,但不适合大规模并行计算。

- GPU:并行计算能力强,适用于图形渲染和深度学习训练等大规模并行计算任务。

- NPU:专门为神经网络和深度学习任务设计,优化矩阵运算,适合AI推理和训练。

CPU、GPU 和 NPU 在不同应用场景中的优势各异,下面是它们在常见应用场景中的详细对比:

1. CPU(中央处理单元)应用场景:

- 日常计算任务:如操作系统管理、应用程序启动和运行、文件系统操作、浏览器等。

- 软件开发和多任务处理:用于开发工具、编译器、调试工具等的执行,能够高效处理各种控制密集型任务。

- 嵌入式系统:在一些嵌入式设备中,CPU 用于控制和执行少量并行任务,如家电、汽车控制系统等。

- 低延迟应用:处理高实时性要求的任务,如数据分析、实时控制等。

- 虚拟化:处理虚拟机环境中复杂的任务和资源调度。

2. GPU(图形处理单元)应用场景:

- 图形渲染:GPU 最初设计用于计算机图形学中的图形渲染,因此在游戏、3D 模型渲染、视频制作等领域得到广泛应用。

- 深度学习训练:GPU 提供的并行处理能力使其成为训练深度学习模型(尤其是卷积神经网络)时的核心硬件,用于加速大规模矩阵运算。

- 科学计算与模拟:GPU 在大规模科学计算、物理模拟、气候模拟等领域中应用广泛,尤其适用于处理需要大量并行运算的数据。

- 视频处理:GPU 在高清视频解码、视频编辑、实时视频流处理等任务中也具有很强的优势。

- 加密货币挖矿:GPU 在加密货币挖矿(尤其是比特币、以太坊等)中被广泛使用,因为其强大的并行计算能力。

3. NPU(神经网络处理单元)应用场景:

- 人工智能推理:NPU 是专为加速神经网络推理而设计的硬件,可以极大提高 AI 模型推理的速度,常见于智能手机、智能硬件、自动驾驶等设备中。例如,苹果的 A 系列芯片中的神经引擎。

- 边缘计算与智能终端:在智能家居、智能摄像头、无人机、智能监控等边缘设备中,NPU 能够在本地进行快速的 AI 推理,而无需依赖云端服务器。

- 语音识别和自然语言处理:在语音助手、翻译设备、智能音响等设备中,NPU 被用来加速语音识别、语音合成和自然语言处理任务。

- 自动驾驶:NPU 被广泛应用于自动驾驶汽车中,用于实时处理来自传感器(如摄像头、雷达、激光雷达)的数据,以支持决策和环境理解。

- 医疗影像分析:在医疗领域,NPU 可加速对医学影像数据的处理与分析,如 CT、MRI 图像的自动诊断、肿瘤检测等。

- 智能监控与图像识别:NPU 用于视频流中的物体识别、面部识别、行为分析等智能监控任务。

- CPU 适用于通用计算和单线程任务,特别适合操作系统、日常应用、虚拟化等场景。

- GPU 适用于图形渲染、大规模并行计算任务,尤其是深度学习训练、科学计算、视频处理和加密货币挖矿等。

- NPU 适用于人工智能和深度学习推理,特别是在边缘计算、智能终端、自动驾驶、语音识别等需要低功耗、高效推理的应用场景中。

浙公网安备 33010602011771号

浙公网安备 33010602011771号