【论文笔记】Equalization Loss for Long-Tailed Object Recognition

快速预览:

作者从一个新角度分析目标检测算法在大型长尾数据集上表现差的原因:一个类的正样本对于其他类而言可看作是负样本,尾部数据较少,所以尾部类收到更多不好的梯度。(In this work, we analyze this problem from a novel perspective: each positive sample of one category can be seen as a negative sample for other categories, making the tail categories receive more discouraging gradients.)

基于这个角度,作者提出均衡损失函数(Equalization Loss),对于尾部类通过简单的忽略头部类的梯度对其的影响来解决长尾部稀有类别的问题。再网络参数更新时,Equalization Loss保护稀有类的学习,改变劣势地位,模型可以学习到更好的判别特征。

详细解读:

问题:长尾问题

思路:

对于一个类别而言,包括背景在内的其他类别的所有样本都被视作负样本。所以尾部类(具有少量样本的类别)在训练过程中很容易被头部类(具有大量样本的类别)压倒并倾向于 被预测为负数。

之前解决长尾问题的大部分工作是将长尾类别分布问题的影响视为训练期间批量采样的不平衡,主要通过设计专门的采样策略来处理该问题。 其他工作引入了专门的损失公式来解决正负样本不平衡的问题。但是他们关注的是前景和背景样本之间的不平衡,不同前景类别之间的严重不平衡仍然是一个具有挑战性的问题。

作者在这篇文章主要关注不同前景类别的严重不平衡。

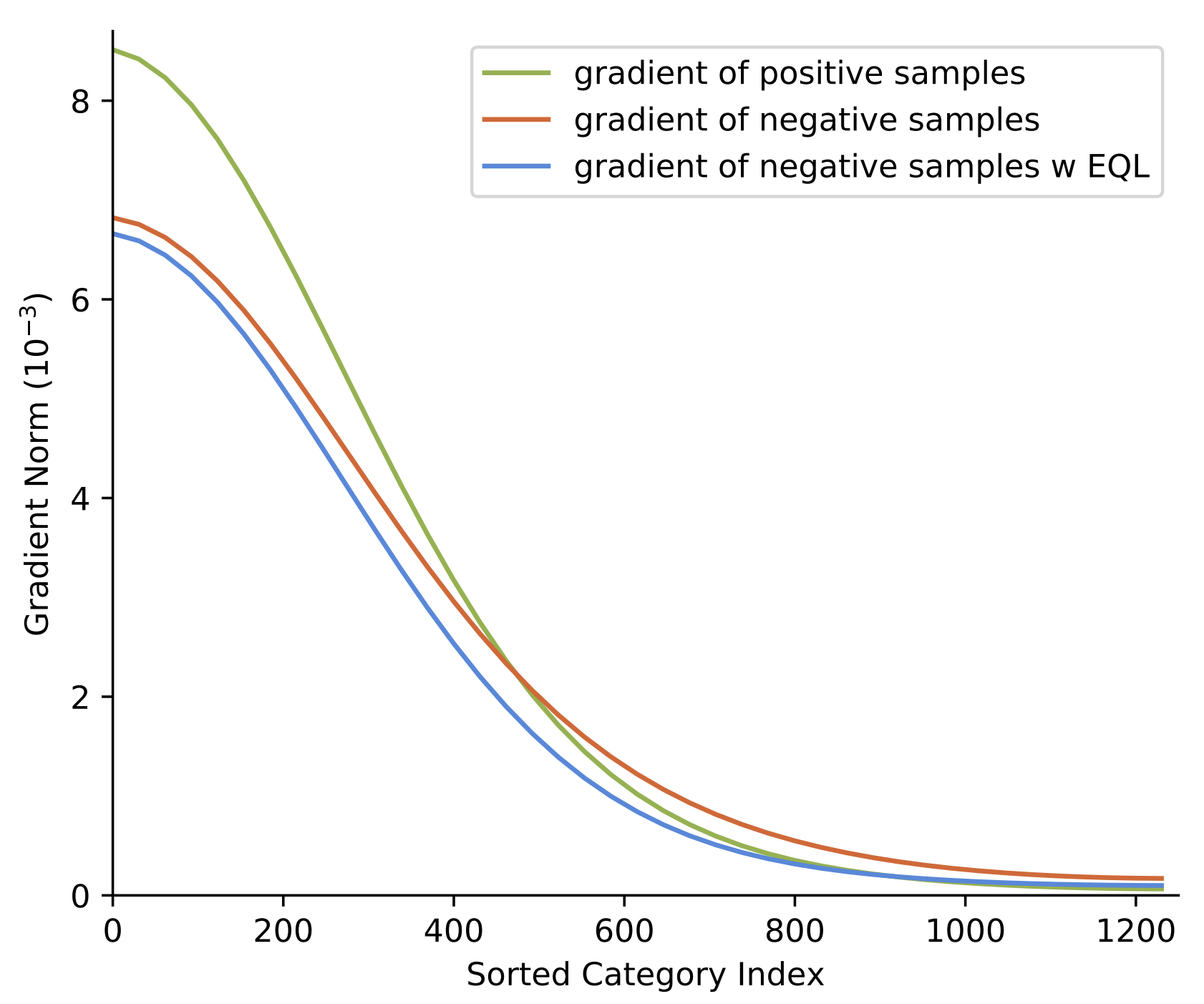

Figure 1

Figure 1

如Figure 1 所示,对于头部类,正样本梯度相比负样本梯度有更大影响,但对于尾部类,负样本梯度有更大影响。对于一个类别,所有其他类别的proposals和背景都是它的负样本 。分类任务中常用的损失函数,例如 softmax 交叉熵和 sigmoid 交叉熵对非真实类的类有抑制作用。 当某个类别的样本用于训练时,其他类别的预测参数将收到令人沮丧的梯度,导致它们预测一个低概率值。 由于尾部类别的样本对象很少出现,因此在网络参数更新期间,这些类别的预测变量会被令人沮丧的梯度所淹没。所以在Figure 1中,头部类数据多,其正样本也多,尾部数据少,训练时梯度对头部类别预测参数的负影响就小。

作者提出Eaualization Loss来解决上述问题,对于每个样本的每个类设置权重,减少负样本对尾部类的影响,以此达到均衡损失的目的。Figure 1中的均衡损失曲线,负样本的平均梯度范数降低。

核心方法:

Equalization Loss的中心目标是缓解长尾类分布中每个类别的类别数量分布不平衡问题。 我们首先重新审视传统的分类损失函数, 即 softmax 交叉熵和 sigmoid 交叉熵。

1.Softmax Cross-Entropy Loss

LSCE=−∑j=1Cyjlog(pj)

2.Sigmiod Cross-Entropy

对于 softmax cross-entropy 和 sigmiod cross-entropy,类别c的一个前景样本,会被看作其他类别j的一个负样本。所以在模型更新时类别j会接收负梯度Pj,导致网络预测低概率。如果j时尾部类,在优化迭代时负梯度会比正梯度更频繁。累积的梯度将对类别j产生不可忽视的影响。 最后,即使是类别 j 的正样本也可能从网络中获得低概率。

图 2 显示了 EQL 效果的简单可视化,使用EQL和没有使用使用EQL的每个类别的positive proposals的平均预测概率。 可以看出,EQL 在不损害头部类别的准确性的情况下,显着提高了尾部类别的性能。 使用所提出的 EQL,在网络参数更新过程中,不同频率的类别处于更加平等的状态,并且训练模型能够区分不同频率的对象 稀有类别更准确。

如果当前的r是背景,那么E(r)=0,wj=1,loss公式相当于 Sigmoid Cross-Entropy ,不做特殊处理。

如果当前的r是前景,那么E(r)=1:

如果r是非稀有类,那么=0,wj=1,不做处理。

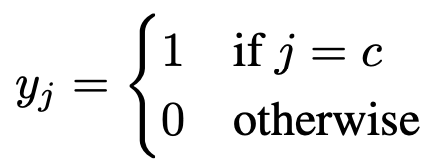

如果r是稀有类,那么=1,wj=yj,而我们知道,yj的取值是:

也就是,分类 Loss 不计算任何非 ground-truth 类别 () 中设定为稀有类别 (

) 的部分。

总之,这样就保证了背景不处理,前景类中,rare类只有它的正样本传播loss,head类(多的类)的正样本(对于rare来说是负样本)不对rare类计算loss,也就减小了对rare类的压制。

这样一来,对于rare类来说,EQL 既忽略了rare类的负样本,又没有忽略背景类的负梯度。

浙公网安备 33010602011771号

浙公网安备 33010602011771号