长短时记忆网络(Long Short-Term Memory, LSTM)学习

定义:长短时记忆网络(Long Short-Term Memory,LSTM)设计的目的是为解决一般递归神经网络中普遍存在的长期依赖问题,其由记忆元、遗忘门、更新门和输出门组成。

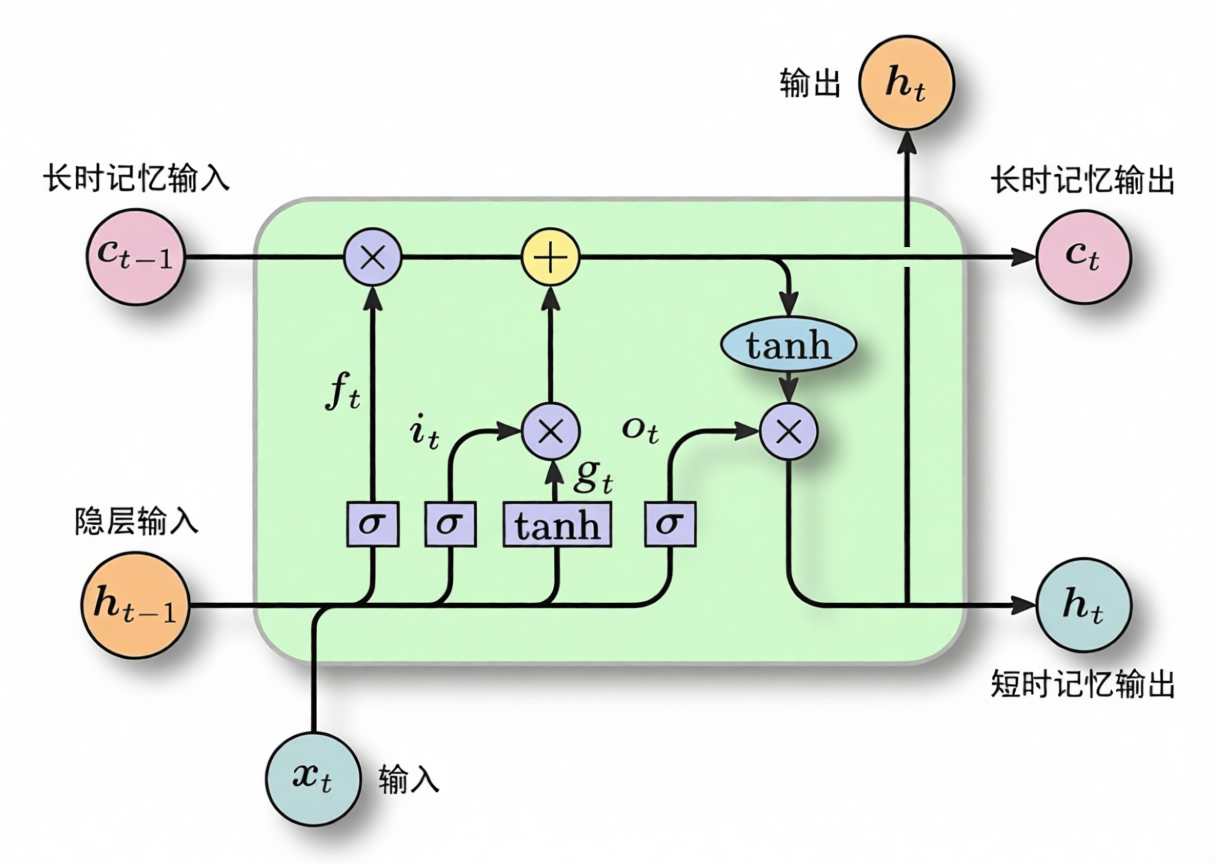

如下图所示:

注:遇到\(\sigma\)在运算的时候添加偏置项

一、记忆元

LSTM由多个记忆元串行构成,可理解为网络对输入数据的“记忆”,为更好的控制记忆元的信息,采用了上述的三种门

二、三种门

针对第\(t\)个记忆元的输入数据\(x_t\),隐层输入\(h_{t-1}\)可理解为上一记忆元的状态,长时记忆输入\(c_{t_1}\)可理解为通过上一记忆元后输入数据的记忆情况,输出\(h_t\)是衡量所记忆的数据的有效程度,其对记忆元的参数起一个监督的作用

1.遗忘门

\(f_t\)是控制记忆元去结合新输入的数据\(x_t\)遗忘掉无用的\(c_{t-1}\)信息

2.更新门

\(x_t\)中也有部分信息是无用的,因此通过\(i_t\)去过滤掉从\(x_t\)提取的新的信息\(g_t\)中的无用信息

至此,去掉\(c_{t-1}\)和\(x_t\)中的无用信息后,共同构成长时记忆输出\(c_t\)

3.输出门

通过\(o_t\)我们从\(c_t\)中选取当前时刻需要的信息用于表达这一记忆元的状态\(h_t\)

浙公网安备 33010602011771号

浙公网安备 33010602011771号