Deep Seek本地安装教程

一、下载Ollama。

搜索引擎搜索:Ollama,或点击进入官网:https://ollama.com/,点击【Download】。

根据电脑系统类型,选择对应安装包进行下载,下载完后是一个.exe文件,直接点击运行进行安装,强制安装在C盘,无法更改路径,C盘需预留足够存储空间。

Ollama是一个开源的大型语言模型服务工具,它帮助用户快速在本地运行大模型。通过简单的安装指令,用户可以执行一条命令就在本地运行开源大型语言模型, Ollama极大地简化了在Docker容器内部署和管理LLM的过程,使得用户能够快速地在本地运行大型语言模型。

二、下载大模型

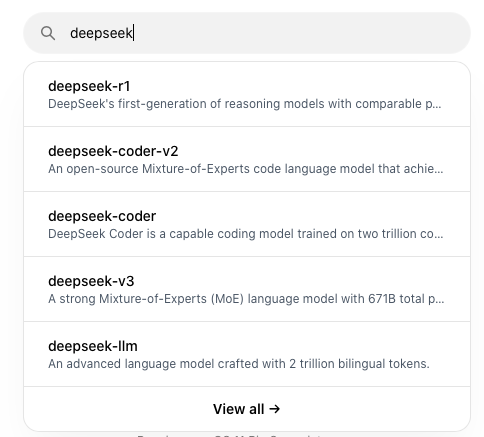

在Ollama官网顶部,搜索【deepseek】,可以选择不同的模型,每个模型有多个版本。

比如,码农可选择【deepseek-coder-v2】,最新的deepseek模型是【deepseek-v3】,下拉选择模型的参数数量,越大则参数数量越多。选项右侧显示模型的文件大小。b的全称是billion:表示十亿。选择【View all】,可以查看所有的模型版本。

三、安装大模型。

打开终端,输入使Ollama运行大模型:

#ollama run 大模型名称

比如:

ollama run deepseek-coder-v2

如果控制台界面不够方便,可以安装一个【Open WebUI】。

四、常用操作指令。

终端启动Ollama,执行以下指令,可对模型进行操作 :

# 启动ollama

ollama serve

# 从模型文件创建模型

ollama create

# 显示模型信息

ollama show

# 运行模型,会先自动下载模型

ollama run

# 从注册仓库中拉取模型

ollama pull

# 将模型推送到注册仓库

ollama push

# 列出已下载模型

ollama list

# 列出正在运行的模型

ollama ps

# 复制模型

ollama cp

# 删除模型

ollama rm

浙公网安备 33010602011771号

浙公网安备 33010602011771号