scrapy scrapd部署错误:浏览器ip无法访问远程scrapyd

本scrapy教程,主要解决这么一个问题:在服务器端安装好scrapyd服务并启动后,在浏览器输入:ip:6800,发现无法访问,如下图:

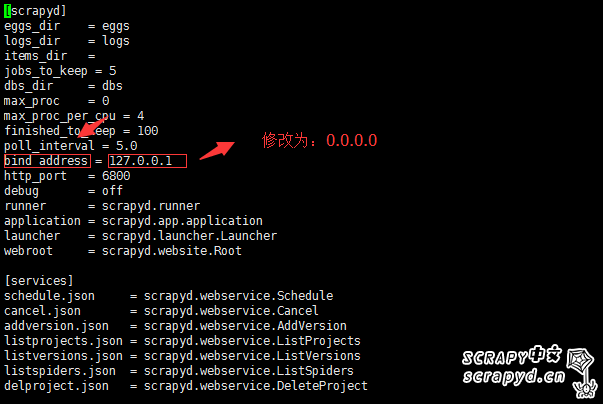

那应该怎么解决呢?我们需要修改scrapyd配置文件:default_scrapyd.conf 。首先找到scrapyd配置文件位置,一般是在如下路径:

/usr/lib/python2.7/site-packages/scrapyd/default_scrapyd.conf

如果找不到,使用linux搜索命令查找一下,如下:

![]() 修改之后需要再次重启scrapyd服务,先Ctrl+c退出,再次在linux命令行输入:

修改之后需要再次重启scrapyd服务,先Ctrl+c退出,再次在linux命令行输入:

![]() 快试试吧,有任何疑问,欢迎访问:scrapy中文网查看!

快试试吧,有任何疑问,欢迎访问:scrapy中文网查看!

find / -name "default_scrapyd.conf"找到之后,做如下图修改:

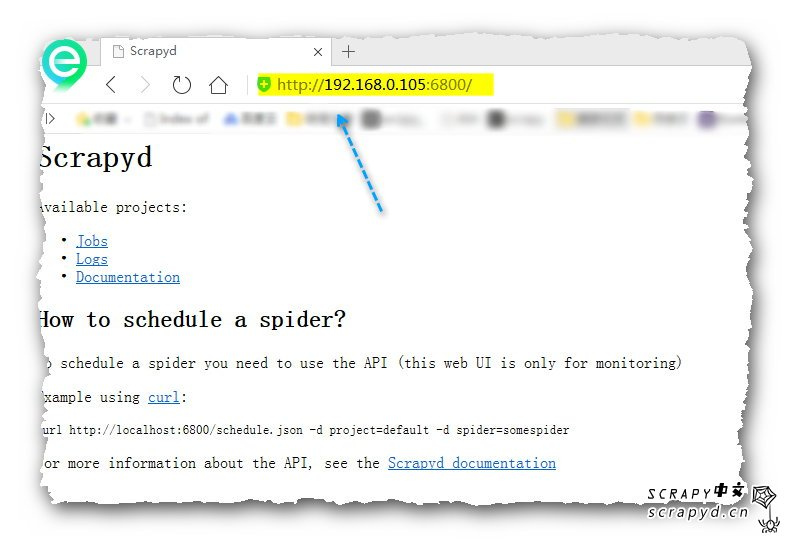

scrapyd启动。在浏览器输入:ip:6800,访问试试,如果还是不行,放行一下6800端口,命令:

firewall-cmd --zone=public --add-port=6800/tcp --permanent还是不行,应该是防火墙强了,直接把centos7防火墙关了,命令:

systemctl stop firewalld.service再次访问,发现可以愉快的访问了,如下图:

浙公网安备 33010602011771号

浙公网安备 33010602011771号