CNN 脑洞:卷积核不用于生成“特征”,而直接作为样本!

CNN 都学了很久了,学懂了吗?不自觉陷入沉思。

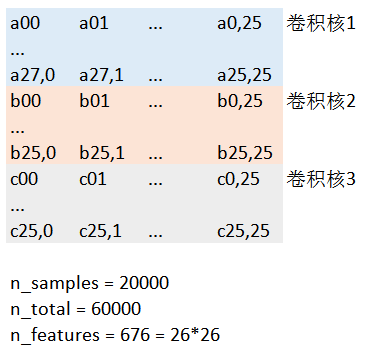

实验:对 MNIST 28*28 进行卷积核卷成 26*26,用 3 个卷积核 ,卷出 26*26*3,样本数量 20000 个。然后展平,用 BP 计算。展平的含义,26*26 = 676 个特征,样本量由原来的 20000 个变成 60000 个,将 3 个卷积核展平。

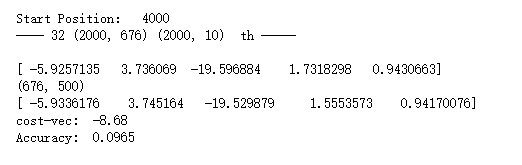

注意,之前 MNIST 用 28*28 = 784 直接展平的时候,迭代 50 轮,准确率可以达到 80%。现在看这种局部特征增加样本的方式。

这次实验显示,迭代到 32 轮时候准确率并没有提升。

因此,卷积神经网络,3 个卷积核生成 3 个新“特征”是不能在样本层面展开,即不能如上述拼接。正确做法是 tf.reduce_sum(axis=1) 变成一个特征!

商业赋能行业,ShoelessCai.com

浙公网安备 33010602011771号

浙公网安备 33010602011771号