[斯坦福大学2014机器学习教程笔记]第二章-代价函数(1)

本节通过看一些例子直观地来理解代价函数是用来做什么的以及为什么我们要使用它。

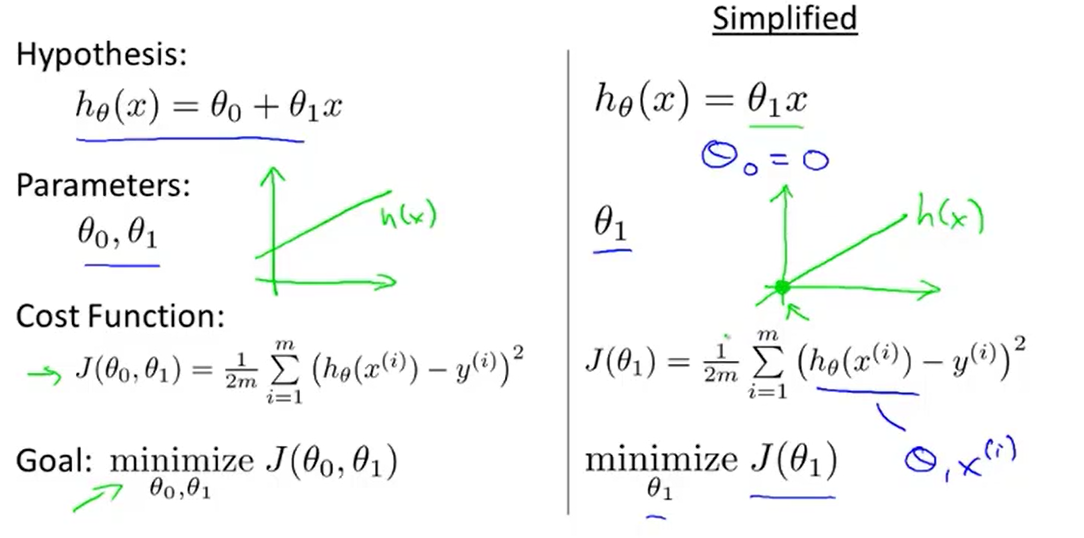

为了更好理解代价函数的概念,我们使用简化的代价函数。

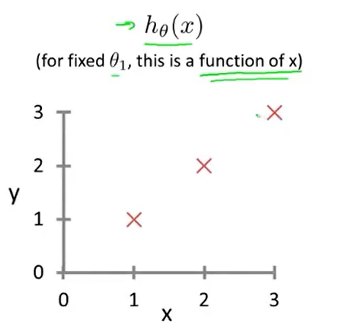

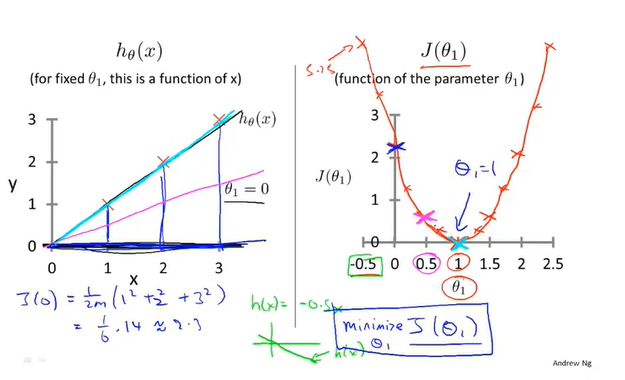

现在有一个训练集,训练集有三个样本。如下图所示。

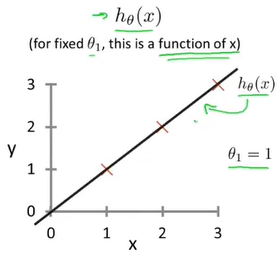

我们先来给θ1赋值。当θ1=1时,我们可以得到一条直线,如下图所示。

我们可以计算J(1)=(1/2m)Σ(hθ(xi)-yi)2=0。

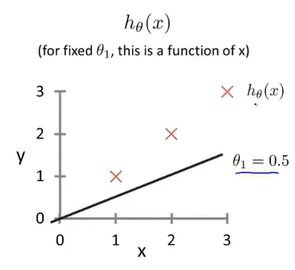

当θ1=0.5时,我们可以得到一条直线,如下图所示。

实际上,J(θ1)是下图所画直线平方和*(1/2m)。我们可以计算J(0.5)=(1/2m)Σ(hθ(xi)-yi)2=0.58。

通过这样不断计算,我们可以得到许多J(θ1)的值。如J(0)=2.3。然后我们就能画出函数图像(如下图右侧)。

我们知道右侧函数的每一个点都可以表示左侧的一条直线。而我们的目标就是找出J(θ1)取最小值时θ1的取值,显然我们可以看到θ1=1的时候J(θ1)最小。同时右侧的图像也告诉我们,当θ1=1时,我们已经完美地拟合了这个训练集。这就是为什么要最小化J(θ1)来找到一条最符合数据的直线。

这一节中,我们其实简化了函数。我们使θ0=0。但在下一节中,我们会回到原始的函数去观察它的图像。

去更远的地方 见更亮的光

浙公网安备 33010602011771号

浙公网安备 33010602011771号