关于AI大模型趋势下,0day攻击防御策略随想思考

我们都知道在当前模式下的防守是流量获取->策略处置,这是一个及其静态的过程,当然也不是说这个过程中没有动态过程,我认为当前的动态过程是人为分析;毕竟在安全设备获取流量后会根据其"指纹库匹配"来判断攻击行为;进行自动处置;

我们是不会对这个过程进行过多关注,我们会在流量获取后,平台根据指纹库分析后,我们进行处置;这是基于已知的情况;

而0day是不在指纹库中的,是不会让我们根据"平台已知"来处置的,我们只能通过"全流量日志";来进行对0day的处置,但是,毕竟人力有限;面对超大资产的情况下,我们不可能一直盯着全流量日志;而攻击方也不会在防守紧绷的时候使用0day,会在我们松懈的时候,比如吃饭,睡觉;

在这个问题下如何破局?

我们关注到这个问题的原因关键是,"安全设备"是根据已知进行处置的静态性,和人力有限的动态性;

那我们可不可以引入一个"安全设备的动态性"进行实时分析,进行流量抓取?

什么东西符合这个特征的?既要有实时动态分析+24h不间断休息呢?

其实标题已经很明显了,没错就是AI;在我的视角中,AI的本质其实就是,算力带来的高效率,强化学习带来的动态性;

这就很符合了;

场景设想;

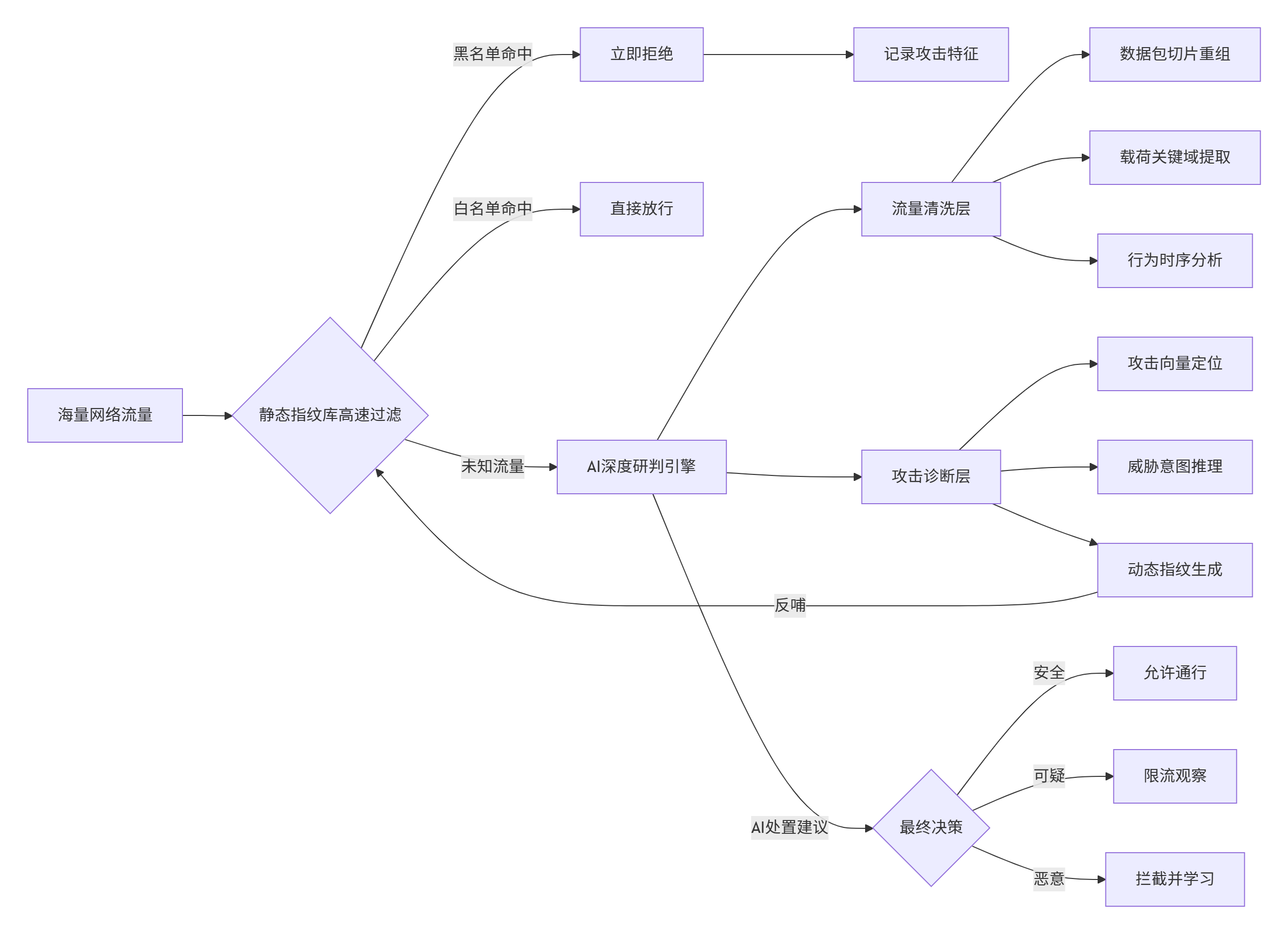

在获取到流量后,现根据静态指纹库匹配处置,会出现拒绝和允许的两个策略处置,允许的话再通过AI进行一次研判(这一步相当于人为分析的那一步),最后AI把分析结果给我们进行最后的处置;为什么要这样的,其实是由于攻击方式的原因,如果在流量/数据包超大情况下,不仅可以进行一次流量清洗,还可以让AI提取出问题关键,就好比在不引入AI的情况下,我们是考生,解题思路自己去思考;而引入AI后,我们就是考官了,AI已经进行一次解题了;

研判处置链路

流量->静态指纹库---->命中黑名单----->拒绝(相对的,命中白名单放行)

------>命中白名单放行

------->未命中----->AI分析------>人为确认攻击行为----->生成处置策略/动态指纹----->放入静态指纹库

这样的情况下就大大减少了人力问题;因为在这个链路中我们的角色其实就是,考官,AI把解题思路建议,让我们确认;

AI:这个方案可以不?

对的,对的

AI:好,我这就去部署执行这个方案

链路生成后,我们怎么去做呢?其实难点在于怎么去培养这个AI,让他可以有分析0day流量能力;目前这个模式,我认为其实是数据喂出来的;

在一定情况下是根据已知,怎么处理未知情况?这个问题?我们思考为什么我们可以面对一些"恶意流量"的情况,认为这是攻击;我们也不知道这个0day呀?但为什么我们可以认为这是攻击行为呢?

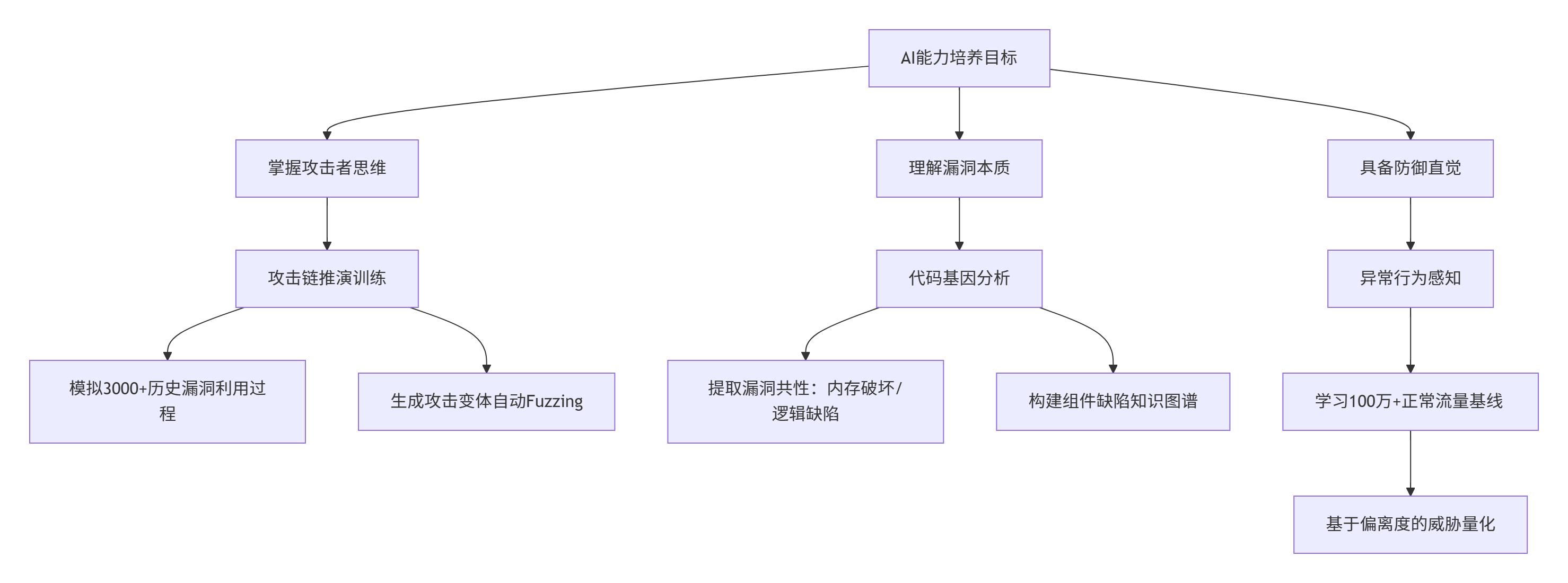

其实就是直觉与经验;在我的视角下;0day其实有两种形式,一个是在已知的day中的bypass版本,继承与前一个day路径;二是某个组件的"缺陷"导致的;由于笔者没有怎么系统学过ai;我认为有两个核心策略就是"攻防一体,知攻善防",既然要做这样的AI,那就少不了AI的知识库,既然少不了知识库,那我们是不是就可以先培养一个AI黑客,从攻击者的视角出发看防守,培养方式还是不断训练AI去打靶场(对抗训练和强化学习);怎么执行呢,我们看到在以往的ai案例中就有阿尔法狗这样的ai经过大量的自我对抗式的强化训练中,已经无人能挡了(虽然是基于算力碾压);

事实上这个策略在国内外已经在研究;

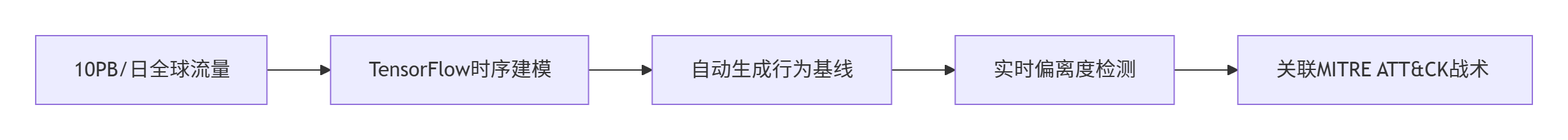

比如说 Google Chronicle:基于无监督学习的0day狩猎

但貌似好多文件没有开源且似乎还处于起步阶段

比如说https://link.springer.com/article/10.1007/s10462-023-10437-z

培养一个可以进行攻防一体的AI本身也是任重道远的,目前的网络安全趋势也是要融合AI;

上文说到,通过对抗式攻防训练来提升AI关于['未知']的嗅觉;事实上也是需要即时动态性生成本身也是在不断对抗训练中;

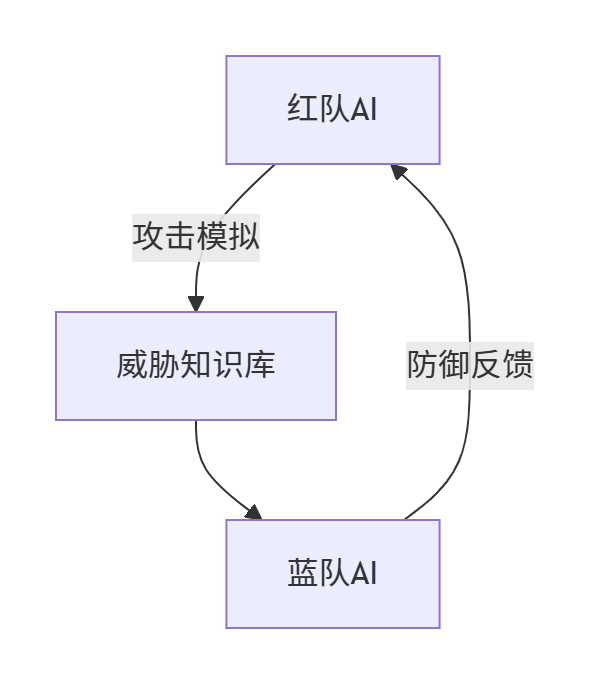

我认为有这样一个模型,关键是攻击直觉培养;就需要有攻击者视角;

攻防一体部署起来就可以通过这样的模式

即时反馈的攻击防御

攻击者思维培养就需要

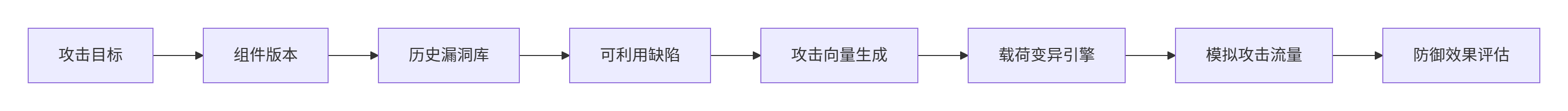

红队AI自动生成API攻击链

理解漏洞本质就需要:构建漏洞基因库(这东西我也不是很了解,但我认为这个是基于他的预测模型,将代码转换成可识别状态后,提取特征,预测缺陷,就比如说在测试过程中让AI找出代码中的bug)

实现防御直觉,构建 基于行为熵的异常感知;核心算法:多维度行为熵值模型

近年来,貌似网络安全的行业形式不是很好,网上也有很多人在唱衰安全,有一段时间,我也很迷茫;

在这个行业吃不上饭怎么办?

后来我明白了,这是我所热爱的行业,我不会因为他的日渐式微而改行改业;@

posted on

posted on

浙公网安备 33010602011771号

浙公网安备 33010602011771号