lvs详细配置

lvs(linux virtual server)

1、概述

1、lvs简介

lvs 是一种基于linux操作系统的负载均衡解决方案,就是将请求分发到多个后端服务器上面,lvs常用于网站,数据库等需要高并发访问的场景

2、lvs架构

-

ipvs :lvs的核心组件,负责实现负载均衡

-

调度器: lvs中的负载均衡器,接受来自客户端的请求,并根据调度算法将请求转发到真实的服务器上

-

真实的服务器(readl server): 实际处理客户端请求的服务器

-

虚拟vip : 提供给客户端访问的ip地址,实际有调度器管理的

3、lvs工作模式

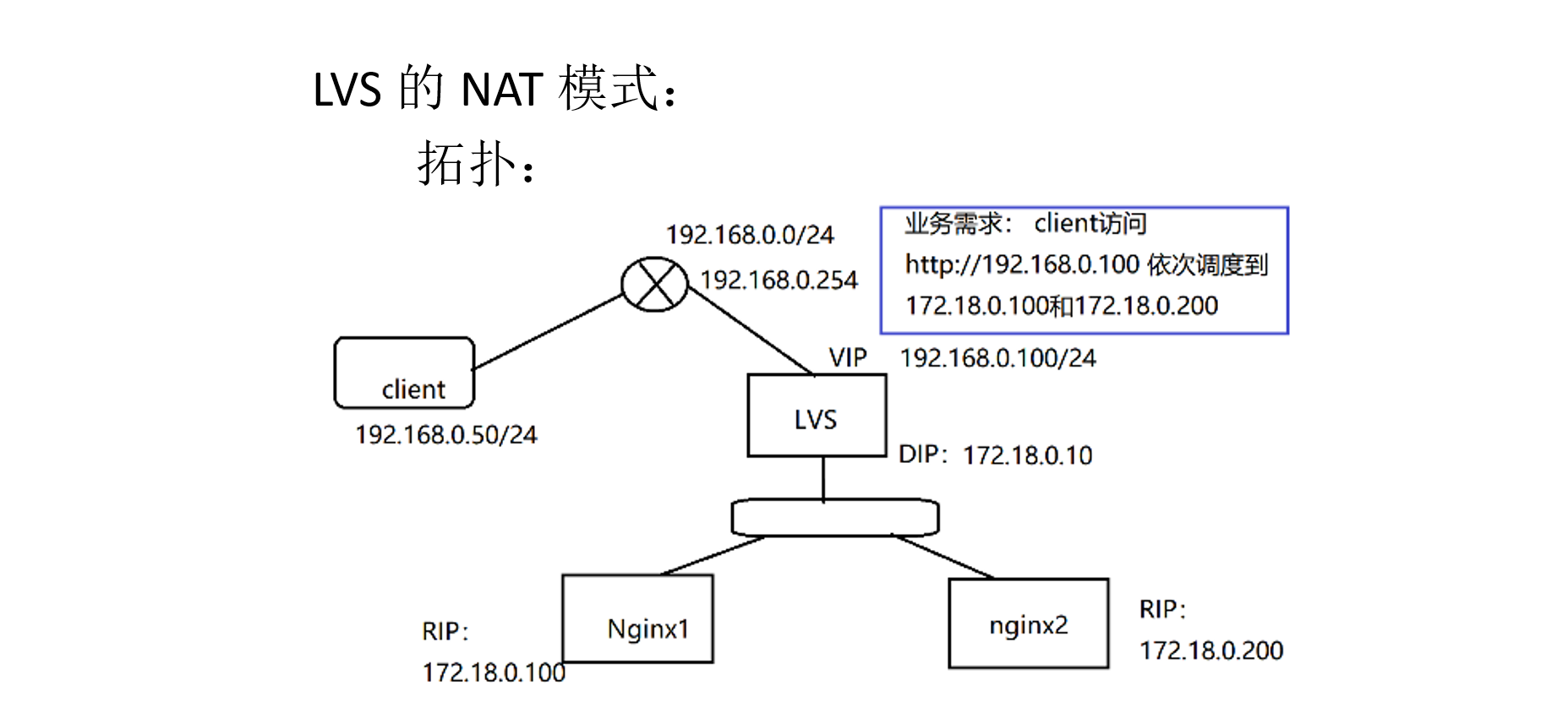

1、nat模式

-

工作原理:

- 在nat模式下面,负载均衡器接收到客户端的请求后,将请求转发给真实的服务器,真实服务器处理请求后,将响应的数据发送给负载均衡器,再有负载均衡器返回给客户端。负载均衡器充当了一个中间件的角色

-

优缺点:

-

优点;配置简单,可以隐藏真实的服务器的ip地址

-

缺点:流量都经过负载均衡器,负载均衡器的性能和宽带是瓶颈

-

-

配置的步骤

-

添加虚拟服务

-

添加真实服务器

-

设置真实服务器的网关,后端服务器网关都设置lvs节点的DIP

-

2、DR模式

2、lvs nat模式配置

1、nat模式配置案例

-

三台机器

-

lvs节点: 2个网卡,一个是192.168.50.0/24(与客户端进行通信的),一个是192.168.100.0/24(与后端服务器通信的)

-

后端服务器配置192.168.20.0/24

-

lvs节点,一个网卡与客户端(nat模式)进行通信,另一个网卡与后端服务器通信

1、安装lvs工具,开启内核转发功能

# 这个安装包非常的小

[root@server ~]# yum -y install ipvsadm

# 主配置文件,但是一般不修改

[root@server ~]# rpm -qc ipvsadm

/etc/sysconfig/ipvsadm-config

# 开启ipv4内核转发模块

# 查询是关闭的状态

[root@server ~]# sysctl -a | grep ipv4.ip_forward

net.ipv4.ip_forward = 0

# 永久生效

[root@server ~]# vim /etc/sysctl.conf

net.ipv4.ip_forward=1

# 立即生效

[root@server ~]# sysctl -p

- 安装之后,不需要启动服务

2、关闭所有节点的防火墙和selinux

# 所有节点上面执行

[root@server ~]# systemctl stop firewalld --now

[root@server ~]# getenforce

Disabled

3、配置lvs和ipvsadm参数讲解

# 创建一个虚拟服务,对外提供服务的地址为192.168.50.20 -s 指定工作模式是轮询

[root@server ~]# ipvsadm -A -t 192.168.50.20:80 -s rr

# 添加后端服务器(真实服务器)

[root@server ~]# ipvsadm -a -t 192.168.50.20:80 -r 192.168.100.11:80 -m

[root@server ~]# ipvsadm -a -t 192.168.50.20:80 -r 192.168.100.12:80 -m

# 查看

[root@server ~]# ipvsadm -ln

IP Virtual Server version 1.2.1 (size=4096)

Prot LocalAddress:Port Scheduler Flags

-> RemoteAddress:Port Forward Weight ActiveConn InActConn

TCP 192.168.50.20:80 rr

-> 192.168.100.11:80 Masq 1 0 0

-> 192.168.100.12:80 Masq 1 0 0

-

添加服务里面的参数解释

-

-A: 创建一个虚拟服务

-

-t: 指定协议的tcp地址,对外提供服务的地址+端口(vip),如果是udp的话,就是-u

-

-s: 指定工作模式为轮询,rr就是轮询

-

-

添加后端服务的里面的参数

-

-a:小写a,指定添加的一个服务器

-

-t:跟上面的一样,就是一个服务名

-

-r:后端服务器的地址+端口

-

-m:指定nat模式

-

-i:指定tun模式

-

-g:指定DR模式

-

4、配置后端服务器的nginx网页

echo "welcome nginx1 " > /usr/share/nginx/html/index.html

[root@node2 ~]# cat /usr/share/nginx/html/index.html

welcome nginx2

5、配置后端服务器的网关

-

因为客户端将请求转发到lvs后,lvs将请求转发到后端服务器后,后端服务器访问不到这个vip地址

-

客户端访问192.168.50.20 后端服务器192.168.100.11收到后,返回不了

[root@node2 ~]# nmcli connection modify ens36 ipv4.gateway 192.168.100.10

[root@node1 ~]# nmcli connection modify ens36 ipv4.gateway 192.168.100.10

# 就是回包的时候,走的网关就是192.168.100.10,到达lvs机器后,进行转发到192.168.50.0/24这个网段上面去了

[root@node1 ~]# route -n

Kernel IP routing table

Destination Gateway Genmask Flags Metric Ref Use Iface

0.0.0.0 192.168.100.10 0.0.0.0 UG 100 0 0 ens36

192.168.100.0 0.0.0.0 255.255.255.0 U 100 0 0 ens36

6、访问集群

[root@server /]# curl 192.168.50.20

welcome nginx1

[root@server /]# curl 192.168.50.20

welcome nginx2

# cmd中访问不到,因为后端服务器回包时,不能与windows通信

-

可以开启另外一个服务器充当客户端

-

配置192.168.50.0/24这个网段,网关指向192.168.50.20

-

就能与后端服务器进行通信了

浙公网安备 33010602011771号

浙公网安备 33010602011771号