通过hadoop上的hive完成WordCount

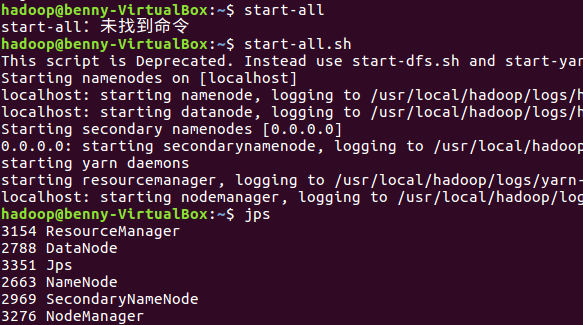

1.启动hadoop

打开所有命令:start-all.sh

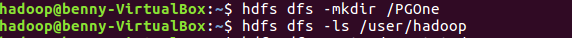

2.Hdfs上创建文件夹

创建名为PGOne到user/hadoop

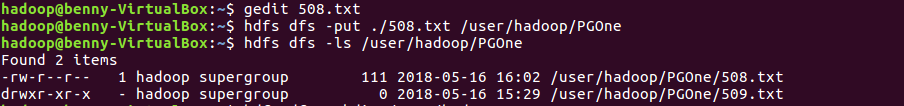

3.上传文件至hdfs

创建和修改508.txt文件,里面尽量多写一下,可写一些重复的内容,以便后面的查重。

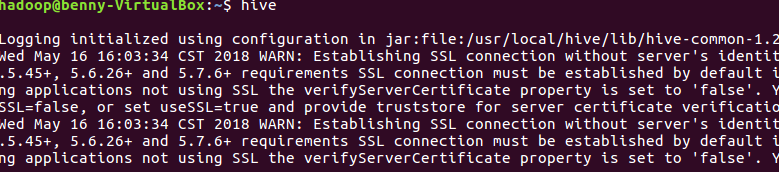

4.启动Hive

打开hiv,不解释

5.创建原始文档表

这里要注意一下,前面创建完之后,一定要先查看是否已经存入到相应的文件夹,同时,txt里面是否有数据,否则就会报错。

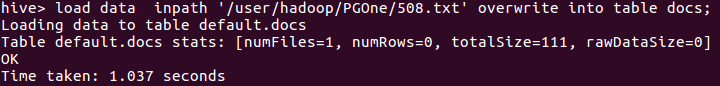

6.导入文件内容到表docs并查看

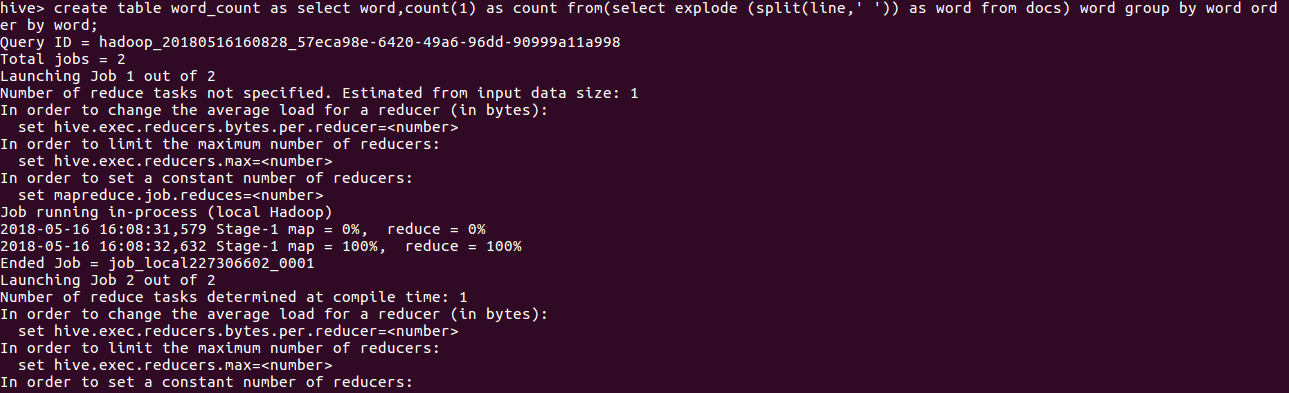

7.用HQL进行词频统计,结果放在表word_count里

这个注意不要打错,word和count(1)之间那个是","不是"."

8.查看统计结果

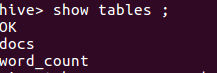

查看新创的table

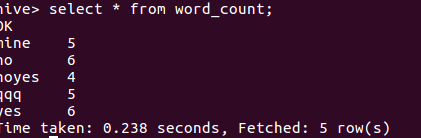

查看最后的结果

浙公网安备 33010602011771号

浙公网安备 33010602011771号