简介

本篇文章是一篇论文翻译,选择的是学习人机交互时比较感兴趣的一篇会议。因为文章内容过长难以逐字准确翻译,因此部分借助了机翻,然后做了点简单的处理,基本上可以还原论文的原意。

正文:

“非用眼目标获取”指的是依靠空间感和本体感觉与周围物理世界进行交互的人类基本能力和重要能力。在这个研究中,我们允许用户在不看虚拟对象的情况下获取虚拟对象从而利用这种能力来改善虚拟现实中的交互行为。我们期望这种自由视角的方法能有效地减少头部运动和焦点变化,从而加快互动,缓解疲劳和虚拟现实疾病。我们一共进行三项实验室研究,以进一步探讨非用眼目标的获取在虚拟现实中的可行性和可用性。结果表明,与使用眼睛的方式相比,非用眼的入路速度明显加快,而且准确率令人满意,明显减少了疲劳和疾病;大多数参与者(有13/16)更喜欢这种方法。除此之外,我们还测量了运动控制的精准度,并评估了用户在身体周围不同位置获取目标时的主观体验。在此基础上,我们还提出了设计合理目标布局的建议,并讨论了虚拟现实中费用眼目标获取的若干个设计层面的问题。

虚拟现实和增强现实在各种应用领域都具备巨大的潜力,如游戏、教育、医学训练等方面。在VR/AR中,人们能够像在现实世界中一样获取和操作虚拟对象。

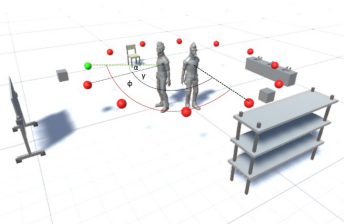

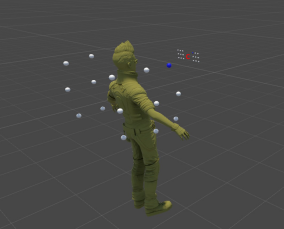

(图1-虚拟现实中通过非用眼获取目标的一个实例。用户正在进行工业设计,他以一种无需眼睛的方式在身体周围的交互空间中获取工具。头盔显示器中的视场是可视化的(110-120度))。

因此,在VR/AR应用中,目标获取是最基本的操作。改进这个基本操作的意义非常重大。目前,在VR/AR中用眼睛获取一个对象:用户在获取对象之前必须移动或旋转他的头部从而以视觉方式定位它。然而,在物质世界中,感知一个物体并不一定需要眼睛的参与。在很多情况下,通过对空间的记忆和本体的一些感应,人们可以通过不需要眼睛的方式伸手去拿物体(举个例子,驾驶员在驾驶时伸手去握把)。

在本研究中,我们希望利用使用者的非用眼输入能力,让使用者可以在不看物体的情况下获得物体,以改善虚拟现实/增强现实中的互动。图1说明了这种交互。如图所示,用户穿着虚拟现实头盔进行设计。他在虚拟空间里面对自己的工作。他可能需要给它上色,仔细观察,或者在设计过程中雕刻它。在这些时刻,他可以伸出手,在身体周围的不同位置获取不同的工具(如钢笔、放大镜),而不用回头看。这样,用户的视觉注意力总是集中在他正在编辑的对象上。这使得整个交互过程更加流畅、沉浸感强,同时减少了头部运动,可以缓解疲劳和虚拟现实疾病,对虚拟现实中的用户体验产生显著影响。

据我们所知,没有研究调查过用户在身体周围的交互环境中通过非用眼采集信息的能力。为了探索其可行性和可用性,我们进行了三次研究。在研究中,我们探索了非用眼目标获取的接受程度。用户(实验者)报告了在不同位置获取目标时的舒适度,以及能够轻松获取目标所需的目标间最小距离。在第二项研究中,我们测试了当使用者获得目标时,运动控制的准确性。我们测量了用户采集点与目标实际位置之间的距离。此外我们还测试了身体上的运动如何影响用户获取目标的准确性。在第三项研究中,我们比较了非用眼方法和使用眼方法在探索非用眼采集的优点和可行性方面的差异。在前两项研究的基础上,我们将18个目标定位在既舒适又准确的位置,并要求用户分别使用上述两种方法获取。结果表明,非用眼采集被广泛接受并且是首选(13/16),具有较高的采集速度、令人满意的准确率(92.59%)、较少的干扰、较少的疲劳和疾病。在三项研究之后,我们讨论了目标布局关于非用眼获取的设计意义和建议。

主要贡献可以总结如下:

•这是探索虚拟现实环境中非用眼目标获取的可行性和可用性的第一项工作。

•我们在身体周围不同位置测量了非用眼目标采集的准确性和主观接受度。

•通过与使用眼方式的比较,我们揭示了非用眼目标获取的优势,如速度更快、疲劳和虚拟现实导致的伤害更少、分心更少。

相关工作

首先回顾了以往在三维空间中获取目标和身体周围相互作用的一些研究成果。然后我们讨论空间记忆和本体感觉的一些事情。

三维空间目标捕获

在三维空间中获取目标主要有两种方法:虚拟瞄准和虚拟手(其实我也不知道怎么翻译这个词)。使用虚拟瞄准(也称为光线投射瞄准),用户能够通过手或控制器发射光线,来指向目标。虚拟指向适用于选择性远程目标。使用虚拟手,用户通过控制器或徒手触摸目标来获取目标。虚拟手通常用于与身体周围的物体交互。目前,大多数虚拟瞄准和虚拟手技术都要求用户在获取目标时对其进行仔细观察。尽管之前的工作已经研究了关于虚拟瞄准的非用眼型使用,但还没有研究过虚拟手的非用眼型使用。

身体周围的相互作用

研究人员提出了几种在身体周围空间进行互动的技术。身体周围的空间很容易接近,因此可以用来扩展输入词汇表(这个地方实在没搞懂什么意思)。

为了扩大显示空间,可触摸显示屏和窥视孔显示屏允许用户通过将移动设备移动到身体周围的不同位置来更改移动设备显示屏上的内容。为了缩短在移动设备上触发快捷方式的过程,VirtualShelve允许用户通过将移动设备定向到不同的方向来启动不同的应用程序。为了扩展交互空间,Chen等人员检测了用户和移动设备之间的空间关系,并启用三种类型的交互。

据我们所知,目前还没有研究在VR/AR中获取物体周围空间的视觉非用眼获取目标的益处。在VR/AR中,由于深度信息的不完全呈现和有限的视场,用户对物体的空间感知会受到影响。在本文中,我们测试了通过非用眼方式获取目标是否可以避免这些问题。

空间记忆与本体感知

人类有能力以非用眼的方式获取目标。这种能力主要建立在两个因素上:空间记忆和本体感知。

空间存储器是存储器的一部分,负责记录关于不同位置和对象之间的空间关系的信息。它可以帮助用户在采集任务中有效地检索目标的位置。先前的工作研究了用户在2D和3D空间中建立空间记忆的能力和有效性。这些研究的一个典型实验是这样进行的:首先要求用户放置目标并记住他们的位置;然后测试他们回忆这个位置的状况。基于回忆结果,他们可以设计目标布局,帮助用户轻松构建空间内存。这一过程通常需要很长时间(在之前的研究中为4个月),需要控制许多因素。本文主要研究用户建立空间记忆后获取位置的基本运动技能。

此外,本体感知的反馈对人体运动控制具有重要意义。本体感知是一个人身体各部分相对于彼此的位置和方向感。借助本体感觉,用户可以在各种平台上对目标进行非用眼模式的采集,例如在VR HMD的背面、在远程屏幕上,或者通过定向移动设备来选择不同的方向。此外,用户可以利用本体的感知来控制身体姿势,并以此作为输入的模型。这些研究大多研究了本体感觉的分辨力和本体感觉的反应时间对采集精度的影响。除了这两个维度外,用户对能否正确获取目标的确定感和获取姿势的舒适度也是很有研究价值的内容。因为这些主观感觉会影响用户是否想要采用这种方法。在本文中,我们举了三项研究,逐步测量了目标捕获的主观接受度、控制精度和捕获速度。

研究1:观察主观接受度

在测试非用眼目标捕获的控制精度和速度之前,我们决定观察用户对这种交互方式的主观接受程度。由于用户在不看目标的情况下获得了目标,他们可能无法确定是否获得了正确的目标。这种确定感可以通过扩大目标之间的距离来缓解。当目标位置的区域较稀疏时,用户应该更有信心获得其中一个目标。此外,如果我们将目标定位在难以到达的位置,例如在非常高的区域,使用者获取目标的手臂姿势可能会导致疲劳和不适。因此,重点在于测试用户感觉舒适的目标位置和需要确定的目标之间的最小距离。这些结果也有助于我们在接下来的研究中确定测试捕获性能的合适目标布局。

参与者

我们从当地校园招募了12名志愿者(其中4名女性)。他们的年龄在22到26岁之间(平均值为24.2,标准差为1.34)。所有参与者均以右手为主导手,没有身体伤害或不适。在本研究之前,8/12的志愿者有了虚拟现实的体验,8/12的参与者熟悉空中手势互动。我们测量了参与者的手臂长度(从肩膀到手掌)平均为67.95厘米(SD=3.22)。

仪器

我们在HTC-Vive设备上进行了实验,并在C#下用Unity 5.60发动机开发了软件。图2显示了实验和任务接口的设置。用户每只手上都握着一个控制器,可以根据方便程度选择所需的目标。HTC Vive使用灯塔定位系统跟踪头戴式显示器和两个控制器。据报道,跟踪精度小于1毫米。

设计

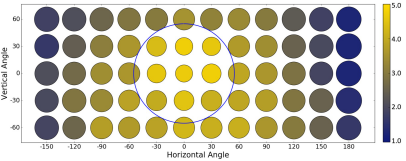

我们设计了两个独立的因素:目标的位置和使用者的姿势(站姿和坐姿)。我们测试了这两个因素如何影响用户在以非用眼方式获取目标时的主观接受度。主观接受度是从两个方面来衡量的:用户觉得可以与之交互的目标之间的最小距离,以及进行采集时手臂的舒适度。如图1所示,我们在用户身体周围的圆形球面上采样了60个位置。我们确定半径为65厘米,这样所有的位置都可以被用户获取。我们将-180度到180度的水平角范围平均分割为12个层次,将-60度到60度的垂直角范围平均分割为5个层次。我们在这些水平和垂直角度定位了60个位置。

图2-研究1中的实验和任务界面的设置。用户在5×5的网格中通过移动控制器来获取虚拟的球体。然后他转头去看他得到的球体是哪个(红色的)。

在60个位置中,有9个在视野范围内,这应该是以眼睛观察的方式获得的。另外51个位置被用来测试用户对非用眼采集的主观接受度。用户不允许回头看这51个位置的目标。为了确保这一点,会有一名实验人员在实验期间通过辅助屏幕观看HMD的画面效果。

对于这60个位置中的每一个,我们都要求用户确定目标之间的最小距离,使他们在获取目标时感到确定。为此,我们绘制了一个5×5的球体目标网格(半径=1.5cm),中心目标位于测试位置。目标的初始布局十分密集,目标之间的中心距为5厘米。我们要求用户自由获取中心目标眼,然后转过头查看是否被获取。根据结果和他们的主观感觉,他们决定是增加距离(一次增加一厘米)还是停止。我们记录了用户停车的距离,以满足确定性要求的最小距离。

任务

每位使用者完成2个流程(姿势)*60个试验(位置)=120个试验。每个用户的目标位置顺序是随机的。在每次试验中,用户通过上述过程确定目标之间的距离。每次试验后,他们用5分“利克特量表”评定手臂姿势的舒适度。

数据处理

采用RM-ANOVA方法,进而研究水平角、垂直角、坐姿和站姿对目标间最小距离的影响。我们用弗里德曼试验来测试他们对舒适度的影响。

结果

图3总结了不同水平和垂直角度级别的结果。圆圈的中心在我们测试的60个位置。半径是每个位置目标之间的最小距离,平均12个参与者和两个姿势的结果。颜色映射到每个位置的舒适度级别。总的来说,我们发现对于不同的位置,用户对非用眼眼采集的主观接受程度是不同的。

图3-这些圆圈演示了用户获得不同目标位置的舒适度和目标之间的最小距离。

位置效应

结果表明,目标高度对目标间最小距离(F4,44=5.173,p=0.002)和舒适度水平(X2(4)=18.02,p=0.001)有显著影响。事后结果显示,当目标垂直于60度(最高水平)时,目标之间的最小距离(平均值=10.87cm)明显大于0度和30度(平均值=9.97cm,10.08cm;p=0.001,0.008),平均距离也大于-30度和-60度(平均值=10.35cm,10.35厘米)。对于舒适度,当目标位于30度和60度时,评分(平均值=3.15,2.65)低于较低高度时的评分(平均值=3.26,3.32,3.30)。用户反映,当目标位置较高时,需要大幅度举起手臂才能获得,从而引起疲劳。同时,与较低高度相比,头部的控制更不稳定。因此,他们需要在目标之间保持更大的距离,以确保能够获得正确的目标。当测试者举起手臂时,抖动会限制测试者的准确性。

此外,我们发现目标位置的水平角显著影响目标与舒适度水平之间的最小距离(f1121=31.451,p<0.001;X2(15)=117.58,p<0.001)。具体来说,我们发现当角度从0度变化到两边(180度和-180度)时,距离变大,舒适度降低,如图4所示。用户报告说,当位置在后方时,他们需要将手臂旋转到不舒服的方向才能获得它们。这会导致疲劳甚至疼痛,从而降低舒适度。同时,由于手臂姿势不舒服,控制精度下降,因此后面的位置很难达到,而且姿势也很不舒服。”此外,用户还报告说,他们觉得很容易获得水平90度和-90度的位置,因为他们只需抬起手臂,不需要旋转就可以达到这些位置。

姿势、可视性和手侧面(???不会翻译)的影响

结果表明,在站立和坐姿的条件下,目标间的最小距离与舒适度水平无显著性差异(F1,11=1.710,p=0.218;X2(1)=0.37,p=0.544)。尽管总体结果显示差异不大,但参与者报告说,他们在站立状态下对手臂和手的控制更灵活,而在坐姿状态下更稳定。

在视野范围内有9个目标位置(图3中的蓝色圆圈),参与者在获取目标时可以看到它们。我们将这些位置的数据与视图外其他位置的数据进行了比较。测试结果显示,当目标位于视野之外时,用户需要目标之间的距离显著增大(t=9.44,p<0.001)。用户所需的距离越大,反映出他们在以非用眼方式获取视野之外的位置时所感受到的不确定性就越大。视野内各位置的平均距离为7.63cm(SD=2.88cm),仍大于起始距离(5cm)。用户报告说,即使他们能看到目标,他们也不愿意在密集的布局中执行非常仔细的控制。视内位置的舒适度显著高于视外位置(t=9.44,p<0.001)。视图中的位置都在前方的区域,用户在日常生活中经常进行交互。使用者习惯于手臂姿势来获得这些姿势,因此感觉他们会感到更舒适。

如图4所示,目标和舒适度在水平方向的最小距离在两侧对称分布。当用户在两侧用不同的手获取目标时,我们测试了不同的手是否会影响这两个指标的值。RM-ANOVA结果显示,不同的手在目标间的最小距离上没有显著差异(F1,11=1.73,p=0.19)。另一方面,弗里德曼的实验结果显示,右手获得的位置能够促使显著的舒适度水平(X2(1)=6.03,p=0.014)。这可能是因为所有的参与者都是右撇子,他们更习惯于用右手获取物体。

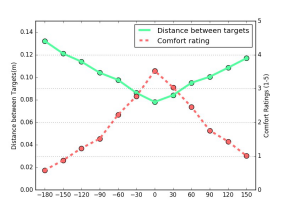

舒适性与准确性的关系

如图4所示,我们发现距离和评分之间存在着负相关的关系,这个结果由点双列检验支持(相关系数=-0.99,p<0.001)。我们还测试了所有60个姿势和两个方面的相关性。结果表明,两个指标之间存在显著的相关性(相关系数为-0.31,p<0.001)。这一结果与用户反馈一致,即对于引起志愿者疲劳或不适的位置,获取它们的手臂姿势也将很难控制。

图4-目标之间平均距离和目标位置不同角度与舒适度的关系图。

研究2:控制精度

本研究的目的是测试使用者以非用眼方式获取目标时,动作控制的准确性。为了达到这一目的,我们要求用户获取位于身体周围但位置不相同的目标。我们将采集点与目标的实际位置进行了比较分析。此外,用户在实际应用程序中进行交互时可能会转向不同的方向。例如,如果一个架构师在虚拟现实中工作在他周围不同的桌子中间,他可能需要改变他的身体方向来操作桌子上的物体。因此,我们研究了用户旋转身体对目标捕获精度的影响。根据研究1得到的准确度结果和主观接受度结果,对无眼目标采集的交互设计提出了建议。

参与者

我们从当地校园招募了24名参与者(4名女性),年龄从20岁到26岁(平均值=23.21,标准差=1.64)。其中6人参加了研究1,其中所有的参与者都用右手作为主导手。其中10人在实验前体验过虚拟现实应用。他们在实验前对VR病进行了评分(5分Likert量表),平均得分为2.2(SD=1.02)。

仪器

我们使用的仪器与研究1中的相同。在这个实验中,我们实现了一个虚拟办公室,里面有家具(如白板、架子),以帮助用户建立环境的空间感。其中目标被渲染为绿色球体,用户按下控制器上的触发器以获取目标。

设计

我们设计了两个独立的因素:一是目标相对于用户的位置,二是用户在获取目标之前执行的旋转次数。我们测试了这些因素如何影响用户在获取目标时的准确性。在研究1中,我们将目标定位在用户身体周围相同的60个不同位置(5个垂直角×12个水平角)。对于每个目标位置,用户必须通过将身体旋转成12个不同的方向(12个水平角)来获得12次相同的目标。在十二次采集中,当用户旋转身体时,目标的绝对位置不变,而采集的相对位置也随之变化。例如在图5所示,用户从左向右旋转,目标与用户的相对水平角从alpha变为phi。当用户按下控制器上的触发器进行确认时,已经进行了目标采集。

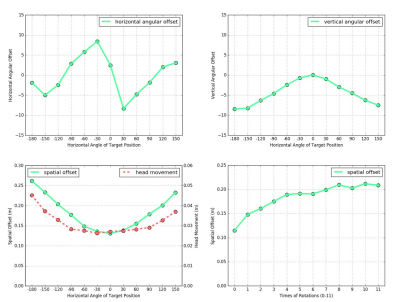

我们定义了两种测量目标捕获精度的指标:空间偏移和角度偏移。空间偏移被定义为捕获点和目标实际位置之间的欧氏距离。如果用户准确地获取目标,空间偏移应该很小。我们还计算了采集点的角度偏移,以分析采集点从目标实际位置向哪个方向偏移。我们将采集点和目标位置从笛卡尔坐标(x,y,z)转换为球面坐标(水平度,垂直度)。角度偏移定义为它们在水平轴和垂直轴上的差异(度)。此外,我们还记录了用户移动头部以获取目标的振幅。

图5-实验的基本概念。这些家具构成了参与者的虚拟环境。红色球体表示参与者能够旋转到的12个方向,绿色球体表示已定位到的目标。

任务和程序

实验前,用户有时间熟悉虚拟房间及其周围环境。这一步是让他们对环境产生空间感。他们环顾房间,用控制器触摸家具,了解位置。这个过程大约花了10分钟,直到用户报告说他们非常熟悉这个空间。

每个用户进行720次目标捕获试验(即60×12次)。在每次会话开始时,用户都会转向起始方向。然后我们用球坐标告诉他/她目标球的位置,例如“水平30度,垂直60度”。我们通知坐标,帮助用户更快地找到目标,否则,她需要视觉搜索目标。用户找到目标后,她能够观察到位置,并移动控制器触摸它。她需要做若干次这样的操作,直到她已经记住了目标的位置。用户被要求在接下来的12次采集中记住这个位置,据报道而言这很容易。在每次采集试验中,用户面对一个指定的方向,在不回头看的情况下获取目标。为了帮助校准他/她的方位,我们在那个方向绘制了一个立方体。采集完成后,我们告诉用户下一步要走哪个方向,例如“右转60度”。用户转向那个方向后,再次获得目标。因为用户在旋转过程中可能能够看到目标,这样会直接影响结果的准确性,因此我们将目标设置为初期时不可见。在完成12次试验后,目标被定位到一个新的位置,并开始了新的训练。每个参与者的目标位置顺序和旋转后的方向都是随机的。整个实验平均花了一个小时左右,每二十次就休息一次。

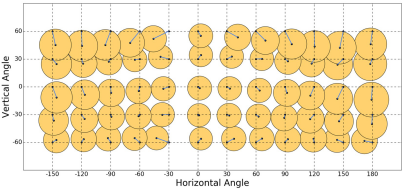

图6-总结实验结果。这些圆心是24个用户12次采集的平均位置,半径是标准差;蓝线表示的是平均位置相对于目标实际位置的偏移量。

数据处理

我们总共收集了24个(参与者)×720个(什么点)=17280个采集数据。在数据处理中,我们去除了1.12%的采集数据,因为它们的空间偏移和角度偏移都超出了允许三倍的偏差范围。我们运用RM-ANOVA分析了目标位置(水平和垂直角度)和用户在获取目标(0到11)之前进行的旋转次数对空间偏移、角度偏移和头部运动幅度的影响。

结果

图6显示了这个实验的主要结果。圆圈对不同目标位置的采集点进行了汇总,结果表明,不同目标位置的采集点(偏移量)的精度和采集点(标准差)的贴近度是不同的。

空间偏移

总的来说,我们发现在不使用眼睛的情况下,采集点与目标的实际位置有很大的空间偏移。不同目标位置的平均空间偏移为1.9cm~19.1cm,标准差为12.5cm~29.0cm。

RM-ANOVA结果显示,目标位置的张角显著影响采集的空间距离(f11253=95.48,p<0.001)。图7(c)中的绿线显示了目标位置12个水平角的平均偏移量的差异。如图所示,这些值从前面的0度增加到两边(-180度和180度),这大致反映了用户控制精度的降低。目标位置的水平角度决定了用户获取目标时手臂的水平外展或内收程度。而人类手臂的外展角度限制在40度左右。当目标位于该范围以外的位置时,用户需要同时旋转身体和手臂来获取目标,这可能会影响运动控制的准确性。正如用户所报告的,当目标在后面时,效果非常显著,“对于后面的目标(-180度,0度),我的肩膀阻碍我的手臂到达它,我无法精确移动控制器。”

图7-(a)表示不同水平角与水平角偏移量的关系图;(b)表示不同水平角与垂直角偏移量的关系图;(c)表示不同水平角采集的空间偏移量和头部运动幅度的关系图;(d)表示不同旋转时间后采集的空间偏移量的关系图。

垂直角度也显著影响采集的空间偏移(F4,92=22.76,p<0.001)。事后结果显示,0度和60度的空间偏移量无显著性差异(p=0.838),但0度、30度、-30度和-60度的空间偏移量差异显著(均p<0.05)。更高的位置要求使用者需要以更大的幅度举起手臂,由此产生的疲劳和抖动降低了他们的运动控制精度。这解释了为什么空间偏移会随着目标位置的升高而增加(0度除外)。在0度时,使用者水平举起手臂,产生最大的扭矩,也可能导致更重的疲劳,从而降低精确度。

旋转次数对空间偏移也有显著影响(F11253=70.46,p<0.001)。如图7(d)所示,采集的空间偏移量随着用户在采集之前执行的旋转次数而增加。用户的身体方向在每次旋转后都会发生变化,在再次获取目标之前需要对本体感知信息进行重新整合。结果表明,随着旋转次数的增加,它们的本体感觉能力下降。事后测试显示,12次采集中,第一次采集的空间偏移显著小于其他采集(均p<0.001)。这表明他们的能力在第一轮轮换后下降最显著。

RM-ANOVA结果显示目标位置的水平角显着影响采集的垂直角偏移(F11,253 = 178.428,p <0.001)。如图7(b)所示,垂直偏移随着水平角度从0度向两侧(180度和-180度)变化而对称地增加。当在前方水平0度获取目标时,用户创建了非常小的垂直偏移(其均值<1度)。当目标位于两侧时,它们到达的位置低于目标的实际位置,并且偏移值在背面为180度(大约8度)时达到最大。我们观察到,随着目标位置的水平角度(绝对值)增加,用户需要以更大的角度支撑肩膀才能获得它。这导致了只有在较小的垂直范围内,他们可以抬起手臂,因此能够到达的位置也较低。结果还显示目标位置的垂直角度也显著影响垂直偏移(F4,92 = 113.814,p <0.001)。除了-60度(平均值= 3.52度)外,用户为其他垂直角度创建了负的垂直偏移量(平均值= -8.45,-1.70,-6.74和-3.72)。

头部运动幅度

我们使用头部运动的各种数据来反映用户旋转身体的幅度。 RM-ANOVA结果表明,目标位置的水平角度对用户头部运动幅度具有显着影响(F11,253 = 47.012,p <0.001)。如图7(c)所示,类似于空间偏移,移动幅度随着目标位置从正面的0度更改为两侧而增加。用户的反馈与结果一致:当目标在前部(水平-90至90度)时,他们不需要旋转身体,但是当目标移至后部区域时,它们会以更大的幅度旋转。

讨论

根据实验一和二的结果,我们对未来在此空间中进行非用眼目标获取的UI设计的建议如下:

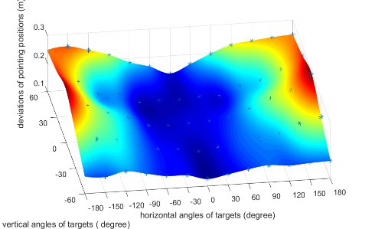

选择UI组件的位置时,需要考虑几个方面:舒适感和用户的可确定性,控制准确性和稳定性以及用户获取位置时的体力消耗量。总体而言,我们发现水平范围超过150度和-150度(后部区域)时的性能较差,因此不太适合定位目标。对于垂直角度,低于-60度或以下的区域被认为较合适,并且具有令人满意的控制精度,可用于布置目标。

对于采集判断,我们建议使用“区域光标” 或“气泡光标” 之类的技术来提高准确性,因为测试了采集位置相对于目标实际位置的平均空间偏移为18.6厘米。设计人员可以通过参考数据结果来确定气泡的大小或区域参数。我们还发现,当目标位于不同位置时,用户获取点的平均位置偏移1.9到19.1 cm。我们建议使用偏移量加上的位置来判断用户打算获取哪些对象。在我们的实验中,尽管我们不要求参与者区分不同的目标位置,但模拟区分60个位置的准确性为74.99%。如果将偏移量添加到目标位置,则精度提高到78.17%。

在这项研究中,我们测试了在球面上均匀采样的60个位置上目标捕获的准确性。基于这些结果,我们还可以在获取该曲面其他位置的目标时内插用户的精度性能(偏移和偏差)。由于标准偏差反映了采集点的接近程度,因此我们可以统计并预测不同目标布局中目标采集的准确率。图8显示了标准偏差的内插结果,设计人员可以参考这些目标位置来布置目标位置,以实现非用眼目标的获取。

图8-将目标采集点在整个曲面上的标准差的插值(真没看懂这句话),可视化成一张热图。

研究3:比较用眼式和非用眼式目标的获取

在这项研究中,我们旨在检测非用眼目标获取的性能,并将其与用眼式的方法进行比较。我们设立了一个在VR中获取18个目标点的任务,研究了非用眼获取在获取性能(速度,准确性),用户体验(疲劳,疾病,注意力分散)方面的优缺点,比较了两种方法在不同视场大小的不同条件下的性能,以及用户是否需要同时执行另一项第二任务,而这又需要他们在视觉上专注。我们还希望获得用户对这两种方法的主观反馈和偏向。

假设

我们打算在这项研究中检验以下三个假设:

假设1:非用眼状况能够促成更快的采集速度,并且可以让更少的注意力分散到正在进行的任务上,因为它需要更少的头部运动和焦点改变。

假设2:在我们通过使用“区域游标”机制优化了获取判断并统计预测了偏移量之后,非用眼条件应该具有令人满意的获取精度,这是研究2提出的。

假设3:基于假设1和假设2,用户应首选非用眼方法而不是双眼方法,尤其是当视场较小或有其他正在进行的任务时。

参加者

在当地校园招募了16名参与者(4名女性)参加了这项研究。他们的年龄在20到26岁之间(平均= 23.0,SD = 1.45)。所有参与者都将其右手用作优势手。在进行这项研究之前,其中有12个人曾体验过VR设备。其中三名参与者报告说,他们在观看3D电影和VR视频时感到不适。

仪器

我们使用与研究1和研究2相同的仪器。我们把一个空房间当作整体环境,如图9所示,在用户身体的每一侧各有一个被渲染为两个3×3的球体网格的目标,用户可以移动控制器并按下触发器以获取目标。在前面,我们呈现了一个目标布局的快捷方式,以显示应该获取哪些目标。当用户执行第二个任务时,我们还呈现了他们应该识别的字符。每次采集后,都会播放一个声音,告知用户是否获得了正确的目标。

设计

我们采用了主题内设计。独立因素为(非用眼/使用眼)、视野(30/110度)和第二任务(已完成/未完成)。

在试验中,非用眼的角色被要求面向前方,在不转头的情况下获得两侧的目标;使用眼的角色被要求寻找目标,并在看到目标时获得目标。对于视场大小,我们使用了110度和30度两种典型的VR(Vive)和AR(HoloLens)设备。为了保持实验条件的一致性,我们在Vive上渲染了30度的FOV大小,使30度以外的内容变暗。

为了测量目标获取行为对用户正在进行的任务造成的干扰,我们设计了第二个任务,要求他们同时执行。这项任务要求用户观察前面出现的字符(“a”、“b”、“c”),并在字符变成“a”时向实验者报告。我们计算了他们漏说“a”的次数,以此作为衡量目标导致分心的标准。我们还计算了误报率,以避免用户在没有识别的情况下说“a”,这在实验中几乎不怎么出现(所有用户<20次)。我们参考了先前研究的第二个任务的设计。

图9-实验环境的概念。目标位于使用者的身体两侧。

我们将18个球体目标定位在使用者能够舒适且准确获取的位置,并在研究1和研究2中进行了测试。如图9所示,球体在使用者两侧被排列成两个三乘三的网格,与使用者胸部的距离相等(65厘米)。两个中心球体位于坐标(-90度,0度)和(90度,0度)。相邻目标间距离相等(31.5cm)。我们不要求用户记住所有球体的位置。然而,正如之前的研究所测试的那样,用户可以在短期训练后记住14到20个目标的三维位置[4,29,39]。所以我们认为在这项研究中测试18个目标是合适的。我们通过前面目标布局的快捷方式通知要获取哪个球体及其位置,如图9所示。用户明确他们可以在它的帮助下很容易地发觉目标球的位置。

我们通过每个目标出现的时间(上次采集后2秒)到用户按下触发器获取目标的时间来测量每次采集目标的速度。我们测量的精度是所获得目标球体的速率。为了判断用户获取的是哪个球体,我们计算了球体的位置与用户定位控制器并按下触发器的实际位置之间的最近距离。对于非用眼条件,我们通过添加在研究2中测量的空间偏移量来计算球体位置。

任务

每个用户执行8次会话(???)。八种不同条件的顺序是平衡的。每个会话的前两个测试是热身,帮助用户熟悉球体布局和条件。每节课大约花了10分钟完成,之后我们在问卷中收集用户关于任务负荷和疾病评分的主观反馈。此外,在整个实验之后,我们还采访了用户,询问他们对两种获取方法的评价以及他们的偏好。实验大约花了90分钟完成,每两次之间都会组织一次休息。

图10-不同条件下采集的速度和精度的关系图。误差线表示标准偏差。

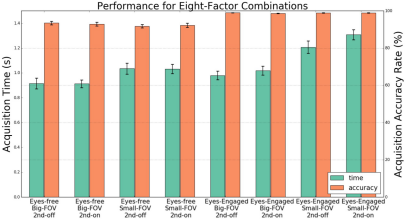

结果

我们最终收集了16名参与者×8个疗程×6个试验×18项收购=13824项收购目标。我们采用全因素RM-ANOVA检验对用户绩效的影响,并采用Wilcoxon检验比较两种方法的评分。

速度

结果支持假设1:非用眼采集(平均值=0.974s)明显快于使用眼采集(平均值=1.132s;F1,15=28.335,p<0.001)。当视场的范围较小时,采集速度显著降低(F1,15=35.815,p<0.001)。非用眼方法具有速度优势,因为它不需要用户转头去搜索视图中的目标,这是耗时的。当FOV较小时,使用眼睛接触的方法进行头部旋转和搜索花费更多的时间,因为用户需要旋转振幅较大的头部,并且在较小的FOV中感知到较差的空间感。由于非用眼几乎不受这个影响,因此两种方式的速度差被放大。此外,研究结果显示,是否有第二个任务的获得速度没有显著差异(F1,15=1.819,p=0.197;平均值=1.035s,1.071s)。

准确度

结果支持假设2,非用眼具有令人满意的捕获精度(18个目标的平均值为92.59%)。然而,与使用眼的方法(平均值为98.87%)相比,使用者仍然会犯更多的错误(F1,15=64.475,p<0.001)。在没有视觉反馈的情况下,用户的控制精度明显下降。然而,依靠本体感觉,用户仍然可以获得足够数量(18)的目标,用于身体周围空间的大多数交互任务。我们还评估了“将研究2中获得的结果添加到采集目标的判断中”的益处。通过模拟球体的原始位置来判断用户获得的球体是否正确,结果表明此时的准确率下降到91.14%。此外,我们发现FOV和第二个任务在准确率上没有显著差异(F1,15=0.897,p=0.359;F1,15=0.377,p=0.548)。

图11-参与者使用两种不同的方法获取目标的主观评分。误差线表示标准偏差。

第二个任务的演示

第二个任务演示的结果支持假设1,即非用眼方法对正在进行的任务造成的干扰较少。RM-ANOVA结果显示,使用眼(平均反应=89.911%)比非用眼(平均反应=97.176%;F1,15=40.196,p<0.001)更容易导致第二项任务的失误。由于非用眼方法避免了用户频繁的焦点切换,因此他们可以持续地对第二个任务进行视觉关注。当FOV值较小时,用户对第二项任务的应答率也显著降低(平均值为91.70%,95.39%;F1,15=7.073,p=0.018)。两种不同视场的影响(F1,15=4.843,p=0.044)表明,当视场较小时,两种方式的差异增大。非用眼方法具备更大的优势(delta从4.64%增加到9.90%),这可能是因为用户使用使用眼方法获取目标所花费的时间更长,因此错过了第二个任务的更多内容。

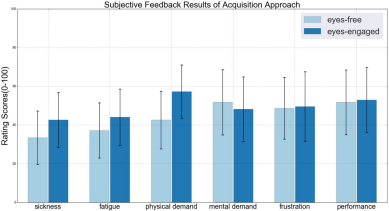

主观反馈

Wilcoxon试验的结果支持假设1,使用非用眼的实验者比使用眼的实验者有更轻的疲劳(Z=-4.528,p<0.001)和更少的不适(Z=-5.305,p<0.001)。由于非用眼的方式减少了使用者的头部运动,有效地缓解了使用者的身体需求(Z=-6.226,p<0.001)和VR导致的怪异感受。然而,使用眼睛的方法,用户可以粗略地将头部转向目标所在的区域,并在头部旋转后进行视觉搜索。而非用眼方法则要求用户在获取目标之前清楚地考虑目标的确切位置。此外,两种方法在挫折感和感知绩效上均无显著差异。图11显示了所有维度的主观评分。

此外,我们还收集了参与者对两种方法的偏好的评论。13/16的参与者表明他们更倾向于非用眼采集。我们采访了那些更喜欢使用眼的参与者。他们报告说,如果他们在获得目标时看到了目标,就会获得更多的信心,而一名参与者则懒得考虑具体的位置。”在我看来,对我来说,想一想目标的位置比搜索它更难。对于更喜欢无眼方法的参与者,他们报告说,他们节省了头部旋转和使用无眼方法进行视觉搜索的时间和精力;当有第二个任务时,无眼获取帮助他们避免丢失他们想要观察的内容。”当我在视觉上搜索目标时,我不知道自己是否错过了一个任务。”;当FOV很小时,非用眼采集帮助他们避免了高昂的回头成本。”我根本不想在较小的视场下转头,因为在较大的范围内转头会让我感到恶心。”一位参与者还提出了一种两种情况的混合方法,“我想搜索附近的目标,而在我身后的目标,我希望抓住他们的眼睛自由”。总体评论支持假设3。

讨论

基于研究1和研究2的结果,我们建议不要将目标放置在很高的高度或右后方区域。我们研究的目标被描绘成球体。不过一些人也对实物的布局设计提出了建议。他们建议,物体位置的安排应符合其日常的规律。例如,他们喜欢把灯开关放在高处,垃圾箱放在脚下。由于后面的区域很难到达,他们更喜欢把很少使用的物体放在那里。对于他们成对使用的物品(笔和纸),他们建议把它们放在两边,然后用双手去拿。研究3中的目标布局是预先定义的,但是,在未来,我们可以测试如果用户自己定义目标布局,将如何影响性能和用户体验。

在实际应用中使用非用眼采集还有一些设计细节有待探讨。首先,需要避免误报(???这个误报没理解是什么)。在研究3中,我们计算出离用户采集点最近的目标作为所选目标。这种实现可能会遇到一些误报的问题。我们可以使用阈值较小(10-20厘米)的区域光标(这地方没看懂)来降低这种风险,但如果是这样,我们需要承担准确性损失作为权衡。在实验3中,我们设计了第二个任务来测试当用户需要获取一个对象时存在正在进行的任务的情况。我们实验中的任务强度相当低。用户只需要区分三种类型的字符(“a”、“b”、“c”)。当实际应用中(例如射击游戏中)正在进行的任务强度增加时,用户性能可能会受到更大的影响。对于AR应用,设计师可以参考研究3中30度FOV尺寸条件的结果,但需要考虑其他因素。我们将视图外的内容设置为纯黑,而AR应用程序实际上允许用户看到真实的环境。用户可能会利用真实物体作为地标,这可以帮助他们定位目标并建立空间记忆,并可能导致更高的捕获性能。除了我们讨论的示例之外,非用眼获取方法可能有利于涉及到频繁工具操作和开关的其他应用,例如使用武器进行战斗游戏。如实验3所示,用户可以专注于正在进行的工作、敌人或其他内容,以较少的分心获得对象。

限制和未来展望

本文对非用眼方法的一些影响因素进行了研究。一个因素是获得的反馈。除了用户自己的本体感觉反馈,提供触觉或听觉反馈可能有助于用户确保他们接触到目标。对反馈设计进行研究,包括反馈类型、反馈模式和反馈强度设计,具有一定的参考价值。另一个因素是目标和用户之间的距离。在这项研究中测试的所有目标位置都与使用者的身体有相同的距离,这很容易接近。我们可以进一步研究当目标更靠近或更远离用户时的性能和体验。第三个因素是参照系。正如Cockburn总结的那样,空间位置可以是绝对的,相对于外部物体、身体、设备或某种混合组合。在我们的实验中,我们将目标放置在绝对的位置上,因为这与现实世界的体验是一致的,而且还支持用户本体感觉的布局是稳定的。我们将在未来探索用户在身体参考或控制器参考帧中自由获取目标的可能性。

结论

本文通过三个方面的研究,对虚拟现实中物体周围交互空间中目标的非用眼进行了研究。在研究1和研究2中,我们测试了无眼获得的主观接受和控制准确性。我们探索了用户感到舒适的位置和他们需要获得的目标之间的最小距离。然后测量了不同位置时用户采集点到目标的偏移量,并测试了身体旋转对其控制精度的影响。在研究3中,通过比较非用眼和使用眼的效率,我们发现非用眼获取目标的方法更快,并且疲劳度降低、更少的对其他正在进行的任务的分心。尽管这可能导致更强烈的精神需求和相对较低的准确性(92.59%对18个目标98.87%)。总的来说,大多数用户(13/16)更喜欢非用眼采集,而不是使用眼采集,特别是当FOV很小或有第二个任务时。根据结果和用户反馈,我们对实际应用中的布局设计和设计建议。

影响

这项工作得到了2016YFB1001200号国家重点研究开发计划、61672314号和61572276号国家自然科学基金、清华大学研究基金20151080408号的资助,也得到了北京网络多媒体重点实验室的支持。

浙公网安备 33010602011771号

浙公网安备 33010602011771号